La tecnología implementada en el mundo real enfrenta inevitablemente desafíos imprevistos. Estos desafíos surgen porque el entorno donde se desarrolló la tecnología difiere del entorno donde se implementará. Cuando una tecnología se transfiere con éxito decimos que se generaliza. en un sistema multiagente, como la tecnología de vehículos autónomos, hay dos posibles fuentes de dificultad de generalización: (1) variación del entorno físico, como cambios en el clima o la iluminación, y (2) variación del entorno social: cambios en el comportamiento de otros individuos que interactúan. Manejar la variación del entorno social es al menos tan importante como manejar la variación del entorno físico, aunque ha sido mucho menos estudiado.

Como ejemplo de entorno social, consideremos cómo los coches autónomos interactúan en la carretera con otros coches. Cada automóvil tiene un incentivo para transportar a su propio pasajero lo más rápido posible. Sin embargo, esta competencia puede conducir a una mala coordinación (congestión vial) que afecta negativamente a todos. Si los automóviles funcionan de manera cooperativa, más pasajeros podrían llegar a su destino más rápidamente. Este conflicto se llama dilema social.

Sin embargo, no todas las interacciones son dilemas sociales. Por ejemplo, hay sinérgico interacciones en el software de código abierto, hay suma cero interacciones en los deportes, y problemas de coordinación son el núcleo de las cadenas de suministro. Navegar en cada una de estas situaciones requiere un enfoque muy diferente.

El aprendizaje por refuerzo de múltiples agentes proporciona herramientas que nos permiten explorar cómo los agentes artificiales pueden interactuar entre sí y con individuos desconocidos (como los usuarios humanos). Se espera que esta clase de algoritmos funcione mejor que otros cuando se prueban sus capacidades de generalización social. Sin embargo, hasta ahora no ha habido ningún punto de referencia de evaluación sistemático para evaluar esto.

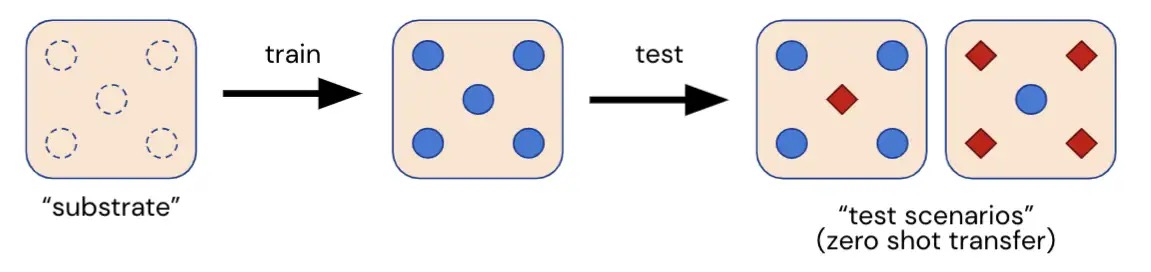

Aquí presentamos Melting Pot, un conjunto de evaluación escalable para el aprendizaje por refuerzo de múltiples agentes. Melting Pot evalúa la generalización a situaciones sociales novedosas que involucran a individuos familiares y desconocidos, y ha sido diseñado para probar una amplia gama de interacciones sociales como: cooperación, competencia, engaño, reciprocidad, confianza, terquedad, etc. Melting Pot ofrece a los investigadores un conjunto de 21 “sustratos” MARL (juegos de múltiples agentes) en los que entrenar agentes, y más de 85 escenarios de prueba únicos en los que evaluar a estos agentes entrenados. El desempeño de los agentes en estos escenarios de prueba pendientes cuantifica si los agentes:

- Desempeñarse bien en una variedad de situaciones sociales donde los individuos son interdependientes,

- Interactuar eficazmente con personas desconocidas que no se ven durante el entrenamiento.

- Pasar una prueba de universalización: responder positivamente a la pregunta “¿y si todo el mundo se comportara así?”.

La puntuación resultante se puede utilizar para clasificar diferentes algoritmos de RL multiagente según su capacidad para generalizar a situaciones sociales novedosas.

Esperamos que Melting Pot se convierta en un punto de referencia estándar para el aprendizaje por refuerzo de múltiples agentes. Planeamos mantenerlo y lo ampliaremos en los próximos años para cubrir más interacciones sociales y escenarios de generalización.

Obtenga más información de nuestro página de GitHub.