Los modelos de difusión de texto a imagen son modelos generativos que generan imágenes en función del mensaje de texto proporcionado. El texto se procesa mediante un modelo de difusión, que comienza con una imagen aleatoria y la mejora iterativamente palabra por palabra en respuesta al mensaje. Lo hace agregando y eliminando ruido a la idea, guiándola gradualmente hacia un resultado final que coincida con la descripción textual.

En consecuencia, Google DeepMind ha presentó Imagen 2, una importante tecnología de difusión de texto a imagen. Este modelo permite a los usuarios producir imágenes detalladas y muy realistas que coinciden estrechamente con la descripción del texto. La compañía afirma que esta es su tecnología de difusión de texto a imagen más sofisticada hasta el momento y que tiene características impresionantes de pintura y pintura.

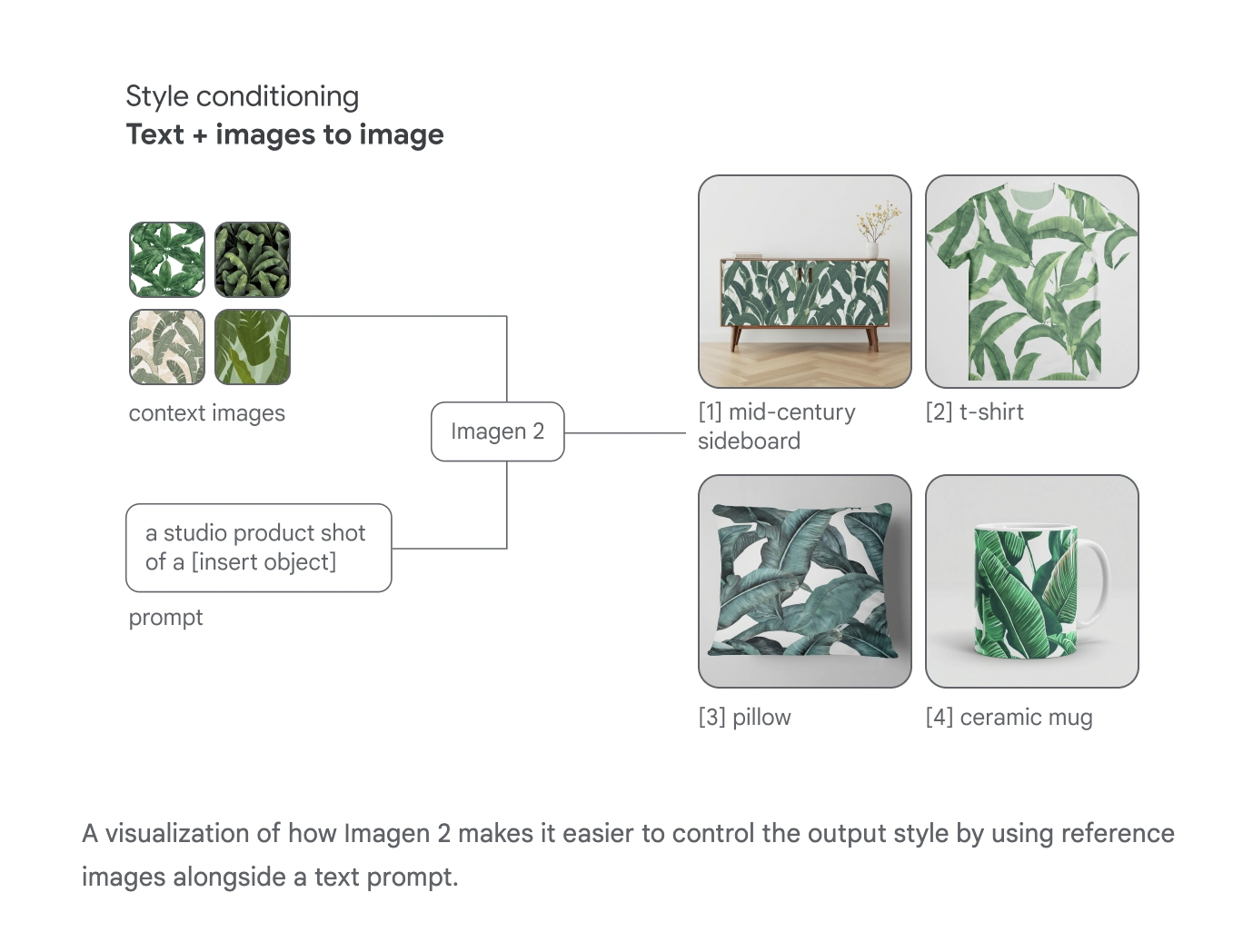

Inpainting permite a los usuarios agregar contenido nuevo directamente a las imágenes existentes sin afectar el estilo de la imagen. Por otro lado, pintar permitirá a los usuarios ampliar la foto y agregar más contexto. Estas características hacen de Imagen 2 una herramienta flexible para diversos usos, incluido el estudio científico y la creación artística. Imagen 2, a diferencia de versiones anteriores y tecnologías similares, utiliza técnicas basadas en difusión, que ofrecen una mayor flexibilidad a la hora de generar y controlar imágenes. En Imagen 2, se puede ingresar un mensaje de texto junto con una o varias imágenes de estilo de referencia, e Imagen 2 aplicará automáticamente el estilo deseado a la salida generada. Esta característica facilita la obtención de una apariencia uniforme en varias fotografías.

Debido a una asociación insuficientemente detallada o imprecisa, los modelos tradicionales de texto a imagen deben ser más consistentes en detalle y precisión. Imagen 2 tiene títulos de imágenes detallados en el conjunto de datos de entrenamiento para superar esto. Esto permite que el modelo aprenda varios estilos de subtítulos y generalice su comprensión a las indicaciones del usuario. La arquitectura y el conjunto de datos del modelo están diseñados para abordar problemas comunes que encuentran las técnicas de conversión de texto a imagen.

El equipo de desarrollo también ha incorporado un modelo de puntuación estética que tiene en cuenta las preferencias de iluminación, la composición, la exposición y el enfoque de los humanos. A cada imagen en el conjunto de datos de entrenamiento se le asigna una puntuación estética única que afecta la probabilidad de que la imagen sea elegida en iteraciones posteriores. Además, los investigadores de Google DeepMind han introducido la API Imagen dentro de Google Cloud Vertex AI, que proporciona acceso a clientes y desarrolladores de servicios en la nube. Además, la empresa se asocia con Google Arts & Culture para incorporar Imagen 2 en su plataforma de aprendizaje interactivo Cultural Icons, que permite a los usuarios conectarse con personalidades históricas a través de experiencias inmersivas impulsadas por IA.

En conclusión, Imagen 2 de Google DeepMind avanza significativamente en la tecnología de conversión de texto a imagen. Su enfoque innovador, su conjunto de datos de capacitación detallado y su énfasis en la alineación de las indicaciones del usuario la convierten en una herramienta poderosa para desarrolladores y clientes de la nube. La integración de capacidades de edición de imágenes solidifica aún más su posición como una poderosa herramienta de generación de texto a imagen. Puede utilizarse en diversas industrias para expresión artística, recursos educativos y emprendimientos comerciales.

Rachit Ranjan es pasante de consultoría en MarktechPost. Actualmente está cursando su B.Tech en el Instituto Indio de Tecnología (IIT) de Patna. Está dando forma activamente a su carrera en el campo de la inteligencia artificial y la ciencia de datos y le apasiona y se dedica a explorar estos campos.