La inteligencia artificial ha avanzado significativamente en el desarrollo de sistemas que pueden interpretar y responder a datos multimodales. A la vanguardia de esta innovación se encuentra Lumos, un innovador sistema multimodal de respuesta a preguntas diseñado por investigadores de Meta Reality Labs. A diferencia de los sistemas tradicionales, Lumos se distingue por su capacidad excepcional para extraer y comprender texto a partir de imágenes, mejorando la entrada a modelos multimodales de lenguaje grande (MM-LLM). Esta capacidad es fundamental, especialmente cuando se trata de imágenes capturadas desde un punto de vista en primera persona, donde la presencia del texto varía en claridad, tamaño y orientación.

La creación de Lumos fue motivada por el desafío de cerrar la brecha entre la interpretación de datos visuales y la comprensión textual. Tradicionalmente, las tecnologías de reconocimiento óptico de caracteres (OCR) han necesitado ayuda con la diversidad y complejidad de los textos de las escenas. Estos desafíos incluyen, entre otros, diferentes tamaños de fuente, estilos, orientaciones y la calidad general del texto capturado en escenarios del mundo real. Esta variabilidad a menudo conducía a imprecisiones que podían descarrilar la capacidad de comprensión de los sistemas multimodales.

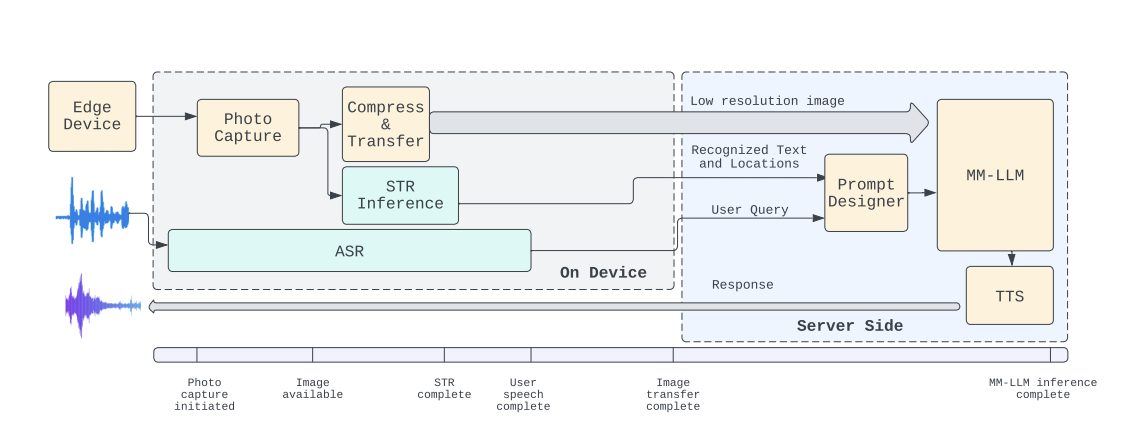

El equipo de Lumos en Meta Reality Labs ideó un novedoso componente de reconocimiento de texto en escena (STR) para contrarrestar estos obstáculos. Este componente está ingeniosamente diseñado para capturar texto de imágenes con precisión, alimentando así datos enriquecidos en MM-LLM. La inclusión estratégica de STR amplifica significativamente la comprensión de Lumos sobre el contenido visual, permitiéndole ofrecer respuestas más precisas y contextualmente relevantes a las consultas de los usuarios.

Profundizar en la metodología de Lumos revela una arquitectura de sistema sofisticada que aborda meticulosamente las complejidades del reconocimiento de texto y la comprensión multimodal. El equipo exploró los desafíos de STR de manera integral, incluido garantizar la extracción de texto de alta calidad, minimizar la latencia para el procesamiento en tiempo real y optimizar la inferencia del modelo para lograr eficiencia. A través de un proceso iterativo de diseño, pruebas y refinamiento, Lumos fue diseñado para sobresalir en aplicaciones del mundo real donde la variabilidad del texto de la imagen es enorme.

La evaluación del desempeño de Lumos subraya su superioridad y eficiencia en el panorama de los sistemas multimodales de respuesta a preguntas. Por ejemplo, Lumos logró una tasa de precisión del 80% en tareas de respuesta a preguntas, un salto significativo con respecto a las capacidades de los sistemas existentes. Este notable desempeño se atribuye al componente STR, que aumentó la precisión de las respuestas a las preguntas en un 28 %. Estas cifras resaltan la eficacia de Lumos y su potencial para redefinir las interacciones con el contenido visual.

Además, las consideraciones de diseño del sistema para el procesamiento en el dispositivo subrayan el compromiso con la experiencia del usuario. Al optimizar una baja latencia y una inferencia eficiente del modelo, Lumos garantiza que las maravillas de la comprensión multimodal sean accesibles en aplicaciones en tiempo real, estableciendo un nuevo estándar para los sistemas interactivos de IA.

En conclusión, el desarrollo de Lumos por parte de Meta Reality Labs marca un momento crucial en la evolución de los sistemas multimodales de respuesta a preguntas. Al superar hábilmente los desafíos asociados con el reconocimiento de textos de escenas y aprovechar técnicas de modelado avanzadas, Lumos ofrece una visión del futuro de la IA, donde los sistemas pueden combinar perfectamente la comprensión visual y textual para interactuar con el mundo que nos rodea de maneras sin precedentes. A través de su enfoque innovador y sus impresionantes métricas de rendimiento, Lumos no solo mejora las capacidades de los MM-LLM sino que también allana el camino para nuevas aplicaciones en diversos dominios, anunciando una nueva era de sistemas inteligentes.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 37k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Muhammad Athar Ganaie, pasante de consultoría en MarktechPost, es un defensor del aprendizaje profundo eficiente, con especial atención en la capacitación dispersa. Cursando un M.Sc. en Ingeniería Eléctrica, con especialización en Ingeniería de Software, combina conocimientos técnicos avanzados con aplicaciones prácticas. Su esfuerzo actual es su tesis sobre “Mejora de la eficiencia en el aprendizaje por refuerzo profundo”, que muestra su compromiso de mejorar las capacidades de la IA. El trabajo de Athar se encuentra en la intersección “Capacitación escasa en DNN” y “Aprendizaje por refuerzo profundo”.