La importancia de la informática y el tamaño de los datos es innegable en el aprendizaje multimodal a gran escala. Aún así, recopilar datos de texto en vídeo de alta calidad siempre resulta complicado debido a su estructura temporal. Los conjuntos de datos de lenguaje de visión (VLD) como HD-VILA-100M y HowTo100M se emplean ampliamente en diversas tareas, incluido el reconocimiento de acciones, la comprensión de videos, VQA y la recuperación. Estos modelos están anotados mediante reconocimiento automático de voz (ASR), lo que les permite transcribir el lenguaje hablado en texto y mejorar su rendimiento.

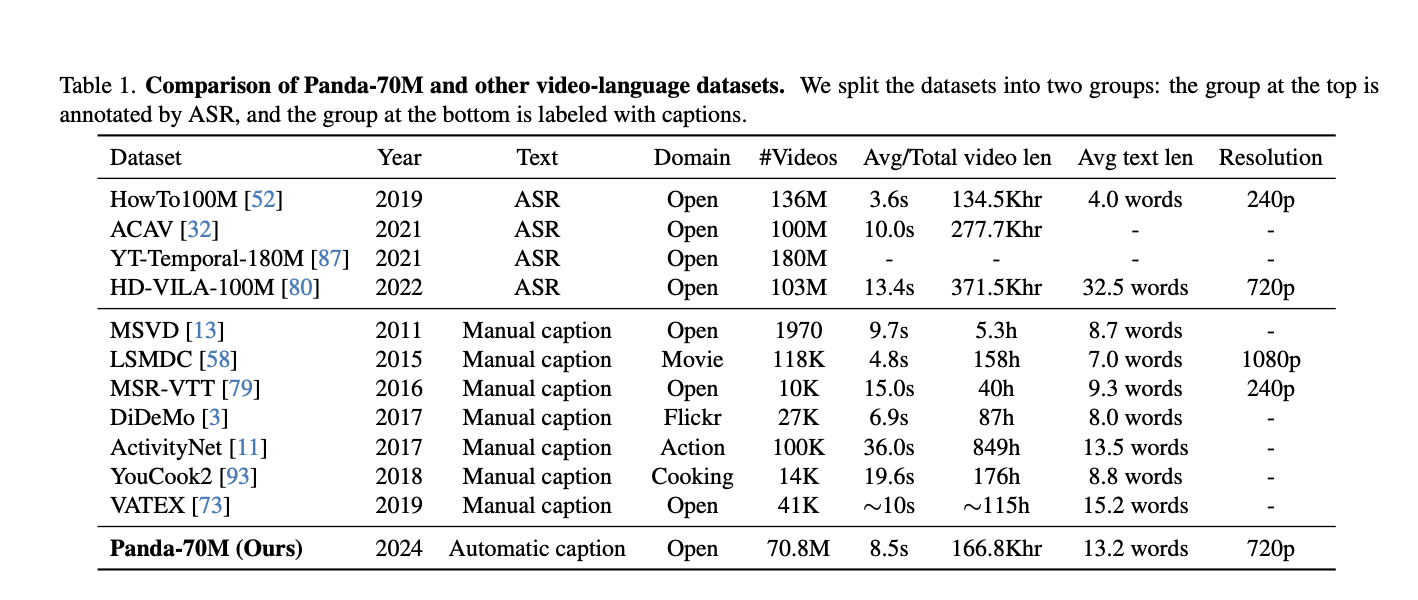

Sin embargo, la metainformación, como los subtítulos, las descripciones de los vídeos y las voces en off, con frecuencia necesitan más precisión debido a que son demasiado amplias, están desalineadas en el tiempo o no son lo suficientemente descriptivas del contenido del vídeo. Si utilizamos VLD como HD-VILA-100M y HowTo100M, los subtítulos normalmente no incluyen el contenido principal y la acción presentada en el vídeo. Esta limitación reduce la eficacia de estos conjuntos de datos para el entrenamiento multimodal. Algunos conjuntos de datos sufren de baja resolución, anotaciones ASR, muestras a pequeña escala o subtítulos breves.

Investigadores de Snap Inc., la Universidad de California, Merced y la Universidad de Trento propusieron Panda-70M para afrontar el desafío de generar subtítulos de vídeo de alta calidad. Panda-70M aprovecha entradas multimodales, como descripción textual de video, subtítulos y fotogramas de video individuales, para establecer un conjunto de datos de video con subtítulos de alta calidad mediante la selección de 3,8 millones de videos de alta resolución a partir de conjuntos de datos HD-VILA-100M disponibles públicamente. Además, para utilizar varios subtítulos, Panda-70M incorpora cinco modelos base: Video LLaMA, VideoChat, VideoChat Text, BLIP-2 y MiniGPT-4 como modelos docentes. Los investigadores siguen protocolos establecidos y evalúan métricas como BLEU-4, ROGUE-L, METEOR y CIDEr.

Para desarrollar Panda-70M, videos de alta resolución de 3,8 millones meticulosamente elaborados se dividen en videoclips semánticamente consistentes, aprovechando múltiples modelos de docentes de modalidad cruzada. Luego, se ajusta un modelo de recuperación detallado para obtener subtítulos para cada vídeo. Los modelos entrenados con la puntuación de datos propuesta superan consistentemente a otros en la mayoría de las métricas, lo que demuestra su superioridad en diversas tareas. En comparación con otros VLD, Panda-70M tardó un promedio de 8,5 segundos en procesar un vídeo de 166,8 Khr de duración, que es el más eficiente de todos los VLD.

En el procesamiento visual, utilizamos un marco familiar, similar al empleado en Video LLaMA, para derivar representaciones de video compatibles con LLM. Para la rama de texto, un enfoque directo sería ingresar texto incrustado directamente en el LLM. Sin embargo, esto plantea dos desafíos:

- Las indicaciones de texto extensas que contienen descripciones de videos y subtítulos pueden abrumar el proceso de toma de decisiones del LLM, lo que resulta en cargas computacionales intensivas.

- La información derivada de las descripciones y los subtítulos a menudo puede ser ruidosa e irrelevante para el contenido del vídeo.

- Los investigadores también introdujeron el texto Q-former, diseñado para extraer representaciones de texto de longitud fija, fomentando así una conexión más fluida entre las representaciones de vídeo y texto. Este Q-former refleja la arquitectura del Query Transformer que se encuentra en BLIP-2.

En conclusión, esta investigación presenta un conjunto de datos de video a gran escala con anotaciones de subtítulos llamado Panda-70M. Se ha propuesto un canal automático que puede aprovechar la información multimodal para subtitular 70 millones de vídeos y facilitar tres tareas posteriores: subtítulos de vídeo, recuperación de vídeo y texto, y generación de texto a vídeo. A pesar de los impresionantes resultados, Panda-70M limita la diversidad de contenido dentro de un solo vídeo y reduce la duración promedio del vídeo; por lo tanto, no logra crear conjuntos de datos con videos largos.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 38k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

También te puede gustar nuestro Cursos GRATUITOS de IA….

Sajjad Ansari es un estudiante de último año de IIT Kharagpur. Como entusiasta de la tecnología, profundiza en las aplicaciones prácticas de la IA centrándose en comprender el impacto de las tecnologías de IA y sus implicaciones en el mundo real. Su objetivo es articular conceptos complejos de IA de una manera clara y accesible.