En los últimos años, el aprendizaje automático se ha alejado significativamente de la suposición de que los datos de entrenamiento y prueba provienen de la misma distribución. Los investigadores han identificado que los modelos funcionan mejor cuando manejan datos de múltiples distribuciones. Esta adaptabilidad a menudo se logra a través de lo que se conoce como “representaciones ricas”, que exceden las capacidades de los modelos entrenados bajo la regularización tradicional que induce la escasez o los métodos comunes de gradiente estocástico.

El desafío es optimizar los modelos de aprendizaje automático para que funcionen bien en varias distribuciones, no solo en aquella en la que fueron entrenados. Los modelos se ajustaron en grandes conjuntos de datos previamente entrenados y específicos para una tarea y luego se probaron en un conjunto de tareas diseñadas para comparar diferentes aspectos del sistema. Sin embargo, este método tiene limitaciones, especialmente cuando se trata de distribuciones de datos que difieren del conjunto de entrenamiento.

Los investigadores han explorado varios métodos para obtener representaciones versátiles, incluida la ingeniería de diversos conjuntos de datos, arquitecturas e hiperparámetros. Se han logrado resultados interesantes reponderando de manera adversa el conjunto de datos de entrenamiento y concatenando representaciones de múltiples redes. El ajuste de las redes residuales profundas es un proceso casi lineal, y la fase de entrenamiento final se limita a una cuenca de atracción casi convexa.

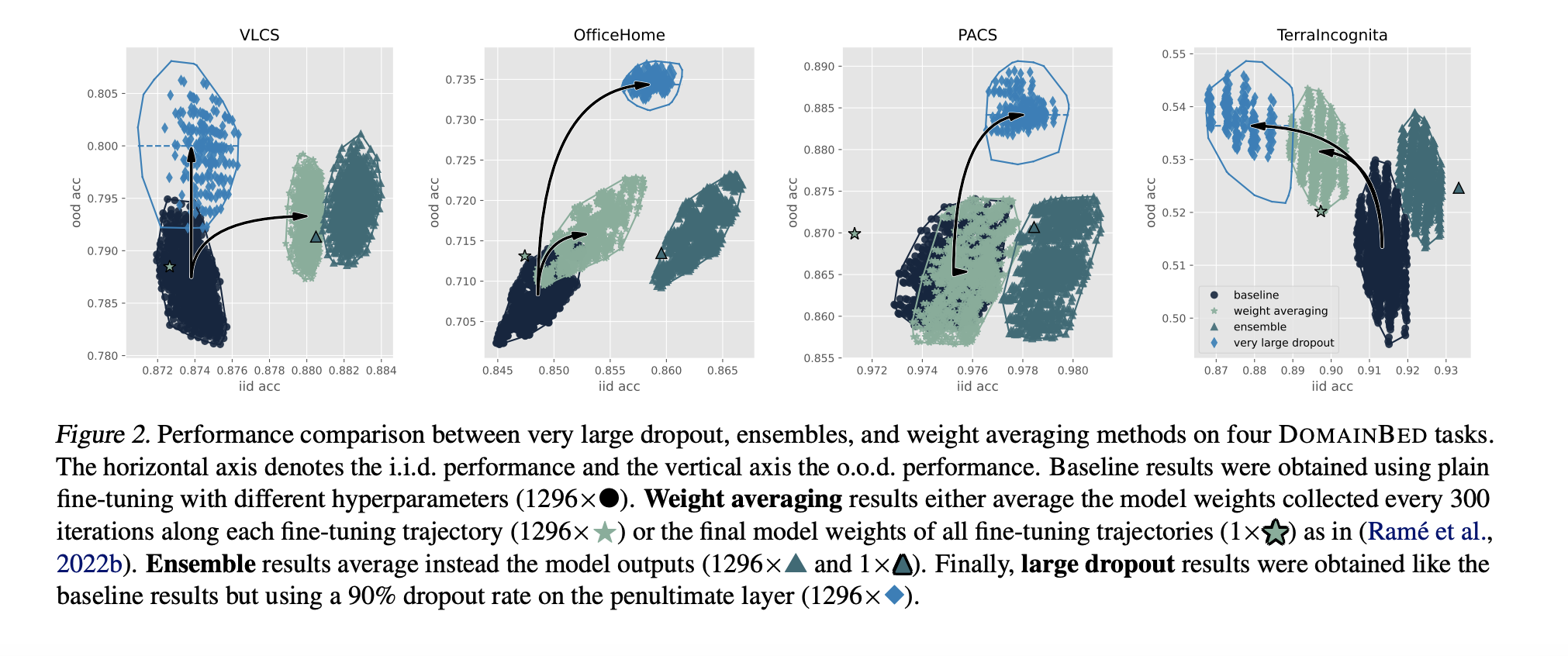

Investigadores de la Universidad de Nueva York y Facebook AI Research han introducido un enfoque novedoso para lograr un rendimiento fuera de distribución (OOD). Investigan el uso de tasas de abandono muy altas como alternativa a las técnicas de conjunto para obtener representaciones ricas. Convencionalmente, entrenar una red profunda desde cero con altas tasas de abandono es casi imposible debido a la complejidad y profundidad de la red. Sin embargo, ajustar un modelo previamente entrenado en tales condiciones es factible y supera el rendimiento logrado por conjuntos y métodos de promedio de peso como las sopas modelo.

El método emplea un sofisticado proceso de ajuste en una red de aprendizaje profundo con conexiones residuales, principalmente entrenada en extensos conjuntos de datos. Este proceso se caracteriza por aplicar tasas de abandono muy altas a la penúltima capa durante el ajuste fino, bloqueando efectivamente las contribuciones de todos los bloques residuales sin crear nuevas representaciones en lugar de aprovechar las existentes. La técnica se destaca por utilizar una aproximación de entrenamiento lineal, donde la aplicación de la deserción actúa como una forma de regularización más suave en comparación con su uso en sistemas no lineales. Sorprendentemente, este enfoque logra un rendimiento comparable o superior al de los métodos tradicionales, como los conjuntos y el promedio de peso, lo que demuestra su eficacia en diversas tareas de DOMAINBED.

Los resultados de rendimiento subrayan la eficacia de este método. El ajuste con altas tasas de deserción mejoró el desempeño de OOD en varios puntos de referencia. Por ejemplo, en el conjunto de datos VLCS, un punto de referencia de adaptación de dominio que plantea importantes desafíos para la generalización, los modelos ajustados con este método mostraron ganancias sustanciales. Los resultados indican un salto considerable en el rendimiento de OOD, lo que afirma el potencial del método para mejorar la solidez y confiabilidad del modelo en diversos conjuntos de datos.

En conclusión, la investigación proporciona un caso convincente para reevaluar las prácticas de ajuste en el aprendizaje automático. Al introducir y validar tasas de deserción escolar muy elevadas, la investigación ha abierto vías para desarrollar modelos más versátiles y robustos capaces de navegar las complejidades de diversas distribuciones de datos. Este método mejora nuestra comprensión de las representaciones enriquecidas y establece un nuevo punto de referencia para el rendimiento de OOD, lo que marca un importante paso adelante en la búsqueda de soluciones de aprendizaje automático más generalizadas.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 38k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

También te puede gustar nuestro Cursos GRATUITOS de IA….

Nikhil es consultor interno en Marktechpost. Está cursando una doble titulación integrada en Materiales en el Instituto Indio de Tecnología de Kharagpur. Nikhil es un entusiasta de la IA/ML que siempre está investigando aplicaciones en campos como los biomateriales y la ciencia biomédica. Con una sólida formación en ciencia de materiales, está explorando nuevos avances y creando oportunidades para contribuir.