El aprendizaje automático multimodal es un campo de investigación de vanguardia que combina varios tipos de datos, como texto, imágenes y audio, para crear modelos más completos y precisos. Al integrar estas diferentes modalidades, los investigadores pretenden mejorar la capacidad del modelo para comprender y razonar sobre tareas complejas. Esta integración permite que los modelos aprovechen las fortalezas de cada modalidad, lo que lleva a un rendimiento mejorado en aplicaciones que van desde el reconocimiento de imágenes y la PNL hasta el análisis de video y más.

El problema clave del aprendizaje automático multimodal es la ineficiencia e inflexibilidad de los grandes modelos multimodales (LMM) cuando se trata de imágenes y vídeos de alta resolución. Los LMM tradicionales, como LLaVA, utilizan una cantidad fija de tokens visuales para representar una imagen, lo que a menudo genera tokens excesivos para contenido visual denso. Esto aumenta los costos computacionales y degrada el rendimiento al saturar el modelo con demasiada información. En consecuencia, existe una necesidad apremiante de métodos que puedan ajustar dinámicamente la cantidad de tokens en función de la complejidad de la entrada visual.

Las soluciones existentes a este problema, como la poda y fusión de tokens, intentan reducir la cantidad de tokens visuales introducidos en el modelo de lenguaje. Sin embargo, estos métodos suelen generar una salida de longitud fija para cada imagen, lo que no permite flexibilidad para equilibrar la densidad de la información y la eficiencia. Necesitan adaptarse a distintos niveles de complejidad visual, lo que puede ser fundamental en aplicaciones como el análisis de vídeo, donde el contenido visual puede variar significativamente de un cuadro a otro.

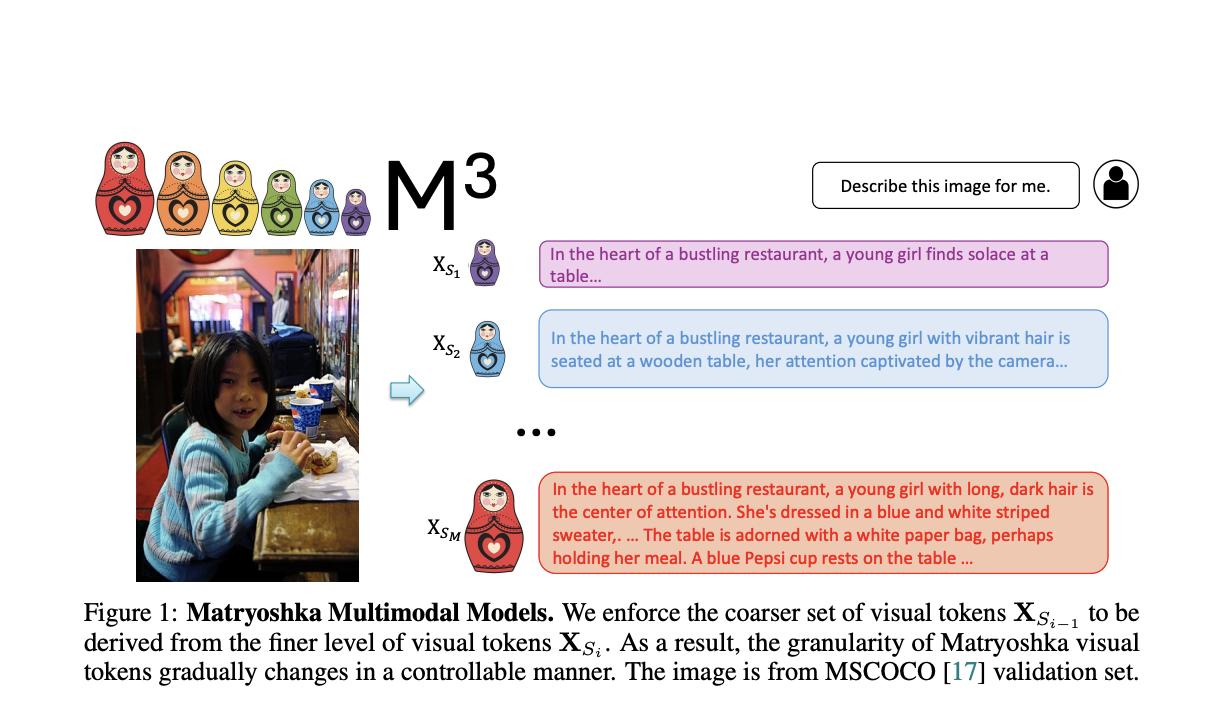

Los investigadores de la Universidad de Wisconsin-Madison y Microsoft Research presentaron Matrioska Modelos Multimodales (M3). Inspirado en el concepto de las muñecas Matryoshka, M3 representa contenido visual como conjuntos anidados de fichas visuales que capturan información en múltiples granularidades. Este novedoso enfoque permite un control explícito sobre la granularidad visual durante la inferencia, lo que permite ajustar la cantidad de tokens en función de la complejidad o simplicidad anticipada del contenido. Por ejemplo, una imagen con detalles densos se puede representar con más tokens, mientras que las imágenes más simples pueden usar menos tokens.

El modelo M3 logra esto codificando imágenes en múltiples conjuntos de tokens visuales con niveles de granularidad crecientes, de grueso a fino. Durante el entrenamiento, el modelo aprende a derivar tokens más gruesos a partir de otros más finos, lo que garantiza que la información visual se capture de manera eficiente. Específicamente, el modelo utiliza escalas como 1, 9, 36, 144 y 576 tokens, y cada nivel proporciona una representación progresivamente más fina del contenido visual. Esta estructura jerárquica permite que el modelo preserve la información espacial mientras adapta el nivel de detalle en función de los requisitos específicos.

Las evaluaciones de rendimiento del modelo M3 demuestran sus importantes ventajas. En los puntos de referencia estilo COCO, el modelo logró una precisión similar a la de usar los 576 tokens con solo aproximadamente 9 por imagen. Esto representa una mejora sustancial en la eficiencia sin comprometer la precisión. El modelo M3 también tuvo un buen desempeño en otros puntos de referencia, lo que demuestra que puede mantener un alto rendimiento incluso con una cantidad drásticamente reducida de tokens. Por ejemplo, la precisión del modelo con 9 tokens era comparable a la de Qwen-VL-Chat con 256 tokens y, en algunos casos, logró un rendimiento similar con solo 1 token.

El modelo puede adaptarse a diferentes limitaciones computacionales y de memoria durante la implementación al permitir un control flexible sobre la cantidad de tokens visuales. Esta flexibilidad es particularmente valiosa en aplicaciones del mundo real donde los recursos pueden ser limitados. El enfoque M3 también proporciona un marco para evaluar la complejidad visual de los conjuntos de datos, lo que ayuda a los investigadores a comprender la granularidad óptima necesaria para diversas tareas. Por ejemplo, mientras que los puntos de referencia de escenas naturales como COCO se pueden manejar con alrededor de 9 tokens, las tareas de percepción visual densa, como la comprensión de documentos o el OCR, requieren más tokens, que van desde 144 a 576.

En conclusión, Matryoshka Multimodal Models (M3) aborda las ineficiencias de los LMM actuales y proporciona un método flexible y adaptable para representar contenido visual, sentando las bases para sistemas multimodales más eficientes y efectivos. La capacidad del modelo para ajustar dinámicamente la cantidad de tokens visuales en función de la complejidad del contenido garantiza un mejor equilibrio entre el rendimiento y el costo computacional. Este enfoque innovador mejora las capacidades de comprensión y razonamiento de los modelos multimodales y abre nuevas posibilidades para su aplicación en entornos diversos y con recursos limitados.

Revisar la Papel y Proyecto. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 43k+ ML | Además, consulte nuestro Plataforma de eventos de IA

A Sana Hassan, pasante de consultoría en Marktechpost y estudiante de doble titulación en IIT Madras, le apasiona aplicar la tecnología y la inteligencia artificial para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una nueva perspectiva a la intersección de la IA y las soluciones de la vida real.