Este artículo explora el dominio de la cuantificación de la incertidumbre dentro de modelos de lenguaje grande (LLM) para identificar escenarios donde la incertidumbre en la respuesta a las consultas es significativa. El estudio abarca incertidumbres tanto epistémicas como aleatorias. La incertidumbre epistémica surge de la falta de conocimiento o datos sobre la verdad fundamental, mientras que la incertidumbre aleatoria surge de la aleatoriedad inherente al problema de predicción. Identificar adecuadamente estas incertidumbres es crucial para mejorar la confiabilidad y veracidad de las respuestas de LLM, especialmente para detectar y mitigar alucinaciones o respuestas inexactas generadas por estos modelos.

Actualmente existen varios métodos para detectar alucinaciones en modelos de lenguaje grandes (LLM), cada uno con su propio conjunto de limitaciones. Un método común es la probabilidad de la respuesta codiciosa (T0), que evalúa la probabilidad de la respuesta más probable generada por el modelo. Otro método es el método de entropía semántica (SE), que mide la entropía de la distribución semántica de las respuestas. Finalmente, el método de autoverificación (SV) implica que el modelo verifique sus respuestas para estimar la incertidumbre.

A pesar de su utilidad, estos métodos tienen desventajas notables. La probabilidad de una respuesta codiciosa suele ser sensible al tamaño del conjunto de etiquetas, lo que significa que puede no funcionar bien cuando hay muchas respuestas posibles. El método de entropía semántica (SE) se basa en puntuaciones de primer orden que no consideran la distribución conjunta de las respuestas, lo que puede conducir a evaluaciones de incertidumbre incompletas. De manera similar, el método de autoverificación (SV) no tiene en cuenta toda la gama de posibles respuestas que el modelo puede generar, lo que potencialmente pasa por alto aspectos importantes de incertidumbre.

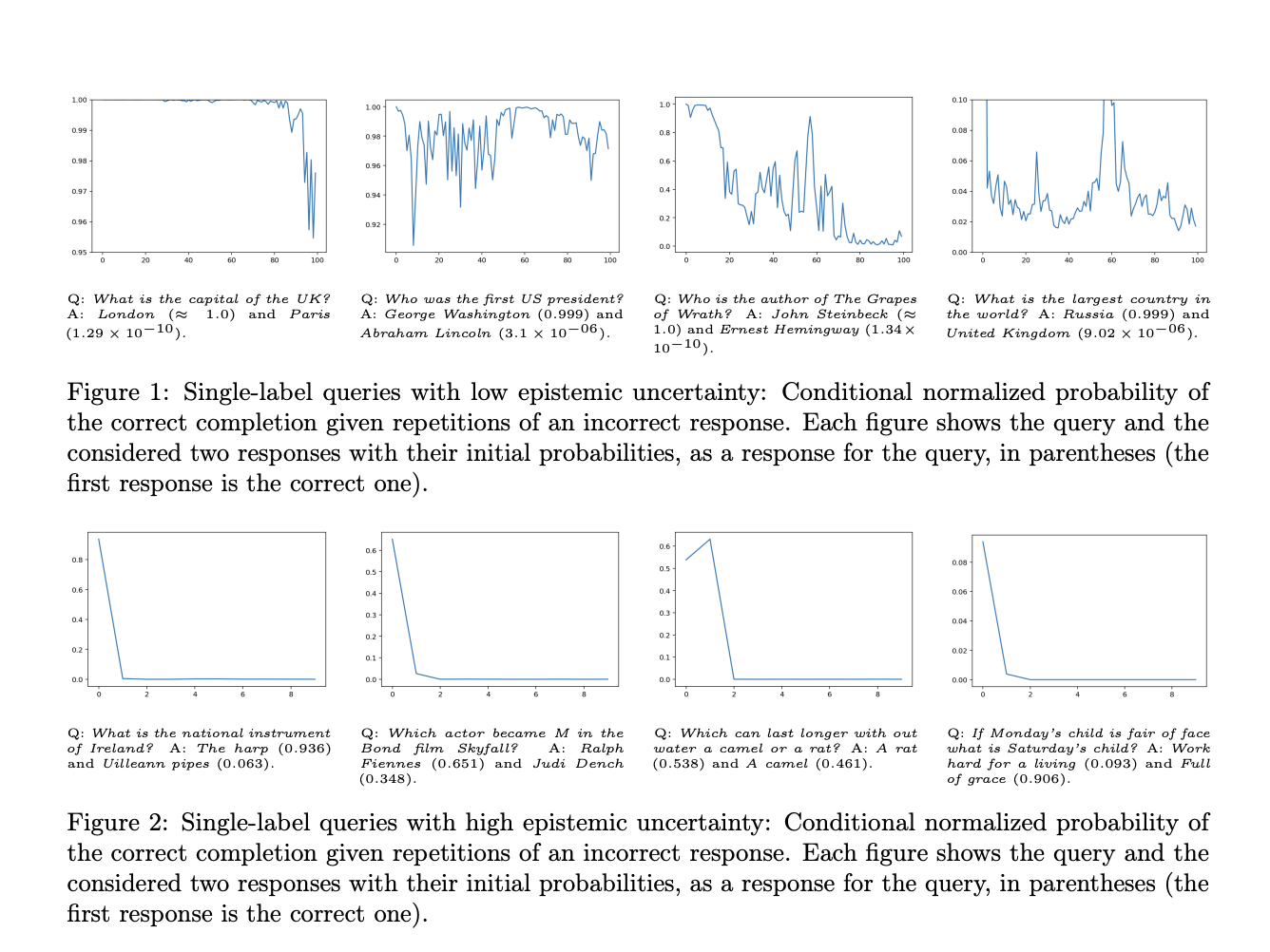

Para superar las limitaciones de los métodos actuales, el enfoque propuesto implica la creación de una distribución combinada para múltiples respuestas del LLM para una consulta específica mediante indicaciones iterativas. Esto implica pedirle al LLM que genere una respuesta a una consulta y luego pedirle que genere respuestas posteriores incluyendo las anteriores en el mensaje. La distribución conjunta se aproxima a la verdad fundamental si las respuestas son independientes, lo que indica una baja incertidumbre epistémica. Sin embargo, si las respuestas están influenciadas entre sí, significa una alta incertidumbre epistémica. Este procedimiento de estímulo iterativo permite a los investigadores derivar una métrica teórica de la información de la incertidumbre epistémica. Lo cuantifican midiendo la información mutua (IM) de la distribución conjunta de respuestas, que es insensible a la incertidumbre aleatoria. Se desarrolla un estimador de muestra finita para este IM, que demuestra tener un error insignificante en aplicaciones prácticas a pesar del soporte potencialmente infinito de los resultados del LLM.

También se analiza un algoritmo para la detección de alucinaciones basado en esta métrica IM. Al establecer un umbral mediante un procedimiento de calibración, el método demuestra un rendimiento superior en comparación con los enfoques tradicionales basados en la entropía, especialmente en conjuntos de datos con consultas mixtas de etiqueta única y etiqueta múltiple. Mantiene altas tasas de recuperación al tiempo que minimiza los errores, lo que la convierte en una herramienta sólida para mejorar la confiabilidad de los resultados de LLM.

Este artículo presenta un avance significativo en la cuantificación de la incertidumbre en los LLM al distinguir entre incertidumbre epistémica y aleatoria. Las indicaciones iterativas propuestas y la métrica basada en información mutua ofrecen una comprensión más matizada de la confianza del LLM, mejorando la detección de alucinaciones y mejorando la precisión general de la respuesta. Este enfoque aborda una limitación crítica de los métodos existentes y proporciona una solución práctica y efectiva para aplicaciones de LLM en el mundo real.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 44k+ ML

Shreya Maji es pasante de consultoría en MarktechPost. Obtuvo su B.Tech en el Instituto Indio de Tecnología (IIT), Bhubaneswar. Entusiasta de la IA, le gusta mantenerse actualizada sobre los últimos avances. Shreya está particularmente interesada en las aplicaciones de la tecnología de punta en la vida real, especialmente en el campo de la ciencia de datos.