Los modelos de lenguaje de gran tamaño (LLM) han ganado una tracción significativa en varios dominios, revolucionando aplicaciones desde agentes conversacionales hasta generación de contenido. Estos modelos demuestran capacidades excepcionales para comprender y producir texto similar al humano, lo que permite aplicaciones sofisticadas en diversos campos. Sin embargo, la implementación de LLM requiere mecanismos robustos para garantizar interacciones de usuario seguras y responsables. Las prácticas actuales a menudo emplean soluciones de moderación de contenido como LlamaGuard, WildGuard y AEGIS para filtrar las entradas y salidas de LLM en busca de posibles riesgos de seguridad. A pesar de proporcionar salvaguardas iniciales, estas herramientas enfrentan limitaciones. A menudo carecen de predicciones granulares de tipos de daño u ofrecen solo resultados binarios en lugar de probabilidades, lo que restringe el filtrado de daño personalizado o los ajustes de umbral. Además, la mayoría de las soluciones proporcionan modelos de tamaño fijo, que pueden no alinearse con las necesidades de implementación específicas. Con eso, la ausencia de instrucciones detalladas para construir datos de entrenamiento obstaculiza el desarrollo de modelos robustos frente a indicaciones adversas y justos entre grupos de identidad.

Los investigadores han logrado avances significativos en la moderación de contenido, en particular en el caso del contenido generado por humanos en las plataformas en línea. Herramientas como Perspective API han sido fundamentales para detectar lenguaje tóxico. Sin embargo, estos recursos suelen ser insuficientes cuando se aplican al contexto único de las indicaciones humanas y las respuestas generadas por LLM. Los avances recientes en la moderación de contenido de LLM han surgido a través de enfoques de ajuste, como se ve en modelos como Llama-Guard, Aegis, MD-Judge y WildGuard.

El desarrollo de modelos de seguridad robustos depende de datos de alta calidad. Si bien los datos de interacción entre humanos y computadoras son abundantes, su uso directo presenta desafíos debido a los ejemplos positivos limitados, la falta de datos contradictorios y diversos y las preocupaciones por la privacidad. Los LLM, utilizando su vasto conocimiento previo, han demostrado capacidades excepcionales para generar datos sintéticos alineados con los requisitos humanos. En el ámbito de la seguridad, este enfoque permite la creación de indicaciones diversas y altamente contradictorias que pueden probar y mejorar eficazmente los mecanismos de seguridad de los LLM.

Las políticas de seguridad desempeñan un papel crucial en la implementación de sistemas de IA en escenarios del mundo real. Estas políticas proporcionan pautas sobre el contenido aceptable tanto en las entradas del usuario como en las salidas del modelo. Tienen un doble propósito: garantizar la coherencia entre los anotadores humanos y facilitar el desarrollo de clasificadores de cero disparos/pocos disparos como soluciones listas para usar. Si bien las categorías de contenido no permitido son en gran medida consistentes tanto para las entradas como para las salidas, el énfasis difiere. Las políticas de entrada se centran en prohibir las solicitudes dañinas o los intentos de obtener contenido dañino, mientras que las políticas de salida apuntan principalmente a prevenir la generación de cualquier contenido dañino.

Investigadores de Google presentan EscudoGemmaun espectro de modelos de moderación de contenido que van desde parámetros 2B a 27B, construidos sobre Gemma2. Estos modelos filtran tanto la entrada del usuario como la salida del modelo para los tipos de daños clave, adaptándose a las distintas necesidades de la aplicación. La innovación radica en una metodología novedosa para generar conjuntos de datos de alta calidad, conflictivos, diversos y justos mediante técnicas de generación de datos sintéticos. Este enfoque reduce el esfuerzo de anotación humana y tiene una amplia aplicabilidad más allá de los desafíos relacionados con la seguridad. Al combinar arquitecturas escalables con generación avanzada de datos, ShieldGemma aborda las limitaciones de las soluciones existentes, ofreciendo un filtrado de contenido más matizado y adaptable en diferentes escenarios de implementación.

ShieldGemma presenta un enfoque integral para la moderación de contenido basado en el marco Gemma2. El método define una taxonomía detallada de seguridad de contenido para seis tipos de daño: información sexualmente explícita, discurso de odio, contenido peligroso, acoso, violencia y obscenidad y blasfemias. Esta taxonomía guía el proceso de toma de decisiones del modelo tanto para los escenarios de entrada del usuario como para los escenarios de salida del modelo.

La innovación principal radica en el proceso de curación de datos sintéticos. Este proceso comienza con la generación de datos sin procesar mediante AART (Automated Adversarial Red Teaming) para crear indicaciones diversas y adversarias. Luego, los datos se amplían mediante un marco de generación y autocrítica, lo que mejora la diversidad semántica y sintáctica. El conjunto de datos se amplía aún más con ejemplos de Anthropic HH-RLHF para aumentar la variedad.

Para optimizar el proceso de entrenamiento, ShieldGemma emplea un algoritmo de margen de clúster para el submuestreo de datos, equilibrando la incertidumbre y la diversidad. Los datos seleccionados se someten a una anotación humana, con expansión de equidad aplicada para mejorar la representación en varias categorías de identidad. Finalmente, el modelo se ajusta mediante aprendizaje supervisado en modelos Gemma2 Instruction-Tuned de distintos tamaños (parámetros 2B, 9B y 27B).

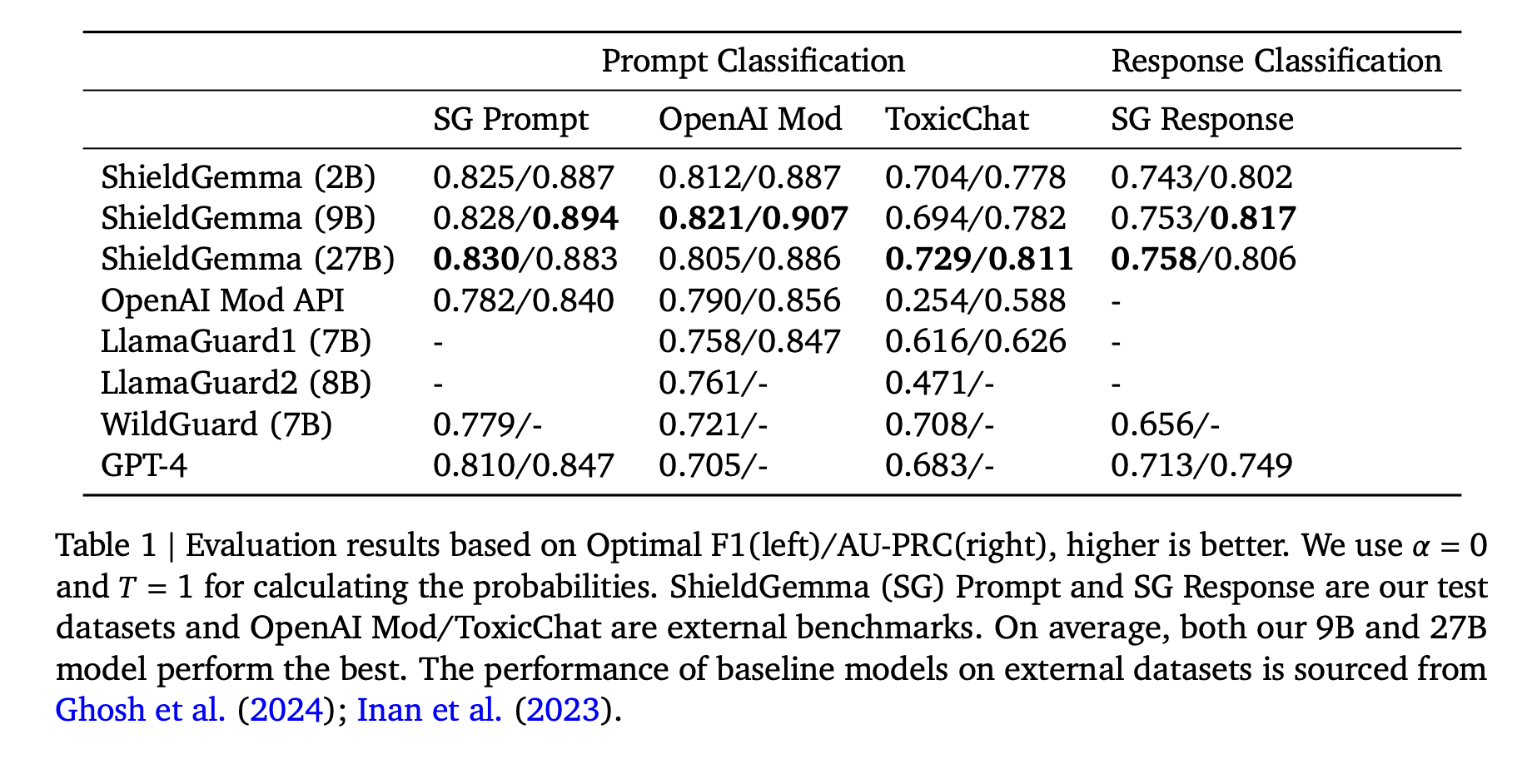

Los modelos ShieldGemma (SG) demuestran un rendimiento superior en tareas de clasificación binaria en todos los tamaños (parámetros 2B, 9B y 27B) en comparación con los modelos de referencia. El modelo SG-9B, en particular, logra un AU-PRC promedio un 10,8 % más alto en los puntos de referencia externos que LlamaGuard1, a pesar de tener un tamaño de modelo y un volumen de datos de entrenamiento similares. Además, el puntaje F1 del modelo 9B supera al de WildGuard y GPT-4 en un 4,3 % y un 6,4 %, respectivamente. Dentro de la familia ShieldGemma, el rendimiento es consistente en los puntos de referencia internos. Sin embargo, en los puntos de referencia externos, los modelos 9B y 27B muestran una capacidad de generalización ligeramente mejor, con puntajes AU-PRC promedio un 1,2 % y un 1,7 % más altos que el modelo 2B, respectivamente. Estos resultados resaltan la efectividad de ShieldGemma en tareas de moderación de contenido en varios tamaños de modelo.

ShieldGemma marca un avance significativo en la moderación de contenido de seguridad para modelos de lenguaje grandes. Este conjunto de modelos (parámetros 2B a 27B) desarrollado sobre Gemma2 demuestra un rendimiento superior en diversos puntos de referencia. La innovación clave radica en su novedoso proceso de generación de datos sintéticos, que produce conjuntos de datos diversos y de alta calidad, al tiempo que minimiza la anotación humana. Esta metodología se extiende más allá de las aplicaciones de seguridad y potencialmente beneficia a varios dominios de desarrollo de IA. Al superar las líneas de base existentes y ofrecer opciones de implementación flexibles, ShieldGemma mejora la seguridad y la confiabilidad de las interacciones de LLM. Compartir estos recursos con la comunidad de investigación tiene como objetivo acelerar el progreso en la seguridad de la IA y la implementación responsable.

Revisar la Papel y Tarjeta modelo HF. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Más de 47 000 suscriptores de ML en Reddit

Encuentra lo próximo Seminarios web sobre IA aquí

Asjad es consultor en prácticas en Marktechpost. Está cursando la licenciatura en ingeniería mecánica en el Instituto Indio de Tecnología de Kharagpur. Asjad es un entusiasta del aprendizaje automático y del aprendizaje profundo que siempre está investigando las aplicaciones del aprendizaje automático en el ámbito de la atención médica.