Los modelos de lenguaje de gran tamaño (LLM) basados en arquitecturas de decodificadores de transformadores autorregresivos han avanzado en el procesamiento del lenguaje natural con un rendimiento y una escalabilidad excepcionales. Recientemente, los modelos de difusión han ganado atención para las tareas de generación visual, eclipsando a los modelos autorregresivos (AM). Sin embargo, los AM muestran una mejor escalabilidad para aplicaciones a gran escala y funcionan de manera más eficiente con los modelos de lenguaje, lo que los hace más adecuados para unificar las tareas de lenguaje y visión. Los avances recientes en la generación visual autorregresiva (AVG) han mostrado resultados prometedores, igualando o superando a los modelos de difusión en calidad. A pesar de esto, aún existen desafíos importantes, especialmente en la eficiencia computacional debido a la alta complejidad de los datos visuales y las demandas computacionales cuadráticas de los transformadores.

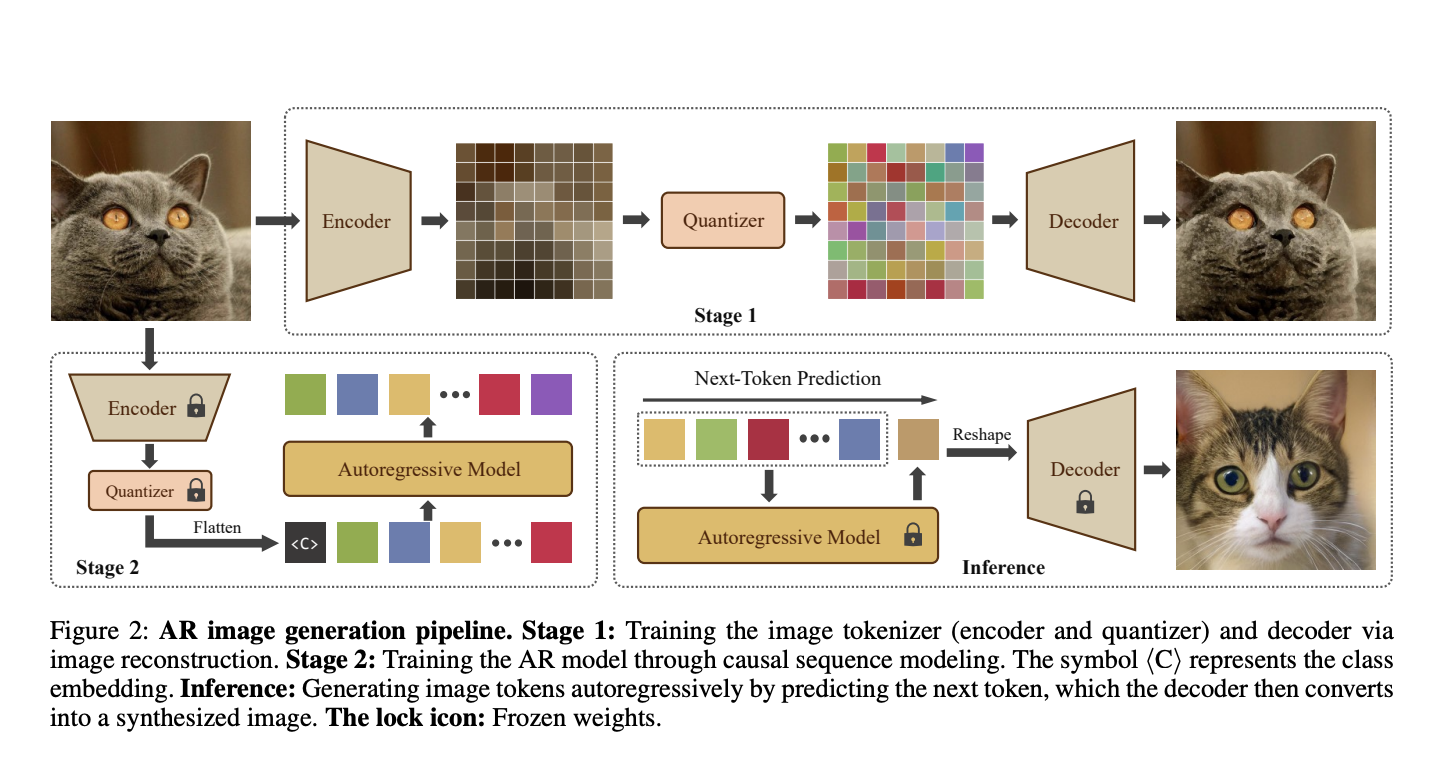

Los métodos existentes incluyen modelos basados en cuantificación vectorial (VQ) y modelos de espacio de estados (SSM) para resolver los desafíos de AVG. Los enfoques basados en VQ, como VQ-VAE, DALL-E y VQGAN, comprimen imágenes en códigos discretos y utilizan AM para predecir estos códigos. Los SSM, especialmente la familia Mamba, han demostrado potencial en la gestión de secuencias largas con complejidad computacional lineal. Las adaptaciones recientes de Mamba para tareas visuales, como ViM, VMamba, Zigma y DiM, han explorado estrategias de escaneo multidireccional para capturar información espacial 2D. Sin embargo, estos métodos agregan parámetros adicionales y costos computacionales, lo que disminuye la ventaja de velocidad de Mamba y aumenta los requisitos de memoria de la GPU.

Investigadores de la Universidad de Correos y Telecomunicaciones de Beijing, la Universidad de la Academia de Ciencias de China, la Universidad Politécnica de Hong Kong y el Instituto de Automatización de la Academia de Ciencias de China han propuesto AiM, un nuevo Autorregresivo iModelo de generación de magos basado en el METROAmba framework. Está desarrollado para la generación de imágenes condicionales de clase de alta calidad y eficiente, lo que lo convierte en el primer modelo de su tipo. Aim utiliza codificación posicional, lo que proporciona un nuevo y más generalizado método de normalización de capas adaptativas llamado adaLN-Group, que optimiza el equilibrio entre el rendimiento y el recuento de parámetros. Además, AiM ha demostrado un rendimiento de vanguardia entre los AM en el benchmark ImageNet 256×256 al tiempo que logra velocidades de inferencia rápidas.

AiM se desarrolló en cuatro escalas y se evaluó en el benchmark ImageNet1K para evaluar su diseño arquitectónico, rendimiento, escalabilidad y eficiencia de inferencia. Utiliza un tokenizador de imágenes con un factor de submuestreo de 16, inicializado con pesos entrenados previamente de LlamaGen. Cada imagen de 256 × 256 se tokeniza en 256 tokens. El entrenamiento se realizó en GPU A100 de 80 GB utilizando el optimizador AdamW con hiperparámetros específicos. Las épocas de entrenamiento varían entre 300 y 350 según la escala del modelo, y se aplicó una tasa de abandono de 0,1 a las incrustaciones de clases para una guía sin clasificador. Las métricas de evaluación utilizaron la distancia de inicio de Frechet (FID) como la métrica principal para evaluar el rendimiento del modelo en tareas de generación de imágenes.

AiM mostró importantes mejoras de rendimiento a medida que aumentaba el tamaño del modelo y la duración del entrenamiento, con un fuerte coeficiente de correlación de -0,9838 entre las puntuaciones FID y los parámetros del modelo. Esto demuestra la escalabilidad de AiM y la eficacia de los modelos más grandes para mejorar la calidad de generación de imágenes. Logró un rendimiento de vanguardia entre los AM como las GAN, los modelos de difusión, los modelos generativos enmascarados y los AM basados en Transformer. Además, AiM tiene una clara ventaja en la velocidad de inferencia en comparación con otros modelos, y los modelos basados en Transformer se benefician de las optimizaciones Flash-Attention y KV Cache.

En conclusión, los investigadores han presentado Aim, un nuevo modelo de generación de imágenes autorregresivas basado en el marco Mamba. Este artículo explora el potencial de Mamba en tareas visuales, adaptándolo con éxito a la generación visual sin necesidad de escaneos multidireccionales adicionales. La efectividad y eficiencia de AiM resaltan su escalabilidad y amplia aplicabilidad en el modelado visual autorregresivo. Sin embargo, se centra solo en la generación condicional de clases, sin explorar la generación de texto a imagen, lo que proporciona direcciones para futuras investigaciones para mayores avances en el campo de la generación visual utilizando modelos de espacio de estados como Mamba.

Echa un vistazo a la Papel y GitHub. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa..

No olvides unirte a nuestro Subreddit con más de 50 000 millones de usuarios

A continuación se muestra un seminario web muy recomendado por nuestro patrocinador: ‘Desarrollo de aplicaciones de IA de alto rendimiento con NVIDIA NIM y Haystack’

Sajjad Ansari es un estudiante de último año de la carrera de IIT Kharagpur. Como entusiasta de la tecnología, se adentra en las aplicaciones prácticas de la IA, centrándose en comprender el impacto de las tecnologías de IA y sus implicaciones en el mundo real. Su objetivo es articular conceptos complejos de IA de una manera clara y accesible.