El tema de la mezcla de regresiones fue analizado profundamente en el artículo. https://medium.com/towards-data-science/introduction-to-the-finite-normal-mixtures-in-regression-with-6a884810a692. He presentado resultados totalmente reproducibles para mejorar la regresión lineal tradicional al tener en cuenta las relaciones no lineales y la heterogeneidad no observada en los datos.

Los modelos de mezcla finita suponen que los datos se generan mediante una combinación de múltiples subpoblaciones, cada una modelada por su propio componente de regresión. Utilizando métodos R y Bayesianos, he demostrado cómo simular y ajustar dichos modelos mediante el muestreo de Markov Chain Monte Carlo (MCMC).

Este enfoque es particularmente valioso para capturar patrones de datos complejos, identificar subpoblaciones y proporcionar predicciones más precisas e interpretables en comparación con las técnicas estándar, manteniendo al mismo tiempo un alto nivel de interpretabilidad.

Cuando se trata de análisis de datos, una de las tareas más desafiantes es comprender conjuntos de datos complejos que provienen de múltiples fuentes o subpoblaciones. Los modelos mixtos, que combinan diferentes distribuciones para representar diversos grupos de datos, son una solución ideal en este escenario. Son particularmente útiles cuando no conoce la estructura subyacente de sus datos pero desea clasificar las observaciones en distintos grupos según sus características.

Antes de sumergirse en la magia de MCMC, el código comienza generando datos sintéticos. Este conjunto de datos representa múltiples grupos, cada uno con sus propias características (como coeficientes y varianzas). Estos grupos se modelan utilizando diferentes ecuaciones de regresión, y cada grupo tiene un conjunto único de variables explicativas y parámetros asociados.

La clave aquí es que los datos generados están estructurados de una manera que imita escenarios del mundo real donde coexisten múltiples grupos, y el objetivo es descubrir las relaciones entre las variables de cada grupo. Al utilizar datos simulados, podemos aplicar métodos MCMC y ver cómo el modelo estima parámetros en condiciones controladas.

Ahora, hablemos del núcleo de este enfoque: Cadena Markov Montecarlo (MCMC). En esencia, MCMC es un método para extraer muestras de distribuciones de probabilidad complejas y de alta dimensión. En nuestro caso, estamos interesados en la distribución posterior de los parámetros en nuestro modelo de mezcla, cosas como coeficientes de regresión (betas) y varianzas (sigma). Las matemáticas de este enfoque se han discutido en detalle en https://medium.com/towards-data-science/introduction-to-the-finite-normal-mixtures-in-regression-with-6a884810a692.

El proceso MCMC en el código es iterativo, lo que significa que refina sus estimaciones a lo largo de múltiples ciclos. Analicemos cómo funciona:

- Actualización de etiquetas de grupo: Dados los valores actuales de los parámetros del modelo, comenzamos determinando la pertenencia al grupo más probable para cada observación. Esto es como asignar una “etiqueta” a cada punto de datos según la comprensión actual del modelo.

- Coeficientes de regresión muestral (Betas): A continuación, tomamos una muestra de los coeficientes de regresión para cada grupo. Estos coeficientes nos dicen con qué fuerza las variables explicativas influyen en la variable dependiente dentro de cada grupo.

- Variaciones muestrales (Sigma): Luego actualizamos las variaciones (sigma) para cada grupo. La variación es crucial ya que nos dice qué tan distribuidos están los datos dentro de cada grupo. Una varianza más pequeña significa que los puntos de datos están estrechamente agrupados alrededor de la media, mientras que una varianza mayor indica una mayor dispersión.

- Reordenar grupos: Finalmente, reorganizamos los grupos en función de los parámetros actualizados, asegurando que el modelo se ajuste mejor a los datos. Esto ayuda a ajustar el modelo y mejorar su precisión con el tiempo.

- Selección de funciones: Ayuda a determinar qué variables son más relevantes para cada componente de la regresión. Utilizando un enfoque probabilístico, selecciona variables para cada grupo en función de su contribución al modelo, calculando la probabilidad de inclusión para cada variable en el modelo mixto. Este mecanismo de selección de características permite que el modelo se centre en los predictores más importantes, mejorando tanto la interpretabilidad como el rendimiento. Esta idea se ha discutido como una herramienta completamente separada en https://medium.com/dev-genius/bayesian-variable-selection-for-linear-regression-based-on-stochastic-search-in-r-applicable-to-ml-5936d804ba4a . En la implementación actual, lo he combinado con una combinación de regresiones para convertirlo en un componente poderoso del marco de regresión flexible. Al muestrear las probabilidades de inclusión durante el proceso MCMC, el modelo puede ajustar dinámicamente qué características se incluyen, haciéndolo más flexible y capaz de identificar las variables más impactantes en conjuntos de datos complejos.

Una vez que el algoritmo haya realizado suficientes iteraciones, podemos analizar los resultados. El código incluye un paso de visualización simple que traza los parámetros estimados y los compara con los valores reales que se utilizaron para generar los datos sintéticos. Esto nos ayuda a comprender qué tan bien le ha ido al método MCMC al capturar la estructura subyacente de los datos.

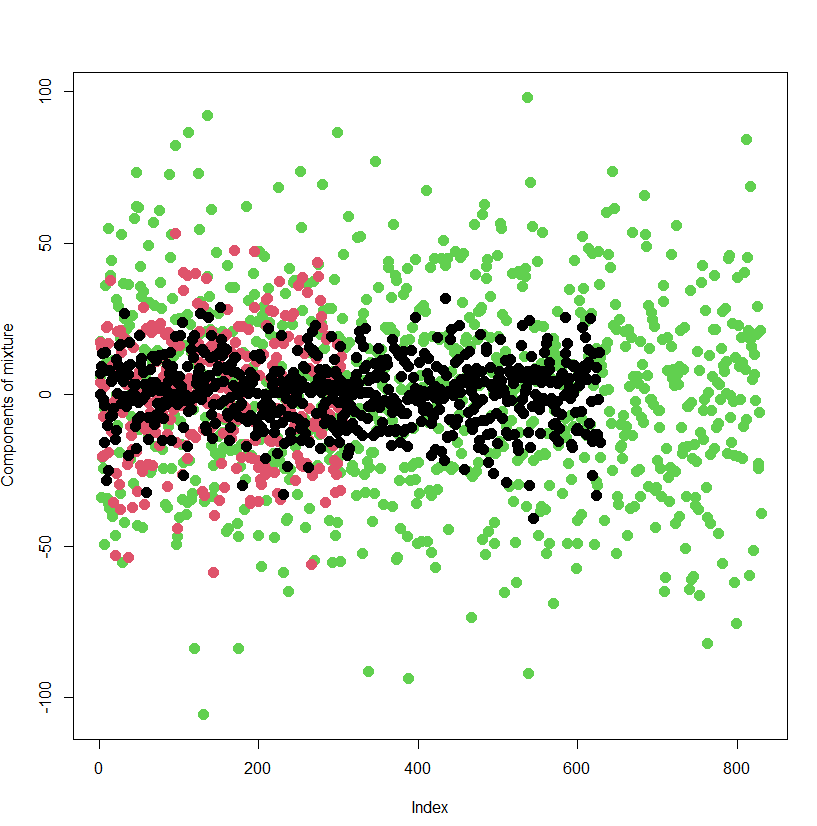

Los gráficos a continuación presentan el resultado del código con sorteos de 5000 MCMC. Trabajamos con una combinación de tres componentes, cada uno con cuatro variables explicativas potenciales. Al principio desactivamos algunas de las variables dentro de las mezclas individuales. El algoritmo es capaz de encontrar sólo aquellas características que tienen poder predictivo para la variable predicha. Trazamos los sorteos de los parámetros beta individuales para todos los componentes de la regresión. Algunos de ellos oscilan alrededor de 0. La curva roja presenta el valor real del parámetro beta en los datos utilizados para generar la mezcla.

También trazamos los sorteos de MCMC de la probabilidad de inclusión. La línea roja en 0 o 1 indica si ese parámetro se ha incluido en la combinación original de regresión para generar los datos. El aprendizaje de la probabilidad de inclusión ocurre en paralelo al entrenamiento de parámetros. Esto es exactamente lo que permite confiar en los valores entrenados de las betas. Se revela la estructura del modelo (es decir, se identifica el subconjunto de variables con poder explicativo) y, al mismo tiempo, se aprenden los valores correctos de beta.

Finalmente, presentamos el resultado de la clasificación de puntos de datos individuales para los respectivos componentes de la mezcla. La capacidad del modelo para clasificar los puntos de datos según el componente de la mezcla del que realmente provienen es excelente. El modelo se ha equivocado sólo en el 6 % de los casos.

Lo que hace que este enfoque sea particularmente interesante es su capacidad para descubrir estructuras ocultas en los datos. Piense en conjuntos de datos que provienen de múltiples fuentes o que tienen subpoblaciones inherentes, como datos de clientes, ensayos clínicos o incluso mediciones ambientales. Los modelos mixtos nos permiten clasificar las observaciones en estas subpoblaciones sin tener que conocer su naturaleza exacta de antemano. El uso de MCMC hace que esto sea aún más poderoso al permitirnos estimar parámetros con alta precisión, incluso en casos donde los métodos de estimación tradicionales pueden fallar.

Los modelos de mezcla con MCMC son herramientas increíblemente poderosas para analizar conjuntos de datos complejos. Al aplicar métodos MCMC, podemos estimar parámetros en situaciones en las que los modelos tradicionales pueden tener dificultades. Esta flexibilidad convierte a MCMC en una opción ideal para muchas tareas avanzadas de análisis de datos, desde identificar segmentos de clientes hasta analizar datos médicos o incluso predecir tendencias futuras basadas en patrones históricos.

El código que exploramos en este artículo es solo un ejemplo de cómo se pueden aplicar modelos mixtos y MCMC en R. Con algo de personalización, puede aplicar estas técnicas a una amplia variedad de conjuntos de datos, lo que le ayudará a descubrir conocimientos ocultos y tomar decisiones más informadas.

Para cualquier persona interesada en el modelado estadístico, el aprendizaje automático o la ciencia de datos, dominar los modelos mixtos y MCMC es un punto de inflexión. Estos métodos son versátiles, potentes y, cuando se aplican correctamente, pueden desbloquear una gran cantidad de conocimientos a partir de sus datos.

A medida que los datos se vuelven cada vez más complejos, tener las herramientas para modelarlos e interpretarlos de manera efectiva es más importante que nunca. Los modelos mixtos combinados con MCMC ofrecen un marco sólido para manejar datos de múltiples grupos, y aprender a implementar estas técnicas mejorará significativamente sus capacidades analíticas.

En el mundo de la ciencia de datos, dominar estas técnicas avanzadas abre una amplia gama de posibilidades, desde análisis de negocios hasta investigación científica. Con el código R proporcionado, ahora tiene un punto de partida sólido para explorar modelos mixtos y MCMC en sus propios proyectos, ya sea que esté descubriendo patrones ocultos en los datos o ajustando un modelo predictivo. La próxima vez que se encuentre con un conjunto de datos complejo, estará bien equipado para profundizar y extraer información significativa.

Hay un subproducto importante de la siguiente implementación. La regresión lineal, si bien es fundamental en el aprendizaje automático, a menudo se queda corta en aplicaciones del mundo real debido a sus suposiciones y limitaciones. Un problema importante es su suposición de una relación lineal entre las características de entrada y la variable objetivo, lo que rara vez es cierto en conjuntos de datos complejos.

Además, la regresión lineal es sensible a los valores atípicos y a la multicolinealidad, donde características altamente correlacionadas distorsionan las predicciones del modelo. También tiene problemas con las relaciones e interacciones no lineales entre características, lo que lo hace menos flexible a la hora de capturar la complejidad de los datos modernos. En la práctica, los científicos de datos suelen recurrir a métodos más sólidos, como árboles de decisión, bosques aleatorios, máquinas de vectores de soporte y redes neuronales. Estas técnicas pueden manejar la no linealidad, las interacciones y grandes conjuntos de datos de manera más efectiva, ofreciendo un mejor rendimiento predictivo y adaptabilidad en entornos dinámicos.

Sin embargo, si bien los métodos mencionados anteriormente ofrecen un mayor poder predictivo, a menudo tienen el costo de la interpretabilidad. Estos modelos funcionan como “cajas negras”, lo que dificulta comprender cómo las características de entrada se transforman en predicciones, lo que plantea desafíos para la capacidad de explicación y la confianza en aplicaciones críticas para la toma de decisiones.

Entonces, ¿es posible restaurar el brillo de la regresión lineal y convertirla nuevamente en una herramienta poderosa? Definitivamente, si sigue el enfoque implementado a continuación con la combinación de regresión normal, sentirá el poder del concepto subyacente de regresión lineal con su gran aspecto de interpretabilidad.

A menos que se indique lo contrario, todas las imágenes son del autor.