En el panorama tecnológico en rápida evolución actual, los desarrolladores y organizaciones a menudo lidian con una serie de desafíos prácticos. Uno de los obstáculos más significativos es el procesamiento eficiente de diversos tipos de datos (textos, habla y visión) dentro de un solo sistema. Los enfoques tradicionales generalmente han requerido tuberías separadas para cada modalidad, lo que lleva a una mayor complejidad, una mayor latencia y mayores costos computacionales. En muchas aplicaciones, desde el diagnóstico de atención médica hasta el análisis financiero, estas limitaciones pueden obstaculizar el desarrollo de soluciones de IA receptivas y adaptativas. La necesidad de modelos que equilibren la robustez con la eficiencia es más apremiante que nunca. En este contexto, el reciente trabajo de Microsoft en modelos de lenguaje pequeño (SLMS) proporciona un enfoque prometedor al esforzarse por consolidar capacidades en un paquete compacto y versátil.

Microsoft AI ha introducido recientemente PHI-4-Multimodal y Phi-4-Mini, las nuevas incorporaciones a su familia PHI de SLMS. Estos modelos se han desarrollado con un enfoque claro en racionalizar el procesamiento multimodal. Phi-4-Multimodal está diseñado para manejar el texto, el habla y las entradas visuales simultáneamente, todo dentro de una arquitectura unificada. Este enfoque integrado significa que un solo modelo ahora puede interpretar y generar respuestas basadas en tipos de datos variados sin la necesidad de sistemas separados y especializados.

En contraste, Phi-4-Mini se adapta específicamente a tareas basadas en texto. A pesar de ser más compacto, ha sido diseñado para sobresalir en razonamiento, codificación e instrucción. Ambos modelos se hacen accesibles a través de plataformas como Azure Ai Foundry y Hugging Face, asegurando que los desarrolladores de una variedad de industrias puedan experimentar e integrar estos modelos en sus aplicaciones. Este lanzamiento equilibrado representa un paso reflexivo para hacer que la IA avanzada sea más práctica y accesible.

Detalles y beneficios técnicos

A nivel técnico, PHI-4-Multimodal es un modelo de 5,6 mil millones de parámetros que incorpora una mezcla de LORAS, un método que permite la integración del habla, la visión y el texto dentro de un solo espacio de representación. Este diseño simplifica significativamente la arquitectura al eliminar la necesidad de tuberías de procesamiento separadas. Como resultado, el modelo no solo reduce la sobrecarga computacional, sino que también logra una latencia más baja, lo que es particularmente beneficioso para las aplicaciones en tiempo real.

Phi-4-Mini, con sus parámetros de 3.8 mil millones, se construye como un transformador denso solo de decodificadores. Cuenta con atención a la querida y cuenta con un vocabulario de 200,000 tokens, lo que le permite manejar secuencias de hasta 128,000 tokens. A pesar de su tamaño más pequeño, Phi-4-Mini funciona notablemente bien en tareas que requieren un razonamiento profundo y la comprensión del lenguaje. Una de sus características destacadas es la capacidad de llamar a funciones, lo que permite interactuar con herramientas externas y API, extendiendo así su utilidad práctica sin requerir un modelo más grande e intensivo en recursos.

Ambos modelos han sido optimizados para la ejecución en el dispositivo. Esta optimización es particularmente importante para aplicaciones en entornos con recursos de cálculo limitados o en escenarios de informática de borde. Los requisitos computacionales reducidos de los modelos los convierten en una opción rentable, asegurando que las funcionalidades avanzadas de IA se puedan implementar incluso en dispositivos que no tengan capacidades de procesamiento extensas.

Insights de rendimiento y datos de referencia

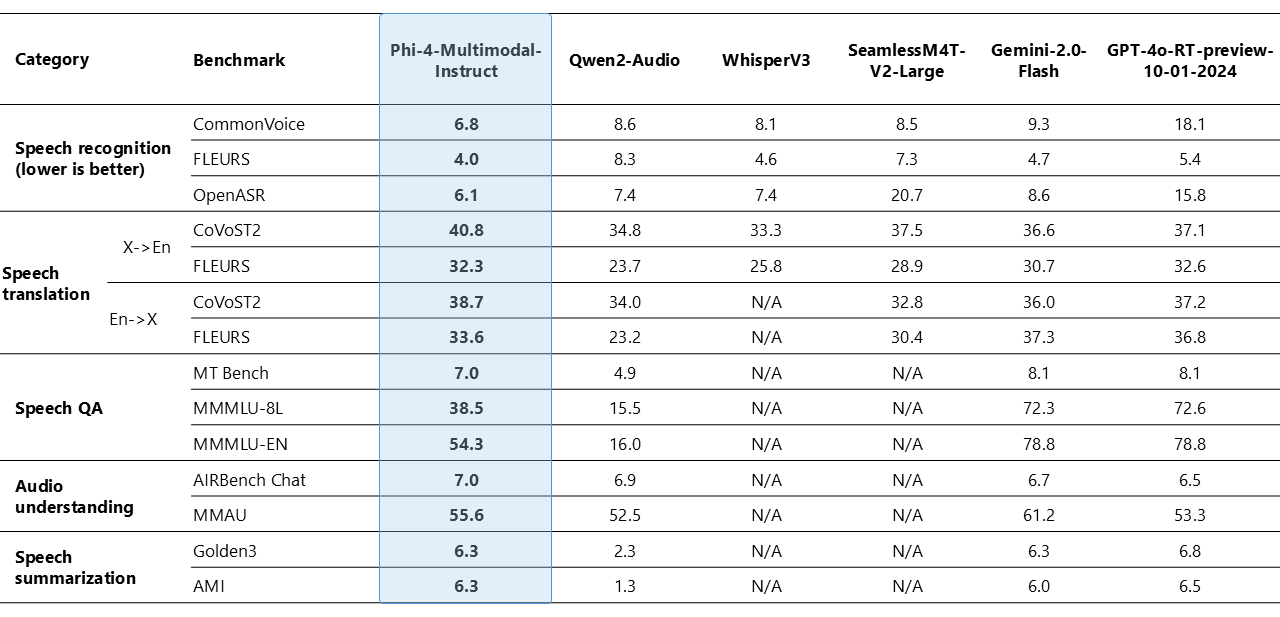

Los resultados de referencia proporcionan una visión clara de cómo funcionan estos modelos en escenarios prácticos. Por ejemplo, PHI-4-Multimodal ha demostrado una impresionante tasa de error de palabras (WER) de 6.14% en tareas de reconocimiento de voz automático (ASR). Esta es una mejora modesta sobre modelos anteriores como Whisperv3, que informó un WER del 6.5%. Tales mejoras son particularmente significativas en las aplicaciones donde la precisión en el reconocimiento de voz es crítica.

Más allá de ASR, PHI-4-Multimodal también muestra un rendimiento robusto en tareas como la traducción del habla y el resumen. Su capacidad para procesar entradas visuales es notable en tareas como razonamiento de documentos, comprensión de los gráficos y reconocimiento de caracteres ópticos (OCR). En varios puntos de referencia, que se extienden desde la interpretación del habla sintética en los datos visuales hasta el análisis de documentos, el rendimiento del modelo se alinea consistentemente con el de los modelos más grandes e intensivos en recursos.

Del mismo modo, Phi-4-Mini ha sido evaluado en una variedad de puntos de referencia de idiomas, donde se mantiene suyo a pesar de su diseño más compacto. Su aptitud para el razonamiento, el manejo de problemas matemáticos complejos y las tareas de codificación subraya su versatilidad en las aplicaciones basadas en texto. La inclusión de un mecanismo de llamada de función enriquece aún más su potencial, lo que permite que el modelo se basa en datos y herramientas externas sin problemas. Estos resultados subrayan una mejora medida y reflexiva en las capacidades de procesamiento multimodal y del lenguaje, proporcionando beneficios claros sin exagerar su rendimiento.

Conclusión

La introducción de PHI-4-Multimodal y Phi-4-Mini por Microsoft marca una evolución importante en el campo de la IA. En lugar de confiar en arquitecturas voluminosas y demandantes de recursos, estos modelos ofrecen un equilibrio refinado entre eficiencia y rendimiento. Al integrar múltiples modalidades en un solo marco cohesivo, PHI-4-Multimodal simplifica la complejidad inherente al procesamiento multimodal. Mientras tanto, Phi-4-Mini proporciona una solución robusta para tareas intensivas en texto, lo que demuestra que los modelos más pequeños pueden ofrecer capacidades significativas.

Verificar el Detalle técnico y Modelo en la cara abrazada. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, siéntete libre de seguirnos Gorjeo Y no olvides unirte a nuestro Subreddit de 80k+ ml.

Aswin AK es un pasante de consultoría en MarktechPost. Está persiguiendo su doble título en el Instituto de Tecnología Indio, Kharagpur. Le apasiona la ciencia de datos y el aprendizaje automático, aportando una sólida experiencia académica y una experiencia práctica en la resolución de desafíos de dominio de la vida real.