La investigación de inteligencia artificial está evolucionando rápidamente más allá del reconocimiento de patrones y hacia los sistemas capaces de un razonamiento complejo y humano. El último avance en esta búsqueda proviene de la introducción de transformadores basados en energía (EBTS), una familia de arquitecturas neuronales diseñadas específicamente para habilitar el “pensamiento del sistema 2” en máquinas sin depender de una supervisión específica de dominio o señales de entrenamiento restrictivas.

Desde la coincidencia de patrones hasta el razonamiento deliberado

La cognición humana a menudo se describe en términos de dos sistemas: sistema 1 (rápido, intuitivo, automático) y el sistema 2 (lento, analítico, esfuerzo). Mientras que los modelos de IA principales de hoy se destacan en el pensamiento del Sistema 1, que hace predicciones basadas en la experiencia, la mayoría se quedan cortas en el razonamiento deliberado y de varios pasos requeridos para tareas desafiantes o exageradas. Los esfuerzos actuales, como el aprendizaje de refuerzo con recompensas verificables, se limitan en gran medida a dominios donde la corrección es fácil de verificar, como las matemáticas o el código, y lucha por generalizar más allá de ellas.

Transformadores basados en energía: una base para el pensamiento del sistema 2 no supervisado

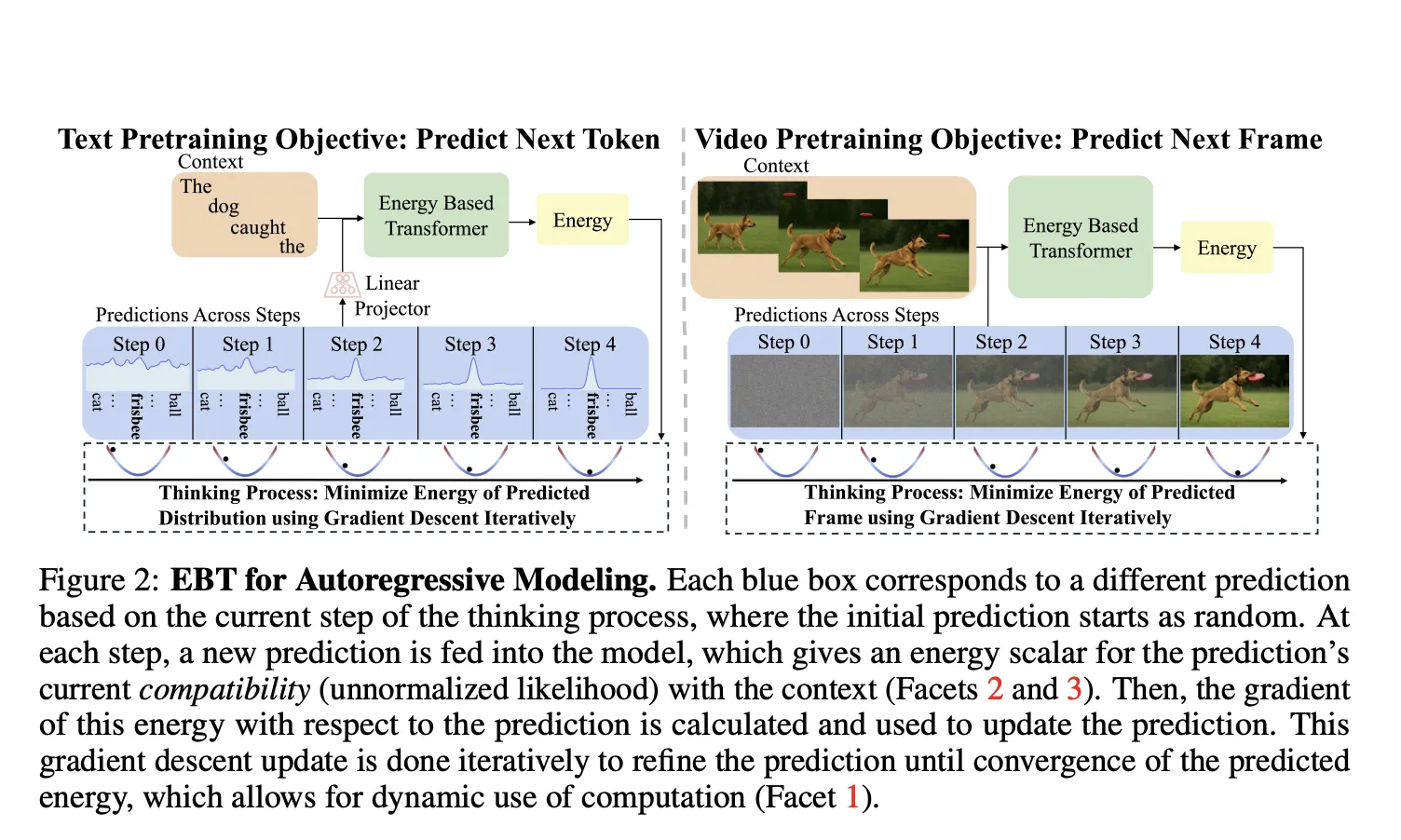

La innovación clave de EBTS radica en su procedimiento de diseño y capacitación arquitectónico. En lugar de producir salidas directamente en un solo pase hacia adelante, los EBT aprenden una función de energía que asigna un valor escalar a cada par de predicción de entrada, lo que representa su compatibilidad o “probabilidad no anormalizada”. El razonamiento, a su vez, se convierte en un proceso de optimización: a partir de una suposición inicial aleatoria, el modelo refina iterativamente su predicción a través de la minimización de energía, por cómo los humanos exploran y verifican las soluciones antes de comprometerse.

Este enfoque permite a EBTS exhibir tres facultades críticas para el razonamiento avanzado, que carece de la mayoría de los modelos actuales:

- Asignación dinámica de cálculo: Los EBT pueden dedicar más esfuerzo computacional, más “pasos de pensamiento”, a problemas más difíciles o predicciones inciertas según sea necesario, en lugar de tratar todas las tareas o tokens por igual.

- Modelado de incertidumbre naturalmente: Al rastrear los niveles de energía a lo largo del proceso de pensamiento, los EBT pueden modelar su confianza (o falta de ella), particularmente en dominios complejos y continuos como la visión, donde los modelos tradicionales luchan.

- Verificación explícita: Cada predicción propuesta se acompaña de una puntuación de energía que indica qué tan bien coincide con el contexto, lo que permite que el modelo se vaya a sí mismo y prefiera respuestas que “sabe” son plausibles.

Ventajas sobre los enfoques existentes

A diferencia del aprendizaje de refuerzo o la verificación supervisada externamente, los EBT no requieren recompensas hechas a mano o supervisión adicional; Sus capacidades del Sistema 2 surgen directamente de objetivos de aprendizaje no supervisados. Además, los EBT son inherentemente agnidad de modalidad: se escala en ambos dominios discretos (como texto y lenguaje) y continuos (como imágenes o videos), una hazaña más allá del alcance de las arquitecturas más especializadas.

La evidencia experimental muestra que los EBT no solo mejoran el rendimiento posterior en las tareas de lenguaje y visión cuando se permite “pensar más tiempo”, sino que también se escala de manera más eficiente durante la capacitación, en términos de datos, calcular y tamaño del modelo, comparados con las líneas de base de transformadores de última generación. En particular, su capacidad para generalizar mejora a medida que la tarea se vuelve más desafiante o fuera de distribución, haciendo eco de los hallazgos en la ciencia cognitiva sobre el razonamiento humano bajo incertidumbre.

Una plataforma para el pensamiento y la generalización escalables

El paradigma del transformador basado en energía señala una vía hacia sistemas de IA más potentes y flexibles, capaz de adaptar su profundidad de razonamiento a las demandas del problema. A medida que los datos se convierten en un cuello de botella para una mayor escala, la eficiencia y la generalización de EBTS pueden abrir puertas a los avances en el modelado, la planificación y la toma de decisiones en una amplia gama de dominios.

Si bien las limitaciones actuales permanecen, como el aumento del costo computacional durante la capacitación y los desafíos con la distribución de datos altamente multimodal, la investigación de problemas está preparada para construir sobre las bases establecidas por los EBT. Las direcciones potenciales incluyen la combinación de EBT con otros paradigmas neuronales, desarrollar estrategias de optimización más eficientes y extender su aplicación a nuevas tareas de razonamiento multimodal y secuencial.

Resumen

Los transformadores basados en la energía representan un paso significativo hacia las máquinas que pueden “pensar” más como los humanos, no simplemente reaccionar reflexivamente, sino hacer una pausa para analizar, verificar y adaptar su razonamiento para problemas abiertos y complejos en cualquier modalidad.

Mira el Papel y Página de Github. Todo el crédito por esta investigación va a los investigadores de este proyecto.

Conozca el boletín de AI Dev leídos por 40k+ desarrolladores e investigadores de Nvidia, Openai, DeepMind, Meta, Microsoft, JP Morgan Chase, Amgen, Aflac, Wells Fargo y 100 más [SUBSCRIBE NOW]

Nikhil es consultor interno en MarktechPost. Está buscando un doble grado integrado en materiales en el Instituto Indio de Tecnología, Kharagpur. Nikhil es un entusiasta de AI/ML que siempre está investigando aplicaciones en campos como biomateriales y ciencias biomédicas. Con una sólida experiencia en la ciencia material, está explorando nuevos avances y creando oportunidades para contribuir.