Una computadora cuántica con corrección de errores a gran escala podrá resolver algunos problemas que son imposibles para las computadoras clásicas, pero construir un dispositivo de este tipo es un esfuerzo enorme. Estamos orgullosos de la hitos que hemos logrado hacia una computadora cuántica con corrección total de errores, pero aún faltan algunos años para lograr esa computadora a gran escala. Mientras tanto, utilizamos nuestros ruidosos procesadores cuánticos actuales como plataformas flexibles para experimentos cuánticos.

En contraste con un cuanto con corrección de errores computadoraexperimentos en cuantos ruidosos procesadores Actualmente están limitados a unos pocos miles de operaciones o puertas cuánticas, antes de que el ruido degrade el estado cuántico. En 2019 implementamos una tarea computacional específica llamada muestreo de circuito aleatorio en nuestro procesador cuántico y mostró por primera vez que superó a la supercomputación clásica de última generación.

Aunque todavía no han alcanzado capacidades más allá de las clásicas, también hemos utilizado nuestros procesadores para observar fenómenos físicos novedosos, como cristales de tiempo y Modos de borde Majoranay han realizado nuevos descubrimientos experimentales, como robustos estados vinculados de fotones que interactúan y el resistencia al ruido de los modos de borde de Majorana de las evoluciones de Floquet.

Esperamos que incluso en este régimen intermedio y ruidoso, encontremos aplicaciones para los procesadores cuánticos en las que se puedan realizar experimentos cuánticos útiles mucho más rápido de lo que se puede calcular en las supercomputadoras clásicas; a estas las llamamos “aplicaciones computacionales” de los procesadores cuánticos. Nadie ha demostrado todavía una aplicación computacional más allá de lo clásico. Entonces, mientras pretendemos alcanzar este hito, la pregunta es: ¿Cuál es la mejor manera de comparar un experimento cuántico ejecutado en un procesador cuántico de este tipo con el costo computacional de una aplicación clásica?

Ya sabemos cómo comparar un algoritmo cuántico con corrección de errores con un algoritmo clásico. En ese caso, el campo de complejidad computacional nos dice que podemos comparar sus respectivos costos computacionales, es decir, el número de operaciones necesarias para realizar la tarea. Pero con nuestros procesadores cuánticos experimentales actuales, la situación no está tan bien definida.

En “Volumen cuántico efectivo, fidelidad y costo computacional de experimentos de procesamiento cuántico ruidosos”, proporcionamos un marco para medir el costo computacional de un experimento cuántico, introduciendo el “volumen cuántico efectivo” del experimento, que es el número de operaciones cuánticas o puertas que contribuyen a un resultado de medición. Aplicamos este marco para evaluar el costo computacional de tres experimentos recientes: nuestro muestreo de circuito aleatorio experimentonuestro experimento que mide cantidades conocidas como “correladores de orden fuera de tiempo” (OTOC)y un experimento reciente sobre una evolución de Floquet relacionado a la modelo ising. Estamos particularmente entusiasmados con los OTOC porque proporcionan una forma directa de medir experimentalmente el volumen cuántico efectivo de un circuito (una secuencia de puertas u operaciones cuánticas), lo cual es en sí mismo una tarea computacionalmente difícil de estimar con precisión para una computadora clásica. Los OTOC también son importantes en resonancia magnética nuclear y espectroscopia de resonancia de espín electrónico. Por lo tanto, creemos que los experimentos de OTOC son un candidato prometedor para una primera aplicación computacional de procesadores cuánticos.

| Gráfico del costo computacional y el impacto de algunos experimentos cuánticos recientes. Mientras que algunos (por ejemplo, Control de Calidad-QMC 2022) han tenido un alto impacto y otros (p. ej., RCS 2023) han tenido un alto costo computacional, ninguno ha sido todavía lo suficientemente útil y difícil como para ser considerado una “aplicación computacional”. Nuestra hipótesis es que nuestro futuro experimento OTOC podría ser el primero en superar este umbral. En el texto se hace referencia a otros experimentos trazados. |

Muestreo aleatorio de circuitos: evaluación del costo computacional de un circuito ruidoso

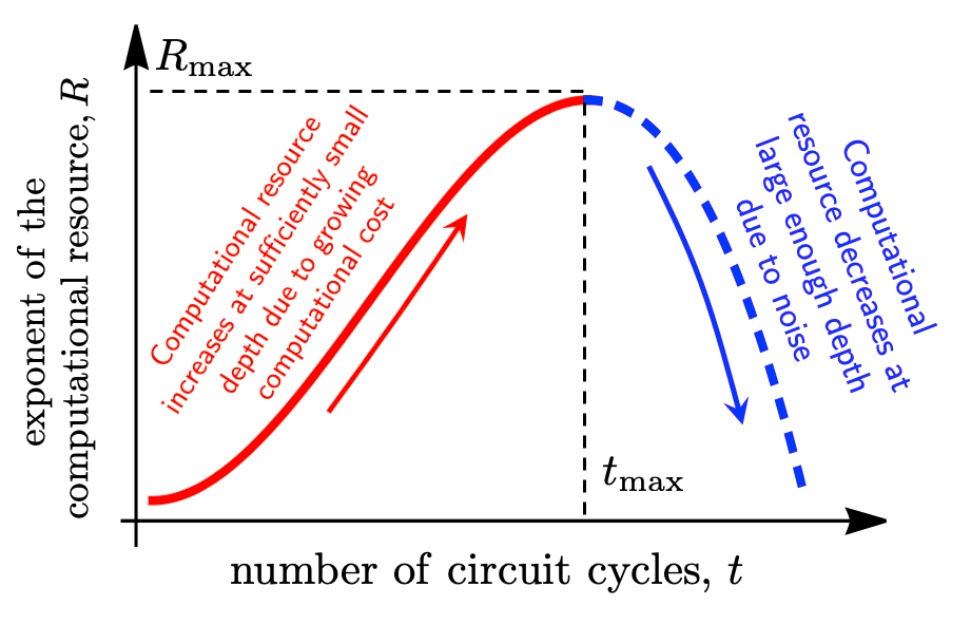

Cuando se trata de ejecutar un circuito cuántico en un procesador cuántico ruidoso, existen dos consideraciones contrapuestas. Por un lado, pretendemos hacer algo que es difícil de lograr de forma clásica. El costo computacional (el número de operaciones necesarias para realizar la tarea en una computadora clásica) depende de la capacidad del circuito cuántico. volumen cuántico efectivo: cuanto mayor es el volumen, mayor es el coste computacional y más puede superar un procesador cuántico a uno clásico.

Pero, por otro lado, en un procesador ruidoso, cada puerta cuántica puede introducir un error en el cálculo. Cuantas más operaciones, mayor será el error y menor será la fidelidad del circuito cuántico al medir una cantidad de interés. Teniendo en cuenta esta consideración, podríamos preferir circuitos más simples con un volumen efectivo menor, pero estos son fácilmente simulados por computadoras clásicas. El equilibrio de estas consideraciones en competencia, que queremos maximizar, se denomina “recurso computacional”, que se muestra a continuación.

Podemos ver cómo se desarrollan estas consideraciones en competencia en un simple programa “hola mundo” para procesadores cuánticos, conocido como muestreo de circuitos aleatorios (RCS), que fue la primera demostración de un procesador cuántico superando a una computadora clásica. Es probable que cualquier error en cualquier puerta haga que este experimento falle. Inevitablemente, este es un experimento difícil de lograr con una fidelidad significativa y, por lo tanto, también sirve como punto de referencia de la fidelidad del sistema. Pero también corresponde al coste computacional más alto conocido que puede alcanzar un procesador cuántico. Recientemente informamos sobre RCS más potente experimento realizado hasta la fecha, con una baja fidelidad experimental medida de 1,7×10-3y un alto coste computacional teórico de ~1023. Estos circuitos cuánticos tenían 700 puertas de dos qubits. Estimamos que este experimento tardaría unos 47 años en simularse en la supercomputadora más grande del mundo. Si bien esto marca una de las dos casillas necesarias para una aplicación computacional (supera a una supercomputadora clásica), no es una aplicación particularmente útil. per se.

OTOC y evolución de Floquet: el volumen cuántico efectivo de un observable local

Hay muchas preguntas abiertas en cuántica. física de muchos cuerpos que son clásicamente intratables, por lo que ejecutar algunos de estos experimentos en nuestro procesador cuántico tiene un gran potencial. Normalmente pensamos en estos experimentos de forma un poco diferente a cómo hacemos el experimento RCS. En lugar de medir el estado cuántico de todos los qubits al final del experimento, normalmente nos preocupamos por observables físicos locales más específicos. Debido a que no todas las operaciones en el circuito necesariamente impactan lo observable, el volumen cuántico efectivo de un observable local podría ser menor que el del circuito completo necesario para ejecutar el experimento.

Podemos entender esto aplicando el concepto de cono de luz de relatividad, que determina qué eventos en el espacio-tiempo pueden estar conectados causalmente: algunos eventos no pueden influir entre sí porque la información tarda tiempo en propagarse entre ellos. Decimos que dos de esos eventos están fuera de sus respectivos conos de luz. En un experimento cuántico, reemplazamos el cono de luz con algo llamado “cono de mariposa”, donde el crecimiento del cono está determinado por la velocidad de la mariposa, la velocidad con la que la información se propaga por todo el sistema. (Esta velocidad se caracteriza midiendo los OTOC, que se analizan más adelante). El volumen cuántico efectivo de un observable local es esencialmente el volumen del cono de mariposa, incluidas solo las operaciones cuánticas que están causalmente conectadas con el observable. Por tanto, cuanto más rápido se difunda la información en un sistema, mayor será el volumen efectivo y, por tanto, más difícil será simular de forma clásica.

Aplicamos este marco a un reciente experimento implementando el llamado modelo Floquet Ising, un modelo físico relacionado con el cristal del tiempo y los experimentos de Majorana. A partir de los datos de este experimento, se puede estimar directamente una fidelidad efectiva de 0,37 para los circuitos más grandes. Con una tasa de error de puerta medida de ~1 %, esto da un volumen efectivo estimado de ~100. Es mucho más pequeño que el cono de luz, que incluía dos mil puertas en 127 qubits. Entonces, la velocidad de la mariposa de este experimento es bastante pequeña. De hecho, argumentamos que el volumen efectivo cubre solo ~28 qubits, no 127, utilizando simulaciones numéricas que obtienen una precisión mayor que el experimento. Este pequeño volumen efectivo también ha sido corroborado con la técnica OTOC. Aunque se trataba de un circuito profundo, el coste computacional estimado es de 5×1011, casi un billón de veces menos que el reciente experimento RCS. En consecuencia, este experimento puede ser simulado en menos de un segundo por punto de datos en una sola GPU A100. Entonces, si bien esta es ciertamente una aplicación útil, no cumple con el segundo requisito de una aplicación computacional: superar sustancialmente a una simulación clásica.

Los experimentos de codificación de información con OTOC son una vía prometedora para una aplicación computacional. Los OTOC pueden brindarnos información física importante sobre un sistema, como la velocidad de la mariposa, que es fundamental para medir con precisión el volumen cuántico efectivo de un circuito. Los experimentos de OTOC con puertas de entrelazamiento rápido ofrecen un camino potencial para una primera demostración más allá de lo clásico de una aplicación computacional con un procesador cuántico. De hecho, en nuestro experimento a partir de 2021 logramos una fidelidad efectiva de Feff ~ 0,06 con una relación señal-ruido experimental de ~1, correspondiente a un volumen efectivo de ~250 puertas y un coste computacional de 2×1012.

Si bien estos primeros experimentos OTOC no son lo suficientemente complejos como para superar las simulaciones clásicas, existe una razón física profunda por la cual los experimentos OTOC son buenos candidatos para la primera demostración de una aplicación computacional. La mayoría de los fenómenos cuánticos interesantes accesibles a los procesadores cuánticos a corto plazo y que son difíciles de simular clásicamente corresponden a un circuito cuántico que explora muchos, muchos niveles de energía cuántica. Tales evoluciones son típicamente caóticas y los correlacionadores de orden temporal (TOC) estándar decaen muy rápidamente a un promedio puramente aleatorio en este régimen. No queda ninguna señal experimental. Esto no sucede por Mediciones OTOC, lo que nos permite aumentar la complejidad a voluntad, solo limitado por el error por puerta. Anticipamos que una reducción de la tasa de error a la mitad duplicaría el costo computacional, llevando este experimento al régimen más allá del clásico.

Conclusión

Utilizando el marco de volumen cuántico efectivo que hemos desarrollado, hemos determinado el costo computacional de nuestros experimentos RCS y OTOC, así como un experimento reciente de evolución de Floquet. Si bien ninguno de estos cumple todavía los requisitos para una aplicación computacional, esperamos que con tasas de error mejoradas, un experimento OTOC sea la primera aplicación útil más allá de lo clásico de un procesador cuántico.