En los últimos tiempos, el campo de la inteligencia artificial ha sido testigo de avances notables, particularmente en el desarrollo de modelos de lenguaje. En Marktechpost Media, hemos cubierto muchos modelos de lenguaje basados en varios parámetros y rendimiento SOTA. Siguiendo esta tendencia, tenemos otro lanzamiento, y esta vez, es de Adept AI Labs que lanza Persimmon-8B. Persimmon-8B es un modelo de código abierto con licencia totalmente permisiva en la clase 8B. Este modelo tiene un inmenso potencial para una amplia gama de aplicaciones, con el objetivo de ayudar a los usuarios en diversas tareas relacionadas con la computadora. Sin embargo, es importante tener en cuenta que, en su forma original, el modelo puede producir resultados que no estén seleccionados para detectar una posible toxicidad. Esto plantea una preocupación crítica sobre la necesidad de técnicas de evaluación más refinadas.

Si bien los modelos de lenguaje más pequeños han demostrado capacidades impresionantes, Persimmon-8B se destaca como un importante avance. Cuenta con un tamaño de contexto cuatro veces mayor que el de LLaMA2 y ocho veces mayor que el de modelos como GPT-3, lo que le permite abordar tareas vinculadas al contexto con mayor delicadeza. Además, su rendimiento está a la par, si no superado, de otros modelos en su rango de tamaño a pesar de haber sido entrenado con una cantidad significativamente menor de datos. Esto ejemplifica la eficiencia y eficacia del proceso de formación del modelo.

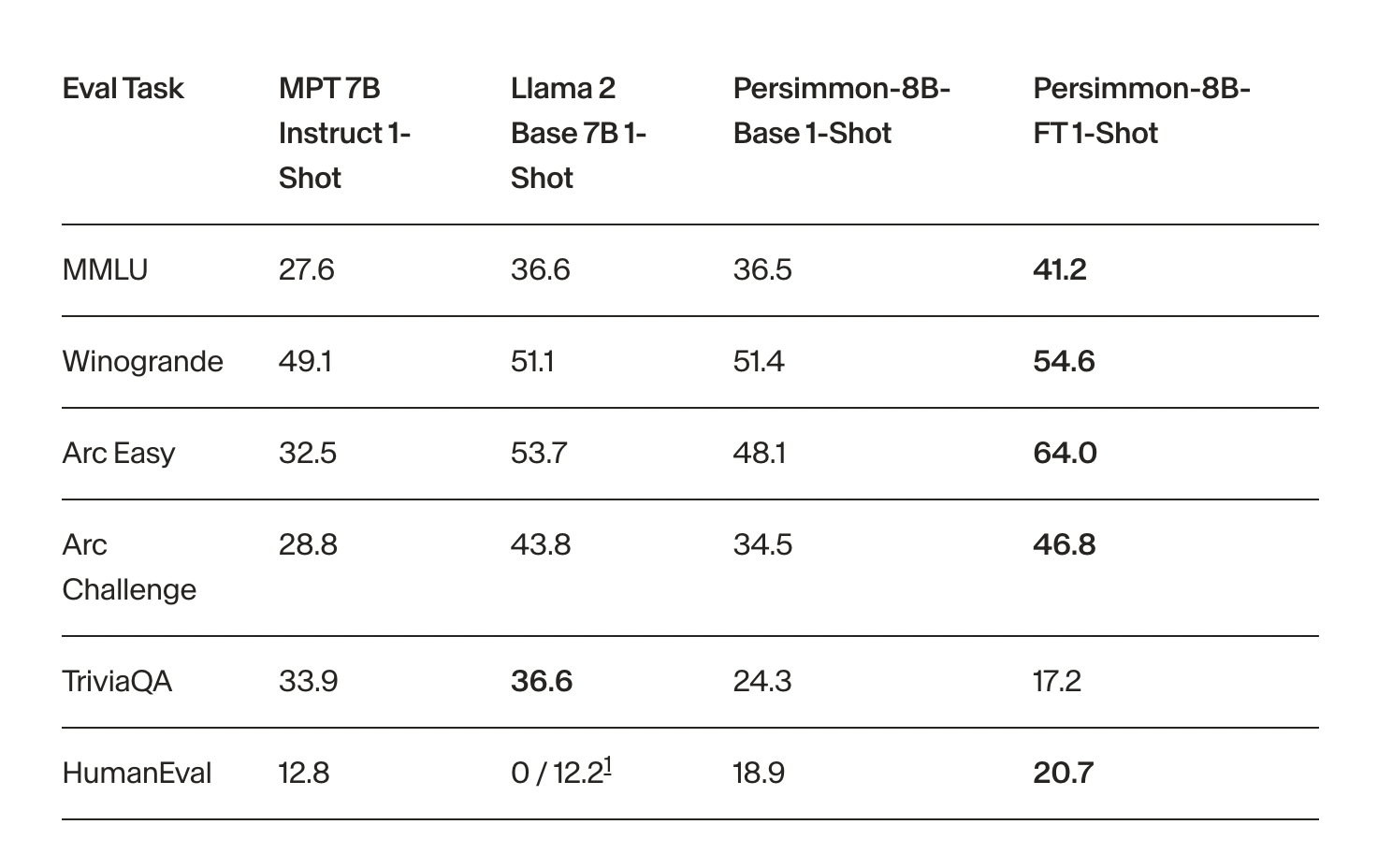

Para evaluar la destreza de Persimmon-8B, el equipo de Adept emplea un enfoque único. En lugar de depender únicamente de probabilidades implícitas, optan por una interacción más directa, donde el modelo tiene la tarea de generar respuestas. Esta metodología refleja las interacciones del mundo real con modelos de lenguaje, donde los usuarios plantean preguntas y anticipan respuestas. Al publicar sus indicaciones, Adept invita a la comunidad a reproducir y validar sus hallazgos.

Los resultados dicen mucho sobre las capacidades de Persimmon-8B. En comparación con otros modelos de su rango de tamaño, como LLama 2 y MPT 7B Instruct, Persimmon-8B-FT emerge como el de mejor desempeño en varias métricas. Incluso el modelo base, Persimmon-8B-Base, demuestra un rendimiento comparable al de LLama 2 a pesar de haber sido entrenado con una fracción de los datos. Esto subraya la eficiencia y eficacia del modelo en el manejo de una amplia gama de tareas.

Profundizando en los detalles técnicos, Persimmon-8B es un transformador solo decodificador con varias mejoras arquitectónicas. Aprovecha la activación ReLU cuadrada y las codificaciones posicionales rotativas, superando a las alternativas convencionales. El punto de control del modelo contiene aproximadamente 9,3 mil millones de parámetros optimizados para un entrenamiento eficiente. En particular, el desacoplamiento de las incorporaciones de entrada y salida sirve como una mejora a nivel del sistema, agilizando el proceso de capacitación.

En términos de velocidad de inferencia, Persimmon-8B muestra un rendimiento impresionante. Con el uso de código optimizado, puede generar aproximadamente 56 tokens por segundo en una única GPU A100 de 80 GB. Esto lo posiciona como una herramienta altamente eficiente para aplicaciones en tiempo real.

En conclusión, el lanzamiento de Persimmon-8B marca un hito importante en el campo de los modelos lingüísticos. Sus capacidades, junto con el enfoque de evaluación innovador empleado por Adept, allanan el camino para una nueva era de aplicaciones interactivas de IA. Al abrir este modelo, Adept invita a la comunidad a construir sobre sus cimientos e impulsar una mayor innovación en este campo dinámico. A medida que crezca la adopción del modelo, es probable que encuentre aplicaciones en una variedad de dominios, revolucionando la forma en que las personas interactúan con los sistemas informáticos.

Revisar la Blog experto y Enlace de GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de más de 30.000 ml, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Niharika es pasante de consultoría técnica en Marktechpost. Es estudiante de tercer año y actualmente cursa su licenciatura en tecnología en el Instituto Indio de Tecnología (IIT), Kharagpur. Es una persona muy entusiasta con un gran interés en el aprendizaje automático, la ciencia de datos y la inteligencia artificial y una ávida lectora de los últimos avances en estos campos.