Los modelos de lenguaje multilingüe a gran escala son la base de muchas aplicaciones de procesamiento del lenguaje natural (PLN) multilingües y distintas del inglés. Estos modelos se entrenan con volúmenes masivos de texto en varios idiomas. Sin embargo, el inconveniente de su uso generalizado es que, debido a que se modelan numerosos lenguajes en un solo modelo, existe competencia por la capacidad limitada del modelo. Por lo tanto, esto da como resultado un rendimiento más bajo en idiomas individuales en comparación con los modelos monolingües. Este problema, conocido como la maldición del multilingüismo, afecta principalmente a las lenguas con pocos recursos.

Para superar el problema frecuente de que los modelos de lenguajes multilingües (LM) funcionen peor que los monolingües debido a la competencia entre idiomas por los parámetros del modelo, un equipo de investigadores de la Universidad de Washington, la Universidad Charles de Praga y el Instituto Allen de Inteligencia Artificial ha sugerido modelos de lenguaje experto multilingüe (X-ELM) como solución. Este enfoque incluye entrenar modelos de lenguaje por separado en partes de un corpus multilingüe.

El objetivo principal de X-ELM es reducir el conflicto entre idiomas para los parámetros del modelo al permitir la especialización autónoma de cada modelo de idioma en el conjunto en un subconjunto particular de datos multilingües. Este método tiene como objetivo preservar la eficiencia del conjunto mientras ajusta el nivel de competencia de cada modelo a un idioma determinado.

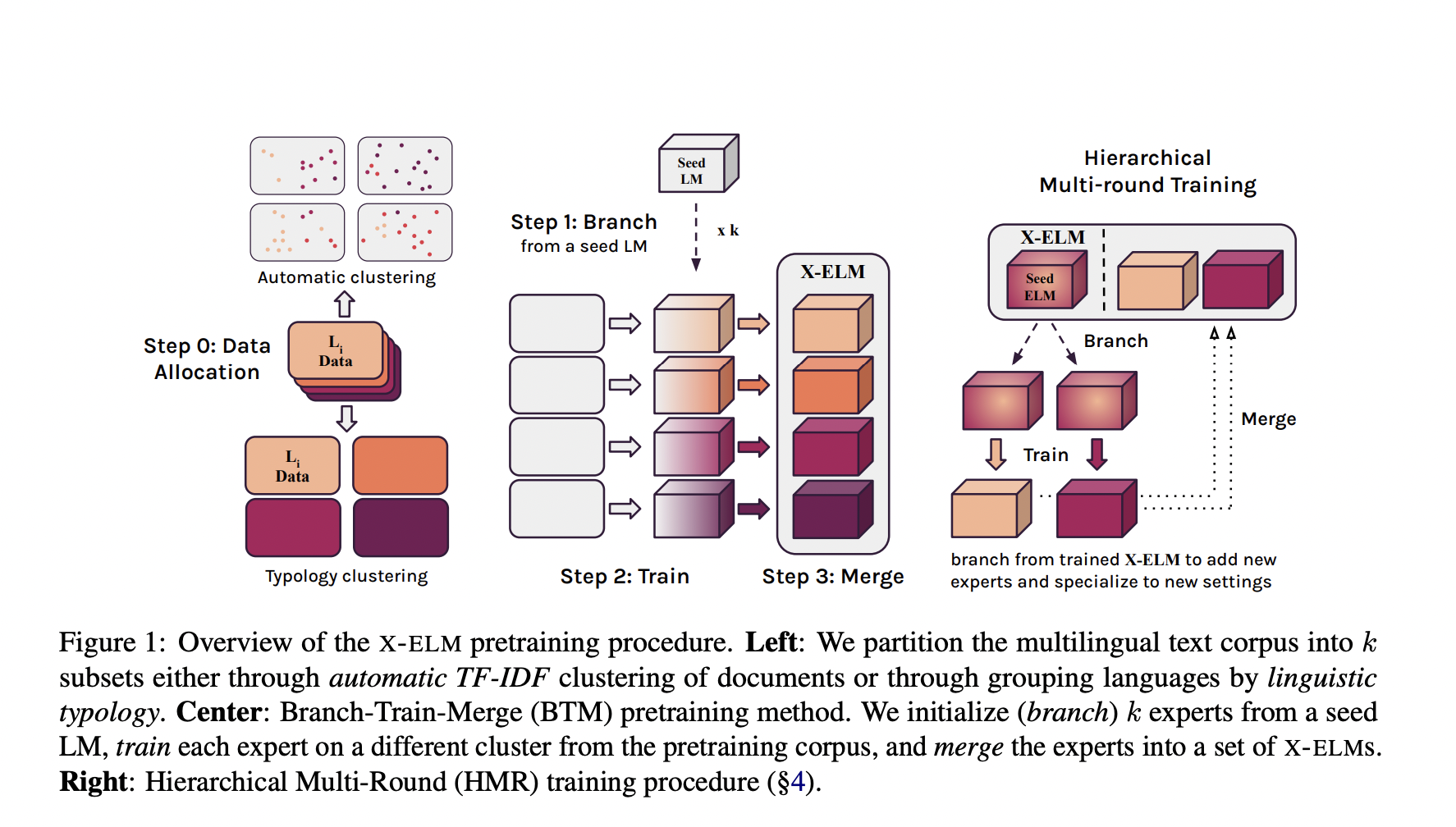

El equipo compartió que se realizó capacitación independiente en un subconjunto diferente de un corpus multilingüe para cada X-ELM. Al utilizar una técnica de conjunto, la capacidad del modelo se ha escalado de manera efectiva para reflejar todos los lenguajes del corpus con mayor precisión. El equipo también presentó x-BTM, una expansión del paradigma Branch-Train-Merge (BTM) diseñado para un entorno multilingüe más heterogéneo, con el fin de entrenar X-ELM.

x-BTM mejora los métodos BTM actuales al introducir un enfoque equilibrado de agrupación de datos multilingüe basado en la similitud tipológica. También incluye capacitación jerárquica de rondas múltiples (HMR), una técnica que educa eficazmente a nuevos expertos con conocimientos especializados de idiomas no descubiertos previamente u otras distribuciones de datos multilingües.

El artículo de investigación publicado por el equipo muestra que se pueden seleccionar expertos dinámicamente para realizar inferencias una vez que se entrenan los primeros X-ELM. Otras rondas de x-BTM con nuevos expertos derivados de los X-ELM actuales permiten que los modelos se ajusten a nuevas situaciones, ampliando el conjunto total de X-ELM sin cambiar a los expertos existentes.

En los experimentos se utilizaron veinte lenguajes y se adaptaron cuatro nuevos lenguajes para demostrar que los X-ELM funcionan mejor en diferentes condiciones experimentales que los modelos de lenguaje denso con el mismo presupuesto de computación. Los aumentos en la perplejidad observados en los lenguajes X-ELM se han distribuido uniformemente entre los recursos lingüísticos. La formación HMR ha demostrado ser un medio más eficaz para adaptar los modelos a nuevos lenguajes que las técnicas tradicionales de preformación adaptativa al lenguaje.

Los estudios han demostrado que X-ELM funciona mejor que los modelos multilingües entrenados conjuntamente en todos los idiomas considerados cuando se les proporcionan los mismos recursos computacionales. Sus mejoras de rendimiento también se aplican a las operaciones posteriores, lo que demuestra la utilidad del modelo en escenarios del mundo real. El modelo también puede adaptarse a nuevos idiomas sin sufrir un olvido catastrófico de idiomas aprendidos previamente gracias a su capacidad iterativa de agregar nuevos expertos al conjunto.

En conclusión, esta investigación aborda perfectamente las dificultades en el uso de modelos de lenguaje multilingüe (LM) masivos y presenta modelos de lenguaje experto multilingüe (X-ELM) como una solución potencial.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Unirse nuestro SubReddit de 36k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Tanya Malhotra es estudiante de último año de la Universidad de Estudios de Petróleo y Energía, Dehradun, y cursa BTech en Ingeniería en Ciencias de la Computación con especialización en Inteligencia Artificial y Aprendizaje Automático.

Es una entusiasta de la Ciencia de Datos con buen pensamiento analítico y crítico, junto con un ardiente interés en adquirir nuevas habilidades, liderar grupos y gestionar el trabajo de manera organizada.