Los modelos de lenguaje grande (LLM) se destacan en diversas tareas, incluidas la generación de texto, la traducción y el resumen. Sin embargo, un desafío cada vez mayor dentro del procesamiento del lenguaje natural es cómo estos modelos pueden interactuar de manera efectiva con herramientas externas para realizar tareas que van más allá de sus capacidades inherentes. Este desafío es particularmente relevante en aplicaciones del mundo real donde los LLM deben obtener datos en tiempo real, realizar cálculos complejos o interactuar con API para completar tareas con precisión.

Un problema importante es el proceso de toma de decisiones de los LLM sobre cuándo utilizar herramientas externas. En situaciones del mundo real, a menudo no está claro si una herramienta es necesaria. El uso incorrecto o innecesario de una herramienta puede dar lugar a errores e ineficiencias importantes. Por lo tanto, el problema central que abordan las investigaciones recientes es mejorar la capacidad de los LLM para discernir sus límites de capacidad y tomar decisiones precisas sobre el uso de herramientas. Esta mejora es crucial para mantener el rendimiento y la fiabilidad de los LLM en aplicaciones prácticas.

Tradicionalmente, los métodos para mejorar el uso de herramientas por parte de los estudiantes de máster se han centrado en ajustar los modelos para tareas específicas en las que el uso de herramientas es obligatorio. Las técnicas como el aprendizaje por refuerzo y los árboles de decisión han demostrado ser prometedoras, en particular en el razonamiento matemático y las búsquedas en la web. Se han desarrollado puntos de referencia como APIBench y ToolBench para evaluar la competencia de los estudiantes de máster con las API y las herramientas del mundo real. Sin embargo, estos puntos de referencia suelen suponer que siempre se requiere el uso de herramientas, lo que no refleja la incertidumbre y la variabilidad que se encuentran en los escenarios del mundo real.

Investigadores de la Universidad Jiaotong de Beijing, la Universidad de Fuzhou y el Instituto de Automatización CAS presentaron el Evaluación comparativa de uso o no de herramientas (WTU-Eval) para abordar esta brecha. Este punto de referencia está diseñado para evaluar la flexibilidad de toma de decisiones de los LLM con respecto al uso de herramientas. WTU-Eval comprende once conjuntos de datos, seis de los cuales requieren explícitamente el uso de herramientas, mientras que los cinco restantes son conjuntos de datos generales que se pueden resolver sin herramientas. Esta estructura permite una evaluación integral de si los LLM pueden discernir cuándo es necesario el uso de herramientas. El punto de referencia incluye tareas como traducción automática, razonamiento matemático y búsquedas web en tiempo real, lo que proporciona un marco sólido para la evaluación.

El equipo de investigación también desarrolló un conjunto de datos de ajuste fino de 4000 instancias derivadas de los conjuntos de entrenamiento de WTU-Eval. Este conjunto de datos está diseñado para mejorar las capacidades de toma de decisiones de los LLM con respecto al uso de herramientas. Al ajustar los modelos con este conjunto de datos, los investigadores apuntaron a mejorar la precisión y la eficiencia de los LLM a la hora de reconocer cuándo usar herramientas e integrar de manera efectiva los resultados de las herramientas en sus respuestas.

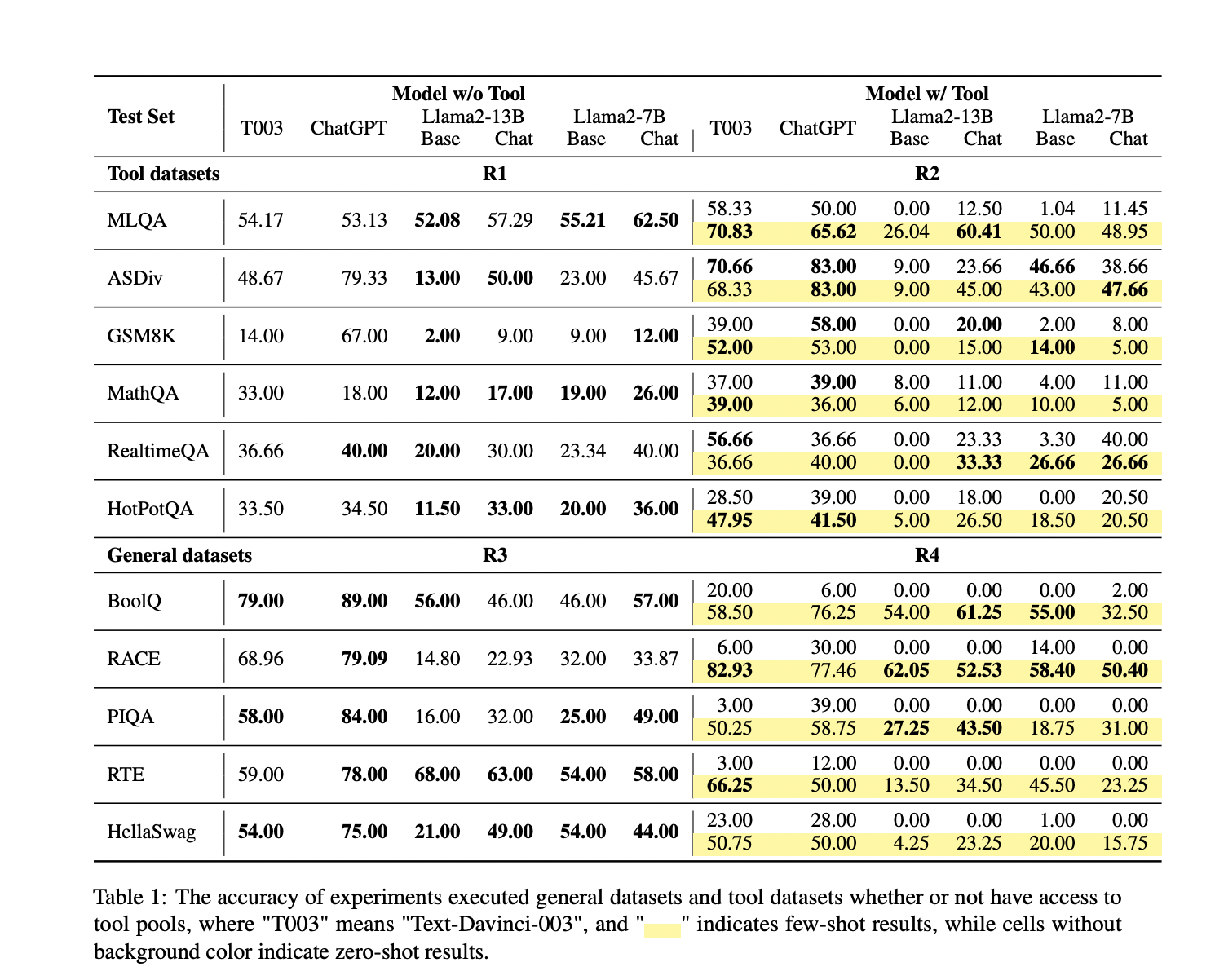

La evaluación de ocho LLM destacados con WTU-Eval reveló varios hallazgos clave. En primer lugar, la mayoría de los modelos necesitan ayuda para determinar el uso de herramientas en conjuntos de datos generales. Por ejemplo, el rendimiento de Llama2-13B cayó al 0 % en algunas preguntas sobre herramientas en entornos de cero disparos, lo que resalta la dificultad que enfrentan los LLM en estos escenarios. Sin embargo, los modelos mejoraron el rendimiento en conjuntos de datos de uso de herramientas cuando sus capacidades se alinearon más estrechamente con modelos como ChatGPT. El ajuste del modelo Llama2-7B condujo a una mejora del rendimiento promedio del 14 % y una disminución del 16,8 % en el uso incorrecto de herramientas. Esta mejora fue particularmente notable en conjuntos de datos que requieren recuperación de información en tiempo real y cálculos matemáticos.

Un análisis posterior mostró que las diferentes herramientas tenían distintos impactos en el rendimiento de los LLM. Por ejemplo, los LLM administraban de manera más eficiente las herramientas más simples, como los traductores, mientras que las herramientas complejas, como las calculadoras y los motores de búsqueda, presentaban mayores desafíos. En entornos de cero disparos, la competencia de los LLM disminuyó significativamente con la complejidad de las herramientas. Por ejemplo, el rendimiento de Llama2-7B cayó al 0 % cuando se usaron herramientas complejas en ciertos conjuntos de datos, mientras que ChatGPT mostró mejoras significativas de hasta el 25 % en tareas como GSM8K cuando las herramientas se usaron de manera adecuada.

El riguroso proceso de evaluación del benchmark WTU-Eval proporciona información valiosa sobre las limitaciones del uso de herramientas de los LLM y las posibles mejoras. El diseño del benchmark, que incluye una combinación de conjuntos de datos generales y de uso de herramientas, permite una evaluación detallada de las capacidades de toma de decisiones de los modelos. El éxito del conjunto de datos de ajuste fino en la mejora del rendimiento subraya la importancia de la capacitación específica para mejorar las decisiones de uso de herramientas de los LLM.

En conclusión, la investigación destaca la necesidad crítica de que los LLM desarrollen mejores capacidades de toma de decisiones con respecto al uso de herramientas. El punto de referencia WTU-Eval ofrece un marco integral para evaluar estas capacidades, y revela que, si bien el ajuste fino puede mejorar significativamente el rendimiento, muchos modelos aún tienen dificultades para determinar sus límites de capacidad con precisión. El trabajo futuro debería centrarse en ampliar el punto de referencia con más conjuntos de datos y herramientas y explorar más a fondo diferentes tipos de LLM para mejorar sus aplicaciones prácticas en diversos escenarios del mundo real.

Revisar la PapelTodo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Subreddit de más de 46 000 millones de usuarios

Encuentra lo próximo Seminarios web sobre IA aquí

Asjad es consultor en prácticas en Marktechpost. Está cursando la licenciatura en ingeniería mecánica en el Instituto Indio de Tecnología de Kharagpur. Asjad es un entusiasta del aprendizaje automático y del aprendizaje profundo que siempre está investigando las aplicaciones del aprendizaje automático en el ámbito de la atención médica.