Los modelos generativos a gran escala como GPT-4, DALL-E y Stable Diffusion han transformado la inteligencia artificial, demostrando capacidades notables para generar texto, imágenes y otros medios. Sin embargo, a medida que estos modelos se vuelven más frecuentes, surge un desafío crítico: las consecuencias de entrenar modelos generativos en conjuntos de datos que contienen sus resultados. Este problema, conocido como colapso del modelo, plantea una amenaza importante para el desarrollo futuro de la IA. A medida que los modelos generativos se entrenan en conjuntos de datos a escala web que incluyen cada vez más contenido generado por IA, los investigadores luchan con la posible degradación del rendimiento del modelo en iteraciones sucesivas, lo que podría hacer que los modelos más nuevos sean ineficaces y comprometer la calidad de los datos de entrenamiento para los futuros sistemas de IA.

Los investigadores actuales han investigado el colapso de modelos a través de varios métodos, incluyendo la sustitución de datos reales por datos generados, la ampliación de conjuntos de datos fijos y la mezcla de datos reales y sintéticos. La mayoría de los estudios mantuvieron tamaños de conjuntos de datos constantes y proporciones de mezcla. El trabajo teórico se ha centrado en comprender el comportamiento de los modelos con la integración de datos sintéticos, analizando la regresión de alta dimensión, los efectos de autodestilación y las colas de salida del modelo de lenguaje. Algunos investigadores identificaron transiciones de fase en las leyes de escala de error y propusieron estrategias de mitigación. Sin embargo, estos estudios consideraron principalmente cantidades fijas de datos de entrenamiento por iteración. Pocos exploraron los efectos de la acumulación de datos a lo largo del tiempo, lo que se asemeja mucho a la evolución de los conjuntos de datos basados en Internet. Esta brecha de investigación destaca la necesidad de una mayor investigación sobre las consecuencias a largo plazo de los modelos de entrenamiento en conjuntos de datos en continua expansión que incluyen datos reales y sintéticos, lo que refleja la naturaleza dinámica de la información a escala web.

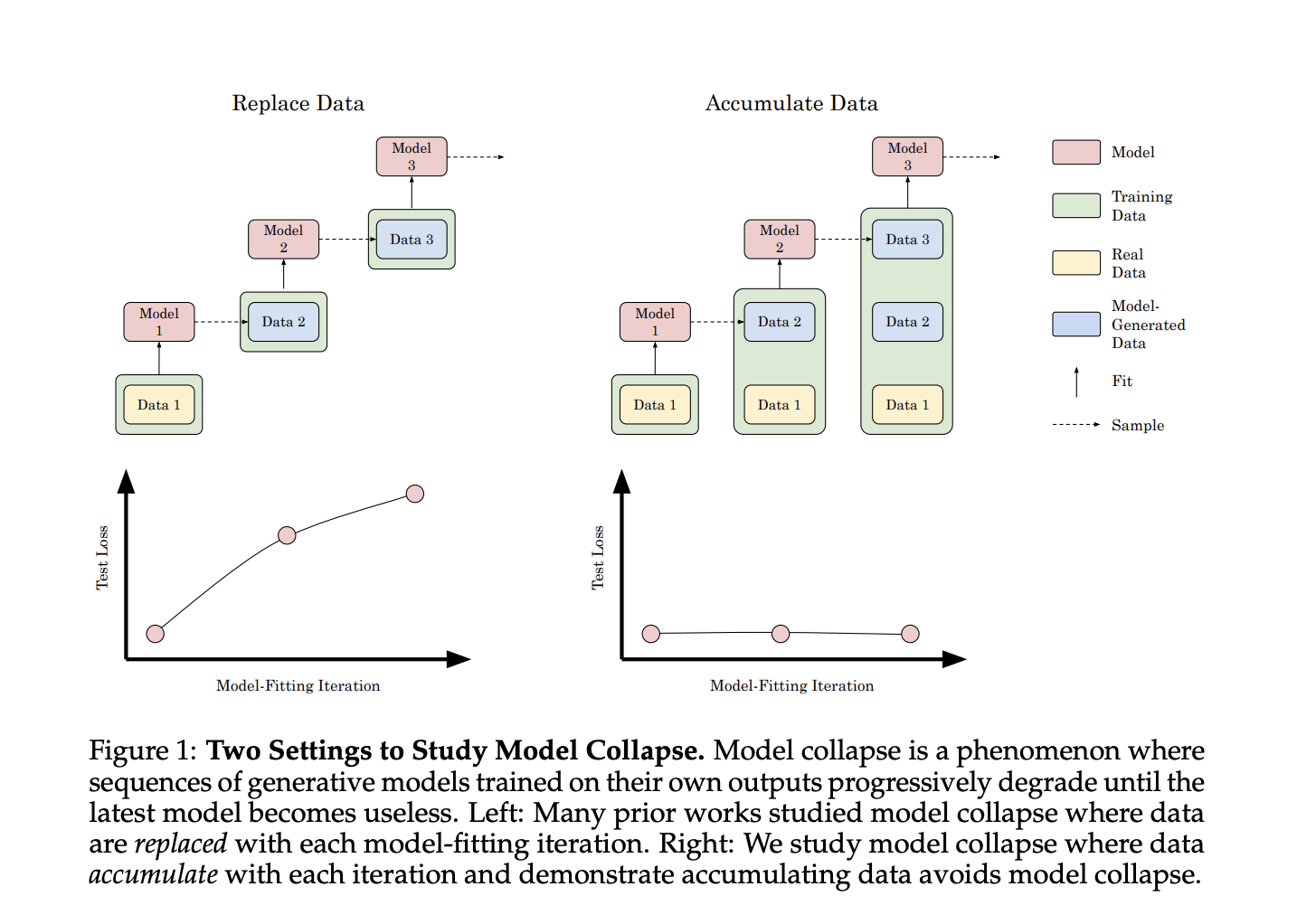

Investigadores de la Universidad de Stanford proponen un estudio que explora el impacto de la acumulación de datos en el colapso del modelo en modelos de IA generativa. A diferencia de investigaciones anteriores centradas en el reemplazo de datos, este enfoque simula la acumulación continua de datos sintéticos en conjuntos de datos basados en Internet. Los experimentos con transformadores, modelos de difusión y autocodificadores variacionales en varios tipos de datos revelan que la acumulación de datos sintéticos con datos reales previene el colapso del modelo, en contraste con la degradación del rendimiento observada al reemplazar datos. Los investigadores amplían el análisis existente de modelos lineales secuenciales para demostrar que la acumulación de datos da como resultado un límite superior finito y bien controlado en el error de prueba, independientemente de las iteraciones de ajuste del modelo. Este hallazgo contrasta con el aumento del error lineal observado en escenarios de reemplazo de datos.

Los investigadores investigaron experimentalmente el colapso del modelo en IA generativa utilizando transformadores causales, modelos de difusión y autocodificadores variacionales en conjuntos de datos de texto, moleculares e imágenes.

- Modelado del lenguaje causal basado en transformadores:

Para probar el colapso del modelo en modelos de lenguaje basados en transformadores, los investigadores utilizaron arquitecturas GPT-2 y Llama2 de varios tamaños, entrenadas previamente en TinyStories. Compararon estrategias de reemplazo y acumulación de datos en múltiples iteraciones. Los resultados mostraron de manera consistente que el reemplazo de datos aumentó la entropía cruzada de prueba (peor desempeño) en todas las configuraciones del modelo y temperaturas de muestreo. Por el contrario, la acumulación de datos mantuvo o mejoró el desempeño en las iteraciones. Las temperaturas de muestreo más bajas aceleraron los aumentos de errores al reemplazar datos, pero la tendencia general se mantuvo constante. Estos hallazgos respaldan firmemente la hipótesis de que la acumulación de datos previene el colapso del modelo en tareas de modelado de lenguaje, mientras que el reemplazo de datos conduce a una degradación progresiva del desempeño.

- Modelos de difusión sobre datos de conformación molecular:

Los investigadores probaron los modelos de difusión GeoDiff en los datos de conformación molecular de GEOM-Drugs, comparando las estrategias de reemplazo y acumulación de datos. Los resultados mostraron una pérdida de prueba creciente al reemplazar los datos, pero un rendimiento estable al acumularlos. A diferencia de los modelos de lenguaje, se produjo una degradación significativa principalmente en la primera iteración con datos sintéticos. Estos hallazgos respaldan aún más la acumulación de datos como método para evitar el colapso del modelo en diferentes dominios de IA.

- Autocodificadores variacionales sobre datos de imágenes (VAE)

Los investigadores utilizaron VAE en imágenes de rostros de CelebA, comparando estrategias de reemplazo y acumulación de datos. El reemplazo de datos provocó un colapso rápido del modelo, con un aumento del error de prueba y una disminución de la calidad y diversidad de la imagen. La acumulación de datos ralentizó significativamente el colapso, preservando las variaciones principales pero perdiendo detalles menores a lo largo de las iteraciones. A diferencia de los modelos de lenguaje, la acumulación mostró una ligera degradación del rendimiento. Estos hallazgos respaldan los beneficios de la acumulación de datos para mitigar el colapso del modelo en los dominios de IA, al tiempo que destacan las variaciones en la efectividad según el tipo de modelo y el conjunto de datos.

Esta investigación investiga el colapso del modelo en la IA, una preocupación a medida que el contenido generado por IA aparece cada vez más en los conjuntos de datos de entrenamiento. Si bien estudios anteriores mostraron que el entrenamiento con resultados de modelos puede degradar el rendimiento, este trabajo demuestra que el colapso del modelo se puede prevenir mediante el entrenamiento con una combinación de datos reales y sintéticos. Los hallazgos, respaldados por experimentos en varios dominios de IA y análisis teóricos para regresión lineal, sugieren que la “maldición de la recursión” puede ser menos grave de lo que se pensaba anteriormente, siempre que los datos sintéticos se acumulen junto con los datos reales en lugar de reemplazarlos por completo.

Revisar la PapelTodo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Más de 47 000 suscriptores de ML en Reddit

Encuentra lo próximo Seminarios web sobre IA aquí

Asjad es consultor en prácticas en Marktechpost. Está cursando la licenciatura en ingeniería mecánica en el Instituto Indio de Tecnología de Kharagpur. Asjad es un entusiasta del aprendizaje automático y del aprendizaje profundo que siempre está investigando las aplicaciones del aprendizaje automático en el ámbito de la atención médica.