Inteligencia artificial Arcee ha anunciado el lanzamiento de Kit de destilación, una innovadora herramienta de código abierto diseñada para revolucionar la creación y distribución de modelos de lenguaje pequeños (SLM). Esta versión se alinea con Inteligencia artificial ArceeLa misión continua de hacer que la IA sea más accesible y eficiente para investigadores, usuarios y empresas que buscan acceder a herramientas de métodos de destilación de código abierto y fáciles de usar.

Introducción a DistillKit

Kit de destilación es un proyecto de código abierto y de vanguardia centrado en la destilación de modelos, un proceso que permite la transferencia de conocimiento desde modelos grandes que consumen muchos recursos a otros más pequeños y eficientes. Esta herramienta tiene como objetivo poner las capacidades avanzadas de IA a disposición de un público más amplio al reducir significativamente los recursos computacionales necesarios para ejecutar estos modelos.

El objetivo principal de Kit de destilación El objetivo es crear modelos más pequeños que conserven la potencia y la sofisticación de sus homólogos más grandes y que estén optimizados para su uso en hardware menos potente, como computadoras portátiles y teléfonos inteligentes. Este enfoque democratiza el acceso a la IA avanzada y promueve la eficiencia energética y el ahorro de costos en la implementación de la IA.

Métodos de destilación en DistillKit

Kit de destilación Emplea dos métodos principales para la transferencia de conocimiento: destilación basada en logit y destilación basada en estados ocultos.

- Destilación basada en logit: Este método implica que el modelo del profesor (el modelo más grande) proporcione sus probabilidades de salida (logits) al modelo del estudiante (el modelo más pequeño). El modelo del estudiante aprende no solo las respuestas correctas, sino también los niveles de confianza del modelo del profesor en sus predicciones. Esta técnica mejora la capacidad del modelo del estudiante para generalizar y funcionar de manera eficiente al imitar la distribución de salida del modelo del profesor.

- Destilación basada en estados ocultos: En este enfoque, el modelo del estudiante se entrena para replicar las representaciones intermedias (estados ocultos) del modelo del maestro. Al alinear su procesamiento interno con el modelo del maestro, el modelo del estudiante obtiene una comprensión más profunda de los datos. Este método es útil para la destilación entre arquitecturas, ya que permite la transferencia de conocimiento entre modelos de diferentes tokenizadores.

Puntos clave de DistillKit

Los experimentos y evaluaciones de rendimiento de DistillKit brindan información clave sobre su eficacia y posibles aplicaciones:

- Aumento del rendimiento de propósito general: Kit de destilación Se demostraron mejoras de rendimiento consistentes en varios conjuntos de datos y condiciones de entrenamiento. Los modelos entrenados en subconjuntos de Openhermes, WebInstruct-Sub y FineTome mostraron avances alentadores en puntos de referencia como MMLU y MMLU-Pro. Estos resultados indican mejoras significativas en la absorción de conocimiento para los SLM.

- Mejora del rendimiento en dominios específicos: El enfoque de destilación dirigida produjo mejoras notables en tareas específicas del dominio. Por ejemplo, la destilación de Arcee-Agent en Qwen2-1.5B-Instruct utilizando los mismos datos de entrenamiento que el modelo del profesor dio como resultado mejoras sustanciales en el rendimiento. Esto sugiere que el aprovechamiento de conjuntos de datos de entrenamiento idénticos para los modelos del profesor y del alumno puede generar mayores ganancias en el rendimiento.

- Flexibilidad y versatilidad: Kit de destilaciónLa capacidad de ‘s para admitir métodos de destilación basados en logit y estados ocultos brinda flexibilidad en las opciones de arquitectura del modelo. Esta versatilidad permite a los investigadores y desarrolladores adaptar el proceso de destilación para satisfacer requisitos específicos.

- Eficiencia y optimización de recursos: Kit de destilación Reduce los recursos computacionales y la energía necesarios para la implementación de la IA al permitir la creación de modelos más pequeños y eficientes. Esto hace que las capacidades avanzadas de IA sean más accesibles y promueve prácticas de investigación y desarrollo de IA sostenibles.

- Colaboración de código abierto: Kit de destilaciónLa naturaleza de código abierto de invita a la comunidad a contribuir a su desarrollo continuo. Este enfoque colaborativo fomenta la innovación y la mejora, alentando a los investigadores y desarrolladores a explorar nuevos métodos de destilación, optimizar las rutinas de entrenamiento y mejorar la eficiencia de la memoria.

Resultados de rendimiento

La eficacia de DistillKit se ha probado rigurosamente mediante una serie de experimentos para evaluar su impacto en el rendimiento y la eficiencia del modelo. Estos experimentos se centraron en varios aspectos, incluida la comparación de técnicas de destilación, el rendimiento de los modelos destilados con sus modelos maestros y las aplicaciones de destilación específicas del dominio.

- Comparación de técnicas de destilación

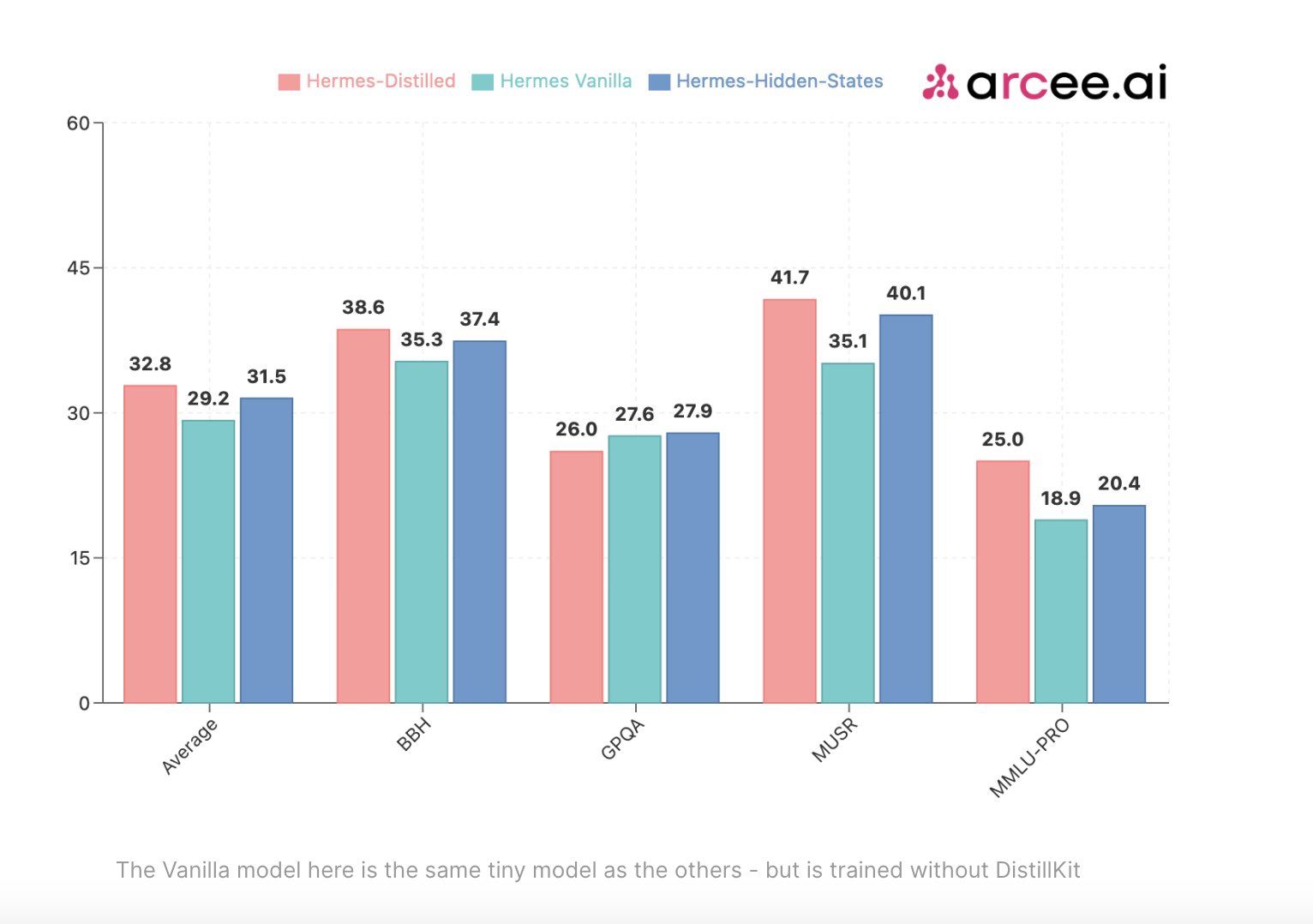

El primer conjunto de experimentos comparó el rendimiento de diferentes modelos refinados mediante técnicas de destilación basadas en logit y estados ocultos frente a un enfoque de ajuste fino supervisado (SFT) estándar. Utilizando Arcee-Spark como modelo docente, el conocimiento se destiló en modelos Qwen2-1.5B-Base. Los resultados demostraron mejoras significativas en el rendimiento de los modelos destilados en comparación con la línea base de solo SFT en los principales puntos de referencia, como BBH, MUSR y MMLU-PRO.

- Destilación basada en logit: El enfoque basado en logit superó al método basado en estados ocultos en la mayoría de los puntos de referencia, lo que demuestra su capacidad superior para mejorar el rendimiento de los estudiantes al transferir conocimientos de manera más efectiva.

- Destilación basada en estados ocultos: Si bien está ligeramente por detrás del método basado en logit en términos de rendimiento general, esta técnica aún proporcionó ganancias sustanciales en comparación con la variante basada solo en SFT, especialmente en escenarios que requieren destilación entre arquitecturas.

Estos hallazgos subrayan la solidez de los métodos de destilación implementados en Kit de destilación y resaltar su potencial para aumentar significativamente la eficiencia y precisión de modelos más pequeños.

- Eficacia en dominios generales:Experimentos posteriores evaluaron la eficacia de la destilación basada en logit en un entorno de dominio general. Se comparó un modelo destilado de 1.5B, entrenado en un subconjunto de WebInstruct-Sub, con su modelo maestro, Arcee-Spark, y el modelo de referencia Qwen2-1.5B-Instruct. El modelo destilado mejoró de manera constante el rendimiento en todas las métricas, y demostró resultados comparables a los del modelo maestro, en particular en los puntos de referencia MUSR y GPQA. Este experimento confirmó la capacidad de DistillKit para producir modelos altamente eficientes que conservan gran parte del rendimiento del modelo maestro y, al mismo tiempo, son significativamente más pequeños y consumen menos recursos.

- Destilación específica del dominio:También se exploró el potencial de DistillKit para tareas específicas de dominio mediante la destilación de Arcee-Agent en modelos Qwen2-1.5B-Instruct. Arcee-Agent, un modelo especializado en llamadas de funciones y uso de herramientas, actuó como instructor. Los resultados revelaron mejoras sustanciales en el rendimiento y destacaron la eficacia de utilizar los mismos datos de entrenamiento para los modelos de instructor y de estudiante. Este enfoque mejoró las capacidades de propósito general de los modelos destilados y los optimizó para tareas específicas.

Impacto y direcciones futuras

El lanzamiento de DistillKit está destinado a permitir la creación de modelos más pequeños y eficientes para que la IA avanzada sea accesible para varios usuarios y aplicaciones. Esta accesibilidad es crucial para empresas e individuos que pueden no tener los recursos para implementar modelos de IA a gran escala. Los modelos más pequeños generados a través de DistillKit ofrecen varias ventajas, incluido un menor consumo de energía y menores costos operativos. Estos modelos se pueden implementar directamente en dispositivos locales, lo que mejora la privacidad y la seguridad al minimizar la necesidad de transmitir datos a servidores en la nube. Arcee AI planea continuar mejorando DistillKit con características y capacidades adicionales. Las futuras actualizaciones incluirán técnicas de destilación avanzadas como el entrenamiento previo continuo (CPT) y la optimización de preferencias directas (DPO).

Conclusión

Kit de destilación por Inteligencia artificial Arcee marca un hito importante en la destilación de modelos, ofreciendo una herramienta robusta, flexible y eficiente para crear SLM. Los resultados de rendimiento de los experimentos y las conclusiones clave resaltan el potencial de DistillKit para revolucionar la implementación de IA al hacer que los modelos avanzados sean más accesibles y prácticos. El compromiso de Arcee AI con la investigación de código abierto y la colaboración de la comunidad garantiza que DistillKit seguirá evolucionando, incorporando nuevas técnicas y optimizaciones para satisfacer las demandas en constante cambio de la tecnología de IA. Arcee AI también invita a la comunidad a contribuir al proyecto desarrollando nuevos métodos de destilación para mejorar las rutinas de entrenamiento y optimizar el uso de la memoria.

Asif Razzaq es el director ejecutivo de Marktechpost Media Inc. Como ingeniero y emprendedor visionario, Asif está comprometido con aprovechar el potencial de la inteligencia artificial para el bien social. Su iniciativa más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, Marktechpost, que se destaca por su cobertura en profundidad de noticias sobre aprendizaje automático y aprendizaje profundo que es técnicamente sólida y fácilmente comprensible para una amplia audiencia. La plataforma cuenta con más de 2 millones de visitas mensuales, lo que ilustra su popularidad entre el público.