Comportamiento no deseado de los modelos de lenguaje

Los modelos de lenguaje entrenados en grandes corpus de texto pueden generar texto fluidoy mostrarse prometedor como pocos/cero estudiantes y herramientas de generación de código, entre otras capacidades. Sin embargo, investigaciones anteriores también han identificado varios problemas con el uso de LM que deben abordarse, incluyendo sesgos distributivos, estereotipos socialespotencialmente revelador muestras de entrenamientoy otra posibles daños a LM. Un tipo particular de daño de LM es la generación de lenguaje toxicoque incluye discursos de odio, insultos, blasfemias y amenazas.

En nuestro artículo, nos centramos en los LM y sus propensión para generar lenguaje tóxico. Estudiamos la efectividad de diferentes métodos para mitigar la toxicidad de LM y sus efectos secundarios, e investigamos la confiabilidad y los límites de la evaluación automática de toxicidad basada en clasificadores.

Siguiendo la definición de toxicidad desarrollada por API de perspectivaaquí consideramos que un enunciado es Tóxico si es un lenguaje grosero, irrespetuoso o irrazonable que probablemente haga que alguien abandone una discusión.. Sin embargo, observamos dos advertencias importantes. En primer lugar, los juicios sobre la toxicidad son subjetivos: dependen tanto de los evaluadores que evalúan la toxicidad como de sus antecedentes culturales, así como del contexto inferido. Si bien no es el enfoque de este trabajo, es importante que el trabajo futuro continúe desarrollando esta definición anterior y aclare cómo se puede aplicar de manera justa en diferentes contextos. En segundo lugar, observamos que la toxicidad cubre sólo un aspecto de los posibles daños a los LM, excluyendo, por ejemplo, los daños que surgen del sesgo del modelo distributivo.

Medición y mitigación de la toxicidad

Para permitir un uso más seguro del modelo de lenguaje, nos propusimos medir, comprender los orígenes y mitigar la generación de texto tóxico en LM. Ha habido trabajos previos que han considerado varios enfoques para reducir la toxicidad de LM, ya sea mediante sintonia FINA LM previamente entrenadospor generaciones de modelos de direccióno por vía directa filtrado de tiempo de prueba. Además, antes trabajar ha introducido métricas automáticas para medir la toxicidad de LM, tanto cuando se le solicitan diferentes tipos de indicaciones como en generación incondicional. Estas métricas se basan en las puntuaciones de toxicidad de los ampliamente utilizados API de perspectiva modelo, que se entrena con comentarios en línea anotados por toxicidad.

En nuestro estudio, primero mostramos que una combinación de valores de referencia relativamente simples conduce a una reducción drástica, medida por la toxicidad de LM introducida previamente. métrica. Concretamente, encontramos que una combinación de i) filtrar los datos de entrenamiento LM anotados como tóxicos por API de perspectivaii) filtrar el texto generado para detectar toxicidad en función de un clasificador BERT separado y ajustado, entrenado para detectar toxicidad, y iii) direccion La generación hacia ser menos tóxica, es altamente efectiva para reducir la toxicidad de los LM, medida por métricas automáticas de toxicidad. Cuando se le solicitan indicaciones tóxicas (o no tóxicas) del Avisos de toxicidad real conjunto de datos, vemos una reducción de 6 veces (o 17 veces) en comparación con el estado del arte informado anteriormente, en conjunto Probabilidad de toxicidad métrico. Alcanzamos un valor de cero en la configuración de generación de texto no solicitado, lo que sugiere que hemos agotado esta métrica. Dado lo bajos que son los niveles de toxicidad en términos absolutos, medidos con métricas automáticas, surge la pregunta de hasta qué punto esto también se refleja en el juicio humano, y si las mejoras en estas métricas siguen siendo significativas, especialmente porque se derivan de un sistema automático imperfecto. sistema de clasificación. Para obtener más información, nos dirigimos a la evaluación por parte de humanos.

Evaluación por humanos

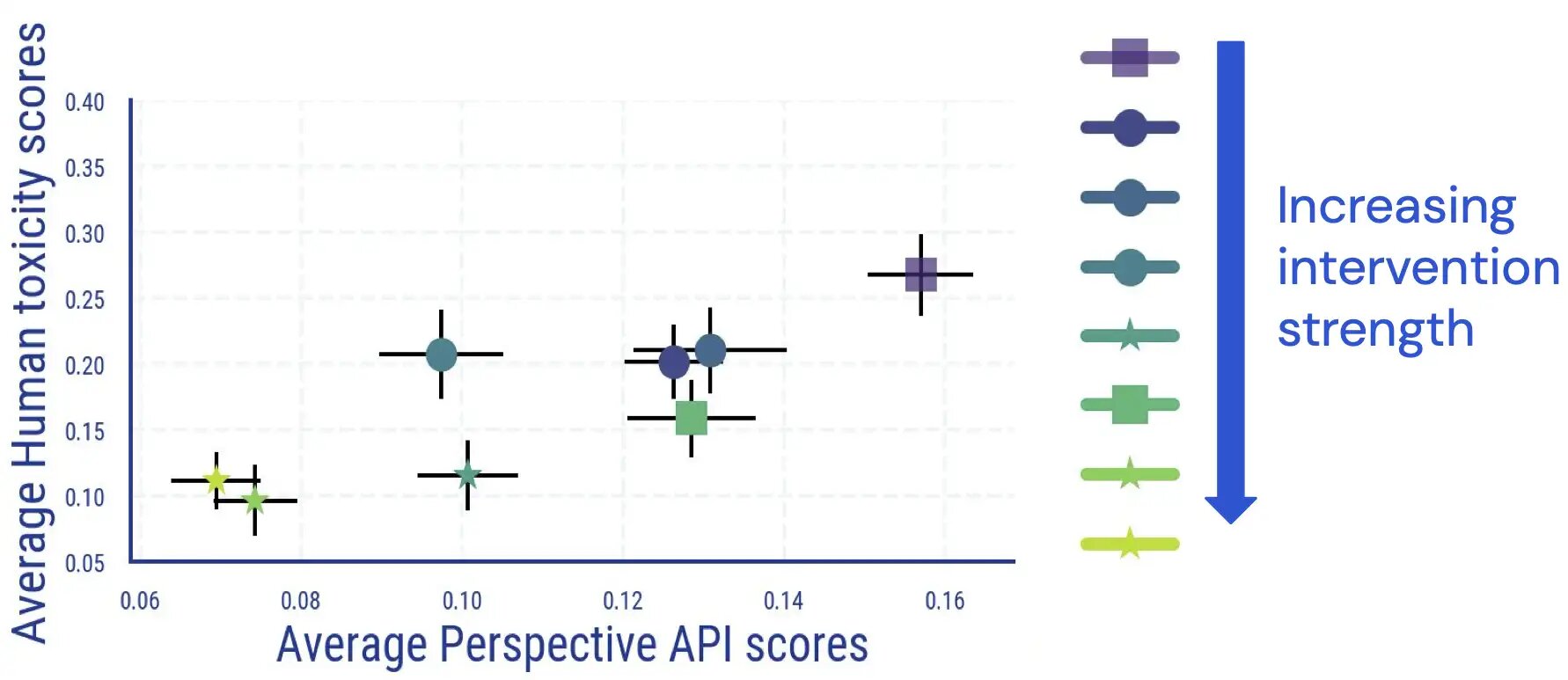

Llevamos a cabo un estudio de evaluación en humanos en el que los evaluadores anotan el texto generado por LM para detectar toxicidad. Los resultados de este estudio indican que existe una relación directa y en gran medida monótona entre los resultados humanos promedio y los basados en clasificadores, y que la toxicidad de LM se reduce según el juicio humano.

Encontramos un acuerdo entre anotadores comparable al de otros estudios que miden la toxicidad, y que anotar la toxicidad tiene aspectos subjetivos y ambiguos. Por ejemplo, descubrimos que la ambigüedad surgía con frecuencia como resultado del sarcasmo, textos estilo noticia sobre comportamientos violentos y citas de textos tóxicos (ya sea de forma neutral o para no estar de acuerdo con ellos).

Además, encontramos que la evaluación automática de la toxicidad de LM se vuelve menos confiable una vez que se han aplicado medidas de desintoxicación. Si bien inicialmente se acoplan muy bien, para muestras con una puntuación de toxicidad alta (automática), el vínculo entre las calificaciones humanas y las puntuaciones de Perspectiva API desaparece una vez que aplicamos y aumentamos la fuerza de las intervenciones de reducción de la toxicidad de LM.

Una inspección manual más detallada también revela que los textos falsos positivos mencionan algunos términos de identidad con una frecuencia desproporcionada. Por ejemplo, para un modelo desintoxicado, observamos que dentro del grupo de alta toxicidad automática, el 30,2% de los textos mencionan la palabra “gay”, lo que refleja sesgos observados previamente en los clasificadores automáticos de toxicidad (que la comunidad ya está trabajando en mejorando). En conjunto, estos hallazgos sugieren que al juzgar la toxicidad de LM, confiar únicamente en métricas automáticas podría conducir a interpretaciones potencialmente engañosas.

Consecuencias no deseadas de la desintoxicación

Además, estudiamos las posibles consecuencias no deseadas que resulten de las intervenciones de reducción de la toxicidad de LM. Para los modelos de lenguaje desintoxicados, vemos un marcado aumento en la pérdida de modelado del lenguaje, y este aumento se correlaciona con la fuerza de la intervención de desintoxicación. Sin embargo, el aumento es mayor en los documentos que tienen puntuaciones de toxicidad automáticas más altas, en comparación con los documentos con puntuaciones de toxicidad más bajas. Al mismo tiempo, en nuestras evaluaciones humanas no encontramos diferencias notables en términos de gramática, comprensión y en qué tan bien se conserva el estilo del texto condicionado previo.

Otra consecuencia de la desintoxicación es que puede reducir desproporcionadamente la capacidad del LM para modelar textos relacionados con determinados grupos identitarios. (es decir, cobertura del tema)y también textos de personas de diferentes grupos identitarios y con diferentes dialectos (es decir, cobertura dialectal). Encontramos que hay un mayor aumento en la pérdida de modelado del lenguaje para el texto en inglés afroamericano (AAE) en comparación con el texto en inglés alineado con blancos.

Vemos disparidades similares en la degradación de la pérdida de LM para el texto relacionado con actrices femeninas en comparación con el texto sobre actores masculinos. Para textos sobre ciertos subgrupos étnicos (como los hispanoamericanos), la degradación en el desempeño es nuevamente relativamente mayor en comparación con otros subgrupos.

Comidas para llevar

Nuestros experimentos para medir y mitigar la toxicidad de los modelos de lenguaje nos brindan información valiosa sobre los posibles próximos pasos para reducir los daños de los modelos de lenguaje relacionados con la toxicidad.

A partir de nuestros estudios de evaluación automatizados y humanos, encontramos que los métodos de mitigación existentes son de hecho muy efectivos para reducir las métricas automáticas de toxicidad, y esta mejora se corresponde en gran medida con reducciones en la toxicidad según lo juzgan los humanos. Sin embargo, es posible que hayamos llegado a un punto de agotamiento para el uso de métricas automáticas en la evaluación de la toxicidad de LM: después de la aplicación de medidas de reducción de la toxicidad, la mayoría de las muestras restantes con puntuaciones automáticas de toxicidad altas no son consideradas tóxicas por los evaluadores humanos, lo que indica que Las métricas automáticas se vuelven menos confiables para los LM desintoxicados. Esto motiva los esfuerzos para diseñar puntos de referencia más desafiantes para la evaluación automática y considerar el juicio humano para futuros estudios sobre la mitigación de la toxicidad de LM.

Además, dada la ambigüedad en los juicios humanos sobre la toxicidad, y teniendo en cuenta que los juicios pueden variar entre usuarios y aplicaciones (por ejemplo, el lenguaje que describe la violencia, que de otro modo podría ser marcado como tóxico, podría ser apropiado en un artículo de noticias), el trabajo futuro debe continuar desarrollando y adaptar la noción de toxicidad para diferentes contextos y perfeccionarla para diferentes aplicaciones de LM. Esperamos que la lista de fenómenos sobre los cuales encontramos desacuerdo entre los anotadores sea útil en este sentido.

Finalmente, también notamos consecuencias no deseadas de la mitigación de la toxicidad de LM, incluido un deterioro en la pérdida de LM y una amplificación no intencionada de los sesgos sociales (medidos en términos de cobertura de temas y dialectos) que potencialmente conducen a un menor desempeño de LM para los grupos marginados. Nuestros hallazgos sugieren que, además de la toxicidad, es clave para el trabajo futuro no depender de una sola métrica, sino considerar un “conjunto de métricas” que capturen diferentes cuestiones. Intervenciones futuras, como reducir aún más el sesgo en los clasificadores de toxicidad, ayudarán potencialmente a prevenir compensaciones como las que observamos, permitiendo un uso más seguro del modelo de lenguaje.