En el campo en rápida evolución del procesamiento del lenguaje natural, los Transformers se han convertido en modelos dominantes, demostrando un rendimiento notable en una amplia gama de tareas de modelado de secuencias, incluido el etiquetado de partes del discurso, el reconocimiento de entidades nombradas y la fragmentación. Antes de la era de los Transformers, los campos aleatorios condicionales (CRF) eran la herramienta de referencia para el modelado de secuencias y específicamente los CRF de cadena lineal que modelan secuencias como gráficos dirigidos, mientras que los CRF en general se pueden usar en gráficos arbitrarios.

Este artículo se desglosará de la siguiente manera:

- Introducción

- Puntajes de emisiones y transición

- Función de pérdida

- Estimación eficiente de la función de partición mediante algoritmo directo

- Algoritmo de Viterbi

- Código LSTM-CRF completo

- Inconvenientes y conclusiones

La implementación de los CRF en este artículo se basa en este excelente tutorial. Tenga en cuenta que definitivamente no es la implementación más eficiente que existe y también carece de capacidad de procesamiento por lotes; sin embargo, es relativamente simple de leer y comprender y debido a que el objetivo de este tutorial es comprender el funcionamiento interno de los CRF, es perfectamente adecuado para a nosotros.

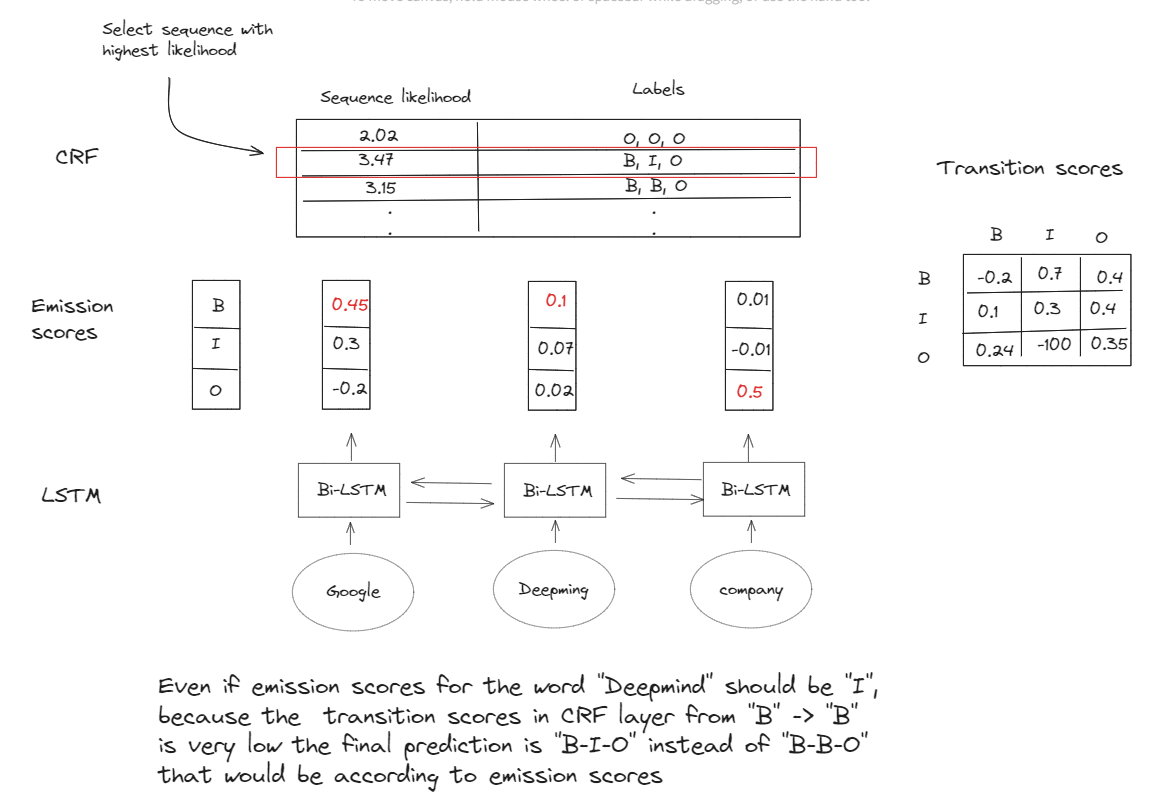

En los problemas de etiquetado de secuencia, tratamos con una secuencia de elementos de datos de entrada, como las palabras dentro de una oración, donde cada elemento corresponde a una etiqueta o categoría específica. El objetivo principal es asignar correctamente la etiqueta adecuada a cada elemento individual. Dentro del modelo CRF-LSTM podemos identificar dos componentes clave para hacer esto: probabilidades de emisión y transición. Nota De hecho, nos ocuparemos de puntuaciones en el espacio logarítmico en lugar de probabilidades de estabilidad numérica:

- Las puntuaciones de emisiones se relacionan con la probabilidad de observar una etiqueta particular para un elemento de datos determinado. En el contexto del reconocimiento de entidades nombradas, por ejemplo, cada palabra en una secuencia está afiliada a una de tres etiquetas: comienzo de una entidad (B), palabra intermedia de una entidad (I) o una palabra fuera de cualquier entidad (O). ). Las probabilidades de emisión cuantifican la probabilidad de que una palabra específica esté asociada con una etiqueta particular. Esto se expresa matemáticamente como P(y_i | x_i), donde y_i denota la etiqueta y x_i representa el…