Los modelos unimodales están diseñados para trabajar con datos de un único modo, que puede ser texto o imágenes. Estos modelos se especializan en comprender y generar contenido específico para el modo elegido. Por ejemplo, los GPT son excelentes para generar texto similar a un humano. Se han utilizado para tareas como traducción de idiomas, generación de texto y respuesta de preguntas. Las redes neuronales convolucionales (CNN) son ejemplos de modelos de imágenes que destacan en tareas como clasificación de imágenes, detección de objetos y generación de imágenes. Actualmente, muchas tareas interesantes, como la respuesta visual a preguntas (VQA) y la recuperación de imágenes y texto, etc., requieren capacidades multimodales. ¿Es posible combinar el procesamiento de texto e imágenes? ¡Podemos! CLIP se destaca como uno de los modelos iniciales de imagen-texto de gran éxito, demostrando competencia tanto en el reconocimiento de imágenes como en la comprensión de texto.

Dividiremos este artículo en las siguientes secciones:

- Introducción

- Arquitectura

- Proceso de entrenamiento y pérdida de contraste.

- Capacidad de disparo cero

- CopaPL

- Conclusiones

El modelo CLIP es un impresionante predictor de tiro cero, que permite predicciones sobre tareas para las que no ha sido entrenado explícitamente. Como veremos con más detalle en las siguientes secciones, al utilizar indicaciones en lenguaje natural para consultar imágenes, CLIP puede realizar la clasificación de imágenes sin requerir datos de entrenamiento específicos de la tarea. Sin embargo, su rendimiento se puede mejorar significativamente con algunos trucos. En esta serie de artículos, exploraremos métodos que aprovechan indicaciones adicionales generadas por modelos de lenguaje grandes (LLM) o algunos ejemplos de capacitación breves sin involucrar ningún entrenamiento de parámetros. Estos enfoques ofrecen una clara ventaja, ya que son computacionalmente menos exigentes y no necesitan ajustar parámetros adicionales.

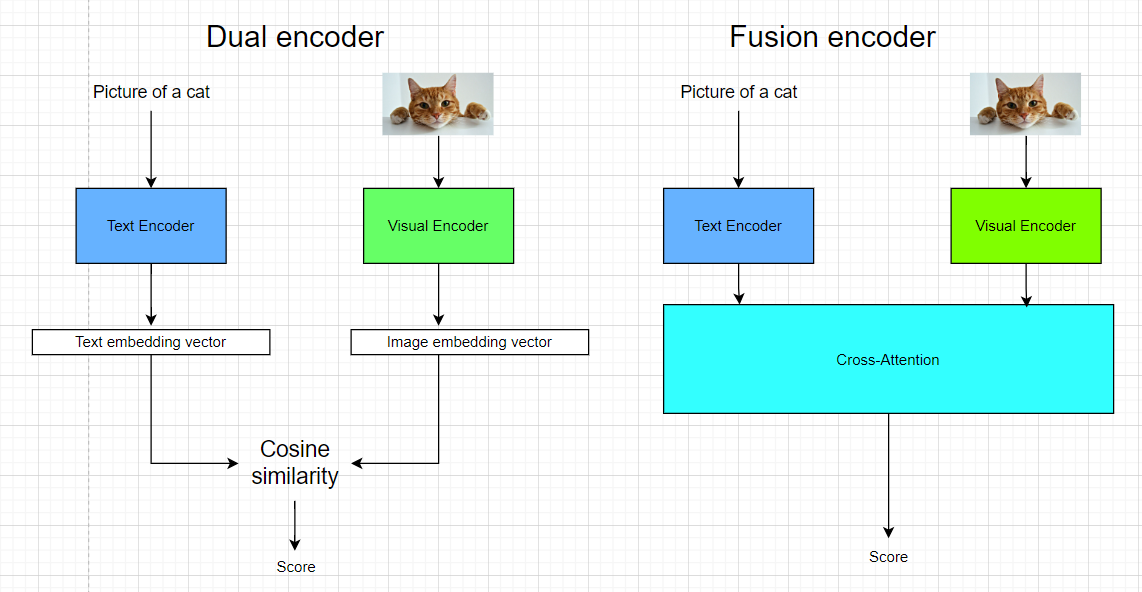

CLIP es un modelo de codificador dual con dos codificadores separados para modalidades visuales y textuales que codifican imágenes y textos de forma independiente. Dicha arquitectura es diferente del codificador de fusión que permite la interacción entre modalidades visuales y textuales a través de la atención cruzada, lo que implica aprender pesos de atención que ayudan al modelo a centrarse en regiones específicas de…