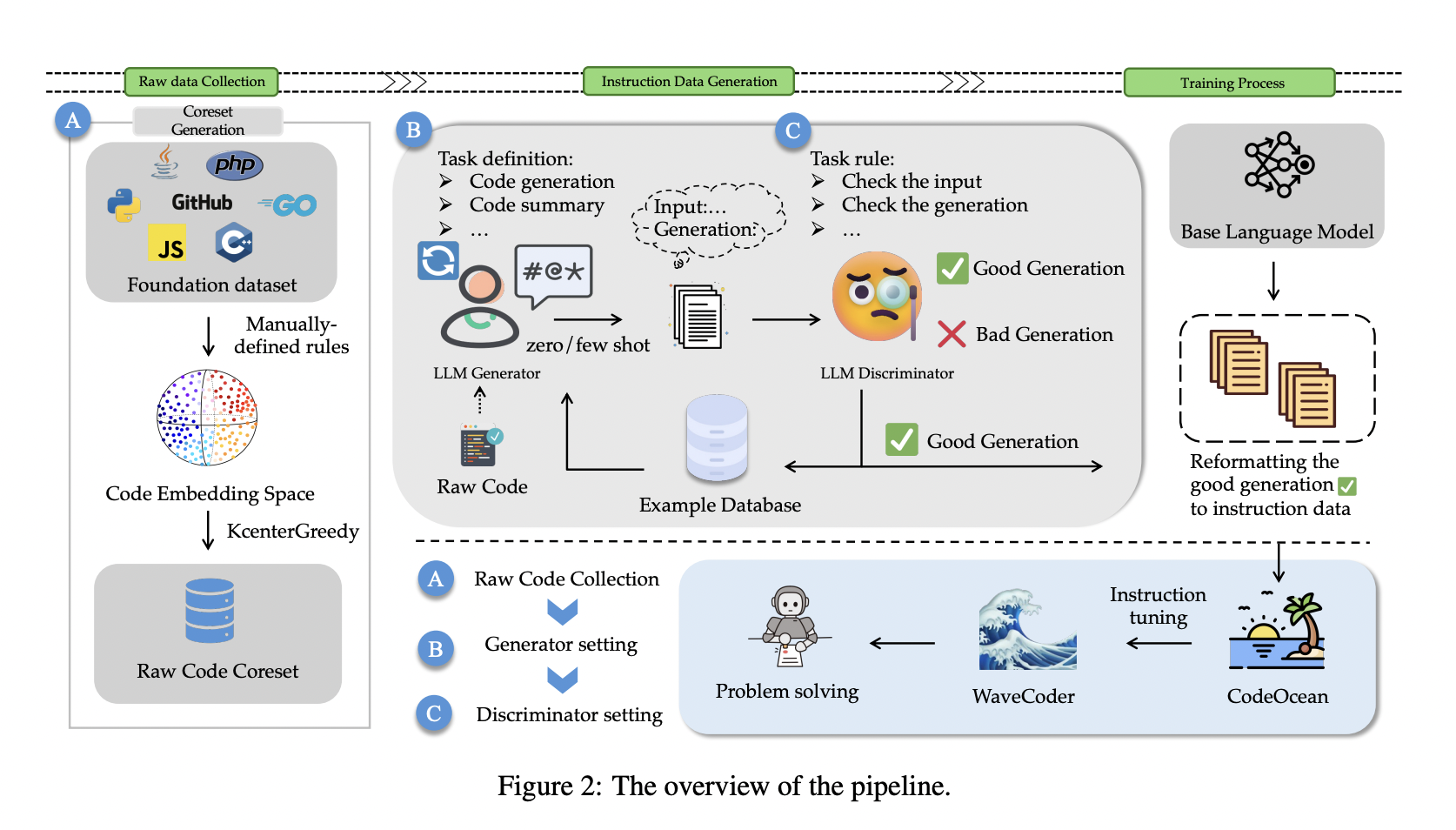

Investigadores de Microsoft han introducido un enfoque novedoso para generar datos de instrucción diversos y de alta calidad a partir de código fuente abierto, mejorando así la efectividad del ajuste de instrucciones y la capacidad de generalización de modelos ajustados. De este modo, aborda los desafíos en la generación de datos de instrucción, como datos duplicados y control insuficiente sobre la calidad de los datos. El método propuesto implica clasificar los datos de instrucción en cuatro tareas universales relacionadas con el código e introduce un marco de procesamiento de datos Generador-Discriminador basado en el modelo de lenguaje (LLM) llamado CodeOcean.

Los investigadores presentan CodeOcean, un conjunto de datos que comprende 20.000 instancias de instrucción en cuatro tareas relacionadas con el código: resumen de código, generación de código, traducción de código y reparación de código. El objetivo es aumentar el rendimiento de Code LLM mediante el ajuste de instrucciones. Este estudio de investigación también presenta WaveCoder, un LLM de código perfeccionado con ajuste de instrucción mejorado generalizado y versátil. WaveCoder está diseñado para mejorar el ajuste de instrucciones para Code LLM y exhibe una capacidad de generalización superior en diferentes tareas relacionadas con el código en comparación con otros modelos de código abierto en la misma escala de ajuste.

Se basa en avances recientes en modelos de lenguajes grandes (LLM), lo que enfatiza el importante potencial del ajuste de instrucciones para mejorar las capacidades del modelo para una variedad de tareas. El ajuste de la instrucción ha demostrado ser eficaz para mejorar las capacidades de generalización de los LLM en diversas tareas, como se ve en estudios como FLAN, ExT5 y FLANT5. La investigación introduce el concepto de alineación, en el que los modelos previamente entrenados, después de haber aprendido de tareas autosupervisadas, pueden comprender entradas de texto. El ajuste de instrucciones proporciona tareas a nivel de instrucción, lo que permite que los modelos previamente entrenados extraigan más información de las instrucciones y mejoren sus habilidades interactivas con los usuarios.

Los métodos existentes para generar datos de instrucción, incluida la autoinstrucción y la instrucción evolutiva, dependen del desempeño de los maestros en maestría y pueden producir datos duplicados. El marco LLM Generator-Discriminator propuesto aprovecha el código fuente y controla explícitamente la calidad de los datos durante el proceso de generación. El método genera datos de instrucciones más realistas tomando código sin formato como entrada y seleccionando un conjunto de datos central mientras controla la diversidad de datos mediante ajustes de distribución de código sin formato.

El estudio clasifica instancias de instrucción en cuatro tareas relacionadas con el código y refina los datos de la instrucción para crear CodeOcean. Los autores presentan modelos WaveCoder, perfeccionados con CodeOcean y demuestran capacidades de generalización superiores en comparación con otros modelos de código abierto. WaveCoder exhibe una alta eficiencia en las tareas de generación de código y proporciona contribuciones significativas a la generación de datos de instrucciones y modelos de ajuste fino para mejorar el rendimiento en tareas relacionadas con el código.

Los modelos WaveCoder superan constantemente a otros modelos en varios puntos de referencia, incluidos HumanEval, MBPP y HumanEvalPack. La investigación enfatiza la importancia de la calidad y diversidad de los datos en el proceso de ajuste de la instrucción. El rendimiento de WaveCoder se evalúa en tareas de generación, reparación y resumen de código, lo que muestra su eficacia en diversos escenarios. Una comparación con el conjunto de datos de CodeAlpaca destaca la superioridad de CodeOcean a la hora de refinar los datos de instrucciones y mejorar la capacidad de seguir instrucciones de los modelos base.

En conclusión, la investigación presenta un enfoque de datos de instrucción multitarea, modelos CodeOcean y WaveCoder para mejorar la capacidad de generalización de Code LLM. El marco LLM Generator-Discriminator propuesto resulta eficaz para generar datos de instrucción diversos y realistas, lo que contribuye a mejorar el rendimiento en diversas tareas relacionadas con el código. El trabajo futuro puede explorar la interacción entre diferentes tareas y conjuntos de datos más grandes para mejorar aún más el rendimiento de una sola tarea y las capacidades de generalización.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de más de 35.000 ml, 41k+ comunidad de Facebook, Canal de discordia, LinkedIn Grarribay Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

Pragati Jhunjhunwala es pasante de consultoría en MarktechPost. Actualmente está cursando su B.Tech en el Instituto Indio de Tecnología (IIT), Kharagpur. Es una entusiasta de la tecnología y tiene un gran interés en el alcance del software y las aplicaciones de ciencia de datos. Siempre está leyendo sobre los avances en diferentes campos de la IA y el ML.