La segmentación de objetos en imágenes y vídeos es una tarea compleja pero fundamental. Tradicionalmente, este campo ha sido testigo de una progresión aislada, con diferentes tareas como la segmentación de imágenes de referencia (RIS), la segmentación de imágenes de pocas tomas (FSS), la segmentación de objetos de vídeo de referencia (RVOS) y la segmentación de objetos de vídeo (VOS) que evolucionan de forma independiente. Este desarrollo inconexo dio lugar a ineficiencias y a la incapacidad de aprovechar eficazmente los beneficios del aprendizaje multitarea.

En el centro de los desafíos de la segmentación de objetos se encuentra la identificación y delineación precisa de los objetos. Esto se vuelve exponencialmente complejo en contextos de vídeo dinámicos o implica interpretar objetos basándose en descripciones lingüísticas. Por ejemplo, RIS a menudo requiere la fusión de visión y lenguaje, lo que exige una profunda integración intermodal. Por otro lado, FSS enfatiza los métodos basados en correlación para una correspondencia semántica densa. Históricamente, las tareas de segmentación de vídeo se han basado en redes de memoria espacio-temporal para la coincidencia a nivel de píxeles. Esta divergencia en las metodologías condujo a modelos especializados y específicos de tareas que consumían recursos computacionales considerables y necesitaban un enfoque unificado para el aprendizaje multitarea.

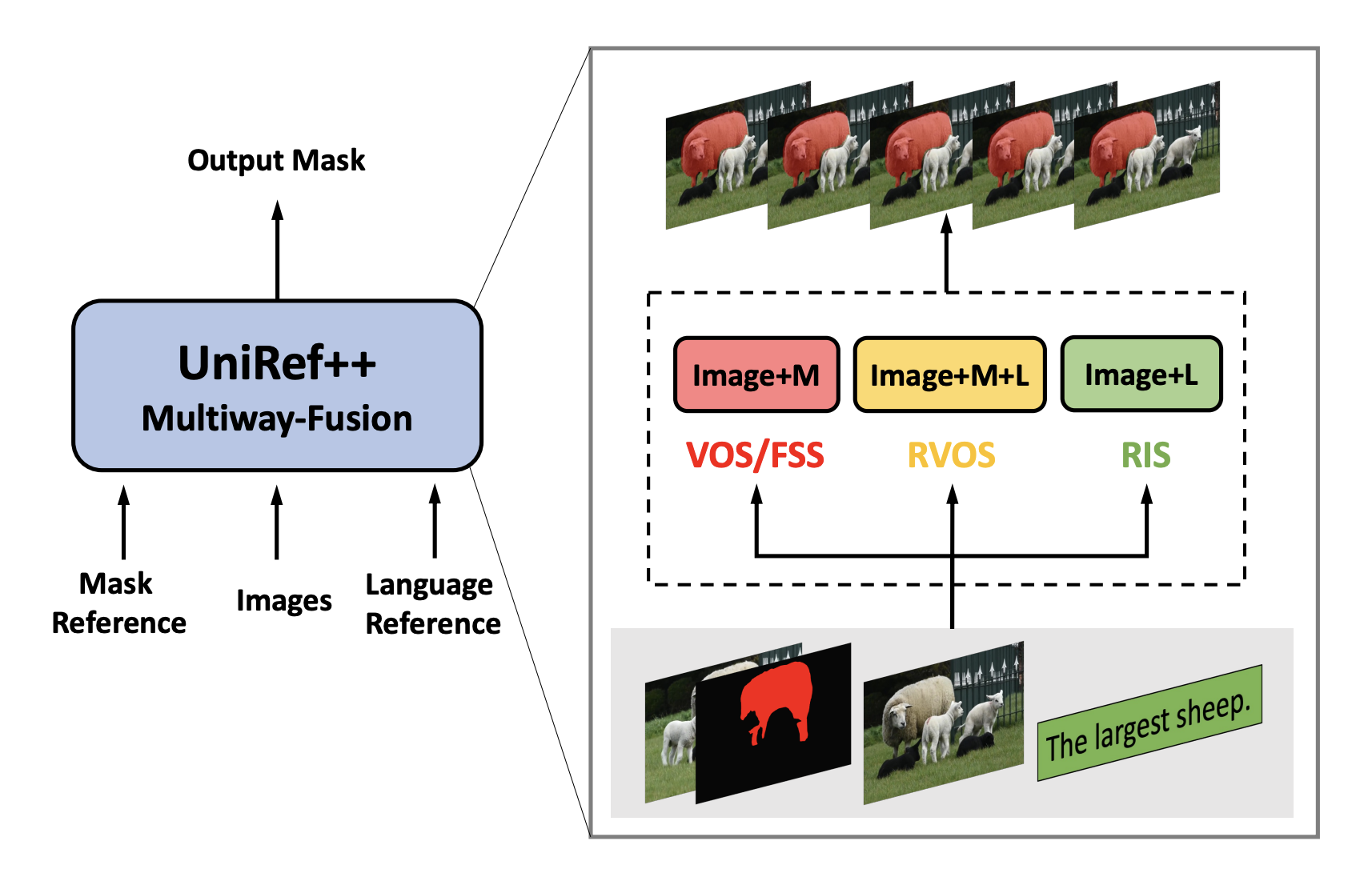

Investigadores de la Universidad de Hong Kong, ByteDance, la Universidad Tecnológica de Dalian y el Laboratorio de IA de Shanghai presentaron UniRef++, un enfoque revolucionario para cerrar estas brechas. UniRef++ es una arquitectura unificada diseñada para integrar perfectamente cuatro tareas críticas de segmentación de objetos. Su innovación radica en el módulo UniFusion, un mecanismo de fusión multidireccional que maneja tareas en función de sus referencias específicas. La capacidad de este módulo para fusionar información de referencias visuales y lingüísticas es especialmente crucial para tareas como RVOS, que requieren comprender descripciones de idiomas y rastrear objetos en videos.

A diferencia de otros puntos de referencia, UniRef++ se puede enseñar de forma colaborativa en una amplia gama de actividades, lo que le permite absorber información amplia que puede usarse para una variedad de trabajos. Esta estrategia funciona, como lo demuestran los resultados competitivos en FSS y VOS y el rendimiento superior en tareas RIS y RVOS. La flexibilidad de UniRef++ le permite ejecutar numerosas funciones en tiempo de ejecución con sólo las referencias correctas especificadas. Esto proporciona un enfoque flexible que permite una transición suave entre referencias verbales y visuales.

La implementación de UniRef++ en el ámbito de la segmentación de objetos no es sólo una mejora incremental sino un cambio de paradigma. Su arquitectura unificada aborda las ineficiencias de larga data de los modelos de tareas específicas y sienta las bases para un aprendizaje multitarea más efectivo en la segmentación de objetos de imágenes y videos. La capacidad del modelo para fusionar varias tareas bajo un único marco, realizando una transición fluida entre referencias lingüísticas y visuales, es ejemplar. Establece un nuevo estándar en el campo, ofreciendo conocimientos y direcciones para futuras investigaciones y desarrollo.

Revisar la Papel y Código. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de más de 35.000 ml, 41k+ comunidad de Facebook, Canal de discordia, LinkedIn Grarribay Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

A Sana Hassan, pasante de consultoría en Marktechpost y estudiante de doble titulación en IIT Madras, le apasiona aplicar la tecnología y la inteligencia artificial para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una nueva perspectiva a la intersección de la IA y las soluciones de la vida real.