En el campo dinámico del desarrollo de software, la integración de grandes modelos de lenguaje (LLM) ha iniciado un nuevo capítulo, especialmente en inteligencia de código. Estos modelos sofisticados han sido fundamentales en la automatización de diversos aspectos de la programación, desde la identificación de errores hasta la generación de código, revolucionando la forma en que se abordan y ejecutan las tareas de codificación. El impacto de estos modelos es enorme y ofrecen aumentar la productividad y disminuir la probabilidad de errores comunes en los procesos de codificación manual.

Sin embargo, un desafío importante en esta área ha sido la disparidad de capacidades entre los modelos de código abierto, propietario y cerrado. Si bien estos últimos han mostrado un rendimiento impresionante, su accesibilidad restringida dificulta la investigación y aplicación de base amplia, lo que genera una brecha de rendimiento notable que es necesario abordar. Esta brecha ha sido una barrera para la democratización de las herramientas de codificación avanzadas, limitando el potencial de innovación y aplicación generalizadas en diversos escenarios de codificación.

Los modelos de código se han entrenado principalmente a nivel de archivo, sin tener en cuenta las complejas interdependencias entre varios archivos en un proyecto de programación. Esto a menudo ha resultado en una brecha en su aplicación práctica, ya que los proyectos de codificación del mundo real generalmente implican relaciones intrincadas entre numerosos archivos. Reconocer esta limitación es crucial para desarrollar modelos que no sólo sean teóricamente competentes sino también aplicables en la práctica.

El equipo de investigación de DeepSeek-AI y la Universidad de Pekín desarrolló la serie DeepSeek-Coder. Esta gama pionera de modelos de código fuente abierto varía entre 1,3 mil millones y 33 mil millones de parámetros. Está capacitado de manera única desde cero en un corpus extenso que cubre 87 lenguajes de programación. Este desarrollo representa un paso significativo para cerrar la brecha existente y mejorar la funcionalidad de los modelos de código abierto en inteligencia de código.

Cabe destacar la metodología adoptada por DeepSeek-Coder. Estos modelos emplean un novedoso enfoque de capacitación de “completar el medio” y una capacidad de ventana de contexto extendida. Este enfoque permite que los modelos manejen secuencias de código más complejas y largas, mejorando significativamente sus capacidades de finalización de código. También los hace muy versátiles, lo que les permite aplicarse de manera más efectiva en escenarios de codificación complejos que involucran múltiples archivos y contextos extendidos. Esta innovación metodológica es un diferenciador clave que distingue a DeepSeek-Coder de los modelos tradicionales.

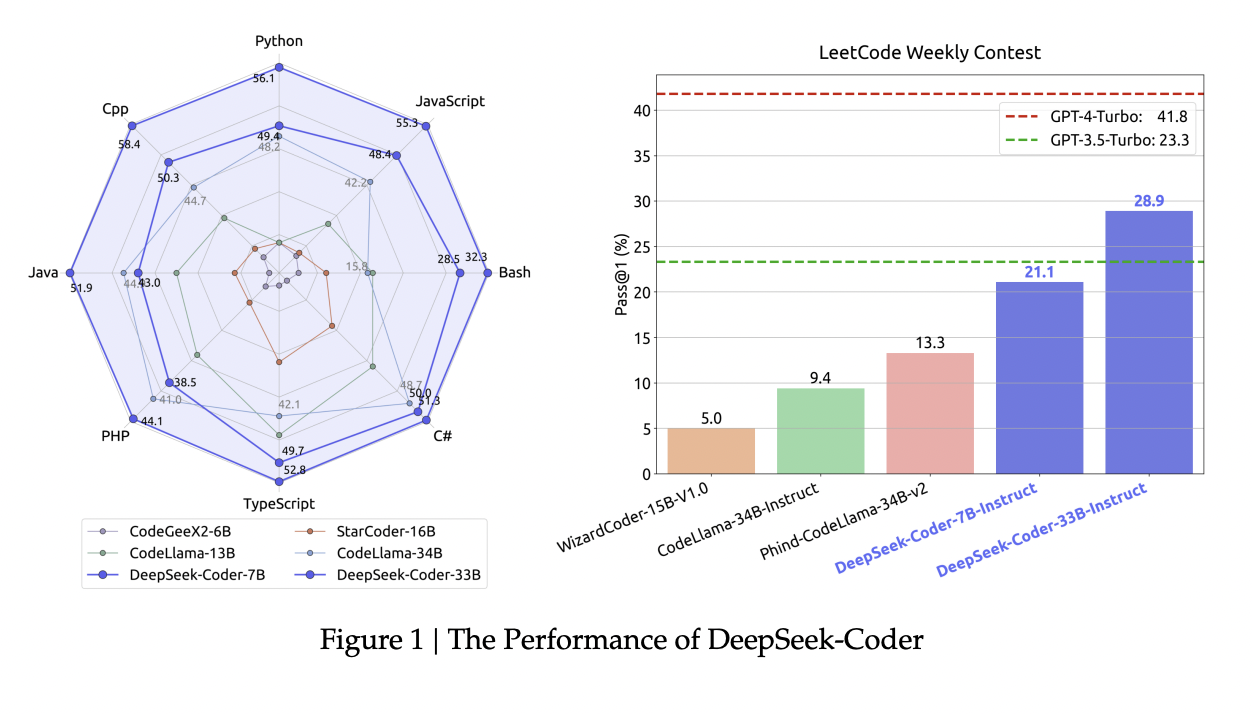

El rendimiento de los modelos DeepSeek-Coder es una característica destacada que demuestra su superioridad en el dominio de código abierto. En particular, el modelo DeepSeek-Coder-Base 33B supera consistentemente a otros modelos de código abierto en varios puntos de referencia. Además, la variante DeepSeek-Coder-Instruct 33B muestra resultados notables en tareas relacionadas con el código, superando a algunos de los principales modelos de código cerrado, incluido el GPT-3.5 Turbo de OpenAI. Estos resultados son un testimonio de la eficacia del enfoque innovador de capacitación y diseño de la serie DeepSeek-Coder.

En conclusión, la serie DeepSeek-Coder marca un avance fundamental en la inteligencia de código. Al abordar eficazmente la brecha entre los modelos de código propietario y de código abierto, DeepSeek-Coder establece un nuevo punto de referencia en el rendimiento de los modelos de código. Su capacidad para comprender y procesar secuencias de códigos complejas y su dominio de varios lenguajes de programación subraya su potencial para revolucionar la generación y comprensión de códigos. Este desarrollo es un salto hacia herramientas de codificación más accesibles, eficientes y avanzadas, allanando el camino para una innovación y aplicación más amplias en el desarrollo de software.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 36k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Muhammad Athar Ganaie, pasante de consultoría en MarktechPost, es un defensor del aprendizaje profundo eficiente, con especial atención en la capacitación dispersa. Cursando un M.Sc. en Ingeniería Eléctrica, con especialización en Ingeniería de Software, combina conocimientos técnicos avanzados con aplicaciones prácticas. Su esfuerzo actual es su tesis sobre “Mejora de la eficiencia en el aprendizaje por refuerzo profundo”, que muestra su compromiso de mejorar las capacidades de la IA. El trabajo de Athar se encuentra en la intersección “Capacitación escasa en DNN” y “Aprendizaje por refuerzo profundo”.