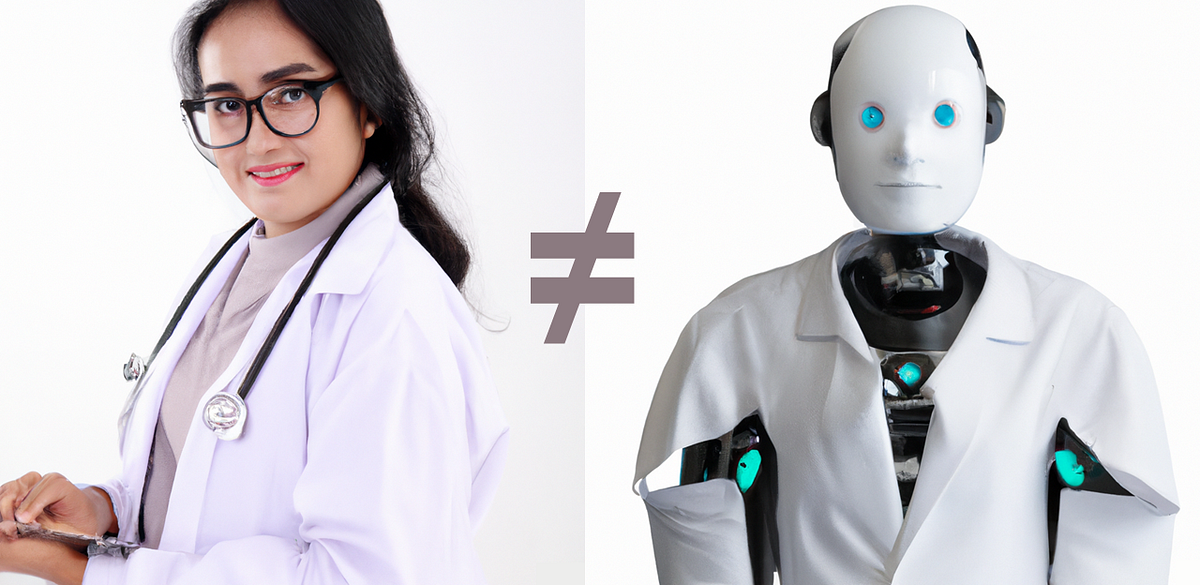

El año pasado, ChatGPT aprobó el examen de licencia médica de EE. UU. y se informó que era “más empático” que los verdaderos médicos. ChatGPT actualmente tiene alrededor de 180 millones de usuarios; Si solo el 10% de ellos le ha hecho a ChatGPT una pregunta médica, esa ya es una población dos veces mayor que la ciudad de Nueva York que usa ChatGPT como médico. Hay una explosión continua de nuevas empresas de chatbots médicos que crean envoltorios delgados alrededor de ChatGPT para repartir consejos médicos. Pero ChatGPT no es un médico, y usar ChatGPT para obtener asesoramiento médico no es sólo contra las políticas de uso de OpenAIpuede ser peligroso.

En este artículo, identifico cuatro problemas clave con el uso de chatbots de uso general existentes para responder preguntas médicas planteadas por los pacientes. Proporciono ejemplos de cada problema utilizando conversaciones reales con ChatGPT. También explico por qué crear un chatbot que pueda responder de forma segura las preguntas de los pacientes es completamente diferente a crear un chatbot que pueda responder preguntas de USMLE. Finalmente, describo los pasos que todos pueden tomar (pacientes, empresarios, médicos y empresas como OpenAI) para hacer que los chatbots sean médicamente más seguros.

Notas

Para facilitar la lectura, utilizo el término “ChatGPT”, pero el artículo se aplica a todos los modelos de lenguaje grande (LLM) de propósito general disponibles públicamente, incluidos ChatGPT, GPT-4, Llama2, Gemini y otros. Existen algunos LLM diseñados específicamente para medicina, como Med-PaLM; Este artículo no trata sobre esos modelos. Me centraré aquí en los chatbots de uso general porque (a) tienen la mayor cantidad de usuarios; (b) son de fácil acceso; y (c) muchos pacientes ya los utilizan para recibir asesoramiento médico.

En los chats con ChatGPT, proporciono citas textuales de la respuesta de ChatGPT, con puntos suspensivos. […] para indicar material que se omitió por motivos de brevedad. Nunca omití nada que hubiera cambiado mi evaluación de la respuesta de ChatGPT. Para que esté completo, las transcripciones completas del chat se proporcionan en un documento de Word adjunto al final de este artículo. Las palabras “Paciente:” y “ChatGPT:” son etiquetas de diálogo y se agregaron posteriormente para mayor claridad. Estas etiquetas de diálogo no formaban parte de las indicaciones ni de las respuestas.