La exploración para perfeccionar el razonamiento de grandes modelos de lenguaje (LLM) marca un paso significativo en la investigación de inteligencia artificial, encabezada por un equipo de FAIR en Meta junto con colaboradores del Instituto de Tecnología de Georgia y StabilityAI. Estos investigadores se han embarcado en un ambicioso viaje para mejorar la capacidad de los LLM para mejorar sus procesos de razonamiento en tareas desafiantes como matemáticas, ciencias y codificación sin depender de aportaciones externas.

Tradicionalmente, los LLM, a pesar de su sofisticación, a menudo necesitan mejorar para identificar con precisión cuándo y cómo su razonamiento necesita perfeccionarse. Esta brecha llevó al desarrollo de modelos de recompensa basados en resultados (ORM), herramientas diseñadas para predecir la precisión de la respuesta final de un modelo, indicando cuándo es necesario un ajuste. Sin embargo, una observación crítica hecha por el equipo fueron las limitaciones de los ORM: se descubrió que eran demasiado cautelosos, lo que provocó refinamientos innecesarios incluso cuando los pasos de razonamiento del modelo estaban en el camino correcto. Esta ineficiencia provocó una investigación más profunda sobre estrategias de refinamiento más específicas.

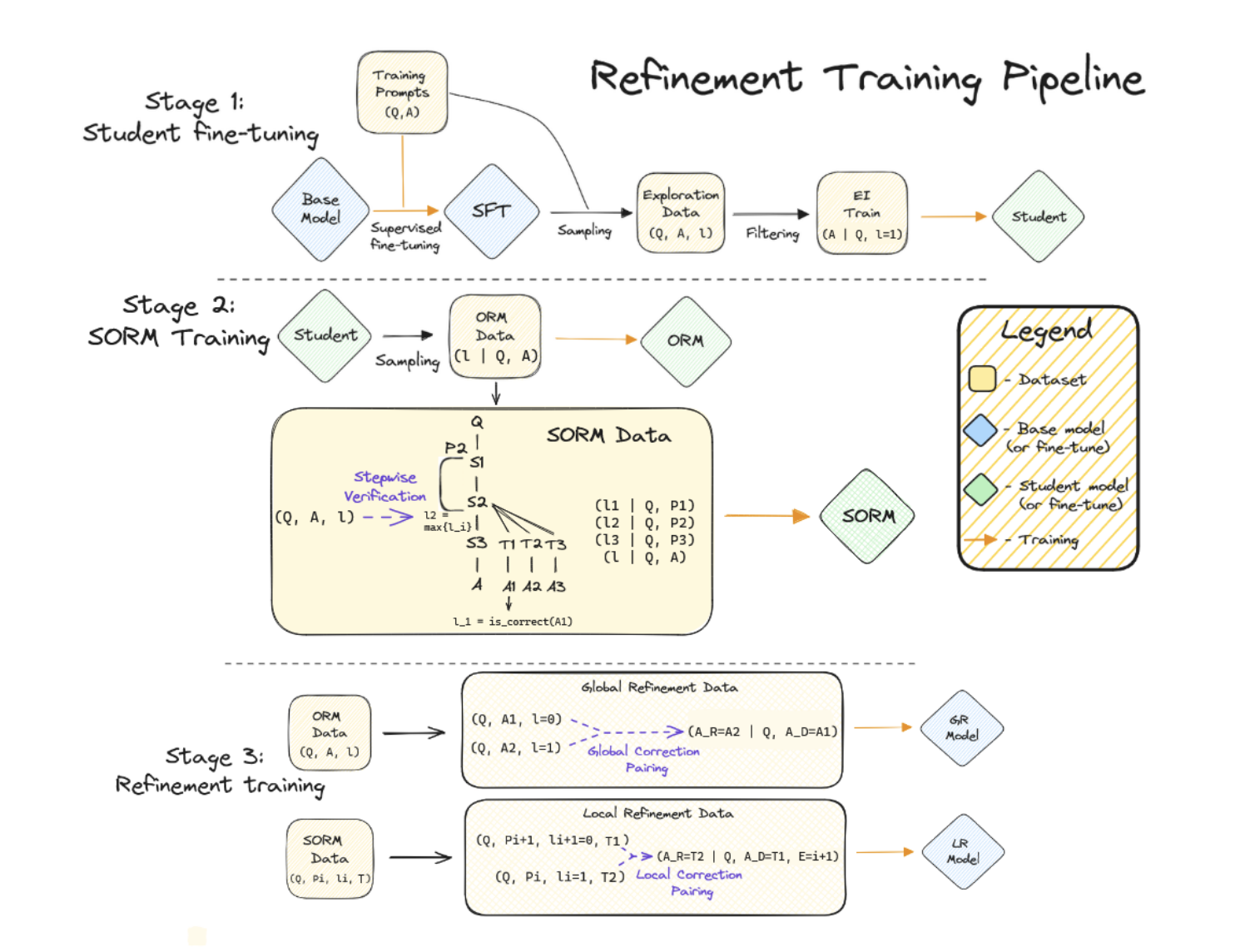

Conozca los ORM paso a paso (SORM), la novedosa propuesta del equipo de investigación. A diferencia de sus predecesores, los SORM son expertos en examinar la exactitud de cada paso del razonamiento, aprovechando datos sintéticos para el entrenamiento. Esta precisión permite un enfoque más matizado del refinamiento, distinguiendo con precisión entre pasos de razonamiento válidos y erróneos, simplificando así el proceso de refinamiento.

La metodología empleada por el equipo implica un modelo de refinamiento dual: global y local. El modelo global evalúa la pregunta y una solución preliminar para proponer una respuesta refinada, mientras que el modelo local se concentra en errores específicos resaltados por una crítica. Esta bifurcación permite un enfoque más granular de la corrección, abordando imprecisiones tanto amplias como puntuales en el razonamiento. Los datos de entrenamiento para ambos modelos se generan sintéticamente, lo que garantiza una base sólida para el proceso de aprendizaje del sistema.

La culminación de esta investigación es una mejora sorprendente en la precisión del razonamiento LLM. El equipo documentó una mejora notable en las métricas de rendimiento a través de pruebas rigurosas, particularmente evidente al aplicar su método al modelo LLaMA-2 13B. En un desafiante problema matemático conocido como GSM8K, la precisión saltó del 53% a un impresionante 65% cuando los modelos se aplicaron en una estrategia combinada de refinamiento global y local, subrayado por el papel del ORM como tomador de decisiones en la selección de la solución más prometedora. .

Este avance significa un avance en las técnicas de refinamiento de LLM y el contexto más amplio de las capacidades de resolución de problemas de la IA. La investigación ilumina un camino hacia sistemas más autónomos, eficientes e inteligentes al delinear cuándo y dónde se necesitan mejoras e implementar una metodología de corrección estratégica. El éxito de este enfoque, evidenciado por la mejora sustancial en la precisión de la resolución de problemas, es un testimonio del potencial del entrenamiento sintético y el uso innovador de modelos de recompensa.

Además, la investigación ofrece un plan para futuras exploraciones sobre el refinamiento de LLM, sugiriendo vías para refinar los procesos de identificación de errores de los modelos y mejorar la sofisticación de las estrategias de corrección. Con esta base, la posibilidad de que los LLM alcancen habilidades de razonamiento casi humanas o incluso superiores en tareas complejas se acerca a la realidad.

El trabajo realizado por el equipo de FAIR en Meta, junto con sus colaboradores académicos, se erige como un faro de innovación en la investigación de la IA. Impulsa las capacidades de los LLM y abre nuevos horizontes para la aplicación de la IA en la resolución de algunos de los problemas más desconcertantes que enfrentan diversos campos científicos y tecnológicos en la actualidad. Por lo tanto, esta investigación no es sólo un hito en el desarrollo de la IA, sino un trampolín hacia el futuro de la informática inteligente.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 38k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

También te puede gustar nuestro Cursos GRATUITOS de IA….

Muhammad Athar Ganaie, pasante de consultoría en MarktechPost, es un defensor del aprendizaje profundo eficiente, con especial atención en la capacitación dispersa. Cursando un M.Sc. en Ingeniería Eléctrica, con especialización en Ingeniería de Software, combina conocimientos técnicos avanzados con aplicaciones prácticas. Su esfuerzo actual es su tesis sobre “Mejora de la eficiencia en el aprendizaje por refuerzo profundo”, que muestra su compromiso de mejorar las capacidades de la IA. El trabajo de Athar se encuentra en la intersección “Capacitación escasa en DNN” y “Aprendizaje por refuerzo profundo”.