Los modelos grandes de imagen a vídeo (I2V) parecen tener mucha posibilidad de generalización en función de sus éxitos recientes. A pesar de que estos modelos pueden alucinar situaciones dinámicas intrincadas después de ver millones de películas, no proporcionan a los usuarios un tipo de control crucial. Es común desear gestionar la generación de fotogramas entre dos puntos finales de imagen; en otras palabras, crear los fotogramas que se encuentran entre dos fotogramas de imagen, incluso si fueron tomados en momentos o lugares muy diferentes. El proceso de intercalación bajo escasas limitaciones de puntos finales se conoce como generación limitada. Debido a que no pueden dirigir la trayectoria hacia un destino preciso, los modelos I2V actuales no pueden realizar una generación limitada. El objetivo es encontrar una manera de generar vídeos que puedan imitar el movimiento tanto de la cámara como del objeto sin asumir nada sobre la dirección del movimiento.

Investigadores del Instituto Max Planck de Sistemas Inteligentes, Adobe y la Universidad de California introdujeron la generación limitada sin entrenamiento del marco de difusión de imagen a video (I2V), definida aquí como el uso de fotogramas iniciales y finales como información contextual. El énfasis principal del investigador está en la Difusión de Video Estable (SVD), un método para la producción de video ilimitada que ha demostrado un realismo y generalización notables. Si bien es teóricamente posible corregir la generación limitada utilizando datos pareados para ajustar el modelo, hacerlo socavaría su capacidad de generalizar. Por tanto, este trabajo se centra en métodos que no requieren formación. El equipo pasa a dos métodos simples y alternativos para la generación limitada sin capacitación: pintura interna y modificación de condición.

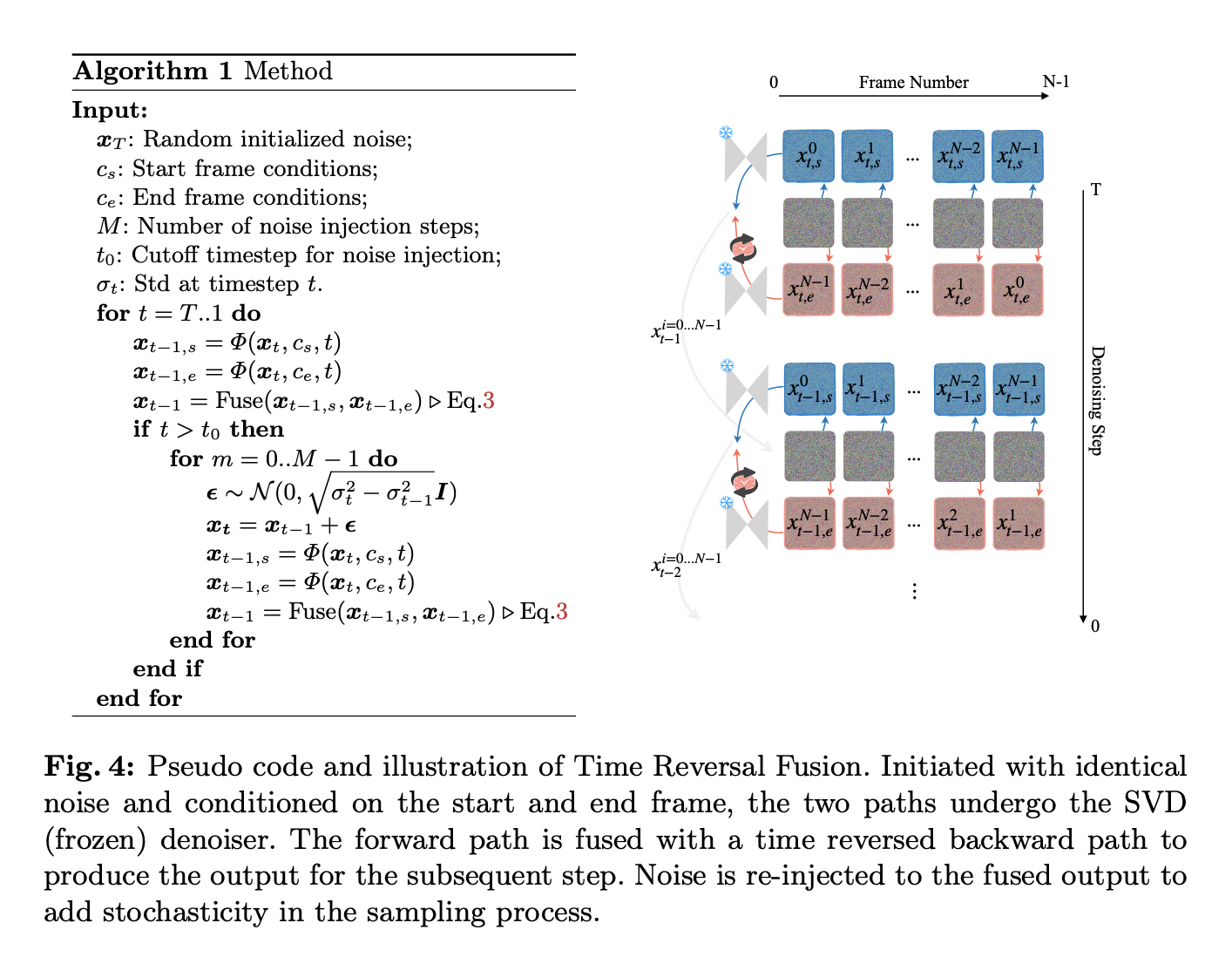

Time Reversal Fusion (TRF) es un enfoque de muestreo novedoso que se introduce en los modelos I2V y permite una generación limitada. Debido a que TRF no requiere capacitación ni ajustes, puede aprovechar las capacidades de generación integradas de un modelo I2V. La falta de capacidad para propagar las circunstancias de la imagen hacia atrás en el tiempo a fotogramas anteriores se debe al hecho de que los modelos I2V actuales están enseñados a proporcionar contenido a lo largo de la flecha del tiempo. Esta falta de capacidad es lo que motivó a los investigadores a desarrollar su enfoque. Para crear una trayectoria única, TRF primero elimina el ruido de las trayectorias hacia adelante y hacia atrás en el tiempo, dependiendo de un cuadro inicial y final, respectivamente.

La tarea se vuelve más compleja cuando ambos extremos del vídeo creado están restringidos. Los métodos sin experiencia a menudo quedan atrapados en mínimos locales, lo que lleva a transiciones de marco abruptas. El equipo aborda esto implementando Noise Re-Injection, un proceso estocástico, para garantizar transiciones de fotogramas perfectas. TRF produce videos que inevitablemente terminan con el cuadro delimitador al fusionar trayectorias bidireccionales independientemente de la correspondencia de píxeles y las suposiciones de movimiento. A diferencia de otros enfoques de creación de video controlado, el enfoque propuesto utiliza completamente la capacidad de generalización del modelo I2V original sin requerir entrenamiento o ajuste del mecanismo de control en conjuntos de datos seleccionados.

Con 395 pares de imágenes que sirvieron como punto inicial y final del conjunto de datos, los investigadores pudieron evaluar películas producidas mediante generación limitada. Estas fotografías contienen una amplia variedad de instantáneas, incluidos movimientos cinemáticos de humanos y animales, movimientos estocásticos de elementos como el fuego y el agua, e imágenes multivista de situaciones estáticas complicadas. Además de hacer posible una gran cantidad de tareas posteriores hasta ahora inviables, los estudios demuestran que los grandes modelos I2V junto con la generación restringida permiten sondear el movimiento generado para comprender la “dinámica mental” de estos modelos.

La estocasticidad inherente del método al crear pases hacia adelante y hacia atrás es una de sus limitaciones. La distribución de posibles rutas de movimiento para SVD podría diferir sustancialmente para dos imágenes de entrada cualesquiera. Debido a esto, las rutas de fotograma inicial y final pueden producir videos drásticamente diferentes, dando lugar a una mezcla poco realista. Además, el enfoque propuesto aborda algunas de las deficiencias de la SVD. Además, si bien las generaciones SVD han demostrado una sólida comprensión del universo físico, no han logrado comprender conceptos como el “sentido común” y el concepto de consecuencia causal.

Revisar la Papel y Proyecto. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro 39k+ ML SubReddi

Dhanshree Shenwai es ingeniero en informática y tiene una buena experiencia en empresas de tecnología financiera que cubren el ámbito financiero, tarjetas y pagos y banca con un gran interés en las aplicaciones de IA. Le entusiasma explorar nuevas tecnologías y avances en el mundo en evolución de hoy que facilita la vida de todos.