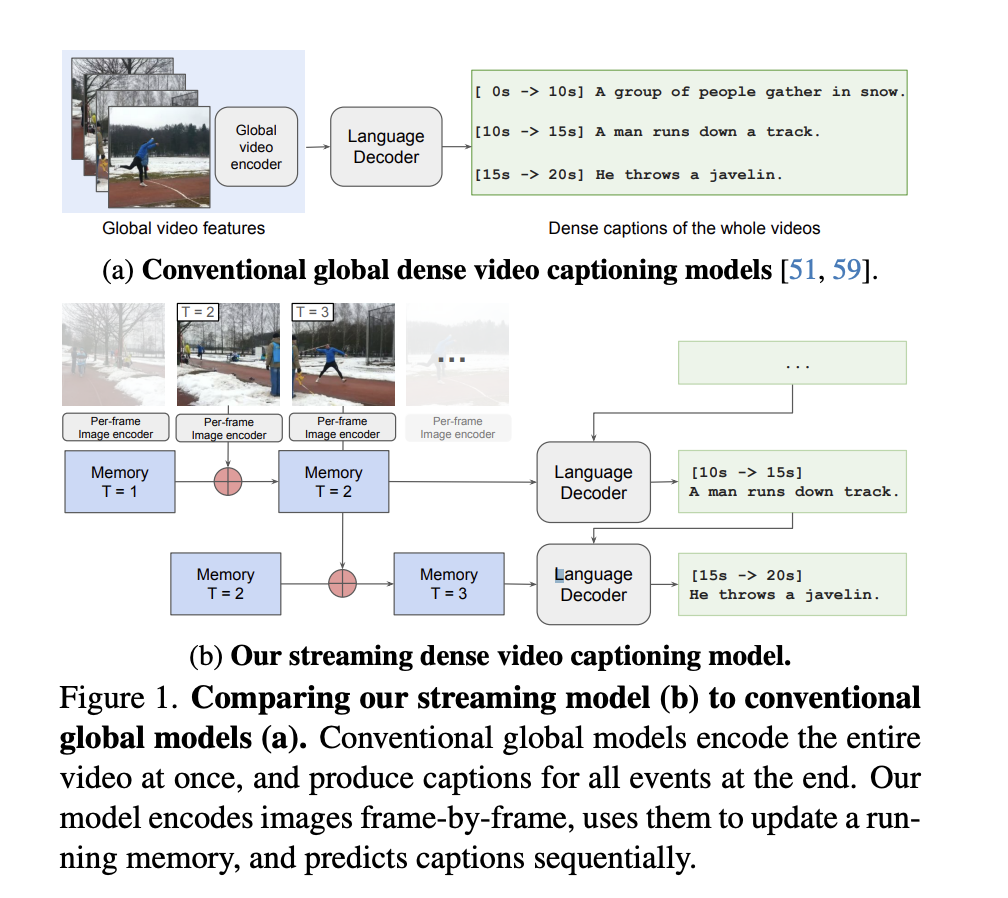

Un equipo de investigadores de Google presentó el modelo Streaming Dense Video Captioning para abordar el desafío de los subtítulos densos en video, que implica localizar eventos temporalmente en un video y generar subtítulos para ellos. Los modelos existentes para la comprensión de vídeos a menudo procesan sólo un número limitado de fotogramas, lo que da lugar a descripciones incompletas o toscas de los vídeos. El artículo pretende superar estas limitaciones proponiendo un modelo de última generación capaz de manejar vídeos de entrada largos y generar subtítulos en tiempo real o antes de procesar el vídeo completo.

Los modelos actuales de última generación para subtítulos de vídeo densos procesan un número fijo de fotogramas predeterminados y realizan una única predicción completa después de ver el vídeo completo. Estas limitaciones hacen que los modelos no sean adecuados para manejar vídeos largos o producir subtítulos en tiempo real. El modelo de subtítulos de vídeo con densidad de transmisión propuesto ofrece una solución a estas limitaciones con sus dos componentes novedosos. Primero, introduce un módulo de memoria basado en la agrupación de tokens entrantes, lo que permite que el modelo maneje videos arbitrariamente largos con un tamaño de memoria fijo. En segundo lugar, desarrolla un algoritmo de decodificación de streaming, que permite al modelo hacer predicciones antes de procesar todo el vídeo, mejorando así su aplicabilidad en tiempo real. Al transmitir entradas con memoria y salidas con puntos de decodificación, el modelo puede producir descripciones textuales ricas y detalladas de los eventos del vídeo antes de completar todo el procesamiento.

El módulo de memoria propuesto utiliza un algoritmo de agrupamiento similar a K-means para resumir información relevante de los cuadros de video, lo que garantiza la eficiencia computacional y al mismo tiempo mantiene la diversidad en las características capturadas. Este mecanismo de memoria permite que el modelo procese un número variable de fotogramas sin exceder un presupuesto computacional fijo para la decodificación. Además, el algoritmo de decodificación de streaming define marcas de tiempo intermedias, llamadas “puntos de decodificación”, donde el modelo predice subtítulos de eventos en función de las características de la memoria en esa marca de tiempo. Al entrenar el modelo para predecir subtítulos en cualquier marca de tiempo del video, el enfoque de transmisión reduce significativamente la latencia de procesamiento y mejora la capacidad del modelo para generar subtítulos precisos. La comparación del modelo de transmisión propuesto con tres conjuntos de datos densos de subtítulos de video muestra que funciona mejor que los métodos actuales.

En conclusión, el modelo propuesto resuelve los desafíos en los modelos actuales de subtítulos de video densos al aprovechar un módulo de memoria para el procesamiento eficiente de fotogramas de video y un algoritmo de decodificación de transmisión para predecir subtítulos en marcas de tiempo intermedias. El modelo propuesto logra un rendimiento de última generación en múltiples pruebas comparativas de subtítulos de vídeo densos. La capacidad del modelo de transmisión para procesar videos largos y generar subtítulos detallados en tiempo real lo hace prometedor para diversas aplicaciones, incluidas videoconferencias, seguridad y monitoreo continuo.

Revisar la Papel y Github. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 39k+ ML

Pragati Jhunjhunwala es pasante de consultoría en MarktechPost. Actualmente está cursando su B.Tech en el Instituto Indio de Tecnología (IIT), Kharagpur. Es una entusiasta de la tecnología y tiene un gran interés en el alcance del software y las aplicaciones de ciencia de datos. Siempre está leyendo sobre los avances en diferentes campos de la IA y el ML.