Exploramos métodos novedosos de aprendizaje de representación de videos que están equipados con capacidad de razonamiento de formato largo. Esta es la Parte III, que ofrece un adelanto de nuestras últimas y mejores exploraciones para el aprendizaje de representación de vídeo egocéntrico de “formato largo”. Ver Parte I en video como un gráfico y es Parte II en escasos transformadores de vídeo-texto.

Los dos primeros blogs de esta serie describieron cómo diferentes motivos arquitectónicos, desde redes neuronales de gráficos hasta transformadores dispersos, abordaron los desafíos del aprendizaje de representación de video de “formato largo”. Mostramos cómo los métodos explícitos basados en gráficos pueden agregar un contexto temporal entre 5 y 10 veces mayor, pero eran métodos de dos etapas. A continuación, exploramos cómo podemos crear memoria y calcular modelos eficientes de aprendizaje de un extremo a otro basados en transformadores y agregados en un contexto temporal 2 veces más grande.

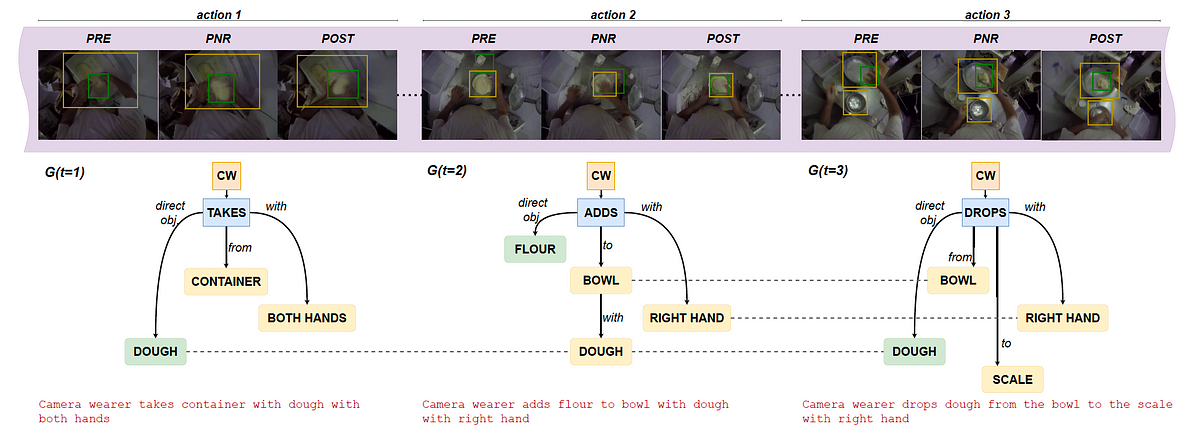

En este blog, lo llevaré a nuestras últimas y mejores exploraciones, especialmente para la comprensión de videos egocéntricos. Como puedes imaginar, lo más probable es que un vídeo egocéntrico o en primera persona (capturado normalmente con cámaras montadas en cascos) provenga de una cámara siempre encendida, lo que significa que los vídeos son realmente muy largos, con mucha información visual irrelevante, especialmente cuando El usuario de la cámara mueve la cabeza. Y esto sucede muchas veces con las cámaras montadas en la cabeza. Un análisis adecuado de estos vídeos en primera persona puede permitir una comprensión detallada de cómo interactúan los humanos con el medio ambiente, cómo manipulan los objetos y, en última instancia, cuáles son sus objetivos e intenciones. Las aplicaciones típicas de los sistemas de visión egocéntricos requieren algoritmos capaces de representar y procesar vídeo en períodos temporales que duran del orden de minutos u horas. Ejemplos de tales aplicaciones son la anticipación de acciones, el resumen de videos y la recuperación de memoria episódica.