El procesamiento del lenguaje natural (PLN) ha avanzado significativamente gracias a las redes neuronales, y los modelos de transformadores marcan la pauta. Estos modelos han funcionado notablemente bien en una variedad de criterios. Sin embargo, plantean serios problemas debido a sus altos requisitos de memoria y su alto gasto computacional, particularmente para aplicaciones que exigen trabajo en contextos prolongados. Este problema persistente motiva la búsqueda de sustitutos más eficaces que mantengan los estándares de desempeño y requieran menos recursos.

El principal problema de los modelos de transformadores son sus elevados requisitos de memoria y procesamiento. Aunque estos modelos funcionan bien en tareas de PNL, podrían resultar más prácticos en contextos con recursos limitados. Esta dificultad resalta la necesidad de modelos con menor sobrecarga computacional que puedan proporcionar un rendimiento comparable o mejor que los actuales. Resolver este problema es esencial para aumentar la usabilidad y accesibilidad de la tecnología moderna de PNL en diversas aplicaciones.

La investigación existente incluye transformadores lineales, cuyo objetivo es mejorar la eficiencia con respecto a los transformadores softmax. El modelo RWKV y RetNet ofrecen un rendimiento competitivo con mecanismos de atención lineal. Los modelos de espacio de estados como H3 y Hyena integran redes recurrentes y convolucionales para tareas de secuencia larga. Métodos como Performers, Cosformer y LUNA se centran en mejorar la eficiencia del transformador. El modelo Griffin combina técnicas de ventana corredera y atención lineal.

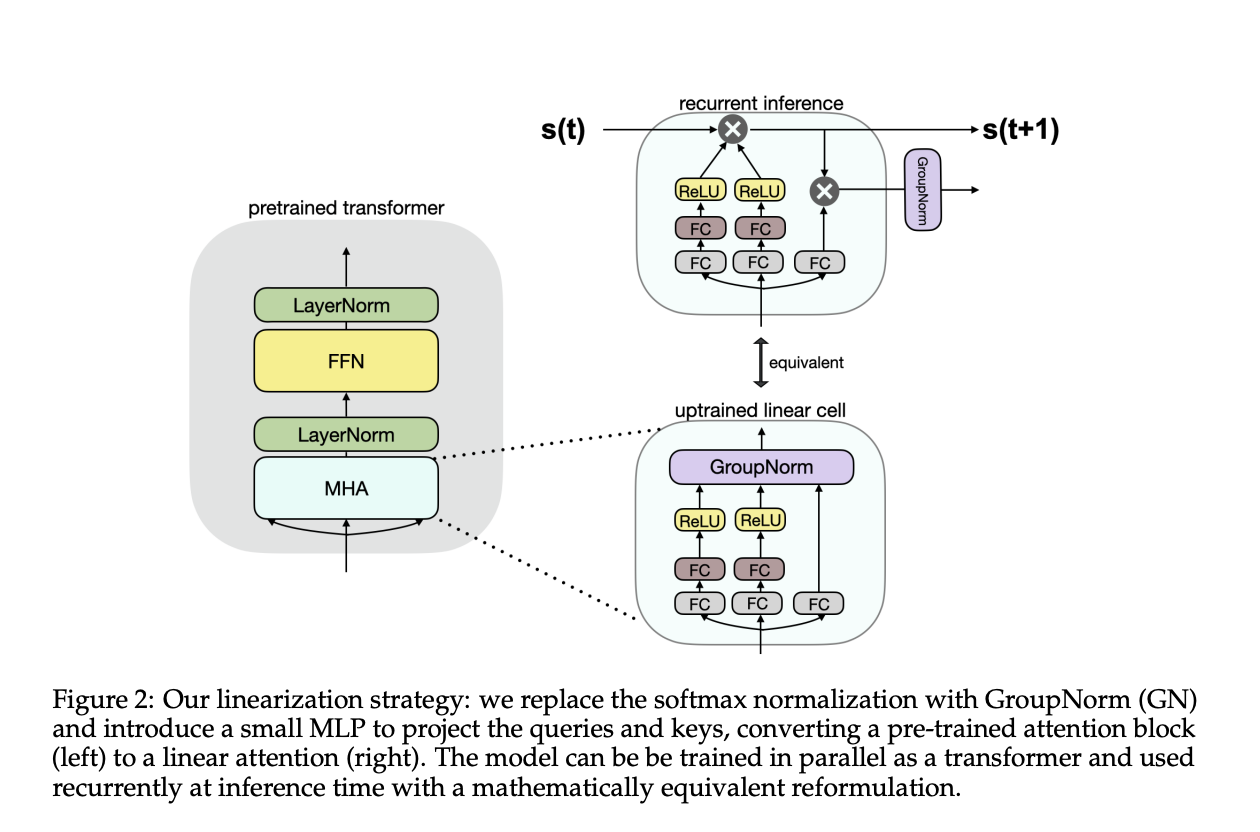

Investigadores del Instituto de Investigación Toyota han introducido el Scalable UPtraining for Recurrent Attention (SUPRA), un método para convertir transformadores previamente entrenados en redes neuronales recurrentes (RNN). Este enfoque aprovecha los datos de entrenamiento previo de alta calidad de los transformadores y al mismo tiempo emplea una técnica de linealización que reemplaza la normalización softmax con GroupNorm. SUPRA es único ya que combina las fortalezas de los transformadores y los RNN, logrando un rendimiento competitivo con un costo computacional reducido.

La metodología SUPRA implica el uptraining de transformadores como Llama2 y Mistral-7B. El proceso reemplaza la normalización softmax con GroupNorm, incluido un pequeño perceptrón multicapa (MLP) para proyectar consultas y claves. Los modelos se entrenaron utilizando el conjunto de datos de RefinedWeb con 1,2 billones de tokens. La capacitación y el ajuste se realizaron utilizando una versión modificada de OpenLM, y las evaluaciones se realizaron con el arnés de evaluación Eleuther en puntos de referencia estándar de NLU. Este enfoque permite que los transformadores operen de manera recurrente y eficiente, manejando tareas de contexto corto y largo.

El método SUPRA mostró un desempeño competitivo en varios puntos de referencia. Superó a RWKV y RetNet en el benchmark HellaSwag, logrando una puntuación de 77,9 frente a 70,9 y 73,0, respectivamente. El modelo también demostró buenos resultados en otras tareas, con puntuaciones de 76,3 en ARC-E, 79,1 en ARC-C y 46,3 en MMLU. La formación requirió sólo 20 mil millones de tokens, significativamente menos que otros modelos. A pesar de algunas caídas en el rendimiento en tareas de contexto prolongado, SUPRA mantuvo resultados sólidos dentro de la duración del contexto de capacitación.

En conclusión, el método SUPRA convierte con éxito transformadores previamente entrenados en RNN eficientes, abordando los altos costos computacionales de los transformadores tradicionales. Al reemplazar la normalización softmax con GroupNorm y utilizar un MLP pequeño, los modelos SUPRA logran un rendimiento competitivo en puntos de referencia como HellaSwag y ARC-C con datos de entrenamiento significativamente reducidos. Esta investigación destaca el potencial de los modelos de PNL escalables y rentables, que mantienen un rendimiento sólido en diversas tareas y allanan el camino para tecnologías avanzadas de procesamiento del lenguaje más accesibles.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 42k+ ML

Nikhil es consultor interno en Marktechpost. Está cursando una doble titulación integrada en Materiales en el Instituto Indio de Tecnología de Kharagpur. Nikhil es un entusiasta de la IA/ML que siempre está investigando aplicaciones en campos como los biomateriales y la ciencia biomédica. Con una sólida formación en ciencia de materiales, está explorando nuevos avances y creando oportunidades para contribuir.