Los modelos de lenguaje grande (LLM) han avanzado significativamente las tareas de procesamiento del lenguaje natural. Recientemente, el uso de LLM para tareas de planificación del mundo físico se ha mostrado prometedor. Sin embargo, los LLM, principalmente modelos autorregresivos, a menudo no logran comprender el mundo real, lo que lleva a acciones alucinatorias y comportamientos de prueba y error. A diferencia de los LLM, los humanos utilizan el conocimiento de las tareas globales y el conocimiento del estado local para ensayar mentalmente y ejecutar tareas de manera eficiente, evitando el ensayo y error ciego y la confusión durante las etapas de planificación y ejecución.

El trabajo existente en sistemas de agentes basados en LLM se centra en la planificación de agentes, la utilización de herramientas externas y la generación de código, a menudo ajustando los LLM de código abierto. Estos enfoques pueden conducir a acciones de prueba y error debido a la falta de cognición ambiental. La planificación de agentes con conocimiento aumentado, utilizando conocimientos previamente entrenados o indicaciones estructuradas, enfrenta desafíos en la transferencia entre tareas.

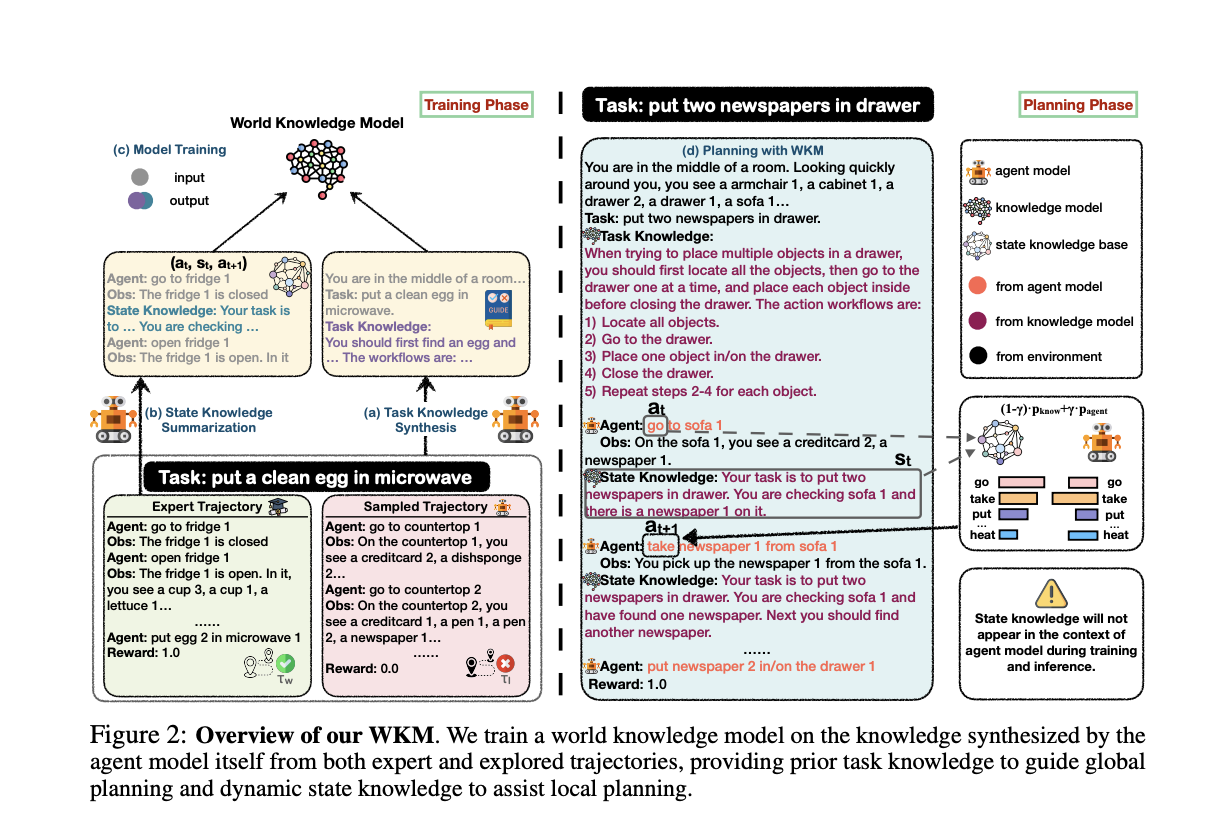

Inspirándose en el enfoque humano de la planificación, investigadores de la Universidad de Zhejiang, el Laboratorio Conjunto de Gráficos de Conocimiento del Grupo Ant, la Universidad Nacional de Singapur y el Grupo Alibaba desarrollaron un método paramétrico. Modelo de conocimiento mundial (WKM) para la planificación de agentes. WKM se basa en el conocimiento de trayectorias tanto de expertos como de trayectorias exploradas. El modelo de agente sintetiza el conocimiento de la tarea comparando estas trayectorias y resume el conocimiento del estado para cada paso de planificación. Este conocimiento se integra en trayectorias expertas para formar al WKM. Durante la planificación, WKM proporciona conocimiento global de la tarea y mantiene el conocimiento del estado dinámico, guiando al agente y previniendo acciones alucinatorias a través de la recuperación de kNN y predicciones ponderadas.

El modelo de agente autosintetiza el conocimiento de la tarea comparando trayectorias de expertos y de muestra. Un agente experimentado genera trayectorias rechazadas de alta calidad, lo que mejora el conocimiento de la tarea más allá del ajuste supervisado. El conocimiento de las tareas guía la planificación global, evitando el ensayo y error ciego. El conocimiento estatal, resumido en cada paso de planificación a partir de trayectorias de expertos, limita la planificación local para prevenir acciones alucinatorias. Una base de conocimiento del estado, formada al combinar el conocimiento del estado con acciones anteriores y posteriores, facilita la recuperación sin sobrecargar el contexto, lo que garantiza una planificación eficaz y precisa de los agentes.

El método se evalúa en conjuntos de datos de ALFWorld, WebShop y ScienceWorld, con tareas invisibles que prueban la generalización. ALFWorld usa recompensas binarias, mientras que WebShop y ScienceWorld usan recompensas densas. Los modelos probados incluyen Mistral-7B, Gemma-7B y Llama-3-8B, en comparación con líneas de base basadas en indicaciones (REACT, Reflexion), líneas de base de ajuste fino (NAT, ETO), KNOWAGENT y ChatGPT/GPT-4. El enfoque, solo a través del entrenamiento LoRA, supera GPT-4 en ALFWorld (44.29→73.57 visto, 38.05→76.87 no visto) y WebShop (62.76→66.64), y ajusta las líneas de base, lo que demuestra que integrar el conocimiento mundial es más efectivo que realizar más ajustes en los ejemplos negativos. WKM muestra un rendimiento y una generalización superiores en comparación con los métodos de conocimiento diseñados por humanos como KNOWAGENT.

Esta investigación desarrolla un WKM paramétrico para mejorar la planificación del modelo de agente lingüístico. El WKM proporciona conocimiento de tareas para la planificación global y conocimiento estatal para la planificación local. Los resultados muestran el rendimiento superior de WKM en GPT-4 y modelos de última generación, superando las sólidas líneas de base. Los experimentos analíticos demuestran la capacidad de WKM para reducir el ensayo y error, mejorar la generalización a tareas invisibles, lograr guía débil-fuerte y extender la capacitación en conocimiento mundial unificado.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo. Únete a nuestro Canal de telegramas, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 43k+ ML

Asjad es consultor interno en Marktechpost. Está cursando B.Tech en ingeniería mecánica en el Instituto Indio de Tecnología, Kharagpur. Asjad es un entusiasta del aprendizaje automático y el aprendizaje profundo que siempre está investigando las aplicaciones del aprendizaje automático en la atención médica.