Los grandes conjuntos de datos previos al entrenamiento de código abierto son importantes para que la comunidad de investigación explore la ingeniería de datos y desarrolle modelos transparentes de código abierto. Sin embargo, hay un cambio importante de los laboratorios de vanguardia al entrenamiento de grandes modelos multimodales (LMM) que necesitan grandes conjuntos de datos que contengan imágenes y textos. Las capacidades de estos modelos de frontera están avanzando rápidamente, creando una gran brecha entre los datos de entrenamiento multimodal disponibles para los modelos cerrados y de código abierto. Los conjuntos de datos multimodales de código abierto actuales son más pequeños y menos diversos en comparación con los conjuntos de datos de solo texto, lo que dificulta el desarrollo de LMM de código abierto sólidos y amplía la brecha en el rendimiento entre los modelos de código abierto y cerrado.

Algunos de los trabajos relacionados que se analizan en este artículo son datos entrelazados multimodales, grandes conjuntos de datos de preentrenamiento de código abierto y LMM. Los conjuntos de datos intercalados multimodales se presentaron por primera vez en Flamingo y CM3. Las primeras versiones de código abierto de estos conjuntos de datos fueron Multimodal-C4 y OBELICS. Trabajos recientes como Chameleon y MM1 han escalado OBELICS para entrenar modelos multimodales de última generación. El segundo enfoque es la columna vertebral de la investigación de código abierto y es importante para entrenar modelos multimodales de código abierto sólidos. En los LMM, los investigadores pretenden entrenar previamente modelos de lenguaje utilizando conjuntos de datos de imagen y texto intercalados multimodales a gran escala. Esto fue introducido por Flamingo y adoptado por modelos de código abierto como OpenFlamingo, Idefics y Emu.

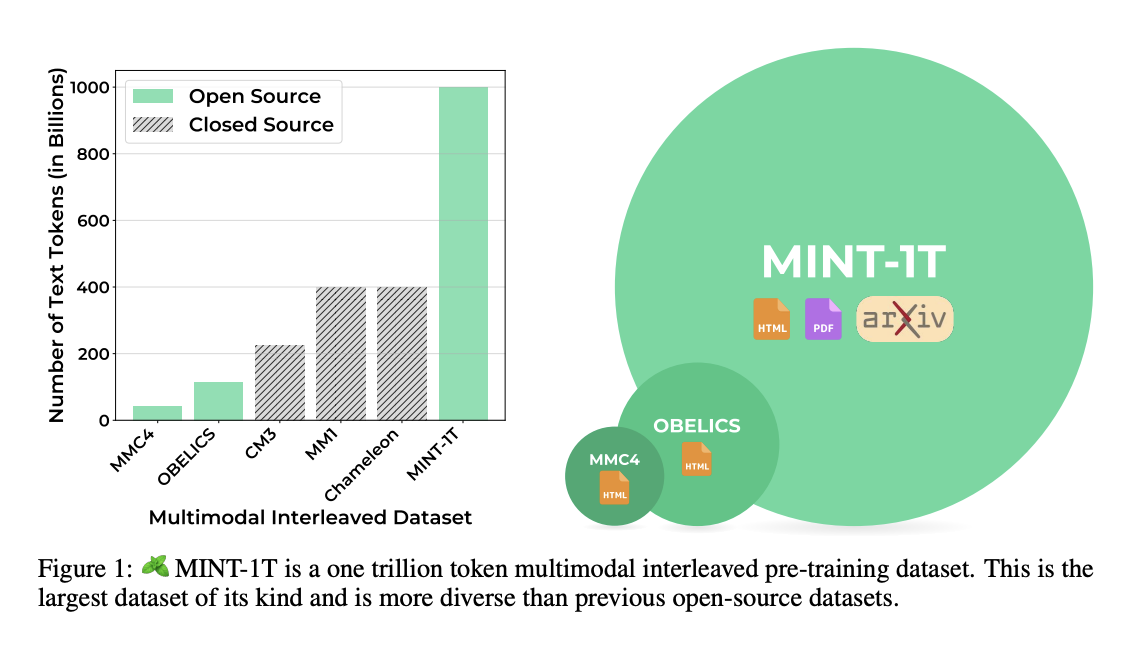

Investigadores de la Universidad de Washington, Salesforce Research, la Universidad de Stanford, la Universidad de Texas en Austin y la Universidad de California en Berkeley han propuesto Multimodal INTerleaved (MINT-1T). Actualmente, MINT-1T es el conjunto de datos intercalados multimodales de código abierto más grande y diverso, que contiene un billón de tokens de texto y tres mil millones de imágenes, recopilados de diversas fuentes como HTML, PDF y ArXiv. Los LLM capacitados en MINT-1T ofrecen una mejora 10 veces mayor en escala y potencialmente superan a los modelos capacitados en el mejor conjunto de datos de código abierto existente, OBELICS, que contiene un conjunto de datos de tokens de texto de 115 mil millones con 353 millones de imágenes obtenidas únicamente de HTML.

MINT-1T ha creado un gran conjunto de datos de código abierto mediante la recopilación de diversas fuentes de documentos mixtos, incluidos archivos PDF y documentos ArXiv, y el conjunto de datos final contiene 965 mil millones de tokens de documentos HTML, 51 mil millones de tokens PDF y 10 mil millones de tokens ArXiv. Para filtrar la calidad del texto, no utilizar heurísticas basadas en modelos ayuda a escalar eficientemente los modelos solo de texto. Esto incluye la eliminación de documentos que no están en inglés utilizando el modelo de identificación de idioma de Fasttext con un umbral de confianza de 0,65. Además, los documentos que contienen URL con subcadenas NSFW se eliminan para evitar contenido pornográfico e indeseable, y se aplican métodos de filtrado de texto de RefinedWeb para eliminar documentos con excesivos n-gramas duplicados.

Para mejorar el rendimiento del aprendizaje en contexto, a los modelos se les solicita de 1 a 15 ejemplos y se ejecuta una única prueba por conteo de disparos para cada punto de referencia de evaluación. Los resultados muestran que el modelo entrenado en MINT-1T funciona mejor que el modelo entrenado en el subconjunto HTML de MINT-1T para todas las tomas. Además, los modelos MINT-1T funcionan de manera similar a los OBELICS de 1 a 10, pero superan después de 10 disparos. Al evaluar el rendimiento en MMMU para cada dominio, MINT-1T supera a OBELICS y la línea base HTML de MINT-1T, excepto en el dominio Empresarial. El método muestra un rendimiento mejorado en los dominios de ciencia y tecnología debido a la alta representación de estos dominios en documentos ArXiv y PDF.

En este artículo, los investigadores presentaron MINT-1T, el primer conjunto de datos entrelazados multimodales de billones de tokens de código abierto y un componente importante para entrenar grandes modelos multimodales. Este método es un recurso importante para que la comunidad de investigación haga ciencia abierta en conjuntos de datos intercalados multimodales. MINT-1T supera al conjunto de datos de código abierto más grande anterior en este dominio, OBELICS, que contiene un conjunto de datos de tokens de texto de 115 mil millones con 353 millones de imágenes obtenidas únicamente de HTML. El trabajo futuro incluye entrenar modelos en subconjuntos más grandes de MINT-1T y desarrollar métodos de filtrado de documentos multimodales para mejorar la calidad de los datos.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo.

Únete a nuestro Canal de telegramas y LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro SubReddit de 44k+ ML

Sajjad Ansari es un estudiante de último año de IIT Kharagpur. Como entusiasta de la tecnología, profundiza en las aplicaciones prácticas de la IA centrándose en comprender el impacto de las tecnologías de IA y sus implicaciones en el mundo real. Su objetivo es articular conceptos complejos de IA de una manera clara y accesible.