Las demandas computacionales de los LLM, particularmente con indicaciones largas, dificultan su uso práctico debido a la complejidad cuadrática del mecanismo de atención. Por ejemplo, procesar una indicación de un millón de tokens con un LLM de ocho mil millones de parámetros en una sola GPU A100 lleva alrededor de 30 minutos en la etapa inicial. Esto genera demoras significativas antes de que el modelo comience a generar resultados. Si bien los métodos existentes apuntan a acelerar este proceso, a menudo necesitan mejorar la precisión y la eficiencia. La atención dispersa dinámica, que se adapta a patrones de entrada variables, puede reducir esta latencia sin un reentrenamiento extenso, a diferencia de los métodos dispersos fijos como Longformer y BigBird.

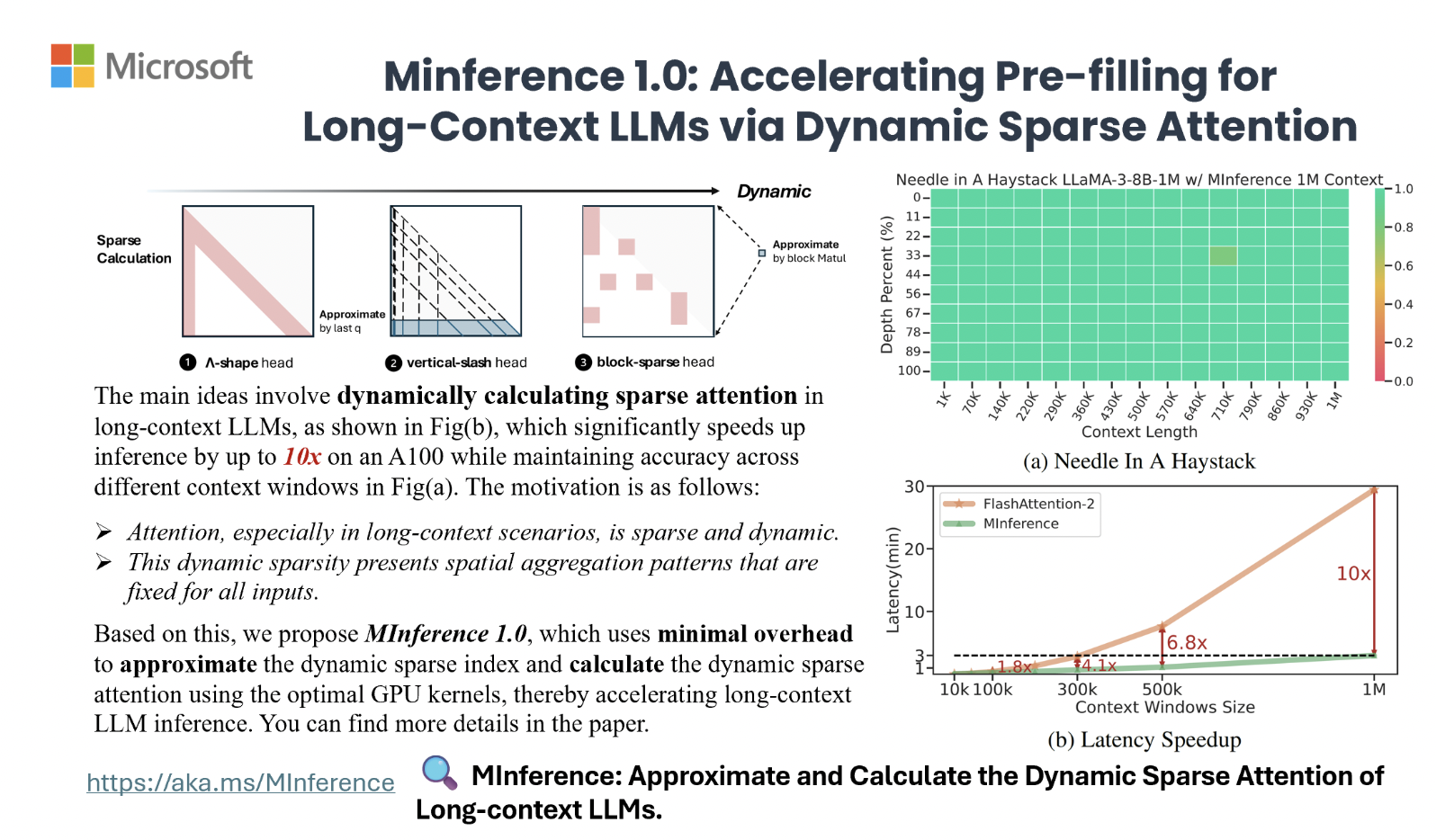

Investigadores de Microsoft Corporation y la Universidad de Surrey han desarrollado MInference (Million-tokens Inference), un método para acelerar el procesamiento de secuencias largas en LLM. Al identificar tres patrones de atención distintos (forma de A, barra vertical y bloque disperso), optimizan los cálculos dispersos para GPU. MInference crea dinámicamente índices dispersos para estos patrones durante la inferencia, lo que reduce significativamente la latencia sin alterar el preentrenamiento ni necesitar ajustes. Las pruebas en varios LLM y puntos de referencia, como LLaMA-3-8B-1M e InfiniteBench, muestran una aceleración de hasta 10 veces, lo que reduce la etapa de prellenado de 30 minutos a 3 minutos en una sola GPU A100 mientras se mantiene la precisión.

Los métodos de atención dispersa tienen como objetivo mejorar la eficiencia del transformador al reducir la complejidad cuadrática de la atención. Estos métodos incluyen patrones dispersos estáticos (por ejemplo, ventanas deslizantes, atención dilatada), enfoques basados en clústeres (por ejemplo, basados en hash, basados en kNN) y atención dispersa dinámica. Sin embargo, generalmente requieren un entrenamiento previo, lo que limita su aplicabilidad directa a los LLM listos para usar. Los enfoques recientes extienden las ventanas de contexto de LLM a través del entrenamiento previo por etapas, incrustaciones de posición modificadas y módulos de memoria externa, pero no reducen los altos costos de inferencia. Otros estudios optimizan el llenado previo y la decodificación en LLM de contexto largo, pero a menudo implican un entrenamiento desde cero o una sobrecarga sustancial, lo que los hace poco prácticos para los modelos preentrenados existentes.

Los pesos de atención en los LLM de contexto largo son inherentemente dispersos y dinámicos. Por ejemplo, en un contexto de 128k, retener solo las columnas de 4k superiores cubre el 96,8 % de la atención total. Sin embargo, los tokens específicos a los que presta atención cada cabeza pueden variar en gran medida con diferentes indicaciones, lo que hace que los patrones de atención dependan en gran medida del contexto. A pesar de esta variabilidad, estos patrones a menudo muestran estructuras consistentes en diferentes capas y cabezas, como forma de A, barra vertical y bloque disperso. Al aprovechar estos patrones, podemos optimizar significativamente los cálculos dispersos en las GPU, lo que reduce la sobrecarga computacional y, al mismo tiempo, mantiene la precisión en los LLM de contexto largo.

Los experimentos realizados tienen como objetivo evaluar la eficacia y eficiencia de MInference en múltiples pruebas comparativas, incluidas InfiniteBench, RULER y la tarea Needle in a Haystack, que abarcan diversos escenarios de contexto largo, como control de calidad, resumen y recuperación. Se utilizaron cuatro modelos de lenguaje de contexto largo de última generación, incluidos LLaMA-3 y GLM-4, con decodificación voraz para lograr coherencia. El rendimiento de MInference se probó en varias longitudes de contexto, lo que demostró superioridad en el mantenimiento del contexto y la velocidad de procesamiento sobre los métodos de la competencia. Se integra de manera eficiente con las técnicas de compresión de caché KV y reduce significativamente la latencia, lo que demuestra su valor práctico para optimizar el rendimiento del modelo de lenguaje de contexto largo.

El estudio aborda el alto costo computacional y la latencia significativa en la etapa de pre-llenado de los cálculos de atención de los LLM de contexto largo mediante la introducción de MInference. MInference acelera este proceso utilizando atención dispersa dinámica con patrones de agregación espacial específicos: forma de A, barra vertical y bloque disperso. Un método que reconoce el núcleo optimiza el patrón disperso para cada cabeza de atención, seguido de una aproximación rápida para crear máscaras dispersas dinámicas para diferentes entradas, lo que facilita una atención dispersa eficiente. Las pruebas en puntos de referencia como InfiniteBench y RULER muestran que MInference mantiene el rendimiento del contexto largo al tiempo que logra una aceleración de hasta 10 veces, reduciendo drásticamente la latencia en una sola GPU A100 de 30 minutos a 3 minutos para indicaciones de hasta 1 millón de tokens. Patrones similares tienen potencial en LLM multimodales y de codificador-decodificador, lo que indica prometedoras aplicaciones de aceleración de la etapa de pre-llenado.

Revisar la Papel, GitHuby Manifestación. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo.

Únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Subreddit de más de 46 000 millones de usuarios

Sana Hassan, pasante de consultoría en Marktechpost y estudiante de doble titulación en el IIT Madrás, es un apasionado de la aplicación de la tecnología y la IA para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una perspectiva nueva a la intersección de la IA y las soluciones de la vida real.