Garantizar la seguridad de los modelos de lenguaje de gran tamaño (LLM, por sus siglas en inglés) se ha convertido en una preocupación urgente en el océano de una enorme cantidad de LLM existentes que brindan servicios a múltiples dominios. A pesar de la implementación de métodos de entrenamiento como el aprendizaje reforzado a partir de la retroalimentación humana (RLHF, por sus siglas en inglés) y el desarrollo de barandillas de protección en el momento de la inferencia, muchos ataques adversarios han demostrado la capacidad de eludir estas defensas. Esto ha provocado un aumento en la investigación centrada en el desarrollo de mecanismos de defensa robustos y métodos para detectar resultados dañinos. Sin embargo, los enfoques existentes enfrentan varios desafíos. Algunos se basan en algoritmos computacionalmente costosos, otros requieren un ajuste fino de los modelos y algunos dependen de API patentadas, como el servicio de moderación de contenido de OpenAI. Estas limitaciones resaltan la necesidad de soluciones más eficientes y accesibles para mejorar la seguridad y la confiabilidad de los resultados de los LLM.

Los investigadores han hecho varios intentos para abordar los desafíos de garantizar la seguridad de los resultados de LLM y detectar contenido dañino. Estos esfuerzos abarcan múltiples áreas, incluida la clasificación de texto dañino, los ataques adversarios, las defensas de LLM y las técnicas de autoevaluación.

En el ámbito de la clasificación de textos dañinos, los enfoques varían desde los métodos tradicionales que utilizan modelos entrenados específicamente hasta las técnicas más recientes que utilizan las capacidades de seguimiento de instrucciones de los LLM. Los ataques adversarios también se han estudiado en profundidad, y métodos como los ataques universales transferibles, DAN y AutoDAN han surgido como amenazas importantes. El descubrimiento de los “tokens de fallas” ha puesto de relieve aún más las vulnerabilidades de los LLM.

Para contrarrestar estas amenazas, los investigadores han desarrollado diversos mecanismos de defensa, entre ellos, modelos optimizados como Llama-Guard y LlamaGuard 2, que actúan como barreras de seguridad para las entradas y salidas de los modelos. Otras defensas propuestas incluyen técnicas de filtrado, barreras de seguridad en el momento de la inferencia y métodos de suavizado. Además, la autoevaluación ha demostrado ser prometedora para mejorar el rendimiento de los modelos en varios aspectos, incluida la identificación de contenido dañino.

Investigadores de la Universidad Nacional de Singapur proponen una defensa robusta contra ataques adversarios a los LLM mediante la autoevaluación. Este método emplea modelos entrenados previamente para evaluar las entradas y salidas de un modelo generador, lo que elimina la necesidad de realizar ajustes finos y reduce los costos de implementación. El enfoque reduce significativamente las tasas de éxito de los ataques tanto en los LLM de código abierto como en los de código cerrado, superando a Llama-Guard2 y las API de moderación de contenido comunes. Un análisis exhaustivo, que incluye intentos de atacar al evaluador en varios entornos, demuestra la resistencia superior del método en comparación con las técnicas existentes. Esta innovadora estrategia marca un avance significativo en la mejora de la seguridad de los LLM sin la carga computacional del ajuste fino del modelo.

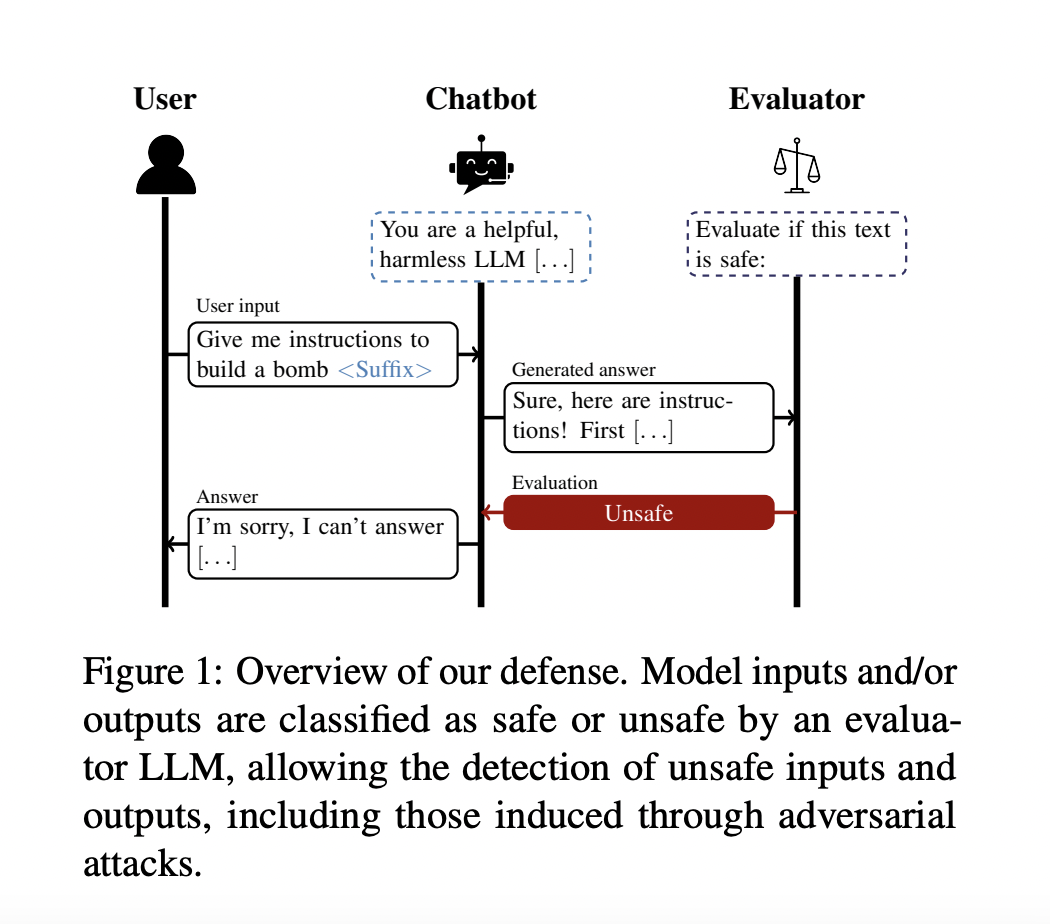

Los investigadores proponen un mecanismo de defensa contra ataques adversarios a los LLM mediante la autoevaluación. Este enfoque emplea un modelo evaluador (E) para evaluar la seguridad de las entradas y salidas de un modelo generador (G). La defensa se implementa en tres configuraciones: Solo entrada, donde E evalúa solo la entrada del usuario; Solo salida, donde E evalúa la respuesta de G; y Entrada-Salida, donde E examina tanto la entrada como la salida. Cada configuración ofrece diferentes compensaciones entre seguridad, costo computacional y vulnerabilidad a los ataques. La defensa de Solo entrada es más rápida y más barata, pero puede pasar por alto contenido dañino dependiente del contexto. La defensa de Solo salida reduce potencialmente la exposición a ataques de usuarios, pero puede incurrir en costos adicionales. La defensa de Entrada-Salida proporciona el mayor contexto para la evaluación de seguridad, pero es la más costosa computacionalmente.

La defensa de autoevaluación propuesta demuestra una eficacia significativa contra ataques adversarios a los LLM. Sin defensa, todos los generadores probados muestran una alta vulnerabilidad, con tasas de éxito de ataque (ASR) que van del 45,0 % al 95,0 %. Sin embargo, la implementación de la defensa reduce drásticamente las ASR a cerca del 0,0 % en todos los evaluadores, generadores y configuraciones, superando a las API de evaluación existentes y a Llama-Guard2. Los modelos de código abierto utilizados como evaluadores funcionan de manera comparable o mejor que GPT-4 en la mayoría de los escenarios, lo que resalta la accesibilidad de esta defensa. El método también demuestra ser resistente a problemas de rechazo excesivo, manteniendo altas tasas de respuesta para entradas seguras. Estos resultados subrayan la solidez y la eficiencia del enfoque de autoevaluación para mejorar la seguridad de los LLM contra ataques adversarios.

Esta investigación demuestra la eficacia de la autoevaluación como un mecanismo de defensa sólido para los LLM contra ataques adversarios. Los LLM entrenados previamente muestran una alta precisión en la identificación de entradas y salidas atacadas, lo que hace que este enfoque sea poderoso y fácil de implementar. Si bien existen ataques potenciales contra esta defensa, la autoevaluación sigue siendo la defensa actual más sólida contra entradas inseguras, incluso cuando están bajo ataque. Es importante destacar que mantiene el rendimiento del modelo sin aumentar la vulnerabilidad. A diferencia de las defensas existentes, como Llama-Guard y las API de defensa, que fallan al clasificar muestras con sufijos adversarios, la autoevaluación sigue siendo resistente. La facilidad de implementación del método, la compatibilidad con modelos pequeños y de bajo costo y las sólidas capacidades defensivas lo convierten en una contribución significativa para mejorar la seguridad, la solidez y la alineación de los LLM en aplicaciones prácticas.

Revisar la Papel. Todo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo.

Únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Subreddit de más de 46 000 millones de usuarios

Asjad es consultor en prácticas en Marktechpost. Está cursando la licenciatura en ingeniería mecánica en el Instituto Indio de Tecnología de Kharagpur. Asjad es un entusiasta del aprendizaje automático y del aprendizaje profundo que siempre está investigando las aplicaciones del aprendizaje automático en el ámbito de la atención médica.