PleIAs anunció recientemente el lanzamiento de OCRonos-Vintageun modelo especializado y preentrenado diseñado específicamente para la corrección mediante reconocimiento óptico de caracteres (OCR). Este modelo innovador representa un hito importante en la tecnología OCR, en particular en su aplicación a los archivos de patrimonio cultural.

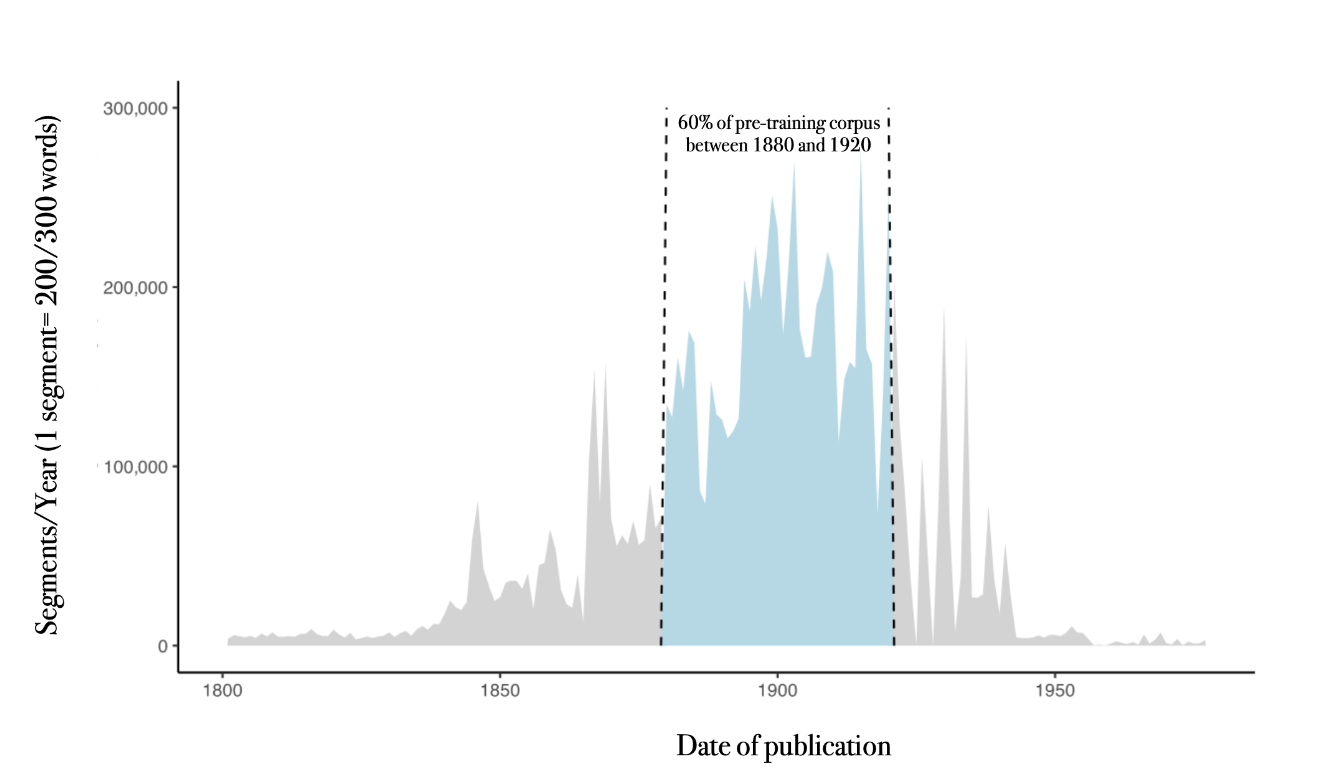

OCRonos-Vintage es un modelo de 124 millones de parámetros entrenado exclusivamente con 18 mil millones de tokens de archivos de patrimonio cultural. Este entrenamiento especializado tiene como objetivo mejorar el rendimiento del modelo en la corrección de errores de OCR en documentos históricos. OCRonos-Vintage ha demostrado una eficacia excepcional en esta aplicación de nicho a pesar de su tamaño relativamente pequeño en comparación con otros modelos. Su desarrollo destaca la creciente tendencia a crear modelos altamente especializados adaptados a tareas específicas en lugar de depender únicamente de modelos grandes y generalistas.

El entrenamiento de OCRonos-Vintage se llevó a cabo utilizando el nuevo clúster H100 en Jean Zay, con el apoyo de una subvención de computación. El modelo se entrenó con llm.c, una nueva biblioteca de preentrenamiento desarrollada por Andrej Karpathy. Creada con fines pedagógicos, esta biblioteca ha demostrado ser muy eficaz para entrenar modelos desde cero. La combinación de canales avanzados de preprocesamiento de datos y el rendimiento eficiente de llm.c permitieron que el proceso de entrenamiento se desarrollara de manera fluida y eficiente.

El preentrenamiento especializado, como el que ejemplifica OCRonos-Vintage, se está volviendo cada vez más viable y atractivo por varias razones. Una de las principales ventajas es la rentabilidad. Los modelos con 100 a 300 millones de parámetros, como OCRonos-Vintage, se pueden implementar en la mayoría de las infraestructuras de CPU sin necesidad de una adaptación o cuantificación extensiva. En entornos de GPU, estos modelos ofrecen un rendimiento significativamente mayor. Esta eficiencia es particularmente importante para procesar grandes volúmenes de datos, como los vastos archivos de patrimonio cultural a los que se dirige OCRonos-Vintage.

Otro beneficio clave del preentrenamiento especializado es la mayor personalización que permite. La arquitectura y el tokenizador de un modelo se pueden diseñar específicamente teniendo en cuenta la tarea y los datos de destino. Para la corrección de OCR, un tokenizador entrenado en una pequeña muestra de datos ruidosos puede superar a los modelos más generalistas. Este enfoque permite optimizar el modelo para requisitos específicos, como el manejo de contextos largos o la mejora de la comprensión en idiomas distintos del inglés. El potencial para una inferencia rápida y un rendimiento mejorado, incluso en la tokenización a nivel de letras o bytes, hace que los modelos especializados sean altamente adaptables y eficientes.

El entrenamiento previo especializado ofrece un control total sobre los datos utilizados. En entornos regulados, la implementación o el ajuste de los modelos existentes pueden generar inquietudes sobre la responsabilidad de los datos. Los modelos especializados como OCRonos-Vintage, entrenados de principio a fin con conjuntos de datos seleccionados, evitan estos problemas. Todos los datos de entrenamiento para OCRonos-Vintage provienen de archivos de patrimonio cultural de dominio público, lo que garantiza el cumplimiento de las regulaciones sobre el uso de datos y promueve la transparencia.

A medida que PleIAs continúa experimentando e iterando en otras tareas, como el resumen y la clasificación, los conocimientos adquiridos con OCRonos-Vintage probablemente informarán el desarrollo de futuros modelos especializados. Las implicaciones más amplias de este enfoque sugieren que los modelos pequeños y eficientes pueden lograr un rendimiento notable en tareas que requieren un uso intensivo del razonamiento, lo que desafía el énfasis convencional en los grandes recuentos de parámetros para lograr una coherencia lógica.

En conclusión, el lanzamiento de OCRonos-Vintage por parte de PleIAs marca un hito importante en la evolución de los modelos de IA especializados. Al centrarse en tareas específicas y optimizar los modelos, PleIAs demuestra que el entrenamiento previo especializado puede ofrecer un rendimiento excepcional manteniendo la eficiencia y la rentabilidad. Este enfoque hace avanzar el campo de la corrección de OCR y sienta un precedente para el desarrollo de modelos de IA especializados en diversas aplicaciones.

Revisar la Modelo y DetallesTodo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Más de 47 000 suscriptores de ML en Reddit

Encuentra lo próximo Seminarios web sobre IA aquí

Asif Razzaq es el director ejecutivo de Marktechpost Media Inc. Como ingeniero y emprendedor visionario, Asif está comprometido con aprovechar el potencial de la inteligencia artificial para el bien social. Su iniciativa más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, Marktechpost, que se destaca por su cobertura en profundidad de noticias sobre aprendizaje automático y aprendizaje profundo que es técnicamente sólida y fácilmente comprensible para una amplia audiencia. La plataforma cuenta con más de 2 millones de visitas mensuales, lo que ilustra su popularidad entre el público.