Los modelos de lenguaje extensos (LLM, por sus siglas en inglés) se implementan ampliamente en sistemas sociotécnicos como la atención médica y la educación. Sin embargo, estos modelos a menudo codifican normas sociales a partir de los datos utilizados durante el entrenamiento, lo que genera inquietudes sobre su alineamiento con las expectativas de privacidad y comportamiento ético. El desafío central es asegurar que estos modelos se adhieran a las normas sociales en diferentes contextos, arquitecturas de modelos y conjuntos de datos. Además, la sensibilidad a las indicaciones (donde pequeños cambios en las indicaciones de entrada conducen a diferentes respuestas) complica la evaluación de si los LLM codifican de manera confiable estas normas. Abordar este desafío es fundamental para prevenir problemas éticos como violaciones no deseadas de la privacidad en dominios sensibles.

Los métodos tradicionales para evaluar los LLM se centran en capacidades técnicas como la fluidez y la precisión, y descuidan la codificación de las normas sociales. Algunos enfoques intentan evaluar las normas de privacidad utilizando indicaciones o conjuntos de datos específicos, pero a menudo no tienen en cuenta la sensibilidad de las indicaciones, lo que genera resultados poco confiables. Además, rara vez se consideran las variaciones en los hiperparámetros del modelo y las estrategias de optimización (como la capacidad, la alineación y la cuantificación), lo que da como resultado evaluaciones incompletas del comportamiento de los LLM. Estas limitaciones dejan un vacío en la evaluación de la alineación ética de los LLM con las normas sociales.

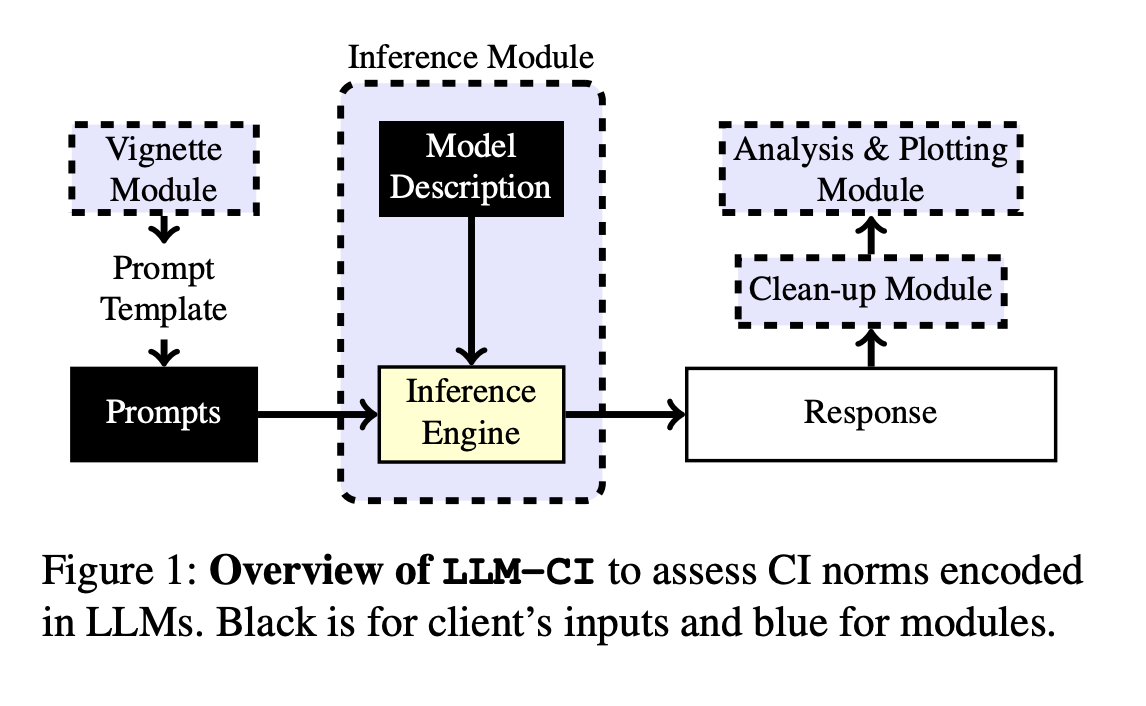

Un equipo de investigadores de la Universidad de York y la Universidad de Waterloo presenta LLM-CI, un nuevo marco basado en la teoría de la integridad contextual (CI), para evaluar cómo los LLM codifican las normas de privacidad en diferentes contextos. Emplea una estrategia de evaluación de múltiples indicaciones para mitigar la sensibilidad a las indicaciones, seleccionando indicaciones que produzcan resultados consistentes en varias variantes. Esto proporciona una evaluación más precisa de la adhesión a las normas en todos los modelos y conjuntos de datos. El enfoque también incorpora viñetas del mundo real que representan situaciones sensibles a la privacidad, lo que garantiza una evaluación exhaustiva del comportamiento del modelo en diversos escenarios. Este método es un avance significativo en la evaluación del desempeño ético de los LLM, particularmente en términos de privacidad y normas sociales.

LLM-CI se probó en conjuntos de datos como viñetas de IoT y viñetas COPPA, que simulan escenarios de privacidad del mundo real. Estos conjuntos de datos se utilizaron para evaluar cómo los modelos manejan factores contextuales como roles de usuario y tipos de información en varios contextos sensibles a la privacidad. La evaluación también examinó la influencia de los hiperparámetros (por ejemplo, la capacidad del modelo) y las técnicas de optimización (por ejemplo, la alineación y la cuantificación) en la adherencia a la norma. La metodología de múltiples indicaciones aseguró que solo se consideraran los resultados consistentes en la evaluación, lo que minimizó el efecto de la sensibilidad de las indicaciones y mejoró la solidez del análisis.

El marco LLM-CI demostró una marcada mejora en la evaluación de cómo los LLM codifican las normas de privacidad en diferentes contextos. Al aplicar la estrategia de evaluación de múltiples indicaciones, se lograron resultados más consistentes y confiables que con los métodos de una sola indicación. Los modelos optimizados mediante técnicas de alineación mostraron hasta un 92% de precisión contextual en la adhesión a las normas de privacidad. Además, el nuevo enfoque de evaluación resultó en un aumento del 15% en la consistencia de las respuestas, lo que confirma que el ajuste de las propiedades del modelo, como la capacidad, y la aplicación de estrategias de alineación mejoraron significativamente la capacidad de los LLM para alinearse con las expectativas sociales. Esto validó la solidez de LLM-CI en las evaluaciones de adhesión a las normas.

LLM-CI ofrece un enfoque integral y sólido para evaluar cómo los LLM codifican las normas de privacidad aprovechando una metodología de evaluación de múltiples indicaciones. Proporciona una evaluación confiable del comportamiento del modelo en diferentes conjuntos de datos y contextos, abordando el desafío de la sensibilidad a las indicaciones. Este método avanza significativamente en la comprensión de qué tan bien se alinean los LLM con las normas sociales, particularmente en áreas sensibles como la privacidad. Al mejorar la precisión y la consistencia de las respuestas del modelo, LLM-CI representa un paso vital hacia la implementación ética de los LLM en aplicaciones del mundo real.

Echa un vistazo a la PapelTodo el crédito por esta investigación corresponde a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de Telegram y LinkedIn Gr¡Arriba!. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa..

No olvides unirte a nuestro Subreddit con más de 50 000 millones de usuarios

Aswin AK es pasante de consultoría en MarkTechPost. Está cursando su doble titulación en el Instituto Indio de Tecnología de Kharagpur. Le apasionan la ciencia de datos y el aprendizaje automático, y cuenta con una sólida formación académica y experiencia práctica en la resolución de desafíos reales interdisciplinarios.