Los avances recientes en modelos de lenguaje grande (LLM) han demostrado capacidades excepcionales de generación y comprensión del lenguaje natural. La investigación ha explorado las habilidades inesperadas de los LLM más allá de su tarea principal de capacitación de predicción de textos. Estos modelos se han mostrado prometedores en funciones que requieren API de software, respaldadas por el lanzamiento de funciones del complemento GPT-4. Las herramientas integradas incluyen navegadores web, sistemas de traducción, seguimiento del estado de diálogo (DST) y robótica. Si bien los LLM muestran resultados prometedores en razonamiento complejo general, todavía enfrentan desafíos en la resolución de problemas matemáticos y las capacidades lógicas. Para abordar esto, los investigadores han propuesto técnicas como llamadas a funciones, que permiten a los LLM ejecutar funciones proporcionadas y utilizar sus resultados para ayudar a completar diversas tareas. Estas funciones varían desde herramientas básicas como calculadoras que realizan operaciones aritméticas hasta métodos más avanzados. Sin embargo, concentrarse en tareas específicas utilizando solo una pequeña porción de las API disponibles resalta la ineficiencia de depender únicamente de modelos grandes, que requieren una gran potencia computacional tanto para el entrenamiento como para la inferencia y debido al alto costo del entrenamiento. Esta situación exige la creación de LLM más pequeños y con tareas específicas que mantengan la funcionalidad principal y al mismo tiempo reduzcan los costos operativos. Si bien es prometedora, la tendencia hacia modelos más pequeños introduce nuevos desafíos.

Los métodos actuales implican el uso de LLM a gran escala para tareas de razonamiento, que requieren muchos recursos y son costosas. Debido a su naturaleza generalizada, estos modelos a menudo tienen dificultades para resolver problemas lógicos y matemáticos específicos.

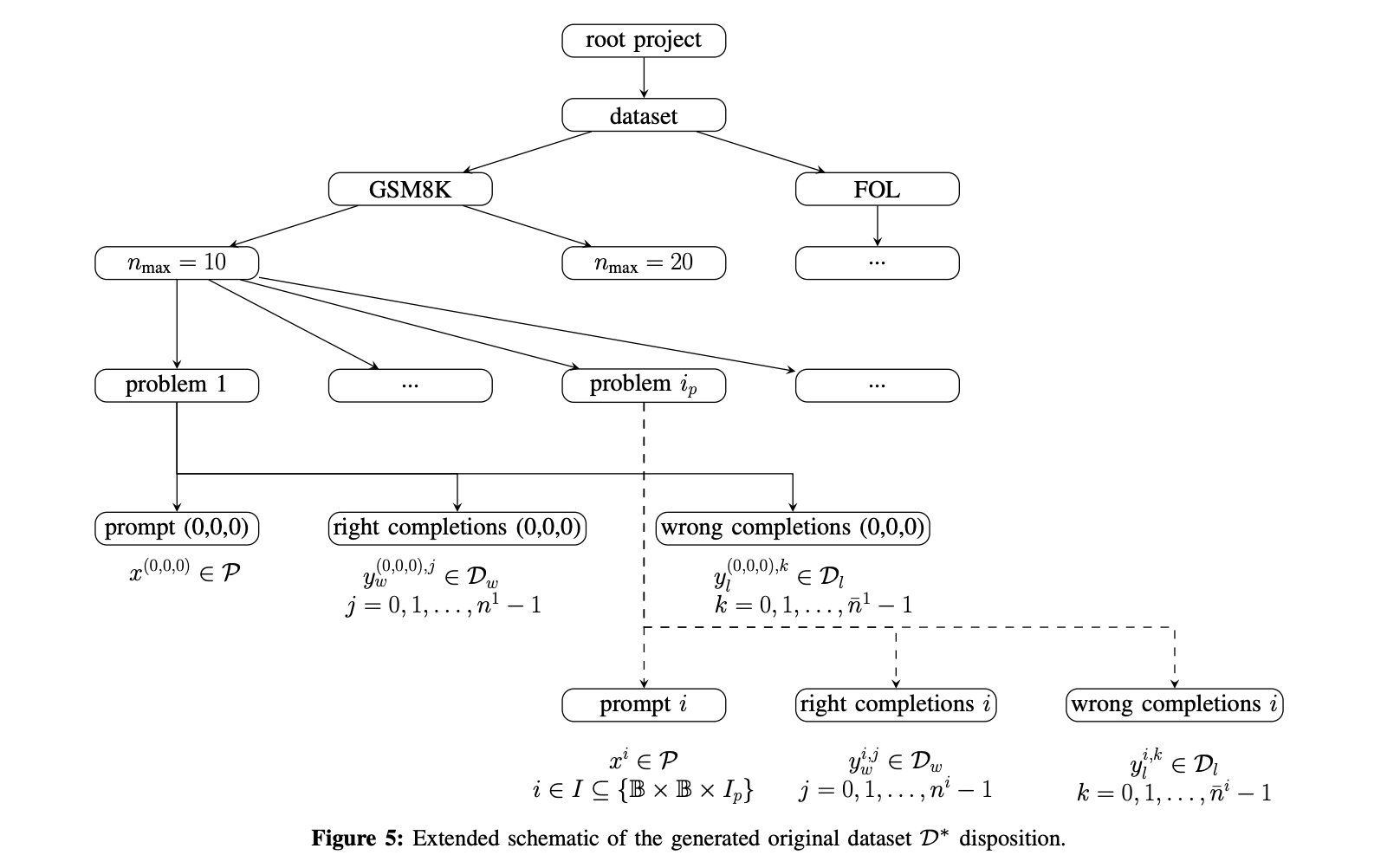

El método de investigación propuesto introduce un marco novedoso para capacitar a LLM más pequeños en llamadas a funciones, centrándose en tareas de razonamiento específicas. Este enfoque emplea un agente que consulta el LLM inyectando descripciones y ejemplos de funciones utilizables en el mensaje, creando un conjunto de datos de terminaciones de cadenas de razonamiento correctas e incorrectas.

Para abordar los inconvenientes de los LLM de gran tamaño, que incurren en costos excesivos de capacitación e inferencia, un grupo de investigadores introdujo un marco novedoso para entrenar modelos de lenguaje más pequeños a partir de las capacidades de llamada de funciones de modelos grandes para tareas específicas de razonamiento lógico y matemático. Dado un problema y un conjunto de funciones útiles para su solución, este marco involucra un agente que consulta un LLM a gran escala inyectando descripciones de funciones y ejemplos en el mensaje y administrando las llamadas a funciones adecuadas necesarias para encontrar la solución, todo en un solo paso. -Cadena de razonamiento paso a paso. Este procedimiento se utiliza para crear un conjunto de datos con terminaciones correctas e incorrectas. Luego, el conjunto de datos generado entrena un modelo más pequeño utilizando un enfoque de aprendizaje por refuerzo a partir de la retroalimentación humana (RLHF), conocido como optimización de preferencias directas (DPO). Presentamos esta metodología probada en dos tareas de razonamiento, lógica de primer orden (FOL) y matemáticas, utilizando un conjunto personalizado de problemas FOL inspirados en el conjunto de datos de HuggingFace.

El proceso del marco propuesto comprende cuatro etapas: primero, definir tareas y problemas para evaluar las habilidades de modelos de lenguaje grandes (LLM) en varios dominios de razonamiento. A continuación se configuran funciones específicas para cada tarea, permitiendo LLM para resolver pasos de razonamiento, gestionar el flujo de la cadena y verificar resultados. Luego se elige un LLM a gran escala previamente capacitado para generar un conjunto de datos de finalización correcta e incorrecta utilizando un enfoque de cadena de pensamiento. Finalmente, se afina un modelo LLM más pequeño utilizando el Optimización de políticas directas (DPO) algoritmo en el conjunto de datos creado. La experimentación implicó probar el modelo en lógica de primer orden (FOL) y problemas matemáticos, con resultados generados utilizando una biblioteca basada en agentes, Microchain, que facilita las consultas LLM con funciones predefinidas para crear un conjunto de datos de cadena de pensamiento.

Se realizó un aumento de datos para ampliar el conjunto de datos y se realizó un ajuste fino en Mistral-7B usando una sola GPU. Las métricas de rendimiento demostraron la mejora de la precisión del modelo en tareas FOL y ganancias moderadas en tareas matemáticas, con significación estadística confirmada a través de un prueba de wilcoxon.

En conclusión, los investigadores propusieron un nuevo marco para mejorar las capacidades de llamada de funciones de los LLM a pequeña escala, centrándose en tareas específicas de razonamiento lógico y matemático. Este método reduce la necesidad de modelos grandes y mejora el rendimiento en tareas lógicas y relacionadas con las matemáticas. Los resultados experimentales demuestran mejoras significativas en el rendimiento del modelo a pequeña escala en tareas FOL, logrando una precisión casi perfecta en la mayoría de los casos. En trabajos futuros, hay un gran margen para explorar la aplicación del marco introducido a una gama más amplia de tareas de razonamiento y tipos de funciones.

Mira el Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y únete a nuestro Canal de telegramas y LinkedIn Grarriba. Si te gusta nuestro trabajo, te encantará nuestro hoja informativa.. No olvides unirte a nuestro SubReddit de más de 55.000 ml.

[Trending] LLMWare presenta Model Depot: una amplia colección de modelos de lenguaje pequeño (SLM) para PC Intel

Divyesh es pasante de consultoría en Marktechpost. Está cursando un BTech en Ingeniería Agrícola y Alimentaria en el Instituto Indio de Tecnología de Kharagpur. Es un entusiasta de la ciencia de datos y el aprendizaje automático que quiere integrar estas tecnologías líderes en el ámbito agrícola y resolver desafíos.