ChatGPT y LLM similares fueron capacitados con cantidades increíbles de datos. OpenAI and Co. buscó en Internet y recopiló libros, artículos y publicaciones en redes sociales para entrenar sus modelos. Es fácil imaginar que algunos de los textos (como artículos científicos o de noticias) fueran más importantes que otros (como los Tweets aleatorios). Esto es válido para casi cualquier conjunto de datos utilizado para entrenar modelos de aprendizaje automático; casi siempre contienen muestras ruidosas, tienen etiquetas incorrectas o información engañosa.

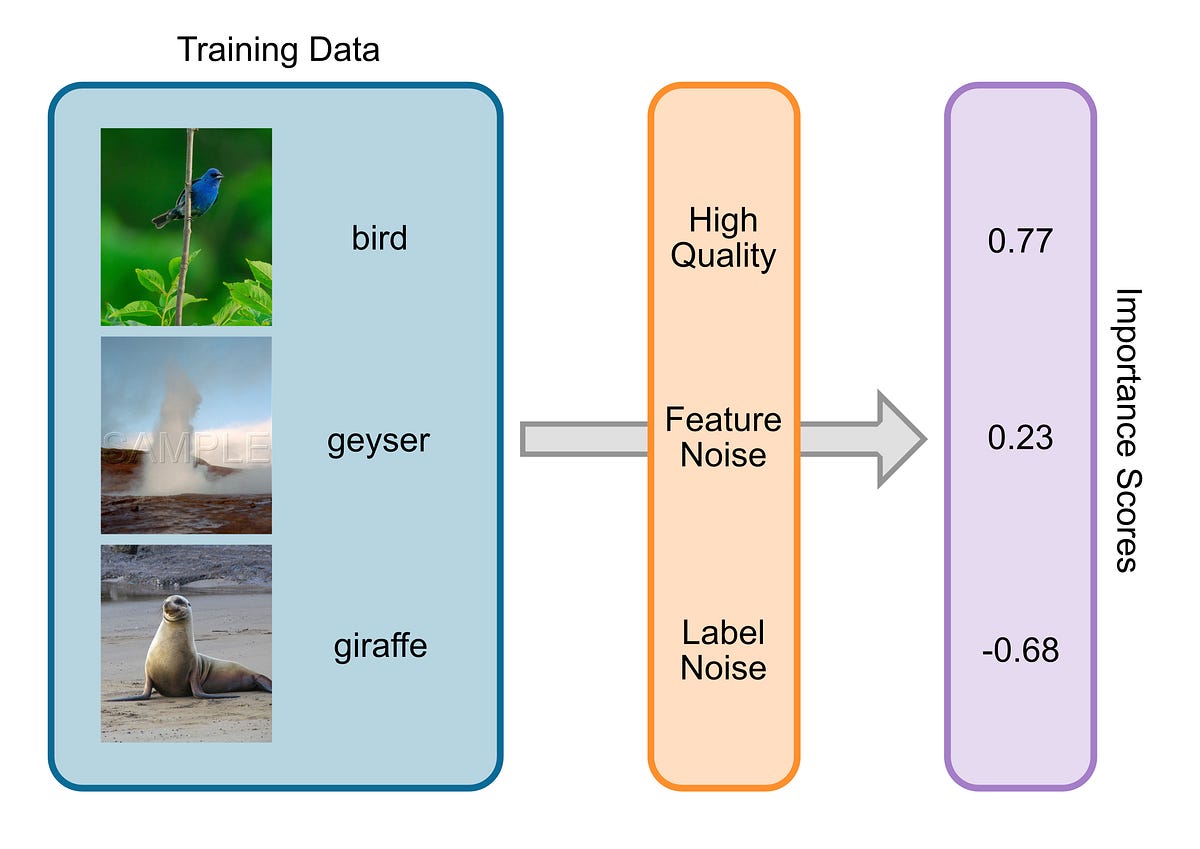

El proceso que intenta comprender qué tan importantes son las diferentes muestras de entrenamiento para el proceso de entrenamiento de un modelo de aprendizaje automático se llama Valoración de Datos. La valoración de datos también se conoce como atribución de datos, análisis de influencia de datos y puntos de representante. Existen muchos enfoques y aplicaciones diferentes, algunos de los cuales analizaré en este artículo.

Mercados de datos

La IA se convertirá en un factor económico importante en los próximos años, pero están ávidos de datos. Los datos de alta calidad son indispensables para entrenar modelos de IA, lo que los convierte en un bien valioso. Esto lleva al concepto de mercados de datos, donde compradores y vendedores pueden intercambiar datos por dinero. La valoración de datos es la base para fijar el precio de los datos, pero hay un problema: los vendedores no quieren mantener sus datos privados hasta que alguien los compre, pero para los compradores, es difícil entender qué tan importantes serán los datos de ese vendedor sin tener lo he visto. Para profundizar en este tema, considere echar un vistazo a los artículos. “Un mercado de datos: una solución algorítmica” y “Una teoría de la fijación del precio de los datos privados”.

Envenenamiento de datos

El envenenamiento de datos representa una amenaza para los modelos de IA: los malos actores podrían intentar corromper los datos de entrenamiento para dañar el proceso de entrenamiento de aprendizaje automático. Esto se puede hacer cambiando sutilmente las muestras de entrenamiento de una manera que sea invisible para los humanos, pero muy dañina para los modelos de IA. Los métodos de valoración de datos pueden contrarrestar esto porque, naturalmente, asignan una puntuación de importancia muy baja a las muestras dañinas (sin importar si ocurren de forma natural o maliciosa).

Explicabilidad

En los últimos años, la IA explicable ha ganado mucho terreno. El Grupo de Expertos de Alto Nivel en IA de la UE incluso pide que la IA sea explicable como fundamental para crear una IA confiable. Comprender la importancia de las diferentes muestras de entrenamiento para un sistema de IA o una predicción específica de un sistema de IA es importante para explicar su comportamiento.

Aprendizaje activo

Si podemos comprender mejor qué tan importantes son las muestras de entrenamiento de un modelo de aprendizaje automático, entonces podemos usar este método para adquirir nuevas muestras de entrenamiento que sean más informativas para nuestro modelo. Supongamos que está entrenando un nuevo modelo de lenguaje grande y descubre que los artículos de la página de Wikipedia en portugués son muy importantes para su LLM. Entonces el siguiente paso natural es intentar adquirir más de esos artículos para su modelo. De manera similar, utilizamos la valoración de datos en nuestro artículo sobre “PérdidaVal” Adquirir nuevos ensayos de colisión de vehículos para mejorar los sistemas de seguridad pasiva de los automóviles.

Ahora sabemos lo útil que es la valoración de datos para diferentes aplicaciones. A continuación, veremos cómo funciona la valoración de datos. Como se describe en nuestro papelLos métodos de valoración de datos se pueden dividir aproximadamente en tres ramas:

- Enfoques basados en el reciclaje

- Enfoques basados en gradientes

- Enfoques basados en datos

- “Otros”

Enfoques basados en el reciclaje

El esquema común de los enfoques basados en el reentrenamiento es que entrenan un modelo de aprendizaje automático varias veces para obtener información sobre la dinámica de entrenamiento del modelo y, en última instancia, sobre la importancia de cada muestra de entrenamiento. El enfoque más básico (que fue introducido en 1977 por Dennis Cook) simplemente vuelve a entrenar el modelo de aprendizaje automático sin un punto de datos para determinar la importancia de ese punto. Si eliminar el punto de datos disminuye el rendimiento del modelo de aprendizaje automático en un conjunto de datos de validación, entonces sabemos que el punto de datos era malo para el modelo. A la inversa, sabemos que el punto de datos fue bueno (o informativo) para el modelo si aumenta el desempeño del modelo en el conjunto de validación. Repita el reentrenamiento para cada punto de datos y obtendrá valiosas puntuaciones de importancia para su conjunto de datos completo. Este tipo de puntuación se denomina error de dejar uno fuera (LOO). Reentrenar completamente su modelo de aprendizaje automático para cada punto de datos es muy ineficiente, pero viable para modelos simples y conjuntos de datos pequeños.

Data Shapley amplía esta idea utilizando el Valor de Shapley. La idea fue publicada simultáneamente por ambos. Ghorbani y Zou y por Jia y otros. en 2019. El valor de Shapley es una construcción de la teoría de juegos que indica cuánto contribuyó cada jugador de una coalición al pago. Un ejemplo más cercano a la vida es el siguiente: imagina que compartes un taxi con tus amigos Bob y Alice de camino a casa después de una fiesta. Alice vive muy cerca de tu destino inicial, pero Bob vive mucho más lejos y tú estás en algún punto intermedio. Por supuesto, no sería justo que cada uno de ustedes pagara una parte igual del precio final, aunque usted y Bob conduzcan una distancia más larga que Alice. El valor de Shapley resuelve esto al observar todas las subcoaliciones: ¿Qué pasaría si solo usted y Alice compartieran el taxi? ¿Qué pasaría si Bob condujera solo? Etcétera. De esta manera, el valor de Shapley puede ayudarles a los tres a pagar una parte justa del precio final del taxi. Esto también se puede aplicar a los datos: volver a entrenar un modelo de aprendizaje automático en diferentes subconjuntos de datos de entrenamiento para asignar de manera justa una “importancia” a cada una de las muestras de entrenamiento. Desafortunadamente, esto es extremadamente ineficiente: calcular los valores exactos de Shapley necesitaría más que el reentrenamiento O(2ⁿ) de su modelo de aprendizaje automático. Sin embargo, Data Shapley se puede aproximar de manera mucho más eficiente utilizando los métodos de Monte Carlo.

Se han propuesto muchos métodos alternativos, por ejemplo, Datos-OOB y Efecto marginal promedio (AME). Los enfoques basados en el reentrenamiento tienen dificultades con conjuntos de entrenamiento grandes debido al reentrenamiento repetido. Las puntuaciones de importancia calculadas mediante el reentrenamiento pueden ser imprecisas debido al efecto de la aleatoriedad en las redes neuronales.

Enfoques basados en gradientes

Los enfoques basados en gradientes solo funcionan para algoritmos de aprendizaje automático basados en gradientes, como las redes neuronales artificiales o la regresión lineal y logística.

Las funciones de influencia son un elemento básico en la estadística y fueron propuesto por Dennis Cookque ya fue mencionado anteriormente. Las funciones de influencia utilizan la matriz de Hesse (o una aproximación de ella) para comprender cómo cambiaría el rendimiento del modelo si se omitiera una determinada muestra de entrenamiento. Al utilizar funciones de influencia, no es necesario volver a entrenar el modelo. Esto funciona para modelos de regresión simples, pero también para redes neuronales. Calcular funciones de influencia es bastante ineficiente, pero se han propuesto aproximaciones.

Enfoques alternativos, como Seguimiento y TRAK Realice un seguimiento de las actualizaciones de gradiente durante el entrenamiento del modelo de aprendizaje automático. Pueden utilizar con éxito esta información para comprender qué tan importante es un punto de datos para el entrenamiento sin necesidad de volver a entrenar el modelo. Similitud de gradiente es otro método que rastrea los gradientes pero los usa para comparar la similitud de los gradientes de entrenamiento y validación.

Para mi tesis de maestría, trabajé en un nuevo método de valoración de datos basado en gradientes que explota la información de gradientes en la función de pérdida, llamado PérdidaVal. Introdujimos un mecanismo de autoponderación en funciones de pérdida estándar como el error cuadrático medio y la pérdida de entropía cruzada. Esto permite asignar puntuaciones de importancia a las muestras de entrenamiento durante la primera ejecución de entrenamiento, haciendo innecesario el seguimiento de gradiente, el cálculo de la matriz de Hesse y el reentrenamiento, sin dejar de lograr resultados de última generación.

Enfoques basados en datos

Todos los métodos que mencionamos anteriormente se centran en un modelo de aprendizaje automático. Esto tiene la ventaja de que le indican cuán importantes son las muestras de capacitación para su caso de uso específico y su modelo de aprendizaje automático específico. Sin embargo, algunas aplicaciones (como Data Markets) pueden beneficiarse de “independiente del modelo” puntuaciones de importancia que no se basan en un modelo de aprendizaje automático específico, sino que se basan únicamente en los datos.

Esto se puede hacer de diferentes maneras. Por ejemplo, se puede analizar la distancia entre el conjunto de entrenamiento y un conjunto de validación limpio o utilizar un medida de volumen para cuantificar la diversidad de los datos.

“Otros”

Bajo esta categoría, incluyo todos los métodos que no encajan en las otras categorías. Por ejemplo, el uso de K-vecinos más cercanos (KNN) permite una computación más eficiente de los valores de Shapley sin necesidad de volver a capacitarse. Subredes que resultan del enmascaramiento cero se puede analizar para comprender la importancia de diferentes puntos de datos. DAVINZ Analiza el cambio en el rendimiento cuando los datos de entrenamiento cambian observando el límite de generalización. Simfluencia ejecuta ejecuciones de entrenamiento simuladas y puede estimar la importancia de cada muestra de entrenamiento en función de eso. Aprendizaje por refuerzo y algoritmos evolutivos También se puede utilizar para la valoración de datos.

Actualmente, existen algunas tendencias de investigación en diferentes direcciones. Se están realizando algunas investigaciones para acercar otros conceptos de la teoría de juegos, como el Valor de Banzhaf o el Valor de inviernoa Valoración de datos. Otros enfoques intentan crear puntuaciones de importancia conjuntas que incluyan otros aspectos del proceso de aprendizaje en la valoración, como la algoritmo de aprendizaje. Otros enfoques trabajan en privado (donde los datos no tienen que ser divulgados) y personalizado Valoración de datos (donde se utilizan metadatos para enriquecer los datos).

La valoración de datos es un tema en crecimiento; muchos otros métodos de valoración de datos no se mencionaron en este artículo. La valoración de datos es una herramienta valiosa para comprender e interpretar mejor los modelos de aprendizaje automático. Si desea obtener más información sobre la valoración de datos, puedo recomendarle los siguientes artículos: