Contribuciones de este trabajo

Este documento proporciona un análisis esclarecedor de la dinámica de entrenamiento a nivel de token y una nueva técnica llamada SLM:

Análisis de pérdida de token:

Demuestran que la mayoría de los tokens contribuyen poco más allá de la fase de entrenamiento inicial, mientras que un pequeño subconjunto permanece persistentemente de alta pérdida.

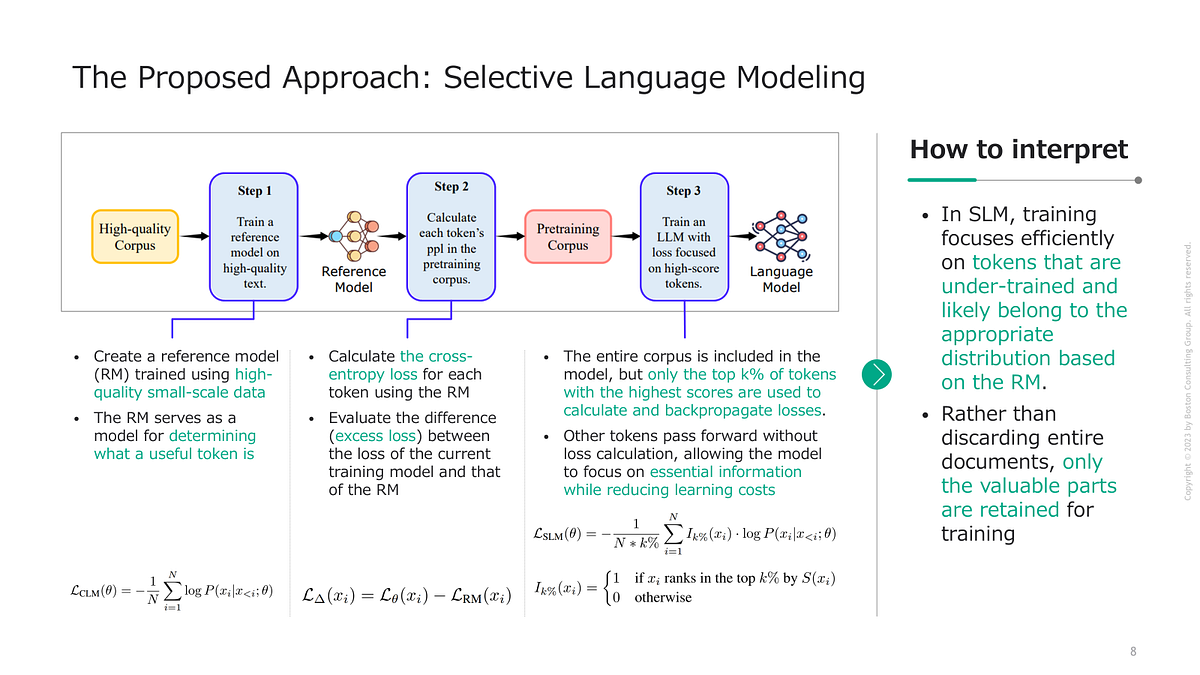

SLM para el aprendizaje enfocado:

Al aprovechar un modelo de referencia para medir cuán “útil” es cada token, logran reducir drásticamente las fichas de entrenamiento Sin sacrificar la calidad, en muchos casos, incluso aumentando el rendimiento posterior.

Amplia demostración de efectividad:

SLM funciona no solo en tareas específicas de matemáticas sino también en dominios más generales, ya sea un conjunto de datos de referencia meticulosamente seleccionado o un modelo de referencia extraído del mismo gran corpus.

¿A dónde podría ir esto después?

SLM abarca varias direcciones potenciales para futuras investigaciones. Por ejemplo:

Ampliando más a fondo:

Aunque el documento se centra principalmente en modelos de alrededor de 1B a 7B de parámetros, sigue habiendo una cuestión abierta de cómo se desempeña SLM en la escala 30B, 70B o 100B+. Si el enfoque de nivel de token se generaliza bien, los ahorros de costos podrían ser enormes para LLM verdaderamente masivos.

Modelos de referencia a través de API:

Si no puede recopilar datos curados, tal vez podría usar un modelo de lenguaje basado en API como referencia. Eso podría hacer que SLM sea más práctico para los equipos de investigación más pequeños que carecen de los recursos para la capacitación de referencia selectiva.

Extensiones de aprendizaje de refuerzo:

Imagine acoplar SLM con aprendizaje de refuerzo. El modelo de referencia podría actuar como un “modelo de recompensa”, y la selección de tokens podría optimizarse a través de algo similar a los gradientes de políticas.

Modelos de referencia múltiples:

En lugar de un solo RM, podría entrenar o reunir varioscada uno enfocándose en un dominio o estilo diferente. Luego, combine sus puntajes de token para producir un sistema de filtrado de dominios múltiples más robusto.

Alineación y seguridad:

Hay una tendencia creciente hacia el factorización en la alineación o la veracidad. Uno podría capacitar a un modelo de referencia para dar puntajes más altos a declaraciones bien soportadas y tokens de cero que parecen fácticamente incorrectos o dañinos.