El razonamiento matemático ha presentado durante mucho tiempo un desafío formidable para la IA, exigiendo no solo una comprensión de los conceptos abstractos sino también la capacidad de realizar deducciones lógicas de varios pasos con precisión. Los modelos de lenguaje tradicional, mientras están expertos en generar texto fluido, a menudo luchan cuando se les encarga a resolver problemas matemáticos complejos que requieren un conocimiento de dominio profundo y un razonamiento estructurado. Esta brecha ha impulsado la investigación hacia arquitecturas especializadas y regímenes de capacitación diseñados para imbuir modelos con capacidades matemáticas robustas. Al centrarse en conjuntos de datos específicos y estrategias de ajuste fino, los desarrolladores de IA tienen como objetivo cerrar la brecha entre la comprensión del lenguaje natural y la resolución de problemas matemáticos formales.

Nvidia ha introducido OpenMath-Nemotron-32b y OpenMath-Nemotron-14b-kagglecada uno meticulosamente diseñado para sobresalir en tareas de razonamiento matemático. Sobre la base del éxito de la familia Qwen de modelos de transformadores, estas variantes de nemotron utilizan ajustes finos a gran escala en un extenso corpus de problemas matemáticos, conocidos colectivamente como el conjunto de datos de condición abierta. La filosofía de diseño subyacente a ambas liberaciones se centra en maximizar la precisión en puntos de referencia competitivos al tiempo que mantiene consideraciones prácticas para la velocidad de inferencia y la eficiencia de los recursos. Al ofrecer múltiples tamaños y configuraciones de modelos, NVIDIA proporciona a los investigadores y profesionales un conjunto de herramientas flexible para integrar capacidades de matemáticas avanzadas en diversas aplicaciones.

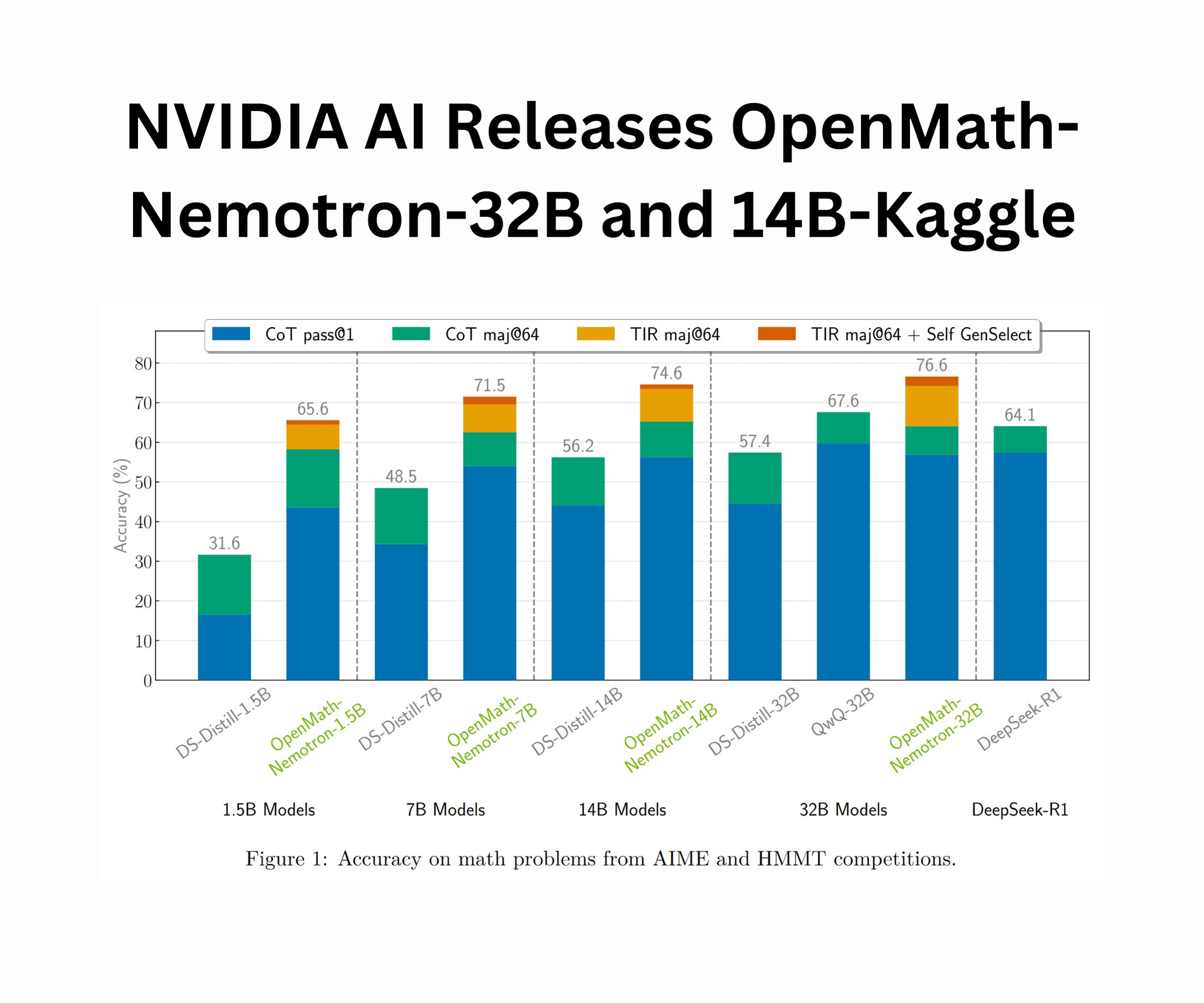

OpenMath-Nemotron-32b representa el buque insignia de esta serie, con 32.8 mil millones de parámetros y aprovechando las operaciones de tensor BF16 para una utilización eficiente de hardware. Está construido por Qwen2.5-32b en el conjunto de datos OpenMathRasoning, una colección seleccionada que enfatiza problemas desafiantes extraídos de las olímpías matemáticas y los exámenes estandarizados. Este modelo logra resultados de última generación en varios puntos de referencia rigurosos, incluido el American Invitational Mathematics Examination (AIME) 2024 y 2025, la Harvard-Mit Mathematics Tournament (HMMT) 2024-25 y la serie Harvard-London-Edinburgh Mathematics Exam (Hle-Math). En su configuración de razonamiento integrado de herramientas (TIR), OpenMath-Nemotron-32b logra un puntaje promedio de pase@1 de 78.4 por ciento en AIME24, con una precisión de 93.3 por ciento de votación de la mayoría, superando los modelos de rendimiento superior anteriores mediante márgenes notables.

Para acomodar diferentes escenarios de inferencia, OpenMath-Nemotron-32b admite tres modos distintos: cadena de pensamiento (COT), razonamiento integrado en herramientas (TIR) y selección de soluciones generativas (Genselect). En el modo COT, el modelo genera pasos de razonamiento intermedio antes de presentar una respuesta final, logrando una precisión de pase@1 del 76.5% en AIME24. Cuando se aumenta con Genselect, que produce múltiples soluciones candidatas y selecciona la respuesta más consistente, el rendimiento del modelo mejora aún más, logrando una notable precisión del 93.3% en el mismo punto de referencia. Estas configuraciones permiten a los usuarios equilibrar entre la riqueza de explicación y la precisión de la respuesta, atendiendo a entornos de investigación que requieren transparencia y configuraciones de producción que priorizan la velocidad y la confiabilidad.

Complementando la variante de 32 mil millones de parámetros, NVIDIA también ha lanzado OpenMath-Nemotron-14b-Kaggle, un modelo de 14.8 mil millones de parámetros ajustados en un subconjunto estratégicamente seleccionado del conjunto de datos OpenMathRonsioning para optimizar el rendimiento competitivo. Esta versión sirvió como la piedra angular de la solución de primer lugar de Nvidia en la competencia Auto-2 Kaggle, un concurso que se centró en técnicas automatizadas de resolución de problemas para desafíos matemáticos avanzados. Al calibrar los datos de entrenamiento para enfatizar los problemas que reflejan el formato y la dificultad de la competencia, el modelo 14b-kaggle demostró una adaptabilidad excepcional, superando los enfoques rivales y asegurando la posición superior de la tabla de clasificación.

Los puntos de referencia de rendimiento para OpenMath-Nemotron-14b-kaggle reflejan los de su contraparte más grande, con el modelo logrando una precisión Pass@1 de 73.7% en AIME24 en modo COT y mejorando al 86.7% bajo protocolos Genselect. En el punto de referencia AIME25, logra una tasa de aprobación del 57.9 por ciento (mayoría a 64 de 73.3 por ciento), y en HMMT-24-25, alcanza el 50.5 por ciento (mayoría a 64 de 64.8 por ciento). Estas cifras destacan la capacidad del modelo para ofrecer soluciones de alta calidad, incluso con una huella de parámetros más compacta, lo que lo hace bien adecuado para escenarios donde las limitaciones de recursos o la latencia de inferencia son factores críticos.

Ambos modelos OpenMath-Nemotron van acompañados de una tubería de origen abierto, lo que permite la reproducibilidad total de la generación de datos, los procedimientos de capacitación y los protocolos de evaluación. NVIDIA ha integrado estos flujos de trabajo en su marco Nemo-Skills, proporcionando implementaciones de referencia para modos de inferencia COT, TIR y Genselect. Con fragmentos de código de ejemplo que demuestran cómo instanciar una tubería de transformador, configurar Dtype y Mapeo de dispositivos, y salidas del modelo de análisis, los desarrolladores pueden prototipos rápidamente de aplicaciones que consultan estos modelos para soluciones paso a paso o respuestas finales optimizadas.

Bajo el capó, ambos modelos están optimizados para funcionar de manera eficiente en las arquitecturas de GPU NVIDIA, que van desde el amperio hasta las microarquitecturas de la tolva, aprovechando las bibliotecas CUDA altamente sintonizadas y las optimizaciones de tensor. Para las implementaciones de producción, los usuarios pueden servir modelos a través del servidor de inferencia de Triton, lo que permite integraciones de baja latencia y alto rendimiento en servicios web o tuberías de procesamiento por lotes. La adopción de formatos de tensor BF16 entra en un equilibrio ideal entre la precisión numérica y la huella de memoria, lo que permite que estos modelos a gran escala se ajusten dentro de las limitaciones de memoria de GPU mientras mantienen un rendimiento robusto en varias plataformas de hardware.

Varias conclusiones clave del lanzamiento de OpenMath-Nemotron-32b y OpenMath-Nemotron-14b-Kaggle incluyen:

- La serie OpenMath-Nemotron de NVIDIA aborda el desafío de larga data de equipar modelos de idiomas con un razonamiento matemático robusto a través del ajuste fino objetivo en el conjunto de datos OpenMathRasoning.

- La variante de 32 parámetros B logra la precisión de última generación en puntos de referencia como AIME24/25 y HMMT, que ofrece tres modos de inferencia (Cot, TIR, Genselect) para equilibrar la riqueza y la precisión de explicación.

- El modelo de 14 parámetros B “Kaggle”, ajustado en un subconjunto centrado en la competencia, aseguró el primer lugar en la competencia Auto-2 Kaggle mientras mantiene puntajes de pase@1 alto, lo que demuestra eficiencia en una huella más pequeña.

- Ambos modelos son completamente reproducibles a través de una tubería de código abierto integrada en el marco Nemo-Skills de NVIDIA, con implementaciones de referencia para todos los modos de inferencia.

- Optimizado para las GPU NVIDIA (Ampere y Hopper), los modelos aprovechan las operaciones de tensor BF16, las bibliotecas CUDA, Tensorrt y Triton Inference Server para implementaciones de bajo rendimiento de baja latencia.

- Las aplicaciones potenciales incluyen sistemas de tutoría impulsados por la IA, herramientas de preparación de competencia académica e integración en flujos de trabajo de computación científica que requieren razonamiento formal o simbólico.

- Las direcciones futuras pueden expandirse a las matemáticas avanzadas a nivel universitario, las entradas multimodales (por ejemplo, las ecuaciones escritas a mano) e integración más estrecha con motores de cálculo simbólicos para verificar y aumentar las soluciones generadas.

Mira el OpenMath-Nemotron-32b y OpenMath-Nemotron-14b-kaggle. Además, no olvides seguirnos Gorjeo y únete a nuestro Canal de telegrama y LinkedIn GRsalpicar. No olvides unirte a nuestro 90k+ ml de subreddit.

Asif Razzaq es el CEO de MarktechPost Media Inc .. Como empresario e ingeniero visionario, ASIF se compromete a aprovechar el potencial de la inteligencia artificial para el bien social. Su esfuerzo más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, MarktechPost, que se destaca por su cobertura profunda de noticias de aprendizaje automático y de aprendizaje profundo que es técnicamente sólido y fácilmente comprensible por una audiencia amplia. La plataforma cuenta con más de 2 millones de vistas mensuales, ilustrando su popularidad entre el público.