La detección de fraude sigue siendo un desafío significativo en la industria financiera, lo que requiere técnicas de aprendizaje automático avanzado (ML) para detectar patrones fraudulentos mientras mantiene el cumplimiento de estrictas regulaciones de privacidad. Los modelos ML tradicionales a menudo dependen de la agregación de datos centralizados, lo que plantea preocupaciones sobre la seguridad de los datos y las limitaciones regulatorias.

El fraude costó a las empresas más de $ 485.6 mil millones en 2023 solo, según Informe de delitos financieros globales de NASDAQcon instituciones financieras bajo presión para mantenerse al día con las amenazas en evolución. Los modelos de fraude tradicionales a menudo dependen de datos aislados, lo que lleva a exagerado y pobre rendimiento del mundo real. Las leyes de privacidad de datos como GDPR y CCPA limitan la colaboración. Con aprendizaje federado usando Amazon Sagemaker AIlas organizaciones pueden capacitar conjuntamente modelos sin compartir datos sin procesar, lo que aumenta la precisión mientras mantiene el cumplimiento.

En esta publicación, exploramos cómo Sagemaker y Federated Learning ayudan a las instituciones financieras a construir sistemas escalables y de detección de fraude de privacidad.

Aprendizaje federado con el marco de flores en Sagemaker AI

Con el aprendizaje federado, múltiples instituciones pueden capacitar a un modelo compartido mientras mantienen sus datos descentralizados, abordando las preocupaciones de privacidad y seguridad en la detección de fraude. Una ventaja clave de este enfoque es que mitiga el riesgo de sobreajustar al aprender de una distribución más amplia de patrones de fraude en varios conjuntos de datos. Permite que las instituciones financieras colaboren mientras mantienen una estricta privacidad de datos, asegurándose de que ninguna entidad única tenga acceso a los datos sin procesar de otro. Esto no solo mejora la precisión de la detección de fraude, sino que también se adhiere a las regulaciones de la industria y los requisitos de cumplimiento.

Los marcos populares para el aprendizaje federado incluyen flores, pysyft, tensorflow federated TFF y FEDML. Entre estos, el Marco de flores se destaca por ser el marco-agnóstico, una ventaja clave que le permite integrarse perfectamente con una amplia gama de herramientas como Pytorch, Tensorflow, abrazando la cara, Scikit-Learn y más.

Aunque Sagemaker es poderoso para los flujos de trabajo ML centralizados, la flor está diseñada especialmente para el entrenamiento de modelos descentralizado, lo que permite una colaboración segura entre los silos de datos sin exponer datos sin procesar. Cuando se implementa en Sagemaker, Flower aprovecha la escalabilidad y la automatización del sistema en la nube al tiempo que permite flujos de trabajo de aprendizaje federados flexibles y que preservan la privacidad. Esta combinación mejora el tiempo de producción, reduce la complejidad de la ingeniería y respalda la estricta gobernanza de datos, lo que lo hace altamente adecuado para entornos interinstitucionales o regulados.

Generación de datos sintéticos con bóveda de datos sintéticos

Para fortalecer la detección de fraude al preservar la privacidad de los datos, las organizaciones pueden usar el Vault de datos sintéticos (SDV)una biblioteca de Python que genera conjuntos de datos sintéticos realistas que reflejan patrones del mundo real. Los equipos pueden usar SDV para simular diversos escenarios de fraude sin exponer información confidencial, ayudando a los modelos de aprendizaje federado a generalizar mejor y detectar tácticas sutiles y en evolución de fraude. También ayuda a abordar el desequilibrio de datos amplificando los casos de fraude subrepresentados, mejorando la precisión del modelo y la robustez.

Más allá de la generación de datos, SDV captura relaciones estadísticas complejas y acelera el desarrollo del modelo al reducir la dependencia de los datos marcados costosos de Obtain. En nuestro enfoque, los datos sintéticos se usan principalmente como un conjunto de datos de validación, que respalda la privacidad y la consistencia en los entornos, y los conjuntos de datos de capacitación pueden ser reales o sintéticos dependiendo de los requisitos de auditoría y cumplimiento. Esta flexibilidad respalda los principios de privacidad por diseño al tiempo que mantiene la adaptabilidad en entornos regulados.

Un enfoque de evaluación justa para los modelos de aprendizaje federado

Un aspecto crítico del aprendizaje federado es facilitar una evaluación justa e imparcial de los modelos capacitados. Para lograr esto, las organizaciones deben adoptar una estrategia de conjunto de datos estructurada. Como se ilustra en la siguiente figura, el conjunto de datos A y el conjunto de datos B se utilizan como conjuntos de datos de capacitación separados, y cada institución participante contribuye a distintos conjuntos de datos que capturan diferentes patrones de fraude. En lugar de evaluar el modelo usando solo un conjunto de datos, se utiliza un conjunto de datos combinado de A y B para la evaluación. Esto asegura que el modelo se pruebe en una distribución más completa de los casos de fraude del mundo real, ayudando a reducir el sesgo y mejorar la equidad en la evaluación.

Al adoptar este método de evaluación, las organizaciones pueden validar la capacidad del modelo para generalizar en diferentes distribuciones de datos. Este enfoque asegura que los modelos de detección de fraude no dependan demasiado de los datos de una sola institución, lo que mejora la robustez contra las tácticas de fraude en evolución. Métricas de evaluación estándar como precisión, recuerdo, puntaje F1 y AUC-ROC se utilizan para medir el rendimiento del modelo. En el sector de seguros, se presta especial atención a falsos negativos, casos donde se pierden reclamos fraudulentos, porque estos se traducen directamente en pérdidas financieras. Minimizar los falsos negativos es fundamental para proteger contra el fraude no detectado, al tiempo que se asegura de que el modelo funcione de manera consistente y de manera justa en diversos conjuntos de datos en un entorno de aprendizaje federado.

Descripción general de la solución

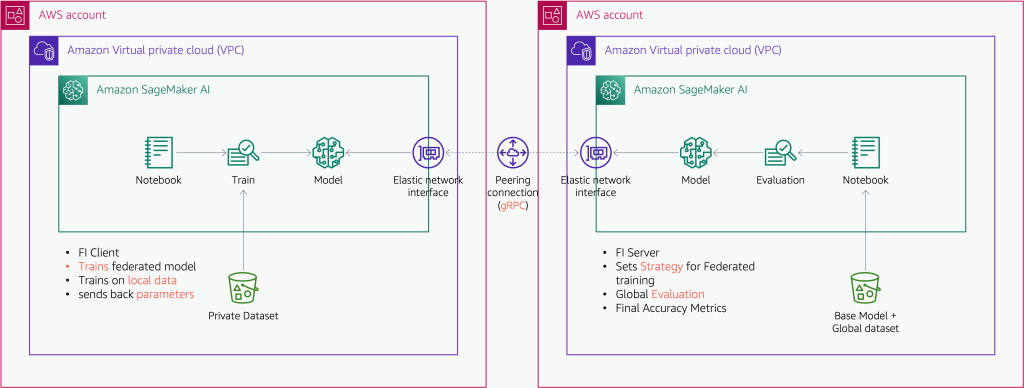

El siguiente diagrama ilustra cómo implementamos este enfoque en dos cuentas de AWS utilizando Sagemaker AI y Cross-Concent Virtual Private Cloud (VPC).

Flower admite una amplia gama de marcos ML, que incluyen Pytorch, TensorFlow, Hugging Face, Jax, Pandas, Fast.Ai, Pytorch Lightning, MXNet, Scikit-Learn y Xgboost. Al implementar el aprendizaje federado en Sagemaker, Flower permite una configuración distribuida donde múltiples instituciones pueden capacitar a los modelos en colaboración mientras mantienen los datos privados. Cada participante capacita a un modelo local en su propio conjunto de datos y solo comparte actualizaciones del modelo, no datos sin procesar, con un servidor central. Sagemaker orquesta el proceso completo de capacitación, validación y evaluación de forma segura y eficiente. El modelo final sigue siendo consistente con el marco original, lo que lo hace desplegar para un punto final de Sagemaker utilizando su contenedor de marco compatible.

Para facilitar una implementación suave y escalable, Sagemaker AI proporciona características incorporadas para orquestación modelo, ajuste de hiperparámetros y monitoreo automatizado. Las instituciones pueden mejorar continuamente sus modelos basados en los últimos patrones de fraude sin requerir actualizaciones manuales. Además, la integración de Sagemaker AI con servicios de AWS como Gestión de identidad y acceso de AWS (IAM) mejora la seguridad y el cumplimiento.

Para obtener más información, consulte el Taller de aprendizaje federado de floresque proporciona orientación detallada sobre la configuración y la ejecución de cargas de trabajo de aprendizaje federado de manera efectiva. Al integrar el aprendizaje federado, la generación de datos sintéticos y las estrategias de evaluación estructuradas, puede desarrollar sistemas de detección de fraude robustos que sean escalables y que se conservan la privacidad.

Resultados y conclusiones clave

La implementación del aprendizaje federado para la detección de fraude ha demostrado mejoras significativas en el rendimiento del modelo y la precisión de la detección de fraude. Al entrenar en diversos conjuntos de datos, el modelo captura una gama más amplia de patrones de fraude, ayudando a reducir el sesgo y el sobreajuste. La incorporación de conjuntos de datos generados por SDV facilita un proceso de capacitación completo, mejorando la generalización en escenarios de fraude del mundo real. El marco de aprendizaje federado en Sagemaker permite a las organizaciones escalar sus modelos de detección de fraude mientras mantienen el cumplimiento de las regulaciones de privacidad de datos.

A través de este enfoque, las organizaciones han observado una reducción en los falsos positivos, ayudando a los analistas de fraude a centrarse en las transacciones de alto riesgo de manera más efectiva. La capacidad de entrenar modelos en una gama más amplia de patrones de fraude en múltiples instituciones ha llevado a un sistema de detección de fraude más integral y preciso. Las optimizaciones futuras pueden incluir la refinación de las técnicas de datos sintéticos y la expansión de la participación del aprendizaje federado para mejorar aún más las capacidades de detección de fraude.

Conclusión

El marco de las flores proporciona un enfoque escalable y preservante de la privacidad para la detección de fraude mediante el uso de aprendizaje federado en Sagemaker AI. Al combinar la capacitación descentralizada, la generación de datos sintéticos y las estrategias de evaluación justa, las instituciones financieras pueden mejorar la precisión del modelo mientras mantienen el cumplimiento de las regulaciones. Shin Kong Financial Holding y SHIN KONG VIDA adoptó con éxito este enfoque, como se destacó en su publicación de blog oficial. Esta metodología establece un nuevo estándar para aplicaciones de seguridad financiera, allanando el camino para una adopción más amplia del aprendizaje federado.

Aunque el uso de Flower en Sagemaker para el aprendizaje federado ofrece fuertes beneficios de privacidad y escalabilidad, hay algunas limitaciones a considerar. Técnicamente, la gestión de la heterogeneidad entre los clientes (como diferentes esquemas de datos, capacidades de cálculo o arquitecturas de modelos) puede ser complejo. Desde la perspectiva del caso de uso, el aprendizaje federado podría no ser ideal para escenarios que requieran inferencia en tiempo real o actualizaciones altamente sincrónicas, y depende de la conectividad estable entre los nodos participantes. Para abordar estos desafíos, las organizaciones están explorando el uso de conjuntos de datos sintéticos de alta calidad que preservan las distribuciones de datos al tiempo que protegen la privacidad, mejoran la generalización del modelo y la robustez. Los próximos pasos incluyen experimentar con estos conjuntos de datos, utilizando el Taller de aprendizaje federado de flores Para una guía práctica, revisar la arquitectura del sistema para una comprensión más profunda e interactuar con el equipo de cuentas de AWS para adaptar y escalar su solución de aprendizaje federado.

Sobre los autores

Ray Wang es un arquitecto de soluciones senior en AWS. Con 12 años de experiencia en el backend y el consultor, Ray se dedica a construir soluciones modernas en la nube, especialmente en NovesqL, Big Data, Aprendizaje automático e IA generativa. Como un getter hambriento, pasó los 12 certificados de AWS para aumentar la amplitud y profundidad de su conocimiento técnico. Le encanta leer y ver películas de ciencia ficción en su tiempo libre.

Kanwaljit Khurmi es un arquitecto principal de soluciones en Amazon Web Services. Trabaja con clientes de AWS para proporcionar orientación y asistencia técnica, ayudándoles a mejorar el valor de sus soluciones cuando usan AWS. Kanwaljit se especializa en ayudar a los clientes con aplicaciones en contenedores y de aprendizaje automático.

James Chan es arquitecto de soluciones en AWS especializado en la industria de servicios financieros (FSI). Con una amplia experiencia en servicios financieros, fintech y sectores de fabricación, James ayuda a los clientes de FSI en AWS innovar y construir soluciones escalables en la nube y arquitecturas de sistemas financieros. James se especializa en contenedores de AWS, arquitectura de red y soluciones generativas de IA que combinan tecnologías nativas de nube con estrictos requisitos de cumplimiento financiero.

Mike Xu es un arquitecto asociado de soluciones especializado en IA/ML en Amazon Web Services. Trabaja con los clientes para diseñar soluciones de aprendizaje automático utilizando servicios como Amazon Sagemaker y Amazon Bedrock. Con experiencia en ingeniería informática y pasión por la IA generativa, Mike se enfoca en ayudar a las organizaciones a acelerar su viaje de IA/ML en la nube. Fuera del trabajo, le gusta producir música electrónica y explorar la tecnología emergente.