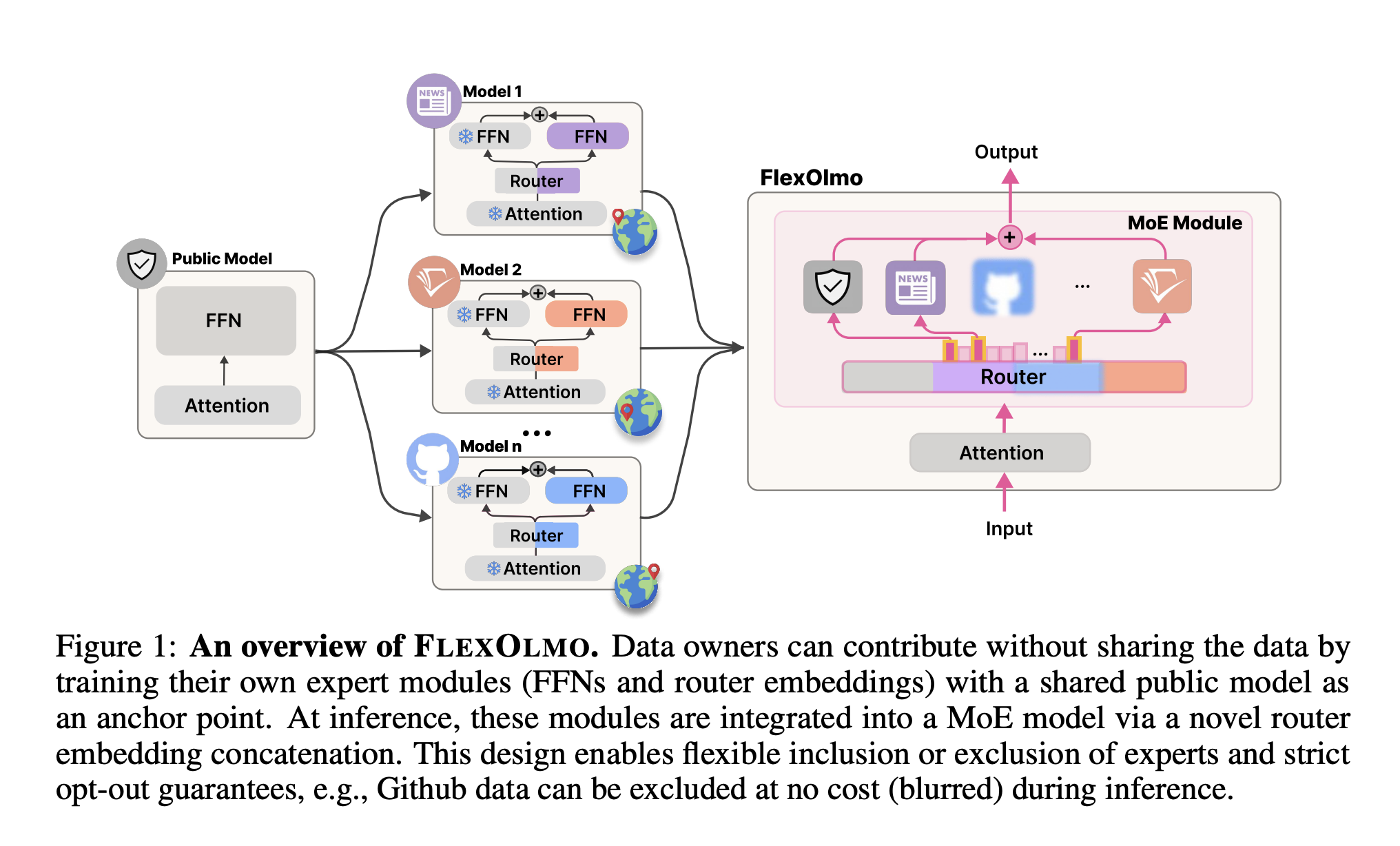

El desarrollo de modelos de lenguaje a gran escala (LLMS) ha requerido históricamente el acceso centralizado a extensos conjuntos de datos, muchos de los cuales son sensibles, con derechos de autor o gobernados por restricciones de uso. Esta restricción limita severamente la participación de organizaciones ricas en datos que operan en entornos regulados o patentados. Flexolmo, incluido por investigadores del Instituto Allen para AI y colaboradores, proporciona un marco modular de capacitación e inferencia que permite el desarrollo de LLM bajo las restricciones de gobernanza de datos.

LLMS actual … ..

Las tuberías de entrenamiento de LLM actuales se basan en agregar todos los datos de entrenamiento en un solo corpus, lo que impone una decisión de inclusión estática y elimina la posibilidad de excluir el entrenamiento posterior. Este enfoque es incompatible con:

- Regímenes regulatorios (por ejemplo, HIPAA, GDPR, leyes de soberanía de datos),

- Conjuntos de datos vinculados a la licencia (por ejemplo, no comercial o restringido por atribución),

- Datos sensibles al contexto (por ejemplo, código fuente interno, registros clínicos).

Flexolmo aborda dos objetivos:

- Entrenamiento descentralizado y modular: Permitir módulos capacitados de forma independiente en conjuntos de datos disjuntos y locales.

- Flexibilidad de tiempo de inferencia: Habilite mecanismos deterministas de opción/exclusión para las contribuciones del conjunto de datos sin capacitación.

Arquitectura del modelo: modularidad experta a través de la mezcla de expertos (MOE)

Flexolmo se basa en una arquitectura de mezcla de expertos (MOE) donde cada experto corresponde a un módulo de red de avance (FFN) entrenado de forma independiente. Un modelo público fijo (denotado como M Pub ) sirve como el ancla compartida. Cada propietario de datos capacita a un experto M I utilizando su conjunto de datos privado D I , mientras que todas las capas de atención y otros parámetros no expertos permanecen congelados.

Componentes arquitectónicos clave:

- Activación escasa: Solo se activa un subconjunto de módulos expertos por token de entrada.

- Enrutamiento de expertos: La asignación de token a experto se rige por una matriz de enrutadores derivada de incrustaciones basadas en el dominio, eliminando la necesidad de capacitación conjunta.

- Regularización de sesgo: Se introduce un término de sesgo negativo para calibrar la selección de expertos entrenados independientemente, evitando la selección excesiva de cualquier experto.

Este diseño mantiene la interoperabilidad entre los módulos al tiempo que permite la inclusión selectiva durante la inferencia.

Optimización asincrónica y aislada

Cada experto M I está capacitado a través de un procedimiento restringido para garantizar la alineación con M Pub . Específicamente:

- El entrenamiento se realiza en una instancia de MOE híbrida que comprende M I y M Pub .

- Las capas de atención experta y compartida M Pub están congeladas.

- Solo se actualizan los FFNS correspondientes a M I y las incrustaciones del enrutador R I .

Para inicializar R I , un conjunto de muestras de D I está incrustada usando un codificador previamente practicado, y su promedio forma la incrustación del enrutador. El ajuste opcional del enrutador liviano puede mejorar aún más el rendimiento utilizando datos proxy del corpus público.

Construcción del conjunto de datos: FlexMix

El corpus de entrenamiento, FlexMix, se divide en:

- A mezcla públicacompuesto por datos web de uso general.

- Siete juegos cerrados Simulando dominios no variable: noticias, reddit, código, texto académico, texto educativo, escritura creativa y matemáticas.

Cada experto está capacitado en un subconjunto disjunto, sin acceso a datos conjuntos. Esta configuración se aproxima al uso del mundo real donde las organizaciones no pueden agrupar los datos debido a limitaciones legales, éticas u operativas.

Evaluación y comparaciones de referencia

Flexolmo se evaluó en 31 tareas de referencia en 10 categorías, incluida la comprensión general del lenguaje (p. Ej., MMLU, Agieval), QA generativo (p. Ej.

Los métodos de referencia incluyen:

- Sopa modelo: Promedio de pesos de modelos individualmente ajustados.

- Rama de la rama (BTM): Conjunto ponderado de las probabilidades de salida.

- Btx: Convertir modelos densos entrenados de forma independiente en un MOE a través del trasplante de parámetros.

- Enrutamiento basado en aviso: Uso de clasificadores ajustados a instrucciones para enrutar consultas a expertos.

En comparación con estos métodos, Flexolmo logra:

- A 41% de mejora relativa promedio sobre el modelo público base.

- A 10.1% de mejora sobre la línea de base de fusión más fuerte (BTM).

Las ganancias son especialmente notables en las tareas alineadas con los dominios cerrados, lo que confirma la utilidad de expertos especializados.

Análisis arquitectónico

Varios experimentos controlados revelan la contribución de las decisiones arquitectónicas:

- Eliminar la coordinación pública experta durante la capacitación degrada significativamente el rendimiento.

- Los incrustaciones de enrutadores inicializados aleatoriamente reducen la separabilidad entre expertos.

- Deshabilitar el término de sesgo sesga la selección de expertos, particularmente al fusionar más de dos expertos.

Los patrones de enrutamiento a nivel de token muestran especialización de expertos en capas específicas. Por ejemplo, la entrada matemática activa al experto en matemáticas en capas más profundas, mientras que los tokens introductorios dependen del modelo público. Este comportamiento subraya la expresividad del modelo en comparación con las estrategias de enrutamiento de un solo experto.

Exclusión por no participar y gobernanza de datos

Una característica clave de Flexolmo es Capacidad de exclusión determinista. Eliminar un experto de la matriz del enrutador elimina completamente su influencia en el momento de la inferencia. Los experimentos muestran que eliminar al experto en noticias reduce el rendimiento en Newsg, pero deja otras tareas no afectadas, confirmando la influencia localizada de cada experto.

Consideraciones de privacidad

Los riesgos de extracción de datos de entrenamiento se evaluaron utilizando métodos de ataque conocidos. Los resultados indican:

- Tasa de extracción de 0.1% para un modelo solo público.

- 1.6% para un modelo denso entrenado en el conjunto de datos de matemáticas.

- 0.7% para Flexolmo con el experto en matemáticas incluido.

Si bien estas tasas son bajas, la capacitación de privacidad diferencial (DP) se puede aplicar de forma independiente a cada experto para garantías más fuertes. La arquitectura no impide el uso de DP o métodos de entrenamiento cifrados.

Escalabilidad

La metodología FlexolMo se aplicó a una línea de base fuerte existente (OLMO-2 7B), previamente en tokens 4T. Incorporando dos expertos adicionales (matemáticas, código) mejoró el rendimiento de referencia promedio de 49.8 a 52.8, sin reentrenar el modelo central. Esto demuestra escalabilidad y compatibilidad con las tuberías de entrenamiento existentes.

Conclusión

Flexolmo presenta un marco de principios para construir LLM modulares bajo restricciones de gobernanza de datos. Su diseño admite capacitación distribuida en conjuntos de datos mantenidos localmente y permite la inclusión/exclusión de la influencia de datos de influencia. Los resultados empíricos confirman su competitividad contra las líneas de base monolíticas y basadas en el conjunto.

La arquitectura es particularmente aplicable a los entornos con:

- Requisitos de localidad de datos,

- Políticas de uso de datos dinámicos,

- Restricciones de cumplimiento regulatorio.

Flexolmo proporciona una vía viable para construir modelos de lenguaje performre mientras se adhiere a los límites de acceso a datos del mundo real.

Mira el Papel, Modelo en la cara abrazada y Codos. Todo el crédito por esta investigación va a los investigadores de este proyecto.

Oportunidad de patrocinio: Llegue a los desarrolladores de IA más influyentes en Estados Unidos y Europa. 1M+ lectores mensuales, 500k+ constructores comunitarios, infinitas posibilidades. [Explore Sponsorship]

Asif Razzaq es el CEO de MarktechPost Media Inc .. Como empresario e ingeniero visionario, ASIF se compromete a aprovechar el potencial de la inteligencia artificial para el bien social. Su esfuerzo más reciente es el lanzamiento de una plataforma de medios de inteligencia artificial, MarktechPost, que se destaca por su cobertura profunda de noticias de aprendizaje automático y de aprendizaje profundo que es técnicamente sólido y fácilmente comprensible por una audiencia amplia. La plataforma cuenta con más de 2 millones de vistas mensuales, ilustrando su popularidad entre el público.