Moonshotai ha de código abierto motor de controlun middleware liviano destinado a resolver uno de los cuellos de botella clave en el despliegue del modelo de idioma grande (LLM): actualizar rápidamente los pesos del modelo en miles de GPU sin interrumpir la inferencia.

La biblioteca está particularmente diseñada para el aprendizaje de refuerzo (RL) y el aprendizaje de refuerzo con retroalimentación humana (RLHF), donde los modelos se actualizan con frecuencia y el tiempo de inactividad afecta directamente el rendimiento del sistema.

¿Qué tan rápido se pueden actualizar los LLM?

Checkpoint-Engine ofrece un avance significativo actualizando un Modelo de 1 billón de parámetros en miles de GPU en aproximadamente 20 segundos.

Las tuberías de inferencia distribuidas tradicionales pueden tardar varios minutos en recargar los modelos de este tamaño. Al reducir el tiempo de actualización por orden de magnitud, el motor de control de control aborda directamente una de las ineficiencias más grandes en la porción a gran escala.

El sistema logra esto a través de:

- Actualizaciones de transmisión para grupos estáticos.

- Actualizaciones de igual a igual (P2P) para grupos dinámicos.

- Copia de comunicación y memoria superpuesta para una latencia reducida.

¿Cómo se ve la arquitectura?

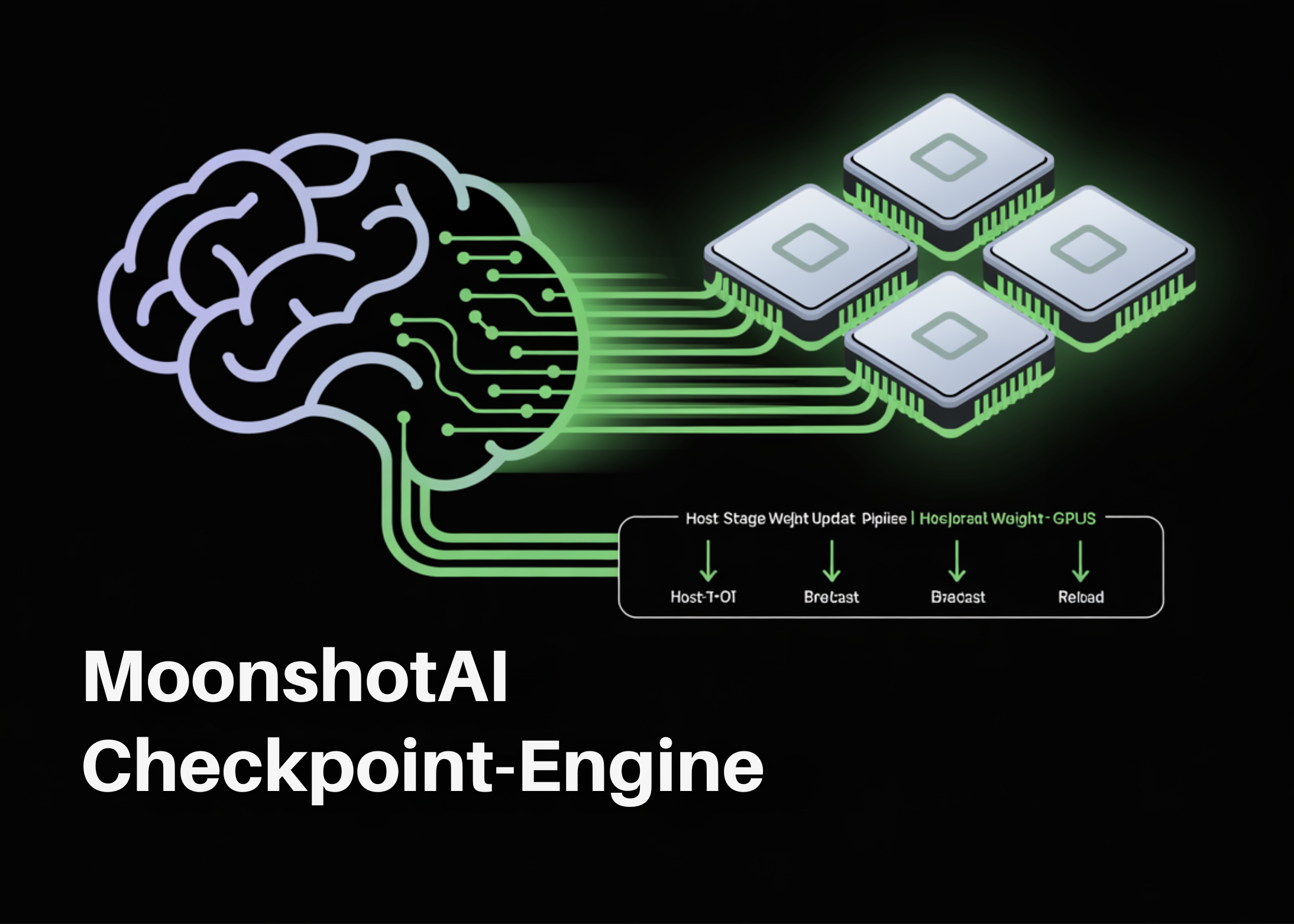

El motor de control se encuentra entre los motores de entrenamiento y los grupos de inferencia. Su diseño incluye:

- A Parámetro Servidor que coordina las actualizaciones.

- Extensiones de trabajadores que se integran con marcos de inferencia como VLLM.

La tubería de actualización de peso se ejecuta en tres etapas:

- Host-to-dispositivo (H2D): Los parámetros se copian en la memoria de GPU.

- Transmisión: Los pesos se distribuyen entre los trabajadores utilizando buffers CUDA IPC.

- Recargar: Cada fragmento de inferencia recarga solo el subconjunto de pesos que necesita.

Esta tubería escenificada está optimizada para la superposición, asegurando que las GPU permanezcan activas durante todo el proceso de actualización.

¿Cómo funciona en la práctica?

Los resultados de la evaluación comparativa confirman la escalabilidad del motor de control:

- GLM-4.5-AIR (BF16, 8 × H800): 3.94s (transmisión), 8.83s (P2P).

- QWEN3-235B-INSTRUST (BF16, 8 × H800): 6.75s (transmisión), 16.47 (P2P).

- Deepseek-v3.1 (FP8, 16 × H20): 12.22S (transmisión), 25.77 (P2P).

- Kimi-K2-Instructo (FP8, 256 × H20): ~ 21.5s (transmisión), 34.49s (P2P).

Incluso a escala de billones de parámetros con 256 GPU, las actualizaciones de transmisión completadas en aproximadamente 20 segundos, validando su objetivo de diseño.

¿Cuáles son algunas compensaciones?

Checkpoint-Engine presenta ventajas notables, pero también viene con limitaciones:

- Sobrecarga de memoria: Las tuberías superpuestas requieren memoria de GPU adicional; La memoria insuficiente desencadena rutas de recuperación más lentas.

- Latencia P2P: Las actualizaciones de igual a igual admiten grupos elásticos pero a un costo de rendimiento.

- Compatibilidad: Probado oficialmente solo con VLLM; El soporte de motor más amplio requiere trabajo de ingeniería.

- Cuantización: El soporte de FP8 existe pero sigue siendo experimental.

¿Dónde encaja en escenarios de implementación?

El motor de control es el más valioso para:

- Refuerzo de aprendizaje de tuberías donde se requieren actualizaciones de peso frecuentes.

- Grandes grupos de inferencia Sirviendo modelos de parámetros 100B – 1T+.

- Ambientes elásticos con escala dinámica, donde la flexibilidad P2P compensa las compensaciones de latencia.

Resumen

El motor de control de control representa una solución enfocada para uno de los problemas más difíciles en la implementación de LLM a gran escala: sincronización de peso rápido sin detener la inferencia. Con actualizaciones demostradas a escala de billones de parámetros en alrededor de 20 segundos, soporte flexible para modos de transmisión y P2P, y una tubería de comunicación optimizada, proporciona una ruta práctica hacia adelante para el refuerzo de aprendizaje de tuberías y clústeres de inferencia de alto rendimiento. Si bien aún se limita a VLLM y requiere refinamientos en cuantización y escala dinámica, establece una base importante para actualizaciones de modelos eficientes y continuas en los sistemas de IA de producción.

Mira el Página del proyecto aquí. No dude en ver nuestro Página de Github para tutoriales, códigos y cuadernos. Además, siéntete libre de seguirnos Gorjeo Y no olvides unirte a nuestro Subreddit de 100k+ ml y suscribirse a Nuestro boletín.