Lista de verificación del ingeniero de aprendizaje automático: mejores prácticas para modelos confiables

Imagen del editor

Introducción

Crear modelos de aprendizaje automático recién entrenados que funcionen es una tarea relativamente sencilla, gracias a marcos maduros y potencia informática accesible. Sin embargo, el verdadero desafío en el ciclo de vida de producción de un modelo comienza después de la primera ejecución de entrenamiento exitosa. Una vez implementado, un modelo opera en un entorno dinámico e impredecible donde su rendimiento puede degradarse rápidamente, convirtiendo una prueba de concepto exitosa en una responsabilidad costosa.

Los profesionales a menudo encuentran problemas como la deriva de datos, donde las características de los datos de producción cambian con el tiempo; deriva del concepto, donde evoluciona la relación subyacente entre las variables de entrada y salida; o bucles de retroalimentación sutiles que sesgan los datos de entrenamiento futuros. Estos obstáculos, que van desde fallos catastróficos del modelo hasta un deterioro lento e insidioso del rendimiento, son a menudo el resultado de la falta del rigor operativo y de los sistemas de seguimiento adecuados.

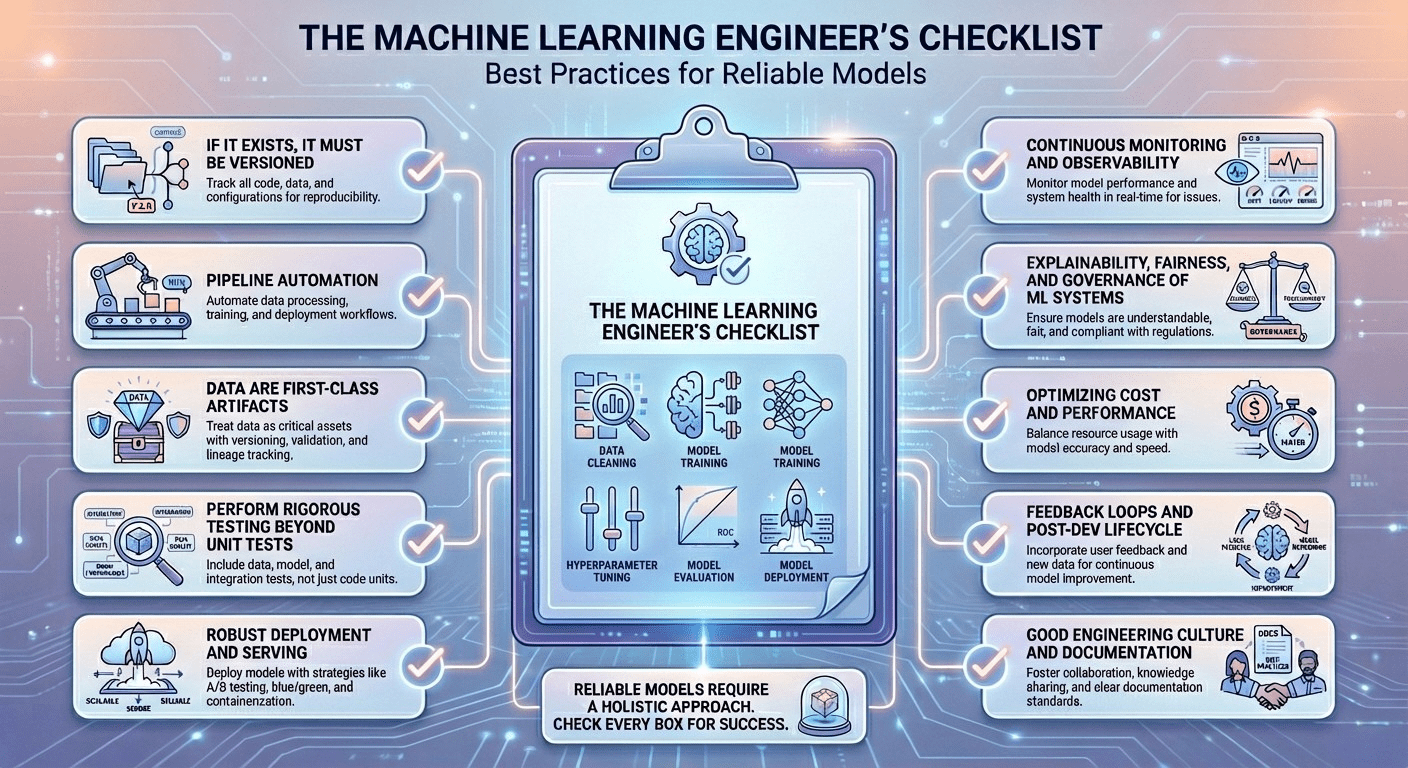

Construir modelos confiables que sigan funcionando bien a largo plazo es una historia diferente, que requiere disciplina, un proceso MLOps sólido y, por supuesto, habilidad. Este artículo se centra exactamente en eso. Al proporcionar un enfoque sistemático para abordar estos desafíos, esta lista de verificación respaldada por investigaciones describe las mejores prácticas esenciales, habilidades básicas y, a veces, herramientas imprescindibles con las que todo ingeniero de aprendizaje automático debería estar familiarizado. Al adoptar los principios descritos en esta guía, estará equipado para transformar sus modelos iniciales en sistemas de producción mantenibles y de alta calidad, garantizando que sigan siendo precisos, imparciales y resistentes a los cambios y desafíos inevitables del mundo real.

Sin más preámbulos, aquí está la lista de las 10 mejores prácticas de ingenieros de aprendizaje automático que seleccioné para que usted y sus próximos modelos brillen al máximo en términos de confiabilidad a largo plazo.

La lista de verificación

1. Si existe, debe tener una versión

Instantáneas de datos, código para modelos de entrenamiento, hiperparámetros utilizados y artefactos del modelo: todo importa y todo está sujeto a variaciones a lo largo del ciclo de vida del modelo. Por lo tanto, todo lo que rodea a un modelo de aprendizaje automático debe tener la versión adecuada. Imagínese, por ejemplo, que el rendimiento de su modelo de clasificación de imágenes, que solía ser excelente, comienza a disminuir después de una corrección de error concreta. Con el control de versiones, podrá reproducir la configuración del modelo anterior y aislar la causa raíz del problema de forma más segura.

Aquí no hay ninguna ciencia espacial: el control de versiones es ampliamente conocido en toda la comunidad de ingenieros, con habilidades básicas como la gestión de flujos de trabajo de Git, el linaje de datos y el seguimiento de experimentos; y herramientas específicas como DVC, Git/GitHub, MLflow y Delta Lake.

2. Automatización de tuberías

Como parte de los principios de integración continua y entrega continua (CI/CD), los procesos repetibles que implican el preprocesamiento de datos a través de capacitación, validación e implementaciones deben encapsularse en canales con ejecución y pruebas automatizadas debajo de ellos. Supongamos que un proceso de configuración nocturna que obtiene nuevos datos (por ejemplo, imágenes capturadas por un sensor) ejecuta pruebas de validación, vuelve a entrenar el modelo si es necesario (debido a la deriva de datos, por ejemplo), reevalúa los indicadores clave de rendimiento (KPI) del negocio y lleva los modelos actualizados a la etapa de preparación. Este es un ejemplo común de automatización de canalizaciones y requiere habilidades como la orquestación del flujo de trabajo, fundamentos de tecnologías como Docker y Kubernetes y conocimientos de automatización de pruebas.

Las herramientas comúnmente útiles aquí incluyen: Airflow, GitLab CI, Kubeflow, Flyte y GitHub Actions.

3. Los datos son artefactos de primera clase

El rigor con el que se aplican las pruebas de software en cualquier proyecto de ingeniería de software debe estar presente para hacer cumplir las restricciones y la calidad de los datos. Los datos son el alimento esencial de los modelos de aprendizaje automático desde su inicio hasta su puesta en producción; por lo tanto, la calidad de los datos que ingieren debe ser óptima.

Una comprensión sólida de los tipos de datos, los diseños de esquemas y los problemas de calidad de los datos, como anomalías, valores atípicos, duplicados y ruido, es vital para tratar los datos como activos de primera clase. Herramientas como Evidentemente, pruebas dbt y Deequ están diseñadas para ayudar con esto.

4. Realice pruebas rigurosas más allá de las pruebas unitarias

Probar sistemas de aprendizaje automático implica pruebas específicas para aspectos como la integración de canalizaciones, la lógica de funciones y la coherencia estadística de las entradas y salidas. Si un script de ingeniería de características refactorizado aplica una modificación sutil en la distribución original de una característica, su sistema puede pasar pruebas unitarias básicas, pero a través de pruebas de distribución, el problema podría detectarse a tiempo.

El desarrollo basado en pruebas (TDD) y el conocimiento de las pruebas de hipótesis estadísticas son fuertes aliados para “poner en práctica estas mejores prácticas”, con herramientas imperativas que pasan desapercibidas como la biblioteca pytest, pruebas de deriva de datos personalizadas y pruebas de burla en unidades.

5. Implementación y servicio sólidos

Tener una implementación sólida de un modelo de aprendizaje automático y su funcionamiento en producción implica que el modelo debe estar empaquetado, ser reproducible, escalable a configuraciones grandes y tener la capacidad de retroceder de forma segura si es necesario.

La llamada estrategia azul-verde, basada en la implementación en dos entornos de producción “idénticos”, es una forma de garantizar que el tráfico de datos entrante pueda revertirse rápidamente en caso de picos de latencia. Las arquitecturas en la nube junto con la contenerización ayudan a este fin, con herramientas específicas como Docker, Kubernetes, FastAPI y BentoML.

6. Monitoreo continuo y observabilidad

Probablemente esto ya esté en su lista de verificación de mejores prácticas, pero como elemento esencial de la ingeniería de aprendizaje automático, vale la pena señalarlo. El monitoreo continuo y la observabilidad del modelo implementado implica monitorear la deriva de datos, el deterioro del modelo, la latencia, el costo y otras métricas comerciales específicas del dominio más allá de la precisión o el error.

Por ejemplo, si la métrica de recuperación de un modelo de detección de fraude cae ante la aparición de nuevos patrones de fraude, las alertas de deriva configuradas correctamente pueden desencadenar la necesidad de volver a entrenar el modelo con datos de transacciones nuevos. Prometheus y las herramientas de inteligencia empresarial como Grafana pueden ayudar mucho en este caso.

7. Explicabilidad, equidad y gobernanza de los sistemas de aprendizaje automático

Otra práctica esencial para los ingenieros de aprendizaje automático es que esta mejor práctica tiene como objetivo garantizar la entrega de modelos con un comportamiento transparente, conforme y responsable, comprendiendo y cumpliendo las regulaciones nacionales o regionales existentes, por ejemplo, la Ley de IA de la Unión Europea. Un ejemplo de la aplicación de estos principios podría ser un modelo de clasificación de préstamos que active controles de equidad antes de implementarse para garantizar que no se rechace injustificadamente a ningún grupo protegido. Para la interpretabilidad y la gobernanza, se recomiendan encarecidamente herramientas como SHAP, LIME, registros de modelos y Fairlearn.

8. Optimización de costos y rendimiento

Esta mejor práctica implica optimizar el entrenamiento del modelo y el rendimiento de inferencia, así como la latencia y el consumo de hardware. Una posible forma de aprovecharlo es pasar de los modelos tradicionales a aquellos que utilizan técnicas como precisión mixta y cuantificación, reduciendo así significativamente los costos de GPU y preservando la precisión. Las bibliotecas y marcos que ya brindan soporte para estas técnicas incluyen PyTorch AMP, TensorRT y vLLM, por nombrar algunas.

9. Bucles de retroalimentación y ciclo de vida posterior al desarrollo

Las mejores prácticas específicas dentro de este incluyen la recopilación de etiquetas de datos “verdaderos”, el reentrenamiento de modelos bajo un flujo de trabajo bien establecido y la reducción de la brecha entre los resultados del mundo real y las predicciones del modelo. Un modelo de recomendación es un gran ejemplo de esto: es necesario volver a entrenarlo con frecuencia, incorporando interacciones recientes de los usuarios para evitar que se vuelva obsoleto. Después de todo, ¡las preferencias de los usuarios cambian y evolucionan con el tiempo!

Las habilidades útiles para definir bucles de retroalimentación sólidos y un ciclo de vida posterior al desarrollo incluyen la definición de estrategias apropiadas de etiquetado de datos, el diseño de esquemas de reentrenamiento de modelos y el uso de runbooks de incidentes (un runbook de incidentes es una guía paso a paso para identificar, analizar y afrontar rápidamente problemas en los sistemas de aprendizaje automático de producción). Asimismo, las herramientas de la tienda de funciones como Tecton y Feast también son útiles para llevar a cabo estas prácticas.

10. Buena cultura y documentación de ingeniería

Para concluir esta lista de verificación, una buena cultura de ingeniería combinada con las otras nueve mejores prácticas es esencial para reducir la deuda técnica no tan obvia y aumentar la mantenibilidad del sistema. En pocas palabras, una intención del modelo claramente documentada evitará que futuros ingenieros lo utilicen para tareas no deseadas, por ejemplo. La comunicación, la colaboración interdisciplinaria y la gestión eficaz del conocimiento son tres pilares básicos para ello. Las herramientas ampliamente utilizadas en empresas como Confluence y Notion pueden ayudar.

Concluyendo

Si bien el panorama del aprendizaje automático está plagado de desafíos complejos (desde la gestión de la deuda técnica y la deriva de datos hasta el mantenimiento de la equidad y el alto rendimiento), estos problemas no son insuperables. Los equipos de MLOps más exitosos ven estos obstáculos no como obstáculos, sino como objetivos necesarios para la mejora de procesos. Al adoptar las prácticas sistemáticas y rigurosas descritas en esta lista de verificación, los ingenieros pueden ir más allá de las soluciones fragmentadas y ad hoc y establecer una cultura de calidad duradera. Seguir estos principios, desde versionar todo hasta probar datos rigurosamente y automatizar la implementación, transforma la difícil tarea de la confiabilidad del modelo a largo plazo en un esfuerzo de ingeniería manejable y reproducible. Este compromiso con las mejores prácticas es lo que, en última instancia, separa los proyectos de investigación exitosos de los sistemas de producción sostenibles e impactantes.

Este artículo proporcionó una lista de verificación de 10 mejores prácticas esenciales para que los ingenieros de aprendizaje automático ayuden a garantizar el desarrollo y el servicio confiables del modelo a largo plazo, junto con estrategias específicas, escenarios de ejemplo y herramientas útiles en el mercado para seguir estas mejores prácticas.