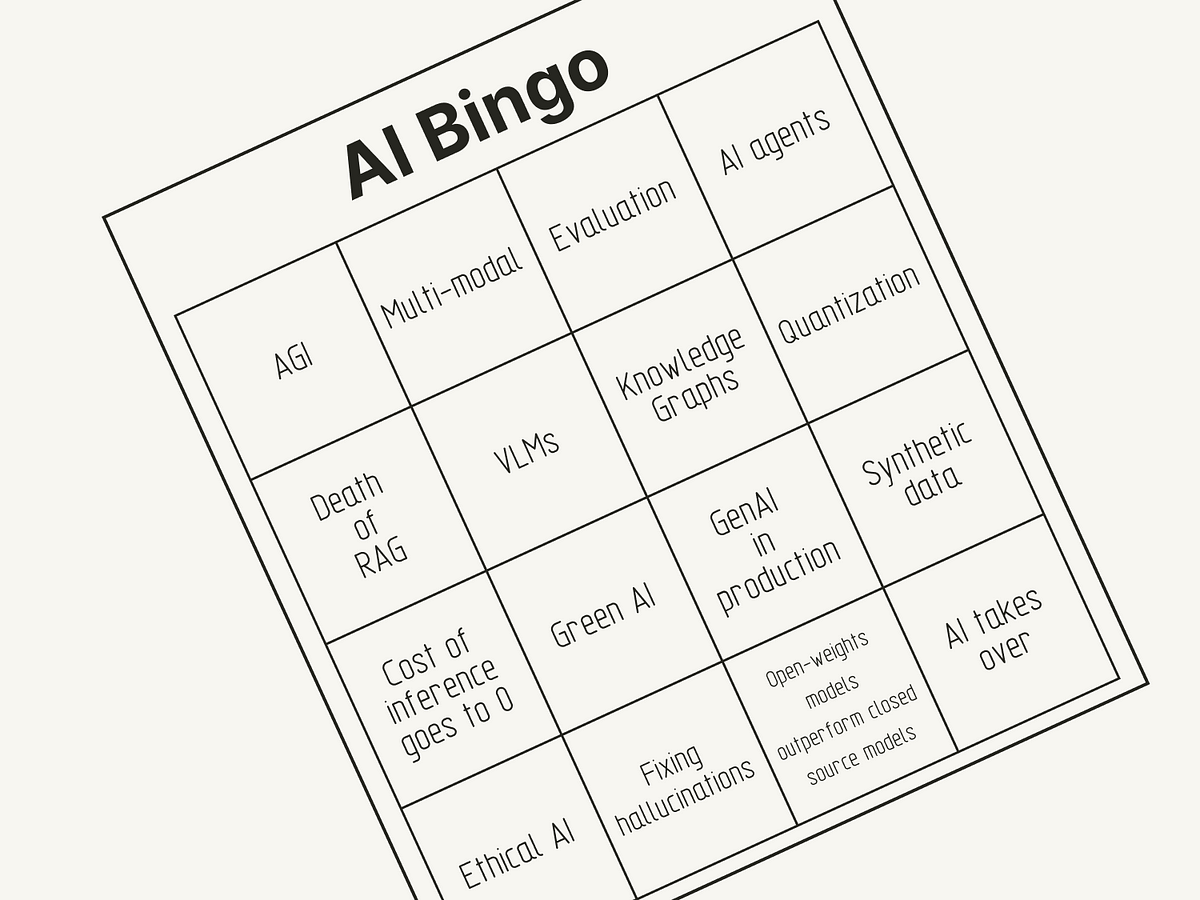

Lo que hice bien (y mal) sobre las tendencias en 2024 y atreverme a hacer predicciones más audaces para el próximo año

En En 2023, la creación de aplicaciones basadas en IA parecía muy prometedora, pero los desafíos ya estaban empezando a mostrarse. Para 2024, comenzamos a experimentar con técnicas para abordar la dura realidad de hacerlos funcionar en producción.

El año pasado, yo revisó las mayores tendencias en IA en 2023 e hizo predicciones para 2024. Este año, en lugar de una línea de tiempo, quiero centrarme en temas clave: ¿Qué tendencias surgieron? ¿Dónde me equivoqué? ¿Y qué podemos esperar para 2025?

Si tengo que resumir el espacio de la IA en 2024, sería el meme “Capitán, es miércoles”. La cantidad de lanzamientos importantes este año fue abrumadora. No culpo a nadie en este espacio que se sienta agotado hacia finales de este año. Ha sido un viaje loco y ha sido difícil mantener el ritmo. Repasemos temas clave en el espacio de la IA y veamos si los predije correctamente el año pasado.

Evaluaciones

Comencemos analizando algunas soluciones de IA generativa que llegaron a producción. No hay muchos. como un encuesta realizada por A16Z revelado en 2024, las empresas todavía dudan en implementar IA generativa en aplicaciones orientadas al cliente. En cambio, se sienten más seguros al usarlo para tareas internas, como búsqueda de documentos o chatbots.

Entonces, ¿por qué no existen tantas aplicaciones de IA generativa orientadas al cliente? Probablemente porque todavía estamos descubriendo cómo evaluarlos adecuadamente. Esta fue una de mis predicciones para 2024.

Gran parte de la investigación implicó el uso de otro LLM para evaluar el resultado de un LLM (LLM-como-juez). Si bien el enfoque puede ser inteligente, también es imperfecto debido al costo adicional, la introducción de sesgos y la falta de confiabilidad.

Mirando hacia atrás, anticipé que veríamos este problema resuelto este año. Sin embargo, si observamos el panorama actual, a pesar de ser un tema importante de discusión, todavía no hemos encontrado una forma confiable de evaluar las soluciones de IA generativa de manera efectiva. Aunque creo que el LLM como juez es la única forma en que podemos evaluar las soluciones de IA generativa a escala, esto demuestra lo temprano que estamos en este campo.

Multimodalidad

Aunque esto podría haber sido obvio para muchos de ustedes, no lo tenía en mi radar para 2024. Con los lanzamientos de GPT4, Llama 3.2y ColPalilos modelos de base multimodal fueron una gran tendencia en 2024. Mientras nosotros, los desarrolladores, estábamos ocupados descubriendo cómo hacer que los LLM funcionaran en nuestras carteras existentes, los investigadores ya estaban un paso por delante. Ya estaban construyendo modelos de cimientos que podían manejar más de una modalidad.

“Hay *De ninguna manera* “Alguna vez alcanzaremos la IA a nivel humano sin que las máquinas aprendan a partir de entradas sensoriales de gran ancho de banda, como la visión”. — Yann LeCun

Tomemos el análisis de PDF como ejemplo de la utilidad de los modelos multimodales más allá de las tareas de conversión de texto a imagen. ColPaliLos investigadores evitaron los difíciles pasos del OCR y la extracción de diseño mediante el uso de modelos de lenguaje visual (VLM). Sistemas como ColPali y colqwen2 procese archivos PDF como imágenes, extrayendo información directamente sin preprocesamiento ni fragmentación. Este es un recordatorio de que las soluciones más simples a menudo surgen al cambiar la forma en que se plantea el problema.

Los modelos multimodales suponen un cambio mayor de lo que parece. La búsqueda de documentos en archivos PDF es solo el comienzo. La multimodalidad en los modelos básicos desbloqueará posibilidades completamente nuevas para aplicaciones en todas las industrias. Con más modalidades, la IA ya no se trata sólo de lenguaje: se trata de comprender el mundo.

Ajuste fino de modelos de peso abierto y cuantificación

Los modelos de peso abierto están cerrando la brecha de rendimiento con respecto a los modelos cerrados. Ajustarlos le brinda un aumento de rendimiento sin dejar de ser liviano. La cuantificación hace que estos modelos sean más pequeños y más eficientes (ver también IA verde) para ejecutarse en cualquier lugar, incluso en dispositivos pequeños. La cuantificación combina bien con el ajuste fino, especialmente porque el ajuste fino de los modelos de lenguaje es inherentemente desafiante (ver QLoRA).

Juntas, estas tendencias dejan claro que el futuro no son sólo modelos más grandes, sino también modelos más inteligentes.

No creo haber mencionado explícitamente este único escribió un pequeño artículo sobre esto en el segundo trimestre de 2024.. Así que no me daré ningún punto aquí.

Agentes de IA

Este año, los agentes de IA y los flujos de trabajo de agentes ganaron mucha atención, como predijo Andrew Ng a principios de año. vimos Cadena Lang y LlamaIndex pasar a incorporar agentes, TripulaciónAI ganó mucho impulso y OpenAI lanzó Enjambre. Este es otro tema que no había visto venir desde que no lo investigué.

“Creo que los flujos de trabajo agentes de IA impulsarán un progreso masivo en la IA este año, tal vez incluso más que la próxima generación de modelos básicos”. — Andrés Ng

A pesar del enorme interés en los agentes de IA, pueden resultar controvertidos. En primer lugar, todavía no existe una definición clara de “agente de IA” y sus capacidades. ¿Los agentes de IA son simplemente LLM con acceso a herramientas o tienen otras capacidades específicas? En segundo lugar, vienen con latencia y costo adicionales. He leído muchos comentarios que dicen que los sistemas de agentes no son adecuados para sistemas de producción debido a esto.

Pero creo que ya hemos visto algunas canalizaciones de agentes en producción con flujos de trabajo livianos, como el enrutamiento de consultas de usuarios a llamadas a funciones específicas. Creo que seguiremos viendo agentes en 2025. Con suerte, obtendremos una definición y una imagen más clara.

RAG no está muerto y la recuperación se generaliza

Recuperación-Generación Aumentada (RAG) Obtuvo una atención significativa en 2023 y siguió siendo un tema clave en 2024, con muchas variantes nuevas surgiendo. Sin embargo, sigue siendo un tema de debate. Algunos argumentan que se está volviendo obsoleto con los modelos de contexto largo, mientras que otros cuestionan si se trata siquiera de una idea nueva. Si bien creo que la crítica a la terminología está justificada, creo que el concepto llegó para quedarse (al menos por un tiempo).

Cada vez que se publica un nuevo modelo de contexto largo, algunas personas predicen que será el fin de los oleoductos RAG. No creo que eso vaya a suceder. Toda esta discusión debería ser una publicación de blog propia, así que no entraré en profundidad aquí y guardaré la discusión para otro. Sólo diré que no creo que sea ni lo uno ni lo otro. Son complementos. En cambio, probablemente usaremos modelos de contexto largo junto con oleoductos RAG.

Además, tener una base de datos en las aplicaciones no es un concepto nuevo. El término ‘RAG’, que se refiere a recuperar información de una fuente de conocimiento para mejorar el resultado de un LLM, ha enfrentado críticas. Algunos argumentan que es simplemente un cambio de marca de técnicas utilizadas durante mucho tiempo en otros campos, como la ingeniería de software. Si bien creo que probablemente nos alejemos del plazo a largo plazo, la técnica llegó para quedarse.

A pesar de las predicciones sobre la desaparición de RAG, la recuperación sigue siendo una piedra angular de los procesos de IA. Si bien mi trabajo en recuperación puede ser parcial, sentí que este tema se volvió más común en la IA este año. Comenzó con muchas discusiones sobre la búsqueda de palabras clave (BM25) como base para los procesos de RAG. Luego evolucionó hacia una discusión más amplia sobre modelos de recuperación densos, como COLBERT o ColPali.

Gráficos de conocimiento

Me perdí por completo este tema porque no estoy muy familiarizado con él. Los gráficos de conocimiento en los sistemas RAG (por ejemplo, Graph RAG) fueron otro gran tema. Dado que todo lo que puedo decir sobre los gráficos de conocimiento en este momento es que parecen ser una poderosa fuente de conocimiento externo, esta sección será breve.