Los videos generados por IA de las descripciones o imágenes de texto tienen un inmenso potencial para la creación de contenido, la producción de medios y el entretenimiento. Avances recientes en aprendizaje profundoparticularmente en las arquitecturas y modelos de difusión basados en transformadores, han impulsado este progreso. Sin embargo, la capacitación de estos modelos sigue siendo intensivo en recursos, lo que requiere grandes conjuntos de datos, un poder informático extenso y una inversión financiera significativa. Estos desafíos limitan el acceso a las tecnologías de generación de videos de vanguardia, haciéndolos principalmente disponibles para grupos y organizaciones de investigación bien financiados.

La capacitación de modelos de video AI es costoso y computacionalmente exigente. Los modelos de alto rendimiento requieren millones de muestras de entrenamiento y poderosos grupos de GPU, lo que hace que sean difíciles de desarrollar sin fondos significativos. Los modelos a gran escala, como Sora de OpenAi, la calidad de la generación de videos de OpenAi a nuevas alturas, pero exigen enormes recursos computacionales. El alto costo de la capacitación restringe el acceso a la síntesis de video avanzada impulsada por la IA, lo que limita la innovación a algunas organizaciones importantes. Abordar estas barreras financieras y técnicas es esencial para hacer que la generación de videos de IA sea más ampliamente disponible y alentando la adopción más amplia.

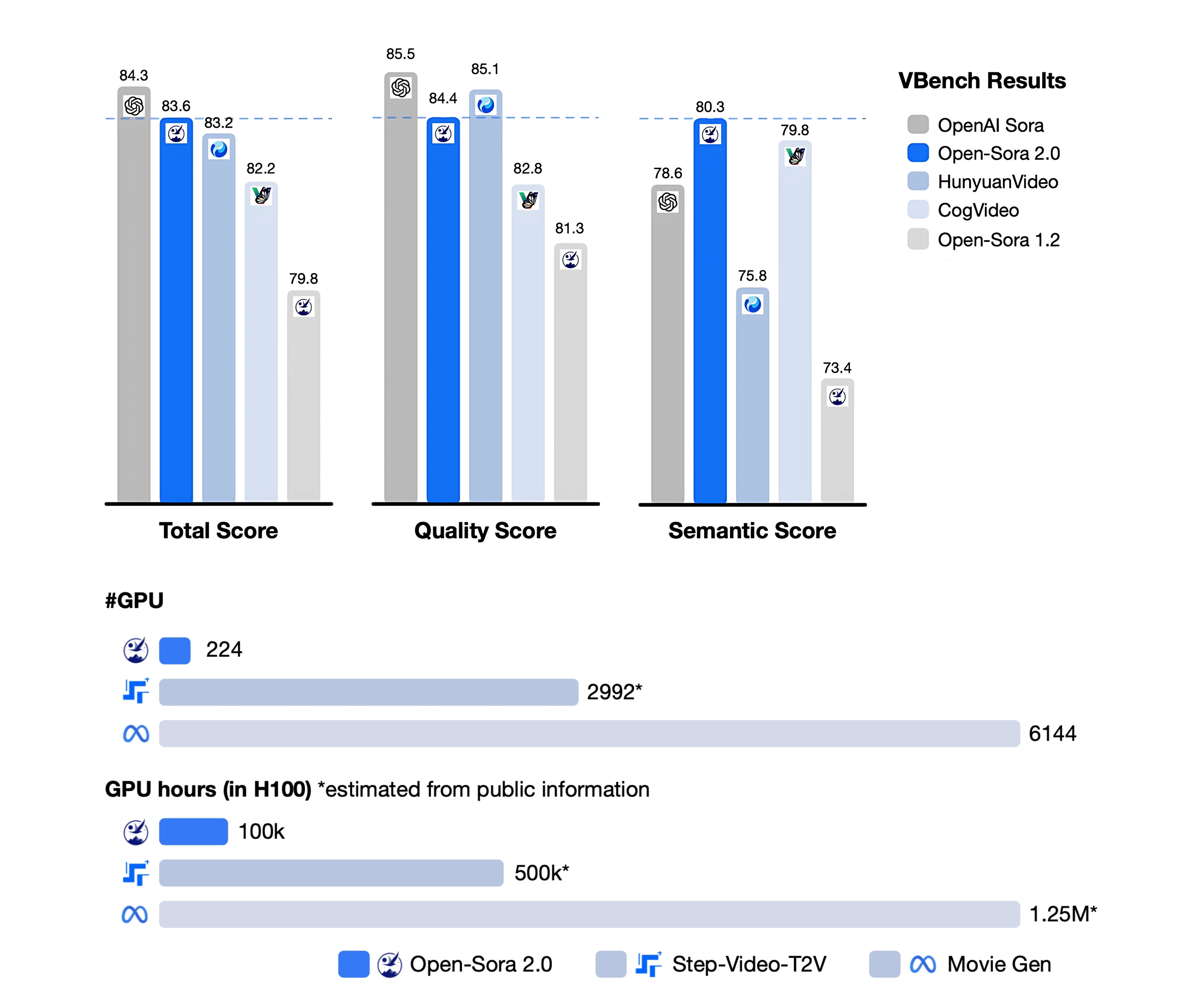

Se han desarrollado diferentes enfoques para manejar las demandas computacionales de la generación de videos de IA. Los modelos patentados como Runway Gen-3 Alpha cuentan con arquitecturas altamente optimizadas, pero son de código cerrado, restringiendo contribuciones de investigación más amplias. Los modelos de código abierto como Hunyuanvideo y Step-Video-T2V ofrecen transparencia, pero requieren una potencia informática significativa. Muchos dependen de extensos conjuntos de datos, compresión basada en autoencoder y técnicas de difusión jerárquica para mejorar la calidad del video. Sin embargo, cada enfoque viene con compensaciones entre eficiencia y rendimiento. Si bien algunos modelos se centran en la producción de alta resolución y la precisión del movimiento, otros priorizan los costos computacionales más bajos, lo que resulta en diferentes niveles de rendimiento en las métricas de evaluación. Los investigadores continúan buscando un equilibrio óptimo que preserva la calidad del video al tiempo que reduce las cargas financieras y computacionales.

Los investigadores de la tecnología de HPC-AI introducen Sora 2.0un modelo de generación de videos de IA de nivel comercial que logra un rendimiento de última generación al tiempo que reduce significativamente los costos de capacitación. Este modelo se desarrolló con una inversión de solo $ 200,000, lo que lo convierte en cinco a diez veces más rentable que los modelos competidores como MovieGen y Step-Video-T2V. Open-Sora 2.0 está diseñado para democratizar la generación de videos de IA haciendo que la tecnología de alto rendimiento sea accesible para un público más amplio. A diferencia de los modelos anteriores de alto costo, este enfoque integra múltiples innovaciones basadas en eficiencia, incluida la curación de datos mejorada, un autoencoder avanzado, un nuevo marco de transformadores híbridos y metodologías de entrenamiento altamente optimizadas.

El equipo de investigación implementó un sistema de filtrado de datos jerárquico que refina conjuntos de datos de video en subconjuntos de calidad progresivamente de mayor calidad, lo que garantiza una eficiencia de capacitación óptima. Un avance significativo fue la introducción del video autoencoder DC-AE, que mejora la compresión de video al tiempo que reduce el número de tokens requeridos para la representación. La arquitectura del modelo incorpora mecanismos de atención completa, procesamiento múltiple y un enfoque de transformador de difusión híbrido para mejorar la calidad del video y la precisión del movimiento. La eficiencia del entrenamiento se maximizó a través de una tubería de tres etapas: aprendizaje de texto a video en datos de baja resolución, adaptación de imagen a video para una dinámica de movimiento mejorada y ajuste fino de alta resolución. Este enfoque estructurado permite al modelo comprender patrones de movimiento complejos y consistencia espacial mientras mantiene la eficiencia computacional.

El modelo se probó a través de múltiples dimensiones: calidad visual, adherencia rápida y realismo de movimiento. Las evaluaciones de preferencias humanas mostraron que el sora abierto 2.0 supera a los competidores patentados y de código abierto en al menos dos categorías. En las evaluaciones de Vbench, la brecha de rendimiento entre la Sora abierta y el SORA de OpenAI se redujo de 4.52% a solo 0.69%, lo que demuestra mejoras sustanciales. Open-Sora 2.0 también logró una puntuación VBench más alta que Hunyuanvideo y Cogvideo, estableciéndose como un fuerte contendiente entre los modelos actuales de código abierto. Además, el modelo integra optimizaciones de capacitación avanzadas, como el procesamiento paralelo, el punto de control de activación y la recuperación automatizada de fallas, garantizando la operación continua y la maximización de la eficiencia de la GPU.

Las conclusiones clave de la investigación sobre abierta-sora 2.0 incluyen:

- Open-Sora 2.0 fue entrenado por solo $ 200,000, por lo que es de cinco a diez veces más rentable que los modelos comparables.

- El sistema de filtrado de datos jerárquicos refina conjuntos de datos de video a través de múltiples etapas, mejorando la eficiencia de la capacitación.

- El video AutoCoder DC-AA reduce significativamente los recuentos de tokens al tiempo que mantiene una alta fidelidad de reconstrucción.

- La tubería de entrenamiento de tres etapas optimiza el aprendizaje de los datos de baja resolución al ajuste de alta resolución.

- Las evaluaciones de preferencias humanas indican que el sora abierto 2.0 supera a los principales modelos patentados y de código abierto en al menos dos categorías de rendimiento.

- El modelo redujo la brecha de rendimiento con SORA de OpenAi de 4.52% a 0.69% en evaluaciones de Vbench.

- Las optimizaciones avanzadas del sistema, como el punto de control de activación y el entrenamiento paralelo, maximizan la eficiencia de GPU y reducen la sobrecarga de hardware.

- Open-Sora 2.0 demuestra que la generación de videos AI de alto rendimiento se puede lograr con costos controlados, lo que hace que la tecnología sea más accesible para investigadores y desarrolladores de todo el mundo.

Verificar el Papel y Página de Github. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, siéntete libre de seguirnos Gorjeo Y no olvides unirte a nuestro Subreddit de 80k+ ml.

Aswin AK es un pasante de consultoría en MarktechPost. Está persiguiendo su doble título en el Instituto de Tecnología Indio, Kharagpur. Le apasiona la ciencia de datos y el aprendizaje automático, aportando una sólida experiencia académica y una experiencia práctica en la resolución de desafíos de dominio de la vida real.