ChipNeMo explora la utilización de LLM para el diseño de chips industriales, empleando técnicas de adaptación de dominio en lugar de depender de LLM disponibles en el mercado. Estas técnicas implican tokenización personalizada, entrenamiento previo adaptable al dominio, ajuste fino supervisado con orientación específica del dominio y modelos de recuperación adaptados al dominio. El estudio evalúa estos métodos a través de tres aplicaciones LLM en diseño de chips, lo que da como resultado mejoras de rendimiento notables en comparación con los modelos de uso general. Permite una reducción sustancial del tamaño del modelo con un rendimiento igual o mejorado en varias tareas de diseño, al tiempo que resalta el potencial para un mayor refinamiento en los enfoques LLM adaptados al dominio.

El estudio explora aplicaciones de dominios específicos de los LLM en el diseño de chips, enfatizando la presencia de datos propietarios en varios dominios. Profundiza en la generación aumentada de recuperación para mejorar las tareas de generación de código y PNL intensivas en conocimiento, incorporando métodos de recuperación dispersos y densos. Investigaciones anteriores en diseño de chips han aprovechado el ajuste de los LLM de código abierto en datos de dominios específicos para mejorar el rendimiento en tareas como la generación de código Verilog. También exige una mayor exploración y mejora de los enfoques LLM adaptados al dominio en el diseño de chips.

Las herramientas de automatización de diseño electrónico (EDA) han mejorado la productividad del diseño de chips, pero aún es necesario completar algunas tareas relacionadas con el lenguaje que requieren mucho tiempo. Los LLM pueden automatizar la generación de código, las respuestas de ingeniería, el análisis y la clasificación de errores en el diseño de chips. Investigaciones anteriores han explorado aplicaciones LLM para generar scripts RTL y EDA. Los LLM de dominios específicos demuestran un rendimiento superior en tareas de diseño de chips de dominios específicos. El objetivo es mejorar el rendimiento de LLM al tiempo que se reduce el tamaño del modelo.

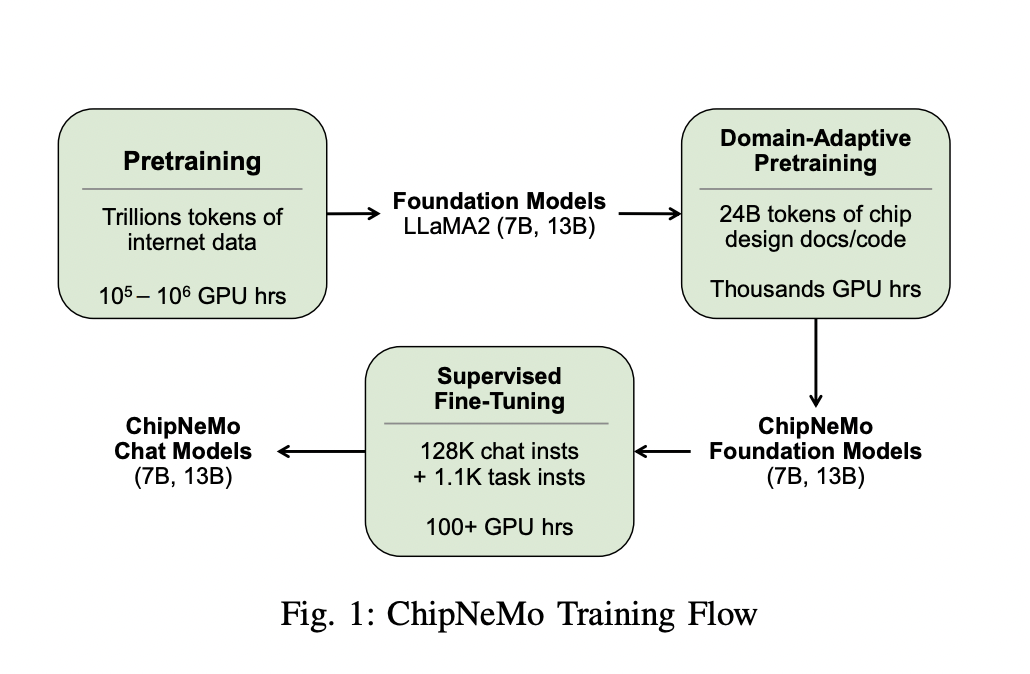

Los datos de diseño del chip se procesaron a través de tokenizadores personalizados, optimizando su idoneidad para el análisis. Se llevaron a cabo procedimientos de preentrenamiento continuo adaptables al dominio para ajustar los modelos básicos previamente entrenados, alineándolos con el dominio de diseño del chip. El ajuste supervisado aprovechó conjuntos de datos de instrucciones de chat generales y específicos del dominio para perfeccionar el rendimiento del modelo. Se aprovecharon modelos de recuperación adaptados al dominio, que abarcan técnicas de recuperación escasa como TF-IDF y BM25, así como métodos de recuperación densos que utilizan modelos previamente entrenados, para mejorar la recuperación y generación de información.

Las técnicas de adaptación de dominio en ChipNeMo produjeron mejoras de rendimiento notables en los LLM para aplicaciones de diseño de chips, que abarcan tareas como chatbots de ingeniería, generación de scripts EDA y análisis de errores. Estas técnicas no sólo redujeron significativamente el tamaño del modelo sino que también mantuvieron o mejoraron el rendimiento en diversas tareas de diseño. Los modelos de recuperación adaptados al dominio eclipsaron a los modelos de uso general y mostraron mejoras notables: 2 veces mejores que los modelos no supervisados y un aumento notable de 30 veces en comparación con los modelos Sentence Transformer. Los rigurosos puntos de referencia de evaluación, que abarcan consultas de opción múltiple y evaluaciones de generación de código, proporcionaron información cuantificable sobre la precisión y eficacia del modelo.

En conclusión, las técnicas adaptadas al dominio, como la tokenización personalizada, el preentrenamiento adaptable al dominio, el ajuste fino supervisado con instrucciones específicas del dominio y los modelos de recuperación adaptados al dominio, marcaron una mejora sustancial en el rendimiento del LLM para aplicaciones de diseño de chips. Los modelos ChipNeMo, ejemplificados por ChipNeMo-13B-Chat, mostraron resultados comparables o superiores a sus modelos base, reduciendo la brecha de rendimiento con modelos LLaMA2 70B más potentes en tareas de chatbot asistente de ingeniería, generación de scripts EDA y análisis de errores.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides unirte. nuestro SubReddit de 32k+ ML, Comunidad de Facebook de más de 40.000 personas, Canal de discordia, y Boletín electrónicodonde compartimos las últimas noticias sobre investigaciones de IA, interesantes proyectos de IA y más.

Si te gusta nuestro trabajo, te encantará nuestra newsletter.

también estamos en Telegrama y WhatsApp.

Hola, mi nombre es Adnan Hassan. Soy pasante de consultoría en Marktechpost y pronto seré aprendiz de gestión en American Express. Actualmente estoy cursando una doble titulación en el Instituto Indio de Tecnología, Kharagpur. Me apasiona la tecnología y quiero crear nuevos productos que marquen la diferencia.