Los agentes basados en GPT-4O liderados por un humano colaboraron para desarrollar nanocodios validados experimentalmente contra SARS-CoV-2. ¡Descubra conmigo cómo estamos entrando en la era del razonamiento automatizado y trabajar con resultados procesables, e imaginemos cómo esto irá aún más allá cuando los técnicos de laboratorio robóticos también puedan llevar a cabo las partes de laboratorio húmedo de cualquier proyecto de investigación!

En una era en la que la inteligencia artificial continúa remodelando cómo codificamos, escribimos e incluso la razón, ha surgido una nueva frontera: la IA que realiza una investigación científica real, como están tratando de lograr varias compañías (desde los principales jugadores establecidos como Google hasta los giros dedicados). Y no estamos hablando solo de simulaciones, resumen automatizado, crujido de datos o resultados teóricos, sino de producir materiales validados experimentalmente, como diseños biológicos con potencial relevancia clínica, en este caso que le traigo hoy.

Ese futuro acaba de acercarse mucho; ¡Muy cerca de hecho!

En un artículo innovador que acaba de publicar en Naturaleza Por investigadores de Stanford y el Biohub de Chan Zuckerberg, un sistema novedoso llamado Laboratorio Virtual demostró que un investigador humano que trabaja con un equipo de agentes de Modelo de lenguaje grande (LLM) puede diseñar nuevos nanobodios: estas son pequeñas proteínas similares a los antibodios que pueden unir a otros para bloquear su función, a los variantes de aumento rápido de SARS-COV-2. Esta no fue solo una interacción de chatbot estrecha o un artículo asistido por herramientas; Era un proceso de investigación de múltiples fases abierto dirigido y ejecutado por agentes de IA, cada uno con una experiencia y un papel especializados, lo que resultó en moléculas biológicas validadas del mundo real que podrían pasar perfectamente a los estudios posteriores para la aplicabilidad real en el tratamiento de la enfermedad (en este caso COVID-19).

Vamos a profundizar para ver cómo esto es una investigación seria y replicable que presenta un enfoque de las obras de ciencias colaborativas de Ai-Human (y en realidad AI-AI).

Desde aplicaciones “simples” hasta materializar un laboratorio de IA de personal de personal completo

Aunque hay algunos precedentes en esto, el nuevo sistema es diferente a cualquier cosa anterior. Y una de las mejores cosas es que no se basa en una LLM o herramienta capacitada en uso especial; Más bien, utiliza GPT-4O instruido con indicaciones que hacen que juegue el papel de los diferentes tipos de personas a menudo involucradas en un equipo de investigación.

Hasta hace poco, el papel de LLM en la ciencia se limitaba a la pregunta de respuesta, resumiendo, escribiendo soporte, codificación y tal vez algún análisis de datos directos. Útil, sí, pero no transformador. El laboratorio virtual presentado en este nuevo Naturaleza El documento cambia que al elevar los LLM de asistentes a investigadores autónomos que interactúan entre sí y con un usuario humano (que trae la pregunta de investigación, ejecuta experimentos cuando es necesario, y finalmente concluye el proyecto) en reuniones estructuradas para explorar, hipotetizar, codificar, analizar e iterar.

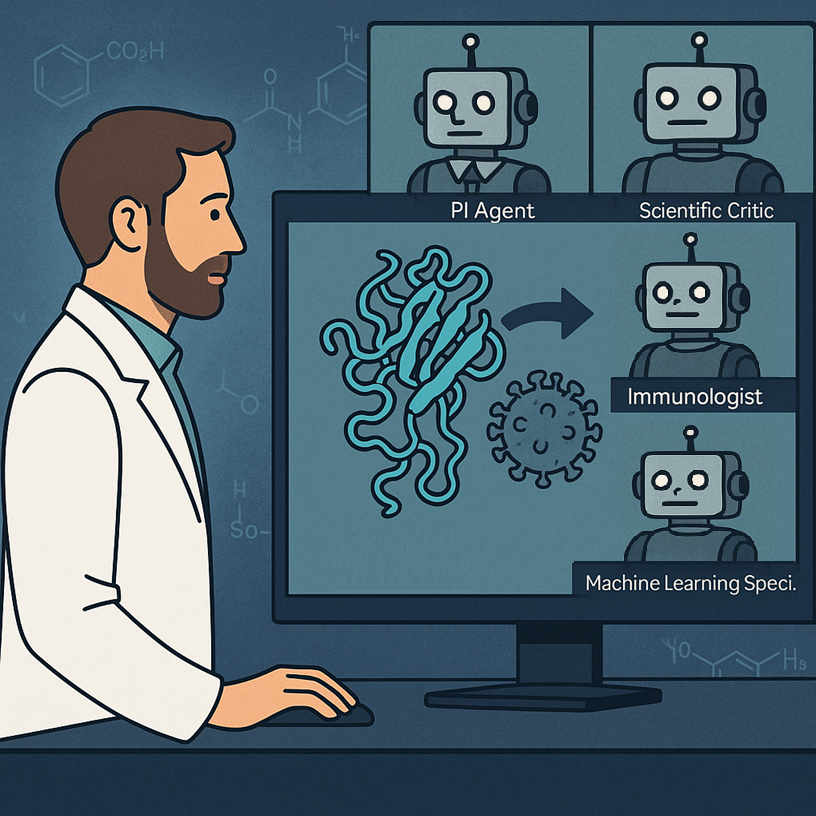

La idea central en el corazón de este trabajo era simular un laboratorio interdisciplinario atendido por agentes de IA. Cada agente tiene un papel científico, por ejemplo, inmunólogo, biólogo computacional o especialista en aprendizaje automático, y se instancia desde GPT-4O con una “persona” diseñada a través de una ingeniería rápida cuidadosa. Estos agentes están liderados por un agente de investigador principal (PI) y monitoreados por un agente crítico científico, ambos agentes virtuales.

El agente crítico desafía los supuestos y señala los errores, actuando como el revisor escéptico del laboratorio; Como exploró el artículo, este fue un elemento clave del flujo de trabajo sin el cual ocurrieron demasiados errores y paseos que se detrimaron en el proyecto.

El investigador humano establece agendas de alto nivel, inyecta restricciones de dominio y finalmente ejecuta los resultados (especialmente los experimentos de laboratorio húmedo). Pero el “pensamiento” (¿tal vez debería comenzar a considerar eliminar las comillas?) Lo hacen los agentes.

Cómo funcionó todo

El laboratorio virtual tuvo la tarea de resolver un desafío biomédico real y urgente: diseñar nuevos aglutinantes de nanobodios para las variantes KP.3 y JN.1 de SARS-CoV-2, que habían evolucionado la resistencia a los tratamientos existentes. En lugar de comenzar desde cero, los agentes de IA decidieron (sí, tomaron esta decisión por sí mismos) para mutar los nanobodios existentes que eran efectivos contra la tensión ancestral pero que ya no funcionaron tan bien. ¡Sí, se decidieron por eso!

Como todas las interacciones son rastreadas y documentadas, podemos ver exactamente cómo avanzó el equipo con el proyecto.

En primer lugar, el humano definió solo el PI y los agentes críticos. El agente de PI creó el equipo científico generando agentes especializados. En este caso fueron inmunólogo, especialista en aprendizaje automático y biólogo computacional. En una reunión de equipo, los agentes debatieron si diseñar anticuerpos o nanobodios, y si diseñar desde cero o mutar los existentes. Eligieron la mutación de nanobodos, justificada por líneas de tiempo más rápidas y datos estructurales disponibles. Luego discutieron sobre qué herramientas usar y cómo implementarlas. Fueron por el modelo de lenguaje de proteína ESM acoplado al multímero Alfafold para la predicción de la estructura y la rosetta para los cálculos de energía de unión. Para la implementación, los agentes decidieron ir con el código Python. Muy curiosamente, el Código debía ser revisado por el agente crítico varias veces, y fue refinado a través de múltiples reuniones asincrónicas.

A partir de las reuniones y múltiples ejecuciones de código, se diseñó una estrategia exacta sobre cómo proponer el conjunto final de mutaciones que se probarán. Brevemente, para los bioinformáticos que leen esta publicación, el agente PI diseñó una tubería iterativa que usa ESM para obtener todas las mutaciones puntuales en una secuencia de nanobodias mediante la relación de veracilización logar clasificación de todas las mutaciones propuestas. Esto en realidad se repitió en un ciclo, para introducir más mutaciones según sea necesario.

La tubería computacional generó 92 secuencias de nanobodios que se sintetizaron y probaron en un laboratorio del mundo real, descubriendo que la mayoría de ellas eran en realidad proteínas que se pueden producir y manejar. Dos de estas proteínas ganaron afinidad con las proteínas SARS-CoV-2 que fueron diseñadas para unirse, tanto a mutantes modernos como a formas ancestrales.

Estas tasas de éxito son similares a las que provienen de proyectos análogos que se ejecutan en forma tradicional (que es ejecutada por humanos), pero tardaron mucho menos tiempo en concluir. Y duele decirlo, pero estoy bastante seguro de que el laboratorio virtual implicaba costos mucho más bajos en general, ya que involucraba muchas menos personas (de ahí los salarios).

Como en un grupo humano de científicos: reuniones, roles y colaboración

Vimos anteriormente cómo el laboratorio virtual imita cómo sucede la ciencia humana: a través de reuniones interdisciplinarias estructuradas. Cada reunión es una “reunión de equipo”, donde múltiples agentes discuten preguntas amplias (el PI comienza, otros contribuyen, las revisiones de los críticos y el PI resume y decide); o una “reunión individual” donde un solo agente (con o sin el crítico) trabaja en una tarea específica, por ejemplo, código de escritura o salidas de puntuación.

Para evitar las alucinaciones y la inconsistencia, el sistema también utiliza reuniones paralelas; Es decir, la misma tarea se ejecuta varias veces con diferente aleatoriedad (es decir, a alta “temperatura”). Es interesante que los resultados de estas varias reuniones sean condensados en una sola reunión de fusión de baja temperatura que es mucho más determinista y puede decidir con bastante seguridad qué conclusiones, entre todas provienen de las diversas reuniones, tienen más sentido.

Claramente, estas ideas se pueden aplicar a cualquier otro tipo de interacción múltiple de agente, ¡y para cualquier propósito!

¿Cuánto hicieron los humanos?

Sorprendentemente poco, para la parte computacional, por supuesto, ¡ya que los experimentos aún no pueden ser tan automatizados, aunque sigan leyendo para encontrar algunos reflexiones sobre los robots en los laboratorios!

En esta ronda de laboratorio virtual, los agentes de LLM escribieron 98.7% del total de palabras (más de 120,000 tokens), mientras que el investigador humano contribuyó con solo 1,596 palabras en total en todo el proyecto. Los agentes escribieron todos los scripts para ESM, postprocesamiento de Alfafold-multimer y flujos de trabajo de Rosetta XML. El humano solo ayudó a ejecutar el código y facilitó los experimentos del mundo real. La tubería de laboratorio virtual se construyó en 1-2 días de solicitación y reuniones, y el cálculo de diseño de nanobodos se ejecutó en ~ 1 semana.

Por qué esto importa (y qué viene después)

El Laboratorio virtual Podría servir como prototipo para un modelo de investigación fundamentalmente nuevo, y en realidad para una forma fundamentalmente nueva de trabajar, donde todo lo que se puede hacer en una computadora se deja automatizado, y los humanos solo toman las decisiones muy críticas. Los LLM están cambiando claramente de herramientas pasivas a colaboradores activos que, como muestra el laboratorio virtual, pueden impulsar proyectos interdisciplinarios complejos desde la idea hasta la implementación.

¿El próximo salto ambicioso? Reemplace las manos de los técnicos humanos, que realizaron los experimentos, con los robóticos. Claramente, la siguiente frontera es automatizar la interacción física con el mundo real, que es esencialmente lo que son los robots. Imagínese entonces la tubería completa aplicada a un laboratorio de investigación:

- Un PI humano define un objetivo biológico de alto nivel.

- El equipo investiga la información existente, escanean bases de datos, ideas de lluvia de ideas.

- Un conjunto de agentes de IA selecciona herramientas computacionales si es necesario, escribe y ejecuta código y/o análisis, y finalmente propone experimentos.

- Luego, los técnicos de laboratorio robótico, en lugar de técnicos humanos, llevan a cabo los protocolos: pipeteo, centrifugación, placas, imágenes, recopilación de datos.

- Los resultados vuelven al laboratorio virtual, cerrando el bucle.

- Los agentes analizan, se adaptan, iteran.

Esto haría que el proceso de investigación sea realmente autónomo de extremo a extremo. Desde la definición del problema hasta la ejecución del experimento y la interpretación de los resultados, todos los componentes serían ejecutados por un sistema integrado de AI-robótica con una intervención humana mínima: dirección de alto nivel, supervisión y visión global.

Los laboratorios de biología robótica ya están siendo prototipos. Esmerald Cloud Lab, Strateos y Transcriptic (ahora parte de Colabra) ofrecen robótico de laboratorio húmedo como servicio. Future House es una construcción de IA sin fines de lucro para automatizar la investigación en biología y otras ciencias complejas. En la academia, existen algunos laboratorios de química autónomos cuyos robots pueden explorar el espacio químico por su cuenta. Las biofundries usan manejadores líquidos programables y brazos robóticos para flujos de trabajo de biología sintética. ADAPTYV BIO automatiza la expresión y las pruebas de proteínas a escala.

Tales tipos de sistemas de laboratorio automatizados acoplados a sistemas emergentes como Virtual Lab podrían transformar radicalmente cómo progresan la ciencia y la tecnología. La capa inteligente impulsa el proyecto y le da a esos robots que funcionen, cuya salida se alimenta de regreso a la herramienta de pensamiento en un motor de descubrimiento de circuito cerrado que funcionaría las 24 horas, los 7 días de la semana sin fatiga o conflictos de programación, realiza cientos o miles de microexperimentos en paralelo y explorará rápidamente espacios de hipótesis que no son viables para los laboratorios humanos. Además, los laboratorios, los laboratorios virtuales y los gerentes ni siquiera necesitan estar físicamente juntos, permitiendo optimizar cómo se extienden los recursos.

Hay desafíos, por supuesto. La ciencia del mundo real es desordenada y no lineal. Los protocolos robóticos deben ser increíblemente robustos. Los errores inesperados todavía necesitan juicio. Pero a medida que la robótica y la IA continúan evolucionando, esas brechas ciertamente se encogerán.

Pensamientos finales

Los humanos siempre confiamos en que la tecnología en forma de computadoras y robots inteligentes nos expulsaría de nuestros trabajos físicos altamente repetitivos, mientras que la creatividad y el pensamiento seguirían siendo nuestro dominio de dominio durante décadas, tal vez siglos. Sin embargo, a pesar de una gran automatización a través de robots, la IA de la década de 2020 nos ha demostrado que la tecnología también puede ser mejor que nosotros en algunos de nuestros trabajos más intensivos en el cerebro.

En el futuro cercano, LLM no solo responde nuestras preguntas o apenas nos ayude con el trabajo. Pedirán, argumentarán, debatirán, decidirán. ¡Y a veces, descubrirán!

Referencias y lecturas adicionales

El Naturaleza Documento analizado aquí:

https://www.nature.com/articles/s41586-025-09442-9

Otros descubrimientos científicos de AI Systems: