El desarrollo de la IA está pasando de modelos estáticos centrados en tareas a sistemas dinámicos y adaptables basados en agentes adecuados para diversas aplicaciones. Los sistemas de IA tienen como objetivo recopilar datos sensoriales e interactuar de manera efectiva con los entornos, un objetivo de investigación de larga data. El desarrollo de IA generalista ofrece ventajas, incluido el entrenamiento de un único modelo neuronal en múltiples tareas y tipos de datos. Este enfoque es altamente escalable a través de datos, recursos computacionales y parámetros del modelo.

Trabajos recientes destacan las ventajas de desarrollar sistemas de IA generalistas entrenando un único modelo neuronal en varias tareas y tipos de datos, ofreciendo escalabilidad a través de datos, computación y parámetros del modelo. Sin embargo, los desafíos persisten, ya que los modelos de gran base a menudo producen alucinaciones e infieren información incorrecta debido a una base insuficiente en entornos de entrenamiento. Los enfoques actuales de sistemas multimodales, que se basan en modelos congelados previamente entrenados para cada modalidad, pueden perpetuar errores sin un entrenamiento previo intermodal.

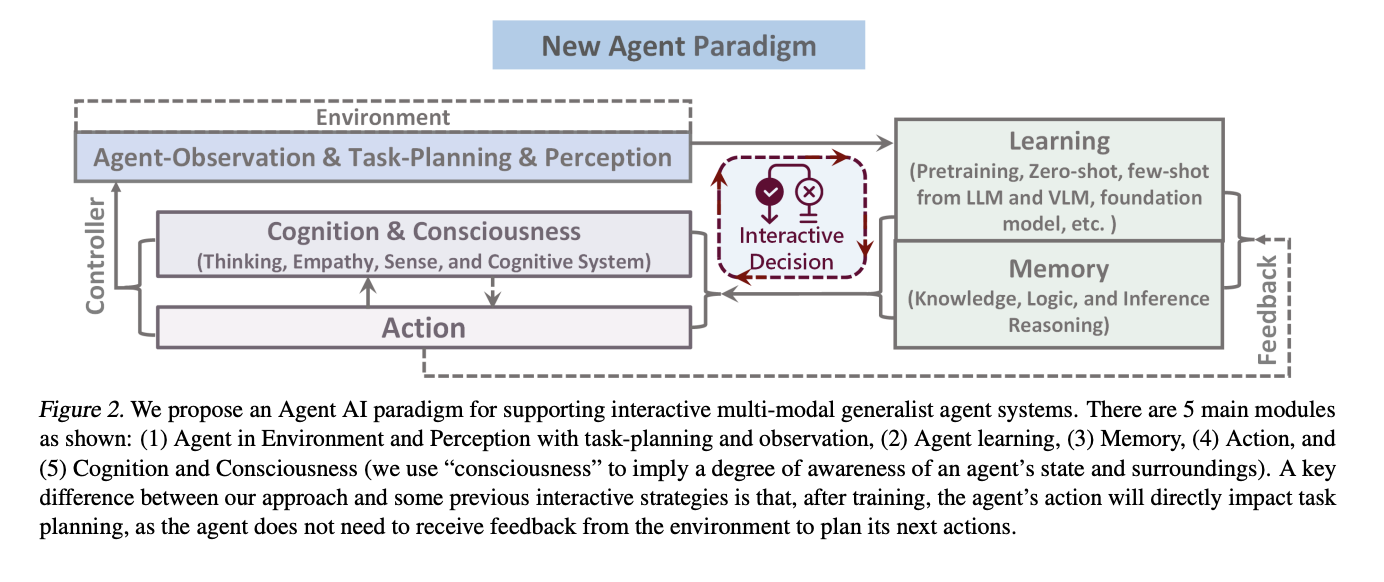

Investigadores de la Universidad de Stanford, Microsoft Research, Redmond y la Universidad de California, Los Ángeles, han propuesto la Modelo de base de agente interactivo, que introduce un marco de preentrenamiento unificado para procesar texto, datos visuales y acciones, tratando cada uno como tokens separados. Utiliza modelos de lenguaje visual y lenguaje previamente entrenado para predecir tokens enmascarados en todas las modalidades. Permite la interacción con humanos y entornos, incorporando la comprensión del lenguaje visual. Con parámetros de 277 millones previamente entrenados conjuntamente en diversos dominios, se involucra de manera efectiva en entornos multimodales en varios entornos virtuales.

El Modelo de base de agente interactivo inicializa su arquitectura con CLIP ViT-B16 previamente entrenado para codificación visual y OPT-125M para modelado de acción y lenguaje. Incorpora el intercambio de información intermodal a través de una transformación de capa lineal. Debido a limitaciones de memoria, se incluyen como entrada acciones previas y marcos visuales, con un enfoque de ventana deslizante. Las incrustaciones posicionales sinusoidales se utilizan para predecir tokens visibles enmascarados. A diferencia de los modelos anteriores que se basan en submódulos congelados, todo el modelo se entrena conjuntamente durante el preentrenamiento.

La evaluación de tareas de robótica, juegos y atención médica demuestra resultados prometedores. A pesar de ser superado en determinadas tareas por otros modelos debido a la menor cantidad de datos para el entrenamiento previo, el método muestra un rendimiento competitivo, especialmente en robótica, donde supera significativamente a un modelo comparativo. El ajuste fino del modelo previamente entrenado resulta notablemente efectivo en tareas de juego en comparación con el entrenamiento desde cero. En aplicaciones de atención médica, el método supera varias líneas de base aprovechando CLIP y OPT para la inicialización, lo que demuestra la eficacia de su enfoque diverso de preentrenamiento.

En conclusión, los investigadores propusieron la Modelo de base de agente interactivo, que es experto en procesar texto, acciones y entradas visuales y demuestra eficacia en diversos dominios. El entrenamiento previo en una combinación de robótica y datos de juegos permite que el modelo modele acciones de manera competente, incluso mostrando una transferencia positiva a tareas de atención médica durante el ajuste. Su amplia aplicabilidad en contextos de toma de decisiones sugiere potencial para agentes generalistas en sistemas multimodales, abriendo nuevas oportunidades para el avance de la IA.

Revisar la Papel. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 37k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

Asjad es consultor interno en Marktechpost. Está cursando B.Tech en ingeniería mecánica en el Instituto Indio de Tecnología, Kharagpur. Asjad es un entusiasta del aprendizaje automático y el aprendizaje profundo que siempre está investigando las aplicaciones del aprendizaje automático en la atención médica.