La aparición de modelos de lenguajes grandes multimodales (MLLM), como GPT-4 y Gemini, ha despertado un interés significativo en combinar la comprensión del lenguaje con diversas modalidades como la visión. Esta fusión ofrece potencial para diversas aplicaciones, desde inteligencia incorporada hasta agentes GUI. A pesar del rápido desarrollo de MLLM de código abierto como BLIP y LLaMA-Adapter, su rendimiento podría mejorarse con más datos de entrenamiento y parámetros del modelo. Si bien algunos destacan en la comprensión de imágenes naturales, necesitan ayuda con tareas que requieren conocimientos especializados. Además, los tamaños de los modelos actuales pueden no ser adecuados para la implementación móvil, lo que requiere la exploración de arquitecturas más pequeñas y ricas en parámetros para una adopción más amplia y un mejor rendimiento.

Investigadores del Laboratorio de IA de Shanghai, MMLab, CUHK, la Universidad de Rutgers y la Universidad de California en Los Ángeles han desarrollado SPHINX-X, una serie MLLM avanzada basada en el marco SPHINX. Las mejoras incluyen la optimización de la arquitectura mediante la eliminación de codificadores visuales redundantes, la optimización de la eficiencia del entrenamiento con tokens de omisión para subimágenes completamente rellenas y la transición a un paradigma de entrenamiento de una sola etapa. SPHINX-X aprovecha un conjunto de datos multimodal diverso, aumentado con datos de conjunto de marcas y OCR seleccionados, y está capacitado en varios LLM básicos, ofreciendo una variedad de tamaños de parámetros y capacidades multilingües. Los resultados comparativos subrayan la generalización superior de SPHINX-X en todas las tareas, abordando las limitaciones anteriores de MLLM y al mismo tiempo optimizando la capacitación multimodal eficiente a gran escala.

Los avances recientes en los LLM han aprovechado las arquitecturas Transformer, ejemplificadas notablemente por los parámetros 175B de GPT-3. Otros modelos como PaLM, OPT, BLOOM y LLaMA han seguido su ejemplo, con innovaciones como la atención a las ventanas de Mistral y las escasas capas MoE de Mixtral. Al mismo tiempo, han surgido LLM bilingües como Qwen y Baichuan, mientras que TinyLlama y Phi-2 se centran en la reducción de parámetros para la implementación de borde. Mientras tanto, los MLLM integran codificadores sin texto para la comprensión visual, con modelos como las series BLIP, Flamingo y LLaMA-Adapter superando los límites de la fusión visión-lenguaje. Los MLLM detallados como Shikra y VisionLLM se destacan en tareas específicas, mientras que otros extienden los LLM a diversas modalidades.

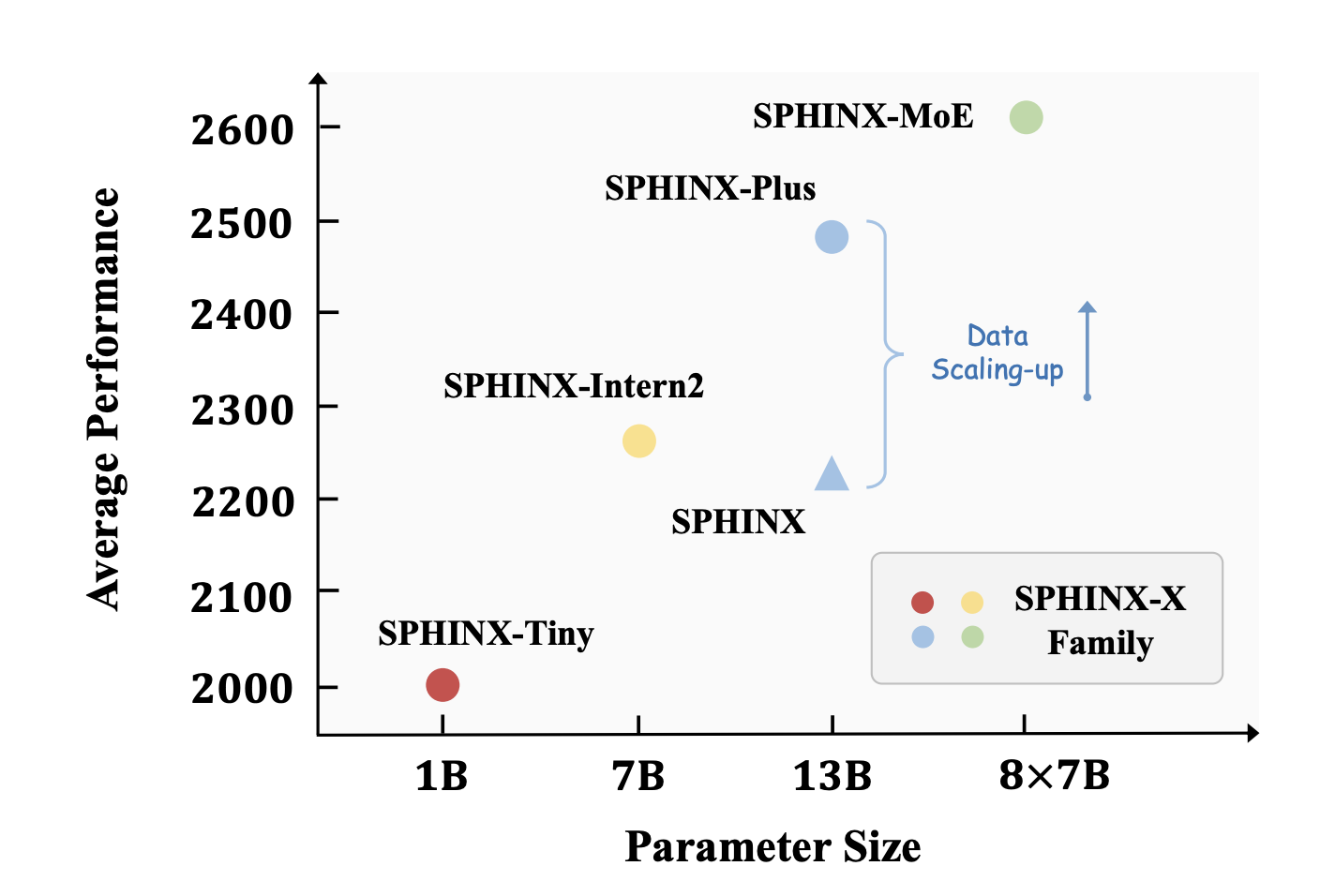

El estudio revisa los principios de diseño de SPHINX. Propone tres mejoras a SPHINX-X, incluida la brevedad de los codificadores visuales, tokens de salto que se pueden aprender para señales ópticas inútiles y entrenamiento simplificado en una sola etapa. Los investigadores reúnen un conjunto de datos multimodal a gran escala que cubre tareas de lenguaje, visión y visión-lenguaje y lo enriquecen con conjuntos de datos de conjunto de marcas y intensivos en OCR seleccionados. La familia SPHINX-X de MLLM está entrenada sobre diferentes LLM base, incluidos TinyLlama-1.1B, InternLM2-7B, LLaMA2-13B y Mixtral-8×7B, para obtener un espectro de MLLM con diferentes tamaños de parámetros y capacidades multilingües.

Los MLLM SPHINX-X demuestran un rendimiento de última generación en diversas tareas multimodales, incluido el razonamiento matemático, la comprensión de escenas complejas, tareas de visión de bajo nivel, evaluación de la calidad visual y resiliencia al enfrentar ilusiones. Una evaluación comparativa integral revela una fuerte correlación entre el rendimiento multimodal de los MLLM y las escalas de datos y parámetros utilizados en el entrenamiento. El estudio presenta el desempeño de SPHINX-X en puntos de referencia seleccionados como HalllusionBench, AesBench, ScreenSpot y MMVP, mostrando sus capacidades en alucinación del lenguaje, ilusión visual, percepción estética, localización de elementos GUI y comprensión visual.

En conclusión, SPHINX-X avanza significativamente los MLLM, basándose en el marco SPHINX. A través de mejoras en la arquitectura, la eficiencia del entrenamiento y el enriquecimiento del conjunto de datos, SPHINX-X exhibe un rendimiento y una generalización superiores en comparación con el modelo original. La ampliación de los parámetros amplifica aún más sus capacidades de comprensión multimodal. La publicación de código y modelos en GitHub fomenta la replicación y la investigación adicional. Con mejoras que incluyen una arquitectura optimizada y un conjunto de datos completo, SPHINX-X ofrece una plataforma sólida para el ajuste de instrucciones multimodal y multipropósito en una variedad de escalas de parámetros, lo que arroja luz sobre futuros esfuerzos de investigación de MLLM.

Revisar la Papel y GitHub. Todo el crédito por esta investigación va a los investigadores de este proyecto. Además, no olvides seguirnos en Gorjeo y noticias de Google. Unirse nuestro SubReddit de 37k+ ML, 41k+ comunidad de Facebook, Canal de discordiay LinkedIn Grarriba.

Si te gusta nuestro trabajo, te encantará nuestro Boletin informativo..

No olvides unirte a nuestro Canal de telegramas

A Sana Hassan, pasante de consultoría en Marktechpost y estudiante de doble titulación en IIT Madras, le apasiona aplicar la tecnología y la inteligencia artificial para abordar los desafíos del mundo real. Con un gran interés en resolver problemas prácticos, aporta una nueva perspectiva a la intersección de la IA y las soluciones de la vida real.